联合多尺度和注意力-残差的深度监督乳腺癌分割

2021-07-03秦传波宋子玉曾军英田联房

秦传波,宋子玉,曾军英*,田联房,李 芳

(1.五邑大学 智能制造学部,广东 江门529020;2.华南理工大学 自动化科学与工程学院,广东 广州510640;3.江门市妇幼保健院,广东 江门529020)

1 引言

乳腺癌是众多严重影响女性患者生活质量和身心健康的疾病之一。相较于钼靶、超声、X-ray、MRI、Thermogram等类型影像[1],动态对比度增强MRI影像(Dynamic Contrast-En⁃hanced Magnetic Resonance Imaging,DCEMRI)对高密度腺体组织的乳腺癌诊断价值大,是一种以病变区和正常组织中的微血管系统为生理基础的无辐射磁共振功能成像技术。DCE-MRI对于早期乳腺癌诊断敏感性强、乳腺癌的分期、分子分型的确诊和病变范围的一致性表现良好。乳腺癌病变区的自动化分割在早期诊断、预防、术中引导和预后具有重大临床研究价值,是实现人工智能计算机辅助诊断系统的关键基础。

DCE-MRI乳腺癌主要分为肿块和非肿块两种类型。乳腺癌病变区主要沿腺体分布,肿块形乳腺癌相对容易辨识和分割,而非肿块乳腺癌病变区的形态变化不一,且病变区强度不一,存在空洞、弱边界和较低的对比度,容易造成放射科医生的漏检和错判。然而,手动勾画乳腺癌病变区要求放射科医生具备丰富的临床经验和技巧,并且是一种劳动密集型的工作,易受主观、心理波动和生理疲劳的影响,导致乳腺病变勾画结果存在一定的随机性。综上,DCE-MRI乳腺癌自动化准确分割是一个具有挑战性的课题,极具临床应用价值和研究意义。

当前乳腺癌影像的研究主要集中在钼靶、超声、X射线和组织病理图像分析[2-4],但对DCEMRI乳腺癌影像的研究目前尚没有统一的公开数据库可以使用,且临床乳腺癌图像病例收集工作量大,样本相对少,且病灶区面积小,背景复杂,易造成漏分割和钙化区误分割,分割精度尚有较大提升空间。

目前,乳腺癌分割算法研究可以大致化分为经典机器学习方法和当前流行的深度学习方法。乳腺癌分割经典机器学习方法主要包括模糊聚类(Fuzzy C-Means,FCM)、活动轮廓模型(Ac⁃tive Contour Model,ACM)、条件随机场、Graph Cut等方法[5-8]。文献[5]选取冠状位影像,采用基于FCM和体积增长实现DCE-MRI乳腺癌图像分割,但需要先手动选定感兴趣区域(Region of Interest,ROI),对于大部分病灶分割结果需手动调整参数;文献[6]根据肿瘤的时间,空间和形态属性,使用图割(Graph Cuts)进行分割,构建一个癌症诊断的框架;文献[7]利用MRF和条件独立性构建了动力学观测模型,将DCE-MRI乳腺动态特征图作为MRF肿瘤分割的观察通道。并将分割结果应用于乳腺癌复发预测。基于偏微分方程的ACM方法在医学影像分割上得到广泛应用;文献[8]针对非肿块乳腺癌病变区分割,通过MRF能量区分肿瘤与背景,再使用能量项后验概率作为ACM区域项,而后根据纹理、强度信息构建ACM速度函数,构建了一个复杂的ACM分割目标函数。但需要事先手动分割出ROI,在小范围病例内有较好分割效果。且计算成本高,耗时长,需要人为调整参数以适应变化的乳腺癌影像。

对于基于传统机器学习方法而言,由于乳腺癌病变区具有对比度低、边界模糊及亮度不均匀等特点,通常需要手动选取ROI,再进行分割处理,或者对分割后结果进行后处理,才能得到平滑和连续的分割边界。通常需要手动调整参数才能适应形态各异的病灶区,显然不是一套完备的自动化分割方案。不适合在大量病例数据上实现自动化分割。

近年来,基于深度学习的图像分割、检测和分类方法取得很大进展[4,9-10]。杜克大学提出了一种掩模引导分层式FCN分割框架[11],通过两个级联FCN粗分割和FCN细分割模型,在前后两个阶段分别完成乳房区域粗略勾画和乳腺癌病变区的精确分割。在其自建的数据库上进行训练和测试,分割关键指标平均Dice值达到0.72。然而,对于体素比较小的乳腺癌病变区存在漏分割、错分割和分割不准确的问题,并且模型架构单一,仅使用FCN级联架构,没有引入更多有效的措施提升分割精度,诸如注意力和监督机制。这也为本文进行下一步深入研究乳腺癌病变区的精确分割提供了思路。

注意力机制[12]、多尺度和监督学习[13-14]表明能有效改善深度学习模型效果。深圳研究院提出基于深度表示的跨模态乳腺MRI影像分割模型[15]。受知识蒸馏和注意力转移策略启发,采用有监督跨模态学习方式对T 1c和T 2W两种序列进行融合,同时引入注意力机制实现有效的信息选择和抑制噪声。

由于DCE-MRI乳腺癌背景复杂,胸腔、乳房等组织占据影像的很大比例的面积,而乳腺癌病变区所占面积相对较小,在乳腺癌分割任务中,先勾画出乳房区域ROI,可进一步提高分割精度[11]。文献[16-17]采用经典U-net[18]为基础,将乳房区域与胸壁线分离。证明了使用U形网络进行乳房ROI提取的可行性。

2 所提出的方法

乳腺癌病变区形态各异且边界模糊,所占面积小,是个典型的分类不均衡问题,并且周围背景复杂,存在心脏、胸壁、皮肤、肌肉和脂肪等组织,严重影响和干扰乳腺癌图像的自动化分割[11]。由于乳腺癌区域相对整张影像所占面积小,为充分挖掘其语义信息,本文提出了一个二阶段的乳腺癌分割框架。

在第一个阶段,重新训练了U-Net模型来提取一个粗略的乳房区域ROI,消除乳房周边胸肌肉、脂肪、心脏等不相关组织对乳房区域内乳腺癌分割的影响。

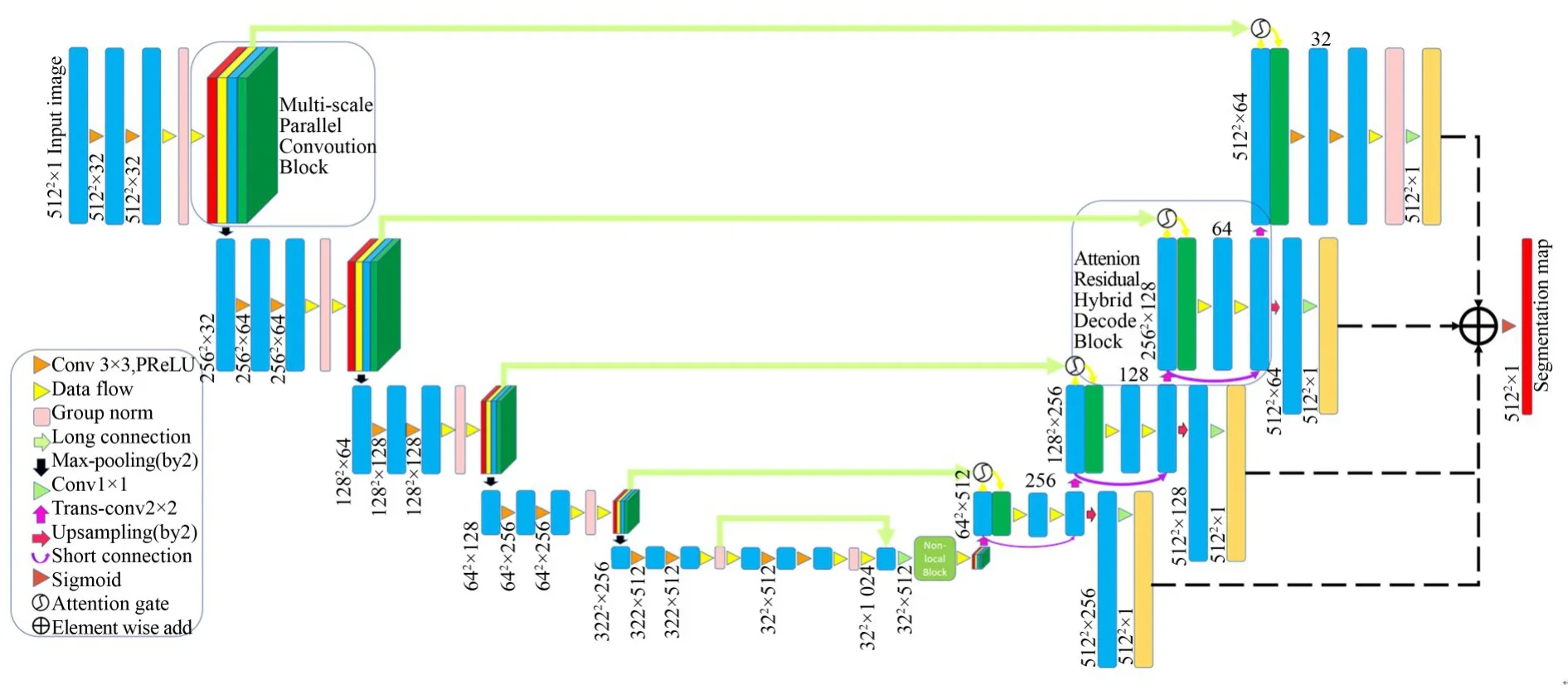

在第二个阶段,基于阶段一粗分割乳房ROI,提出了一种UTB-Net模型,实现乳腺肿瘤分割,模型如图1所示。

图1 所提深度监督UTB-Net架构Fig.1 Proposed deep supervision UTB-Net架构

所提模型以改进的U-Net为基准,设计并融合多尺度并行卷积融合模块、Non-local模块[19]、注意力-残差混合解码模块,提出了融合深度监督的UTB-Net模型。采用深度监督的UTB-Net模型可以提取更加丰富的细节信息,结合全局注意力和局部注意力对细小的乳腺癌病灶进行更准确的定位,而深度监督机制则能加强网络对前景的响应。

本文主要所做的工作和贡献如下:

(1)在编码路径,提出多尺度并行卷积融合模块。采用多尺度的并行卷积结构,通过不同核大小的卷积操作提取不同尺度的特征信息,丰富模型提取边缘信息与精细信息的能力。

(2)对基准U-Net网络模型进行微调。在编码路径采用PReLU激活函数,减少网络非线性表达的信息丢失,将BatchNorm换成Group⁃Norm[20],以此来减少计算量不足对分割精度的影响。并在编码路径的末端增加了Non-local,从而高效地获取全局相关信息,以此形成一个全局的注意力机制。

(3)在解码端,提出结合注意力和残差的混合解码模块,将注意力模块的非线性整流单元与残差结合来构建解码模块,以此来改善网络信息流向,提高特征提取能力。

实验表明,所提出的模型不但对于肿块和非肿块有较好的分割结果,提高分割精度的同时对于小体素、小面积的乳腺癌图像也具有良好的分割效果。

2.1 乳房ROI提取

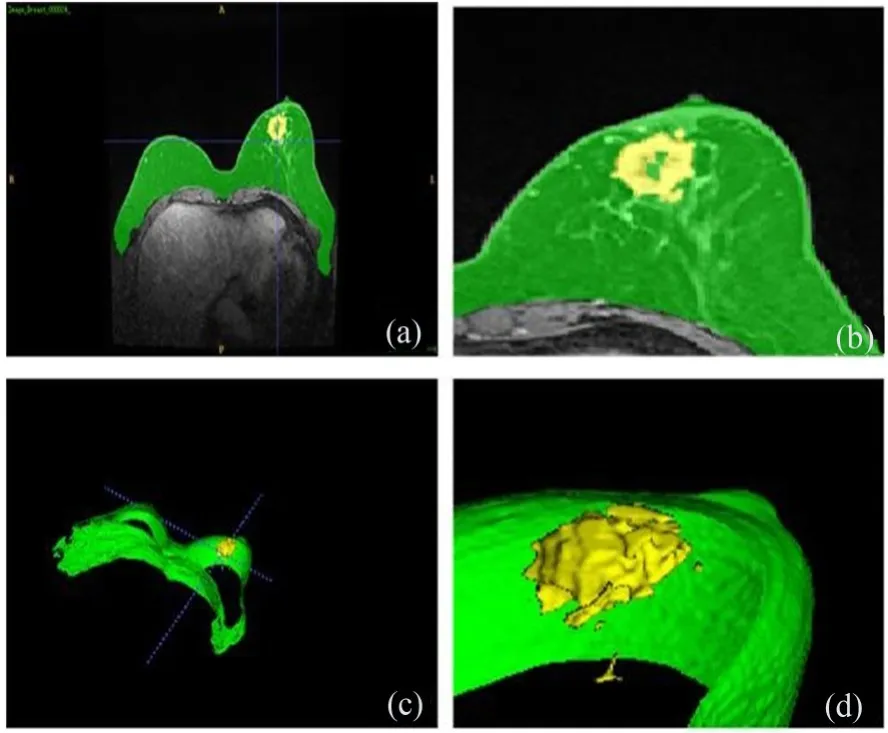

乳腺肿瘤病变区通常出现在乳房区域,极少出现在胸壁线的位置或者乳房边缘。事先提取一个粗糙的乳房区域ROI,有利于下一步乳腺癌的准确分割[11]。在第一个阶段,根据临床医生勾画的乳房区域标签,重新设计了医学影像分割任务中常用的基准U-Net模型,实现乳房ROI粗略勾画,如图2所示(彩图见期刊电子版)。图2(a)是DCE-MRI乳腺癌水平位影像,乳房区域ROI用绿色标签标记,乳腺癌区域用黄色区域标记。图2(b)是局部放大图,可见乳腺癌有边界不规则、空洞等特征。图2(c)是用ITK-Snap工具重建3D效果图。图2(d)从空间角度展示了乳房组织和乳腺癌之间空间关系。

图2 DCE-MRI乳腺癌示意图Fig.2 Illustration of DCE-MRI breast tumor

2.2 微调基准U-Net模型

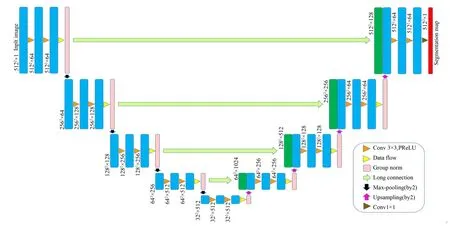

为了充分挖掘乳腺肿瘤区域的语义信息,对基准U-net模型分别做了微调和改进。微调UNet架构细节如图3所示。

图3 微调的U-net模型Fig.3 Illustration of Fine-tuned U-net model

首先,编码区与解码区特征提取单元采用的激活函数用PReLU替换掉ReLU,以此来减少信息的丢失;其次,又因医学影像计算量大,采用GroupNorm作为归一化层,以缓解显卡内存不足对分割精度的影响;特征提取单元基本结构为Conv→PReLU→Conv→PRe⁃LU→GroupNorm;最后,在编码路径的最后一层,进 行 两 次Conv→PReLU→Conv→PReLU→GroupNorm操作,而后将信息融合压缩至与原通道数一致,目的是保证不增加参数的同时提取更多高级特征信息。在后续实验分析部分,其实验结果表明,相较于基准U-net模型,经微调的U-net也可以取得较好分割效果。

其次,基于所提模型的微调U-Net模型结构基础,在其编码路径上,进一步整合本文所构建的多尺度并行卷积模块;在编码路径末端加入Non-local模块;在解码路径上加入了所提出的注意力-残差混合解码模块,并对各层解码输出使用多尺度深度监督机制进行融合。即分别在微调U-Net模型的编码路径、编码末端和解码路径进行改进,构建所提出的UTBNet模型。

2.3 所提出的UTB-Net分割模型构建方法

下面将详尽阐述UTB-Net的构建过程,即如何将多尺度并行卷积模块、Non-local模块和注意力、残差混合解码模块和多尺度监督分别嵌入至微调的U-Net模型的编码路径和解码路径。

2.3.1 多尺度并行卷积融合模块

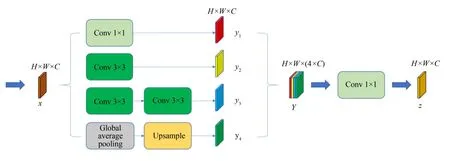

因乳腺癌区域大小不定、形状各异、灰度不均且边界模糊,在模型引入多尺度并行卷积融合(Multi-Scale Parallel Convolution Fusion,MSP⁃CF)模块,如图4所示。并行卷积结构能够在同一层级获得不同感受野的特征,提高模糊边缘和小面积肿块的乳腺癌分割精度,然后将不同尺度的信息融合传递至下一层,可以在提高精度的同时灵活地平衡计算量和模型能力。

图4 多尺度并行卷积融合模块Fig.4 MSPCF Block

MSPCF模块包含3个并行卷积层和1个全局平均池化层、1个1×1卷积层。3个并行卷积操作的卷积核尺寸分别为1×1,3×3和5×5,其中5×5的卷积核经过卷积分解处理[21],用2个3×3的卷积核替代。卷积分解使用小的卷积核级联替代大的卷积核,可以获得相同的感受野,同时在一定程度上减少模型的参数,提高模型的非线性表达能力。

MSPCF模块采用不同大小的卷积核获取多尺度的上下文特征信息,其中1×1的卷积层则保留当前尺度的特征信息。MSPCF模块还使用了全局平均池化层,获取像素级的全局信息,而后通过双线性插值上采样得到所需的维度,再通过1×1卷积将全局平均池化层信息与三个并行卷积层信息融合并压缩。然后将输出特征图传递至下一层。

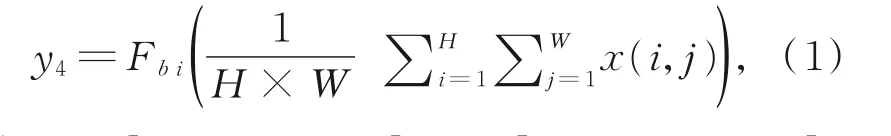

在分割任务中,将此MSPCF模块融合至所提出的网络的编码部分。在图4中,y4的的计算公式如式(1)所示:

其中:x=[x1,x2,...,xc],y4=[y41,y42,...,y4c],F bi(x)表示双线性插值,然后将所有分支的特征图整合为Y,其中Y=[y1,y2,y3,y4]。最后,通过一个[1×1,C]的卷积操作将多尺度信息聚集到一起得到输出特征图z。

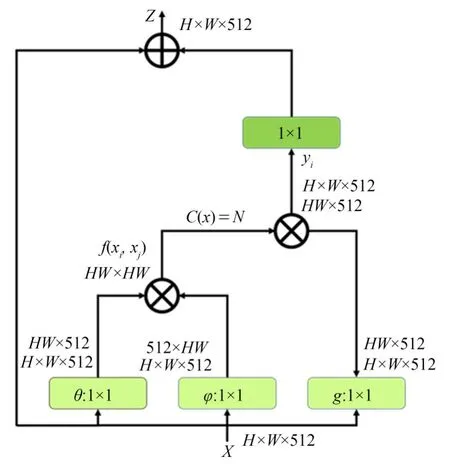

2.3.2 Non-local模块

众所周知,卷积操作通常关注局部的感受野。如果要增大感受野,传统的方法是堆叠卷积层和池化层来实现,但这样会增加模型的参数量和计算量。Wang等人[19]借鉴图像去噪的思想而提出Non-local模块,用来获取长距离之间的关联信息,最终实现每个像素的全局感受野,并通过不同的操作,可以获得不同空间、时间、通道的像素之间的信息相关性,按照非局部均值定义,具体结构如图5所示。其中,C(x)是归一化参数,在实验中设置为x的位置数量,用N来表示。x表示输入的信号。y表示输出的信号,其面积和输入信号相同。g(x i)用于计算输入信号在j位置的特征值。f(x i,x j)则表示点乘相似度,在本方法中采用点积表示。其中:

图5 Non-local模块架构[19]Fig.5 Non-local block architecture[19]

将Non-local架构定义为一个残差形式,使其具有灵活性,不需要循环渐进的训练,可以十分方便的整合到一个标准CNN架构中,以此来改善模型的敏感性和准确性,并且不需要改变原有结构,输出信号zi=W z yi+x i,x i表示残差,W z表示一系列的卷积操作,zi则表示下层的输入信号。可灵活地将Non-local模块整合到本文模型中。

2.3.3 注意力-残差混合解码模块

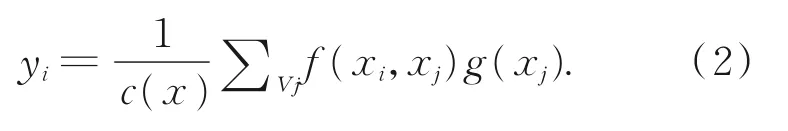

本文提出了一种注意力-残差混合解码模块(Attention-Residual Hybrid Decoding,ARHD),并将其融入本网络的解码路径当中,ARHD架构细节如图6所示。He等人[21]通过短连接构建残差模块,在一定程度上缓解了梯度消失和梯度爆炸问题,使得在训练更深的网络的同时,不增加参数量同时且能保证良好的性能。文献[12]根据软自注意力机制提出附加注意门(Additive at⁃tention Gate,AG)模块,在自动学习聚焦于不同形状和大小的目标结构同时,隐式的学习抑制输入图像中不相关区域,以此来突出特定任务中有效的显著特征,从而有效地提高分割精度。根据上述两种方法,构建了ARHD模块。

图6 注意力、残差混合解码模块Fig.6 Block of attention and residual hybrid decoding

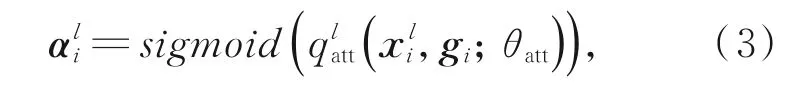

如图6所示,AG模块将深层特征信息与来自浅层的特征信息进行矩阵加法运算,再经PRe⁃LU[20]得到激活特征,然后通过sigmoid得到注意力系数。在计算注意力系数ali∈[0,1]时,由于ReLU激活函数会造成信息的丢失,所以在模块中将使用PReLU[22]函数,公式如式(3)所示:

其中:

其中:Group Norm[19]是针对batch size较小时的一种规范化方式,α是可学习参数。分别代表浅层特征和深层特征信息,是卷积操作的线性变换,sigmoid(x)=1/(1+ex)。

将AG模块输出的注意力系数与深层特征信息进行矩阵相乘运算,消除不相关特征与噪声,突出显著特征,再将结果和浅层信息加入残差连接模块,改善解码部分的梯度流动,缓解梯度弥散和网络退化问题,使深层的网络更容易训练,最后输出注意力特征图。为了方便表达,用代表矩阵相乘运算,表示最后输出的注意力特征图,实验结果分析见后续3.5节内容。

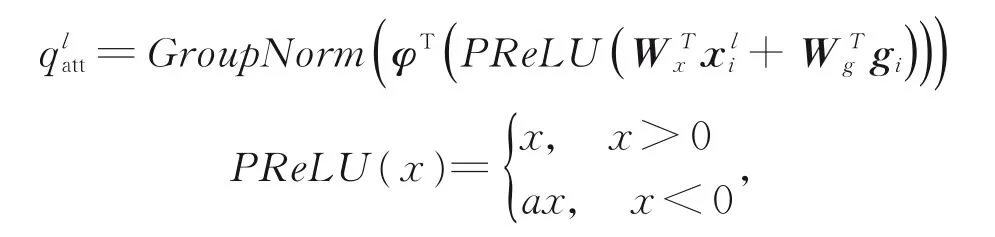

在ARHD模块中,将AG模块嵌入到解码层单元中,再加入残差连接,改善解码部分的梯度流动,缓解梯度弥散和网络退化问题,使深层的网络更容易训练。用cat来表示通道拼接操作,d表示通道拼接后的特征图,F(x)表示一系列的卷积操作,那么有:

其中:y表示最后的输出结果。最后的输出结果将经过上采样,作为下一层的输入。

2.3.4 深度监督(Deep Supervision,DS)

为解决深度模型训练时梯度消失或爆炸的优化问题,Lee等[13]提出深度监督,加快网络收敛速度、提高识别网络的识别能力。这种机制通过导出一个直接联系上下层训练的目标函数而实现,以便在训练过程中抵消不稳定的梯度变化产生的负面影响。

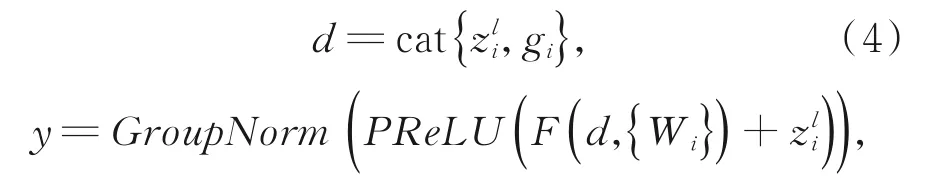

在本文所提出的网络中,如图1右侧所示,最后输出的结果将来自不同解码层输出的特征图输出结果作为深度监督的输入。对四个输出特征图使用同一种损失函数,最后将所有分支的输出结果求和取平均作为最终损失。具体表述公式如式(5)所示:

其中:yj,分别表示不同解码层输出的概率值、真实标签值,N表示分支的总数。

2.3.5 改进过程

将上述三种模块:多尺度并行卷积模块、Non-local模块和注意力、残差混合解码模块和深度监督机制,分别嵌入至微调的U-net模型的编码区和解码区。对于三种模块的加入方式,依次研究了如下3种改进:

首先,提出基于ARHD模块的ARH-UNet模型。仅在解码部分进行改进。在每个特征提取单元前嵌入ARHD模块,在乳腺肿瘤分割中,ARHD模块可以将编码区的浅层特征信息和解码区的深层特征信息进行融合,再通过注意力系数得到所要的局部显著特征,同时,因为短连接的存在使解码单元的语义信息更加丰富,改善解码部分的梯度流动,缓解梯度弥散和网络退化问题,使深层的网络更容易训练,从而简化网络的训练,有效的提高乳腺肿瘤分割精度,在实验中可以取得一定效果。

其次,提出基ARHD模块和MSPCF模块的AMH-UNet。基于上面的ARH-UNet模型,在编码部分进行改进。在每个编码部分的特征提取单元后嵌入MSPCF模块,与ARH-UNet网络融合提出AMH-UNet。用于提取位于编码部分不同层级的不同尺度的特征信息,将其融合压缩后传递至一下层或通过长连接传递至对应的解码层,以此来丰富网络提取的特征信息,在实验中对于乳腺癌病灶的分割取得较好的效果。

最后,基于上面的ARH-UNet模型,引入具有良好可移植性的Non-local模块,从而高效地获取全局相关信息,以此形成一个全局的注意力机制。又因为Non-local模块计算开销大,所以我们将其放置在编码部分最后一层,从而提出UTBNet网络。并在解码路径的各层输出引入深度监督,构建基于深度监督的UTB-Net,模型具体细节如图1所示,其实验效果表现最佳,详见后续章节3实验对比分析。

UTB-Net可以提取丰富的浅层、深层特征信息,跟已有的乳腺病灶分割网络相比,通过全局注意力与局部注意力相辅相成,实现准确地病灶定位、分割。最后,为了避免长连接的浅层语义信息影响病灶像素级分割,采用深度监督机制使解码单元间特征在每个图像尺度上具有语义识别能力,以此来确保不同尺度的注意力单元能够对特征中前景信息产生最大响应。

2.3.6 Loss Function

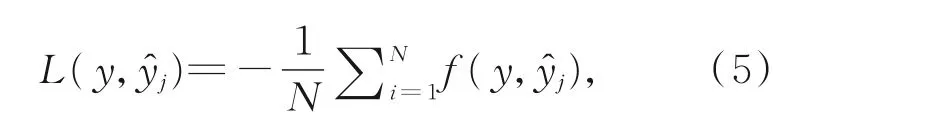

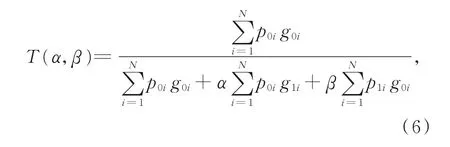

在医学图像分割中的一个重要挑战就是数据不平衡。一般情况下,大部分数据集中的病灶体素的数量远低于非病变体素的数量,乳腺癌数据集亦如此,并且乳腺病灶的面积远小于乳房区域面积。数据集训练出的模型会对分割精度产生影响。为此,针对该种情况采用Tversky[23]损失函数。它是一种基于Tversky指数的广义损失函数,可以有效解决数据不平衡的问题,在精度和召回率之间达到更好的平衡。公式如式(6)所示:

其中:p,g为网络最后一层sigmoid输出的结果。p0i为病变体素的输出概率,p1i非病变体素的输出概率。类似地,对于g,0表示病变体素输出概率,1表示非病变体素输出的概率。α,β则分别控制假阴性和假阳性,可以通过调整α,β来控制假阳性和假阴性之间的权衡,在实验中α=0.3,β=0.7。

3 实验与分析

在这项研究应用中,服务器硬件配置为:In⁃tel(R)Core(TM)i9-9900K CPU@3.60 GHz×16;GPU显卡配置为GeForce RTX 2080 Ti;操作系统为Ubuntu 18.04;采用Python3.6编程语言;使用基于Pytorch1.3的深度学习框架。

3.1 数据库及预处理

本文实验所用DCE-MRI影像数据为160例自建临床数据库,采集乳腺癌影像的设备型号是西门子MAGNETO 1.5T MRA,配备乳腺专用4通道相控阵表面线圈。在采集过程中病人的姿态呈俯卧位。筛选后最终入库160例T 2期DCE-MRI临床数据,影像为横切面方向,图像大小512×512。乳房ROI区域的标签制作由临床医生借助LabelMe软件手动进行标注。乳腺癌的标签制作使用了医学影像软件3D slicer。对于临床160例影像数据,随机划分为训练集128例,测试集32例,在训练时对数据进行了镜像、缩放、弹性形变等数据增强操作。在训练过程中又对数据进行有效的预处理,首先删除前0.1%与后0.1%的像素值进行去噪,然后进行灰度归一化操作。对于乳房ROI区域提取与乳腺癌病灶分割采用同一批训练集和测试集,二者在整体框架上是一种先后顺序的二阶段结构,在训练过程中分别对两个模型进行先后训练。首先使用微调U-net模型进行乳房ROI区域提取,其次对于乳腺癌病灶分割在训练过程中使用He[22]归一化算法进行初始化,Adam优化器[25]进行梯度下降,参数设置为:β1=0.9,β2=0.999,ε=1e-8、学习率为1e-3。Batch size设置为2,每个模型迭代次数为200,最后通过sigmoid函数得到输出结果,因为其输出值域为(0,1),所以最后输出结果通过设置阈值(threshold=0.3)来判断。

3.2 分割评价标准

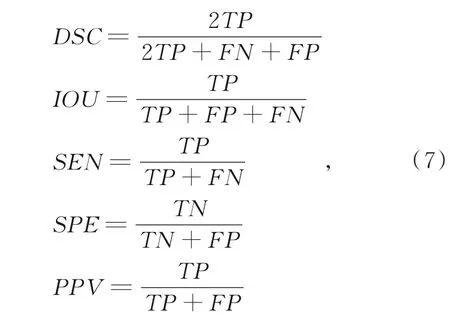

评估分割结果借鉴五种常用的医学影像分割评估指标:Dice coefficient(DSC)、Intersection over Union(IoU)、敏感性(Sensitivity)、特异性(Specificity)、阳性预测值(Positive predictive val⁃ue),公式如式(7)所示。

其中:TP是像素级分割中前景分割正确的像素点数,TN是像素级分割中背景分割正确的像素点数,FP是像素级分割中背景分割错误的像素点数,FN是像素级分割中前景分割错误的像素点数。

3.3 乳房ROI分割

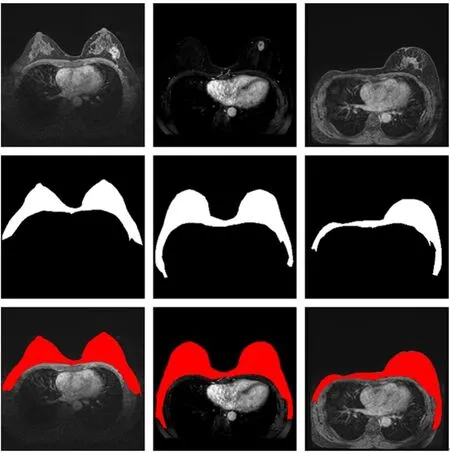

重新设计基准U-Net模型实现乳房ROI粗略勾画。分割示意如图7所示(彩图见期刊电子版),第1行为3例含有乳腺癌的影像;第2行为医生手动分割乳房区域标签;第3行红色区域为UNet乳房区ROI粗分割结果。乳房区域可以延深至胸部两侧,以确保没有乳腺癌区域漏掉。同时实现即使较小的乳房区域也得以正确分割。

图7 乳房区域粗分割示意图Fig.7 Illustration of breast area coarse segmentation

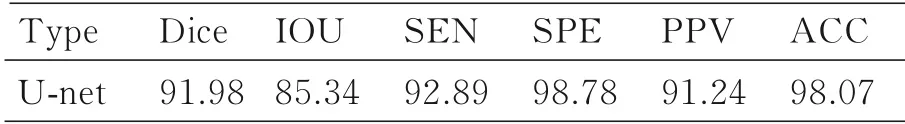

分割结果的实验统计表明,其DICE值可以达到0.92,ACC达到0.98,如表1所示。满足下一步乳腺癌精确分割的需求。基本不影响后续乳腺癌病灶分割。

表1 乳房区域分割结果Tab.1 breast area segmentation results

3.4 不同方法实验对比分析

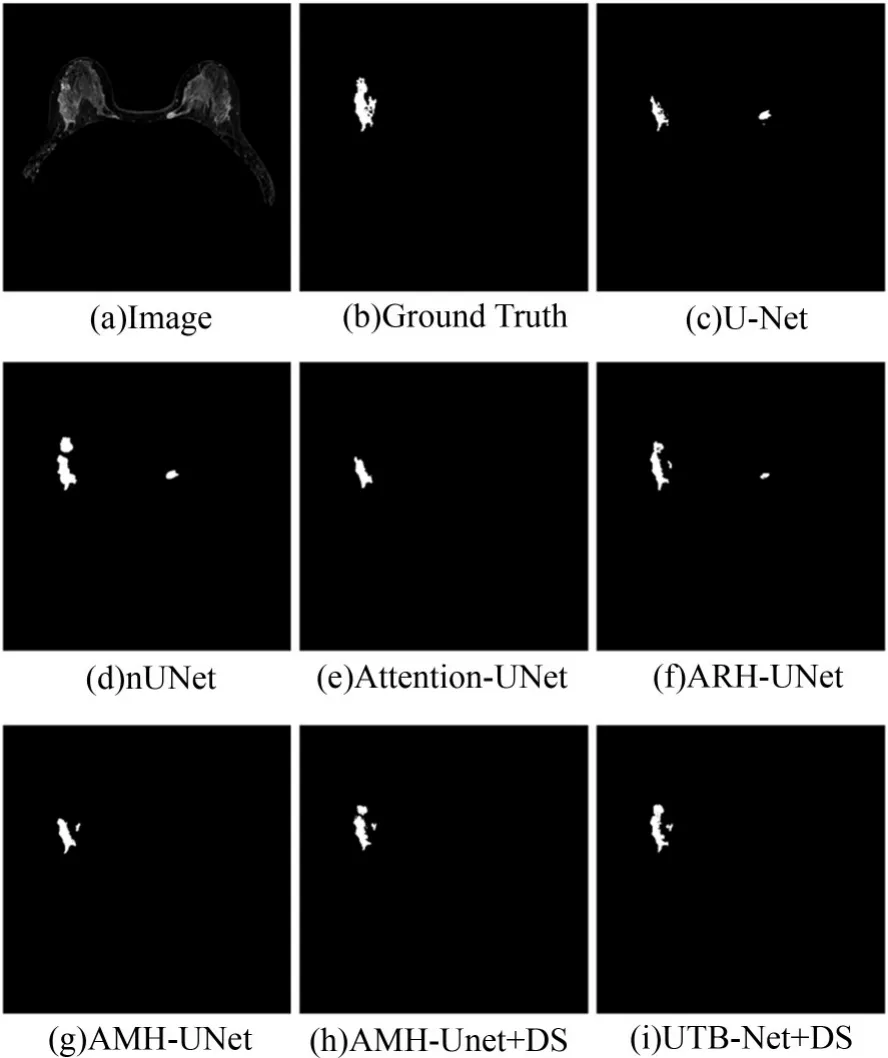

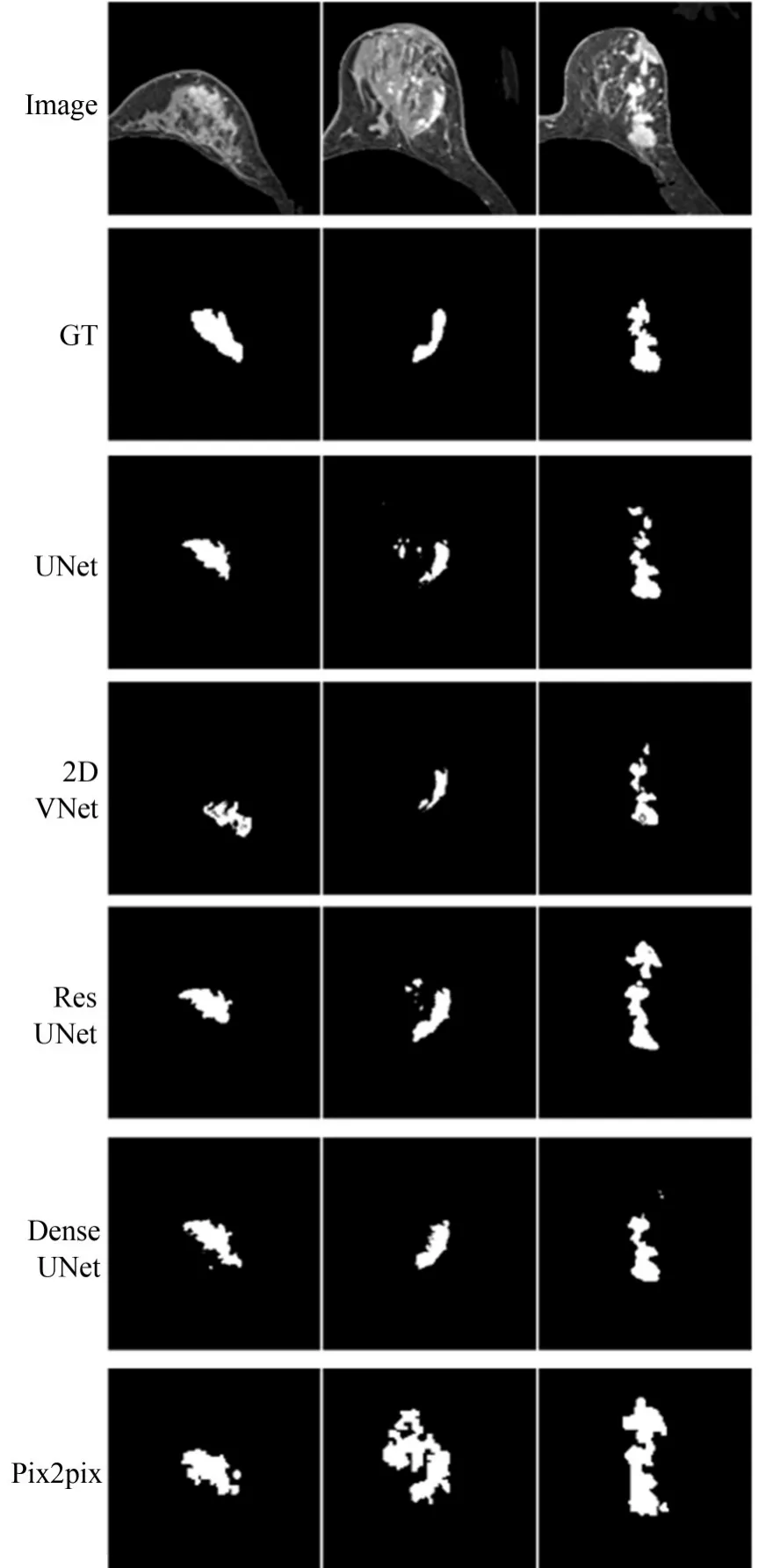

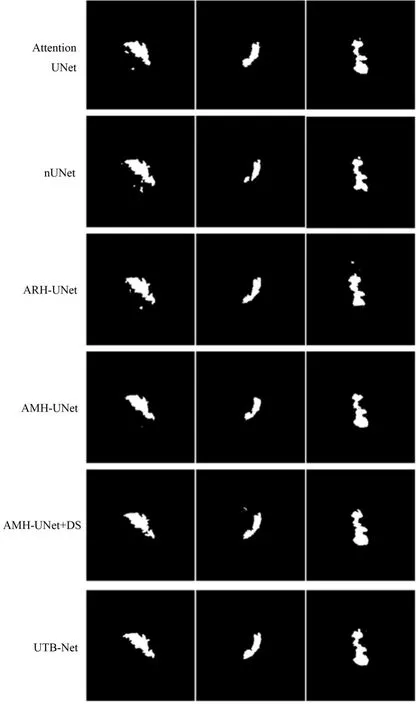

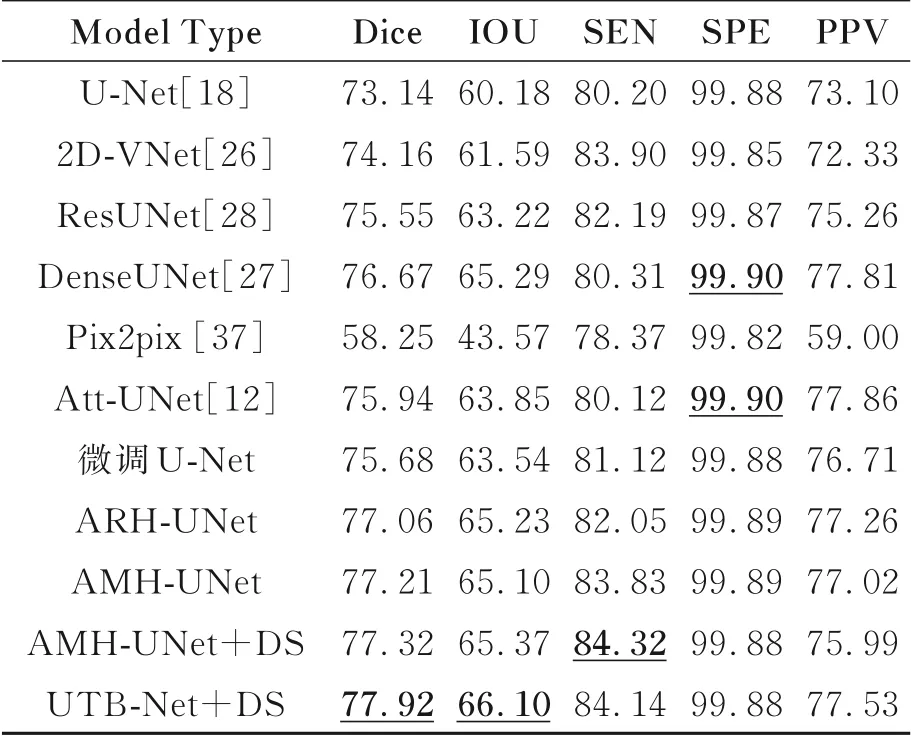

在有限的相同数据集上,将所提出模型与现有表现优异的主流分割模型进行对比测试。我们的微调模型有:U-Net,ARH-UNet,AMH-UN⁃et,AMH-UNet+DS,UTB-Net+DS。而选择用于比对的6个表现优异主流医学影像分割模型:U-Net[18],2D-VNet[26],ResUNet[28],2D-DenseU⁃Net[27],Pix2pix[29],Attention-UNet[12]进 行 对 比 分析。实验结果分别如图8~图10所示。

图10 乳腺癌分割结果全局展示图Fig.10 Global illustration of breast tumor segmentation

图8展示了3例病人在6个不同表现优异的主流分割模型的乳腺癌病变区分割结果。第1行为3例病人原始影像。第2行分别是3例病人相应的金标准。从第3行到第7行分别对应UNet[18],2D-VNet[26],ResUNet[28],2D-DenseU⁃Net[27],Pix2pix[29]的5种 模 型 相 应 的 分 割 结 果。由图可知,第3行U-net分割结果的边缘粗糙,不能准确区分正常腺体与乳腺癌灶区域,分割结果主要集中在灰度值较高的区域,未能完整地出分割出乳腺癌灶,分割结果小于金标准区域。第4行是2D-VNet的分割的结果,可以看出受乳房边缘和周围腺体的影响,甚至无法分割出乳腺癌灶。

图8 乳腺癌病变区分割结果局部示图Fig.8 Partial segmentation of breast tumor lesions

在图8中,第5行是ResUNet[28]的分割结果,可以看出受周围正常腺体的影响,将正常腺体分割成乳腺癌灶区域。第6行是2D-DenseUNet[27]的分割结果,由于乳腺癌灶边界具有模糊特性,分割存在过度分割的问题。第7行是Pix2pix[29]分割结果,作为可用于分割的生成对抗网络,由于乳腺癌灶存在亮度不均,语义信息复杂,最终影响了分割的 准确性。Attention-UNet[12]分割结果在图9中第1行,主观上可以看出对乳腺癌灶的定位较为准确,但是对于边缘和细节的部分还有欠缺。

图9 乳腺癌病变区分割结果局部示图Fig.9 Partial segmentation of breast tumor lesions

对于本文所提出的5个改进模型分割结果,主要展示在图9的第2行至第6行。

图9第2行是微调U-Net模型的分割结果,在编码部分的最后一层,进行两次Conv→PRe⁃LU→Conv→PReLU→Group Norm操作,在保证不增加参数的同时提取更多高级特征信息。相较于图8中第三行基准U-net分割结果,乳腺癌结果在面积上有所增加。图9中第3行是ARHUNet分割结果,ARH-UNet与基准U-Net相比不仅继承了微调U-Net优点,全局上观察则对分割的病灶进行了较为准确的定位,局部上展示出获取了更多细节信息。而图9中第4行是AMHUNet分割结果,其在全局定位与局部细节都得到更进一步提升,分割结果噪点更少。

图9中第5行是AMH-UNet+DS分割结果,模型在局部边缘和信息的识别上展示得更优异。图9中最后一行是UTB-Net+DS模型分割结果,与所有实验网络相比表现出最高的分割准确性。这是因为引入了多尺度注意力混合机制,相对其他模型而言,更接近于医生标注的金标准结果,分割结果优于其他方法。另外,结合图8和图9可以看出微调U-Net与基准U-Net相比无论全局还是局部都具有更高的分割准确性,最明显的优点是保留了更多图片信息。分割不准确的主要原因主要由于非肿块的乳腺肿瘤区域边界模糊,形态变化大,纹理不规则,受周围正常腺体组织的影响较大。

图10进一步使用单个病例从全局分析分割结果。ARH-UNet与基准U-Net相比不仅继承了微调U-Net优点,全局上观察则对分割的病灶进行了较为准确的定位,局部上展示出获取了更多细节信息。而AMH-UNet则在全局定位与局部细节都得到更进一步提升。使得分割结果的噪点更少。AMH-UNet+DS则在局部边缘和信息的识别上展示的更优异。最后,UTB-Net+DS与所有实验网络相比表现出最高的分割准确性。

通过分析局部细节分割结果图8~图9和全局分割图10,可以看出UTB-Net+DS在全局与局部的分割区域定位、边缘信息识别和细节信息分割方面都取得了最好的表现。最终得出在分割过程中对分割区域进行全局与局部精准定位、保留更多图像信息与增强信息识别能力对像素级分割结果至关重要,这也证实了UTB-Net+DS网络存在一定的鲁棒性与合理性。

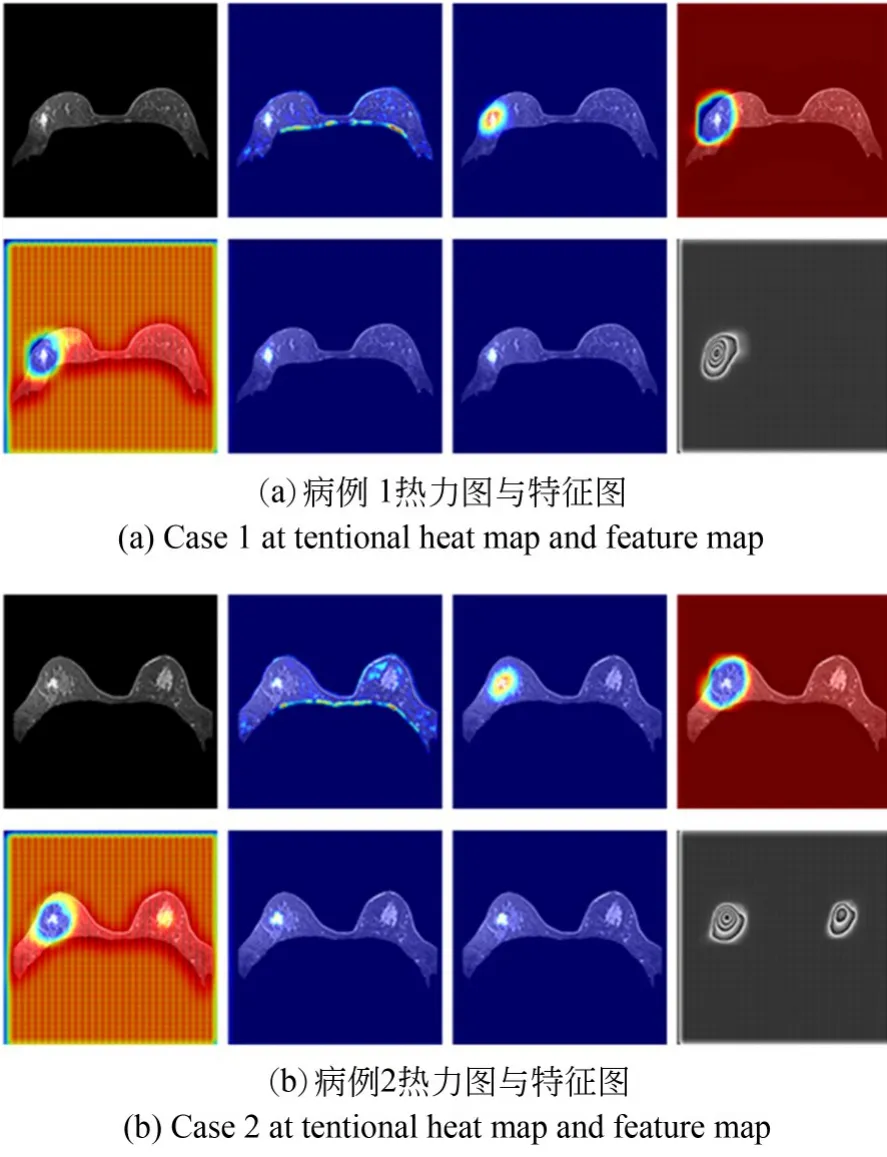

3.5 注意力图和特征分析

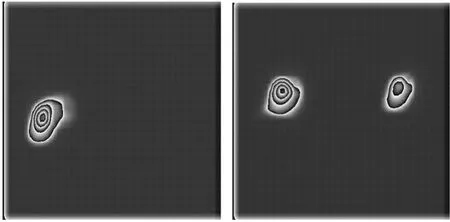

如图11所示,为两例乳腺癌灶注意力的热力图和特征图。网络初始化时注意力点在乳房全局区域服从均匀分布。随着数据在网络中流动,网络的焦点逐渐聚焦于乳腺癌灶的边缘,最后从粗糙的定位和大概轮廓逐渐聚焦于乳腺癌灶,从而进行精确地分割。即使当数据流经网络过程中产生错误的聚焦也可以被逐渐修正。从中可以观察到,残差与注意力单元ARHD与Non-lo⁃cal能够帮助进行病灶定位与纠正,以及获取目标的重要特征。

图11 乳腺癌灶分割注意力热力图与特征图Fig.11 Breast tumor segmentation Attention and feature map

图11为两例病人注意图采用Grad-CAM[30]方法产生热力图和特征图作为注意力的仿真结果,通过病例1可以观察到模型使用注意力机制后可以稳定的定位到病灶部位。病例2可以观察到,图中左乳区有乳腺癌病灶,图2中右乳区存在虚假疑似病灶区域,所提模型的注意力机制配合残差与注意力单元(ARHD)与Non-local能够帮助进行疑似病灶定位与纠正,以及获取目标的重要特征。所获得的注意力特征图如图12所示,从所提模型的编码路径与解码路径的连接处提取注意力特征图,从中可以看到所提模型稳定的定位到病灶区和疑似病灶区,而对于图2中右乳区虚假病灶区,所提模型可以在解码部分进行抑制,能够有效的减少虚假病灶区错分割。

图12 乳腺癌灶分割特征图Fig.12 Breast tumor segmentation Attention and feature map

3.6 模型可视化与消融实验分析

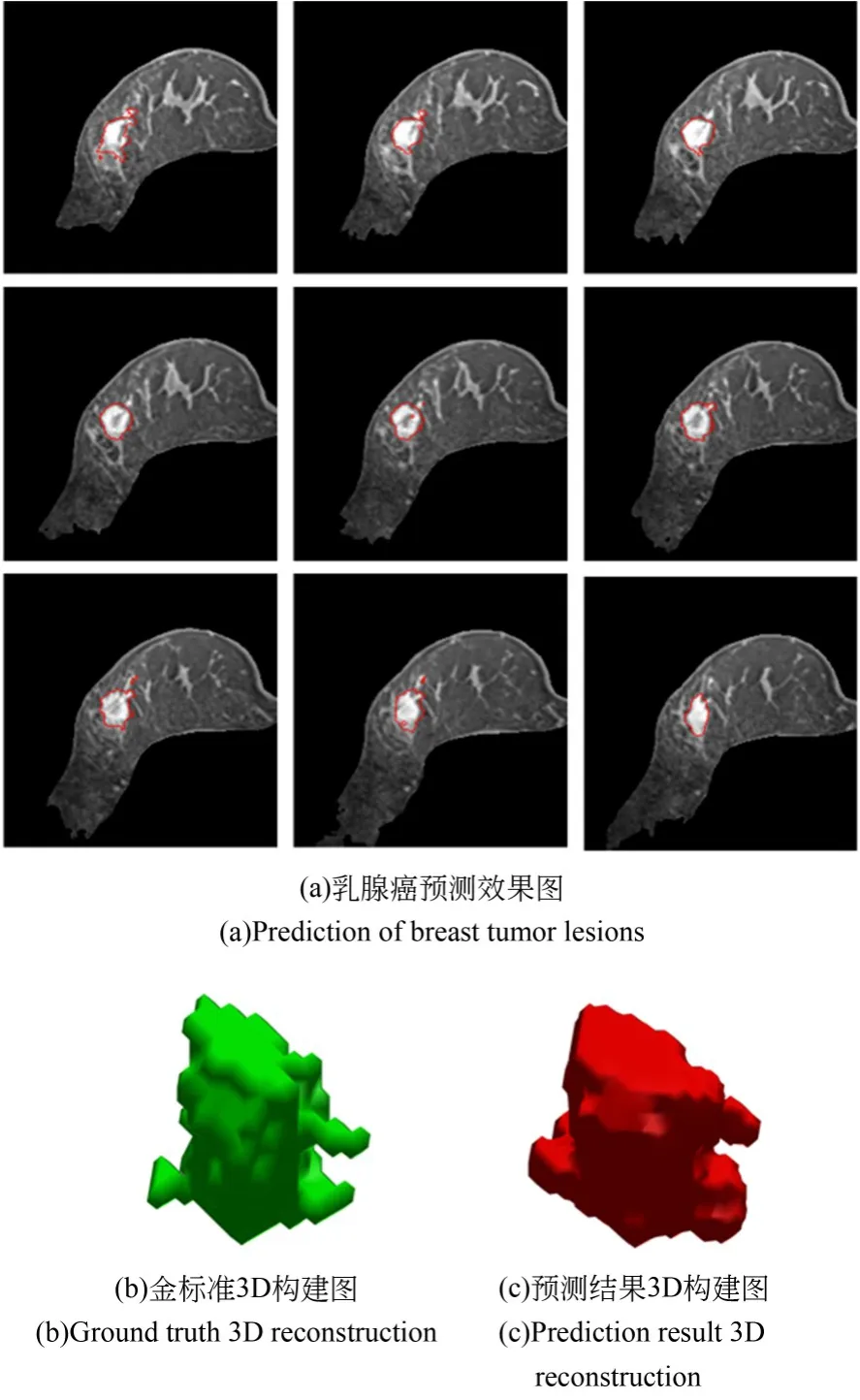

图13展示深度监督UTB-Net对单例病灶的乳腺癌灶分割结果的2D和3D拟合效果。图13(a)预测结果轮廓基本拟合乳腺癌灶区。由于MSPCF能够在同一层级获得不同感受野的特征,可提高网络获取模糊边缘和小面积肿块信息的能力。为了更加直观展现所提模型预测结果,分别对金标准和预测结果进行3D构建,结果分别如图13(b)和13(c)。由图可知,所提模型的分割结果虽然接近金标准的大体轮廓,但在乳腺癌病变边缘像素级分割上仍有待加强。

图13 单病例分割与3D重构Fig.13 Segmentation and 3D reconstruction of single case

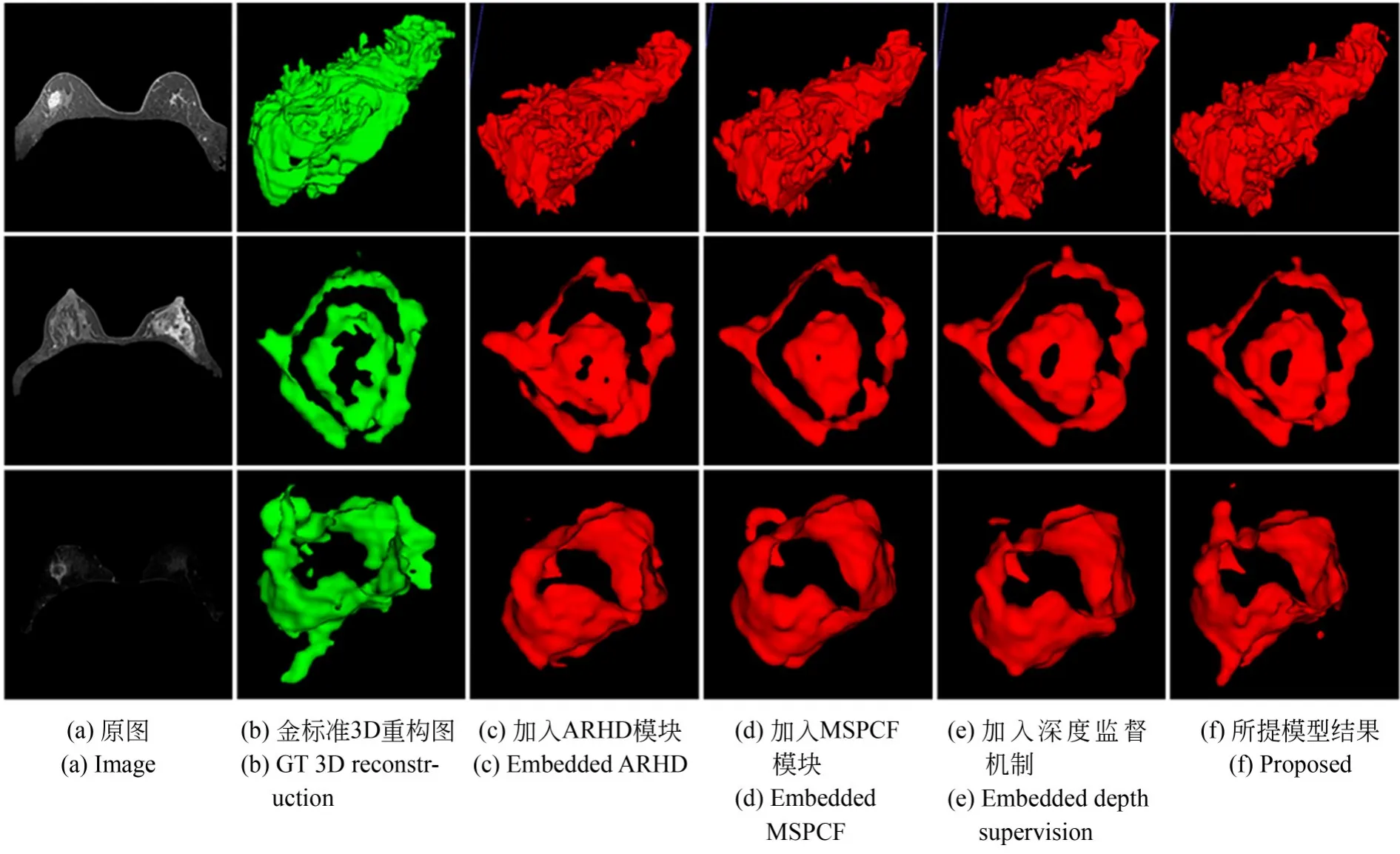

为了进一验证注意力-残差混合解码模块、多尺度并行卷积融合模块、深度监督机制和Nonlocal模块对模型的贡献,进行了模型的消融实验仿真和分析。如图14所示,第1列为3例病患的原始影像;第2列为金标准在3D空间中的重构图;第3列为微调U-net加入注意力-残差混合解码(ARHD)模块后,分割结果在3D空间中的重构图;第4列为模型加入多尺度并行卷积融合(MSPCF)模块后,分割结果在3D空间中的重构图;第5列为加入深度监督机制(Depth supervi⁃sion)后,分割结果在3D空间中的重构图;最后1列为加入Non-local后,所提出模型的分割结果在3D空间中的重构图。在各个模块添加的过程当中,在表面细节、颗粒度、中间的空洞处理、病灶边缘上分割效果逐渐提升,对于综合后的模型表现为最优。

图14 消融实验过程展示Fig.14 Diagram of ablation experiment process

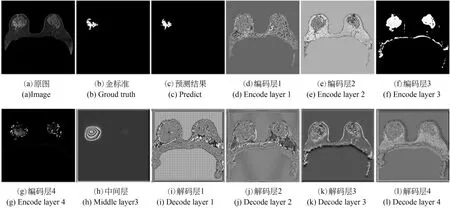

对于模型中的卷积层特征进行了提取和再现,如图15所示,分别对编码层1~4进行特征可视化,从图中可知所提模型在编码层主要学习纹理、边缘、灰度等浅层特征信息,在解码路径上分别对解码层1~4进行特征可视化,从图中可知解码层我们的模型主要学习深层的语义信息。

图15 卷积层仿真结果展示Fig.15 Diagram of ablation experiment process

3.7 分割结果统计分析

为了更进一步验证深度监督UTB-Net对于乳腺癌灶的分割性能,使用Dice coefficient(DSC),Intersection over Union(IoU),敏 感 性(Sensitivity),特异性(Specificity),阳性预测值(Positive predictive value)作为该数据集上的评估指标,对测试结果进行统计分析。

如表2所示,在该数据集深度监督UTB-Net在所有评估指标上取得了很好的结果。但由于乳腺DCE-MRI临床数据集包含大量噪声,背景区域与前景区域不平衡,所以造成模型表现出敏感性指标低特异性指标高这一特点。深度监督UTB-Net的DICE值超出对比基准U-Net 4.78%,IOU上超出5.92%,SEN超出3.94%,在SPE上持平,在PPV上超出4.43%。可以看出,深度监督UTB-Net结果与基准U-Net[18]相比更具有稳定性,且测试结果平均水平也高于它。所提最终深度监督UTB-Net是经过一系列模型不断创新改进而来。

表2 不同模型分割结果统计分析Tab.2 Compare of segmentation results

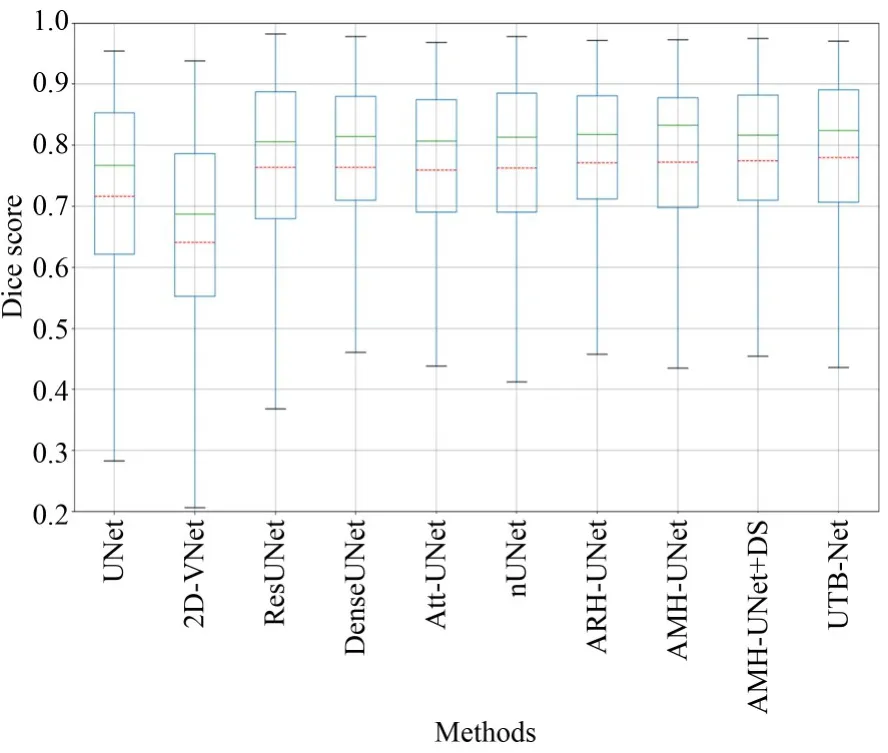

图16为各个算法的BOX箱线图统计对比(彩图见期刊电子版),其横轴表述前面实验对比算法中所用到的不同模型,纵轴表示DICE系数,本文所提微调U-Net、ARH-UNet、AMH-UNet、AMH-UNet+DS、UTB-Net+DS模型,随着改进过程,所有指标值、稳定性均逐步升高,进一步验证了所提模块的有效性和对模型改进与创新方向的正确性。BOX图中的绿色线和红色线分别表示测试数据的平均值和中值。

图16 所有实验模型的箱线图展示Fig.16 BOX diagrams of all comparative experiments

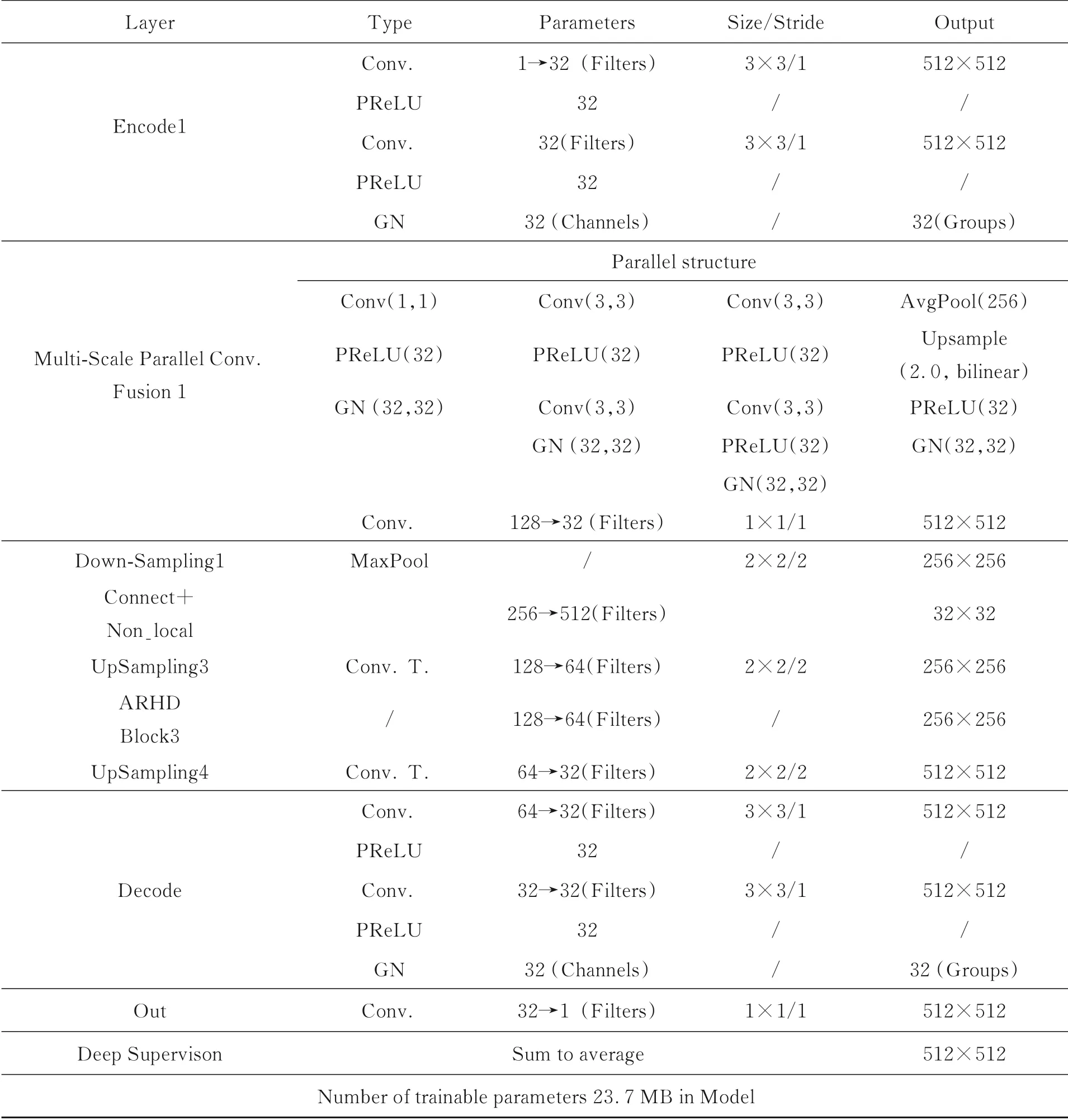

3.8 模型参数分析

由表3可知,所提模型参数约23.7 MB,所提出模型使用微调U-net作为基础的编码与解码结构,即Conv→PReLU→Conv→PReLU→Group⁃Norm,在编码路径加入多尺度并行卷积融合(MSPCF)模块构成编码层的一部分。UTB-Net包含四层编码层和四个最大池化运算,每个运算之后特征图面积减半。除MSPCF外,所有卷积层都有3×3的卷积核,通道数如上表所示,第一个编码层输出有32个通道,随着网络的加深,每个编码层和最大池化运算之后通道数会加倍,直到通道数为512,在之后的卷积层与Non-local模块输出通道数不变。

表3 UTB-Net主要模块参数Tab.3 Main module parameters of UTB net

在解码部分,包含注意力-残差混合解码(ARHD)模块构建的三层解码层、一个基础解码结构和四个转置卷积运算,每个运算后特征图面积增大两倍,同时通道参数减少一半。转置卷积的输出连接着编码器对应部分的输出,以此作为下层的输入。由此得到的特征图通过卷积运算来处理,以保持通道数量与对称编码部分相同。最后将每个解码层的输出的特征图,通过上采样与1×1卷积操作,还原成512×512大小的单通道特征图,经过深度监督机制求和取平均获得最终输出结果。

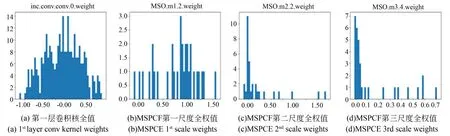

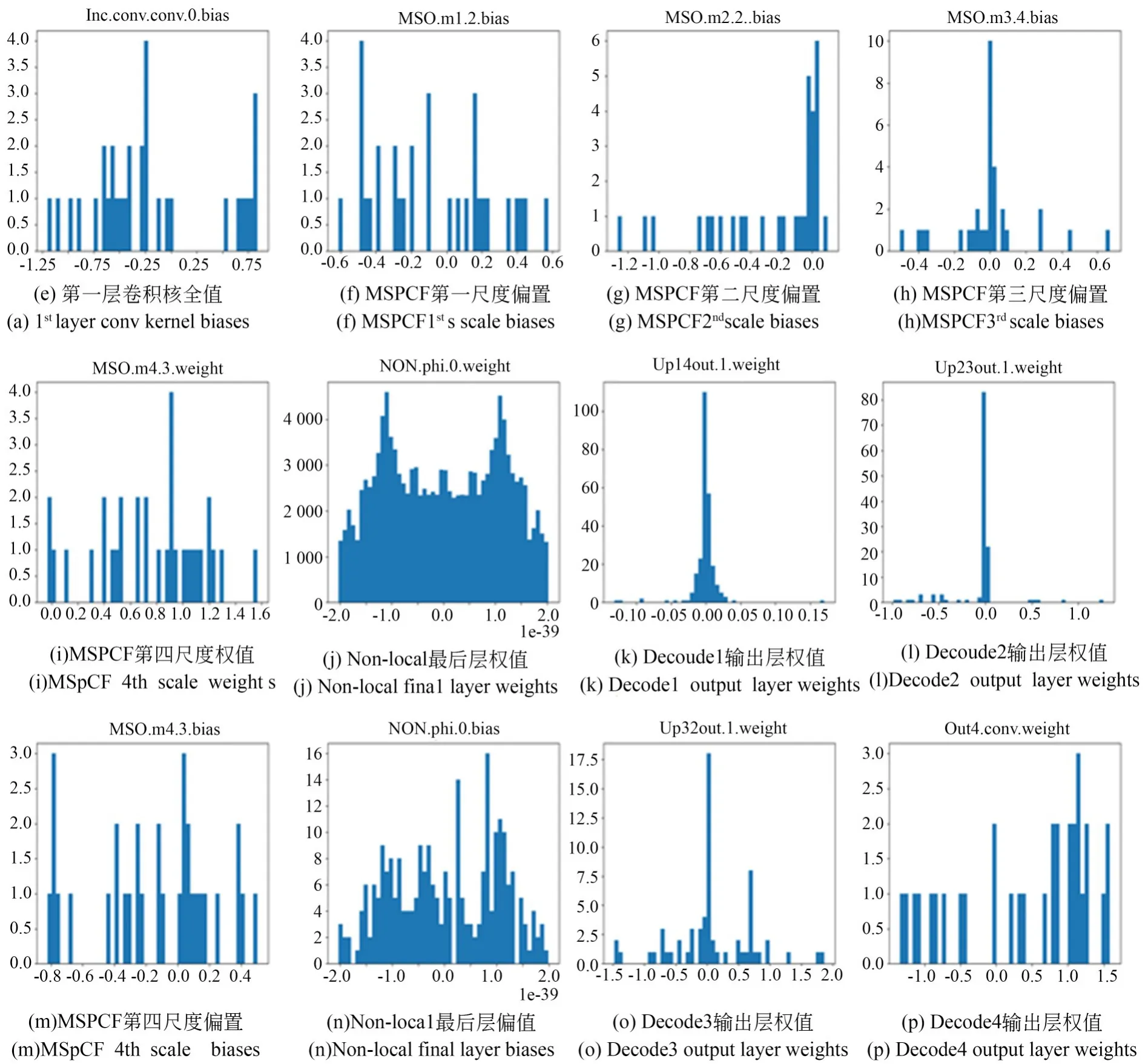

对所提出模型的关键卷积核权值与偏置进行了可视化分析。如图17所示,从图17(a)可以看出编码层第一层的卷积核权值服从正态分布,这一层卷积核主要学习一些粗糙的浅层特征。图17(b),(c),(d),(i)是编码层第一层多尺度并行卷积融合(MSPCF)模块不同尺度的卷积核权值,从中可以看到不同尺度的卷积核所学习的特征是不相同,这进一步验证所提出MSPCF模块的合理性与有效性。图12(k),(l),(o)是解码层1~3的卷积核权值,从图中可以看出注意力-残差混合解码(ARHD)模块的卷积核所学习特征分布基本一致,进一步表明所提ARHD模块能稳定识别与定位病灶区域,能有效的学习到深层语义信息。图12(p)为解码层最后一层的卷积核参数,由于长连接的存在使其不仅能保留上层所学习的深层特征信息,也能保留对应编码层的浅层特征信息。综上,通过卷积核权值的分析,所提模型具有一定的合理性与正确性。

图17 UTB-Net关键卷积核权值与偏置Fig.17 BOX diagrams of all comparative experiments

3.9 分割模型训练与验证

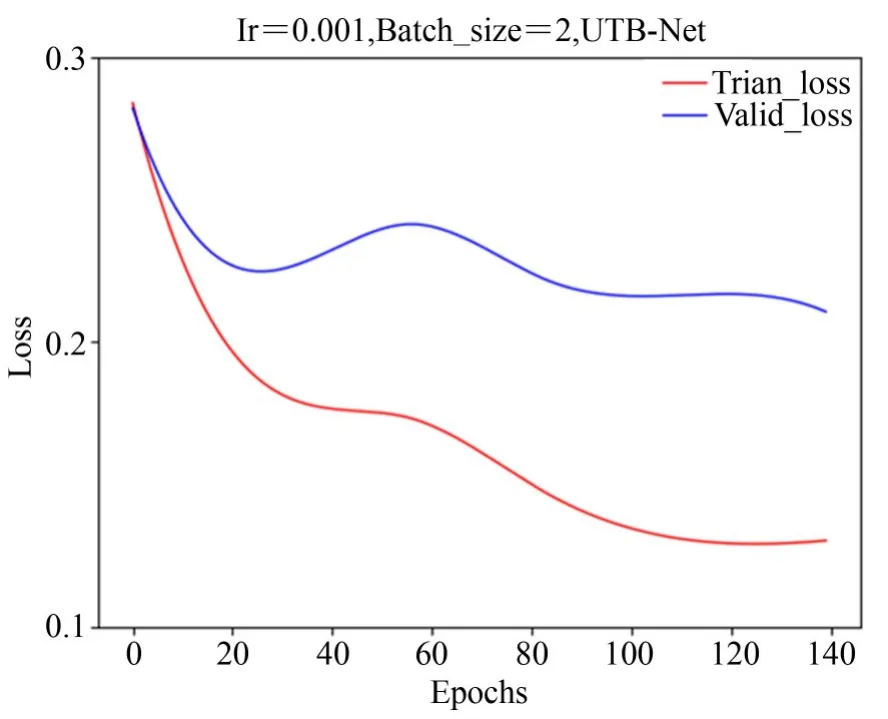

如图18可知,本文所提出的模型在训练过程中,训练loss在迭代0~25次之间收敛速度较快,在经历25~140次迭代后曲线收敛逐渐趋于平缓。验证loss在0~25次迭代之间收敛速度也较快,在经历25~140次迭代后曲线趋于平缓。综上所述,本文所提的模型在训练与验证过程中具有一定的稳定性与鲁棒性。

图18 UTB-Net训练与验证Loss曲线Fig.18 UT B-N train and valid loss

4 结论

在有限的数据集上,针对具有复杂背景的DCE-MRI乳腺癌图像分割问题。本文提出了一种分阶段乳腺癌图像分割模型。首先,借鉴Unet模型完成乳房区域的粗略勾画。其次,提出一种UTB-Net模型,在解码路径整合注意力-残差混合解码结构,在编码路径和末端分别引入多尺度并行卷积模块、Non-local模块。实验结果表明所提出的模型实验相较于U-Net基准模型,乳腺癌分割指标DICE,IOU,SEN,PPV分别提升了4%。4.78%,5.92%,3.94%。不足之处:对于网孔状较小的病变区细节分割上需进一步提升。下一步将研究乳腺癌图像的3D分割和定位,结合影像组学,建立预测模型,提高乳腺癌的诊断、治疗和预后。