基于多目标跟踪的商场热点图生成方法

2021-03-07郑舟轩王勇王瑛

郑舟轩 王勇 王瑛

摘要:多目标跟踪领域以基于检测的跟踪方法为主,CenterTrack算法提出了以目标中心点为检测对象,每帧输出基于目标中心点生成的热图以辅助下一帧的检测和跟踪的方法。此方法在保证帧率的前提下有效提升了多目标跟踪准确率,但由于其缺乏对目标重识别的关注,当目标遭遇到遮擋或噪声影响从检测结果中丢失时无法将随后重新出现的同一目标识别为原目标,导致ID切换较频繁。该文在CenterTrack算法模型中加入近期丢失跟踪链队列和重识别模块以改善其在重识别方面的表现。输入商场监控录像并取得跟踪结果后,根据行人目标移动与停驻时间分配权值生成商场热点图,帮助经营者提升销售能力。

关键词: 计算机视觉; 多目标跟踪; CenterTrack算法; 目标重识别; 商场热点图; MOTA(多目标跟踪准确率)

中图分类号:TP391 文献标识码:A

文章编号:1009-3044(2021)36-0106-03

开放科学(资源服务)标识码(OSID):

Shopping Mall Heat Map Generation Method Based on Multi-object Tracking

ZHENG Zhou-xuan, WANG Yong, WANG Ying

(School of Computer Science and Technology, Guangdong University of Technology, Guangzhou 510006, China)

Abstract:The field of multi-object tracking is based on tracking-by-detection methods. The CenterTrack algorithm proposes a method that uses the center of the object as the detection target, and outputs a heat map generated based on the center of the target for each frame to assist the detection and tracking of the next frame. This method effectively improves multi-object tracking accuracy under the premise of ensuring the frame rate. However, due to its lack of attention to target re-identification, when the target encounters occlusion or the influence of noise, thus lost from the detection result, it cannot reappear as the same object. The object is not recognized as the original object, which leads to frequent ID switching. This paper adds a recently lost tracks queue and re-identification module to the CenterTrack to improve its performance in re-identification. After the input of the shopping mall surveillance video data and obtaining the tracking results, the shopping mall heat map is generated according to the weights of pedestrian target movement and staying time to help shop owners improve sales.

Key words:computer vision; multi-object tracking; CenterTrack algorithm; target re-identification; shopping mall heat map; MOTA(Multi-Object Tracking accuracy)

有店铺零售业指的是消费者购买行为主要在一个相对固定,能够进行商品陈列、展示和销售的场所或设施中进行的零售业务[1]。随着网络零售业为首的无店铺零售业的迅速发展,有店铺零售业受到了前所未有的冲击,尤其过去两年受新型冠状病毒肺炎疫情等事件影响,在中国零售业整体增速持续减缓的背景下,有店铺零售业的发展更是连续受挫。尽管有店铺零售业的“退潮”似乎在所难免,许多零售业经营者并未轻易放弃,而是积极寻求改变。

在许多高出货量或者高客单价的零售店铺经营工作中,经营者常常通过观看店铺的监控录像,记录并统计各个货架、陈列台前停驻的消费者数量,以了解店铺内各货架、陈列台的热门程度,并根据这些信息调整货架摆放、商品陈列策略,改善经营状况最终得到更高的经济效益。

多目标跟踪(Multi-Object Tracking, MOT)指的是使用计算机视觉技术,通过处理输入的视频获得视频流中的多个目标以及它们的外观特征、每帧的位置等信息,并最终得到所有目标的运动轨迹[2]。随着深度学习的发展和深入应用,多目标跟踪领域的研究进步迅速,Zhou等提出的CenterTrack在MOT17数据集上进行的实验达到了在22FPS的帧率下,67.8%的多目标跟踪准确率(Multi-Object Tracking Accuracy),截至原文发表时为该公开数据集最佳成绩。多目标跟踪的迅速发展让一些零售业经营者看到了一个能够帮助他们改善经营状况的契机:用计算机视觉技术代替上述手动进行的热门货架和陈列台的记录、统计工作,通过对店铺的监控录像进行处理,以消费者为目标进行多目标跟踪任务,自动统计消费者在各个货架、陈列台前的逗留时间,并据此自动生成相应的商场热点图。

1 研究现状

1.1 传统方法

在多目标跟踪领域,研究者们进行过相当丰富的相关工作,主要的跟踪方法包括检测跟踪方法,联合检测跟踪方法以及与运动预测相结合的方法。

首先是检测跟踪方法(Tracking-by-detection),這些方法往往由两个部分组成,第一个部分是一个或者多个现成的检测器,用来对视频流中的每一帧进行目标检测,从而得到视频流中每一帧的多个目标边界框;第二个部分是一个关联算法,通过逐帧关联的方式,将每一帧中检测到的目标进行前后关联,从而生成跟踪路径。SORT[3]算法就是这样的设计思路,用卡尔曼滤波器作为目标检测器,用匈牙利算法作为关联算法进行帧间目标关联。

DeepSORT[4]算法改进了SORT算法的关联算法部分,将目标外观特征加入了关联的代价计算中。后续按此思路提出算法大多数也将关注点集中在改进这个关联算法上。Tang等[5]提出的LMP算法利用人体姿态特征加强了目标重识别的成功率。Xu等[6]提出了STRN算法,其改进的关联算法强调利用空间定位将多个线索融合。这一类方法有两个共同的缺点,第一个是关联算法要么是放弃了目标的外观特征,要么需要复杂的特征提取器来对外观特征进行提取再进行关联,第二个是将检测和跟踪分离了,本质上是把跟踪任务拆解成了检测任务和关联任务,使得解决方案不具备整体性。

其次是联合检测跟踪方法(Joint detection and tracking),这类方法是多目标跟踪领域的一个新趋势,它的改进就是将检测和跟踪结合起来,把检测器改进为跟踪器,从而同时处理检测任务和跟踪任务。Feichtenhofer等[7]提出的ConvNet就是将当前帧和前一帧一起输入一个孪生网络,并预测每个目标的帧间偏移。IODT[8]将前一帧的跟踪结果作为约束加入当前帧的检测中,强化检测与跟踪的相关性。Bergmann等[9]提出的Tracktor则是将前一帧的跟踪结果直接作为当前帧的候选区域,确定前一帧的目标在当前帧是否仍存在于画面中,该目标的边界框只需要在前一帧的边界框的基础上进行小幅的偏移和尺寸调整即可,然后再对剩余的部分进行检测,确定是否有新的目标进入画面。Kang等[10]将整段视频流作为整体进行输入,以便将跟踪的目标作为一个管道进行检测。Zhu等[11]提出了一个导向特征聚合以加速帧间联合检测跟踪的方法。

另外还有与运动预测结合的方法,早期一些方法使用卡尔曼滤波对目标的运动速度进行建模;Held等[12]对单目标跟踪进行帧间偏移计算;Xiao等[13]利用光流估计网络对人体姿态进行跟踪。这些方法都在每一帧提供对每个目标的运动方向和幅度的预测。

1.2 CenterTrack算法

上述提到的联合检测跟踪方法中,最新的一种方法是在2020年8月的ECCV上Zhou等提出的CenterTrack[14],它相对于其他同类的方法的优点在于:其他联合检测跟踪方法都采用了FasterRCNN框架[15]作为目标检测框架,这就存在一个必要的前提,同一个目标在帧间的边界框需要较大的重合,这个前提对于移动速度较快的目标,或者是对于低帧率的输入效果比较差。而CenterTrack算法使用的是由同一个团队之前提出的另一个目标检测框架CenterNet,其输入除了连续的两帧以外,还有一个包含若干个点的热图,从前一帧的跟踪结果中提取出来。在本课题中以该算法为基础进行改进也看重此优点,这个优点的主要意义是降低模型的工作时间,因为现实中监控录像的视频长度往往是以小时计算的,如果整段视频都进行输入,即使是实时的跟踪算法也需要耗费大量的工作时间才能生成跟踪结果,而如果将视频按帧率进行降采样,就可以用更小的输入取得相近的结果。

CenterTrack采用了联合检测跟踪方法,同时抛弃了此类方法常用的FasterRCNN框架,加入了一个基于前一帧跟踪结果的热图作为输入,以基于目标中心点的方式进行检测和跟踪。但是这个方法存在一个比较明显的问题,其检测和跟踪都是基于连续帧间关联的,因此一旦目标在一个较长的时间内未被跟踪到,它再次被检测到时会被定义为一个新的目标,造成较高的IDSW(Identity Switch),这对于商场热点图生成任务来说是相当不利的,因此需要IDSW尽可能的低。基于这个目的,引入LMP算法对CenterTrack进行改进。

2 改进CenterTrack

CenterTrack算法在对每一帧视频画面进行处理时,能够充分利用前一帧的处理结果,优先在热图区域内进行目标检测和帧间目标关联,因此具有较好的准确率和实时性,但同样因为其过于强调跟踪目标在相邻帧间的连续性,对于一些目标在视频流中遭遇遮挡或者噪声干扰时丢失又在一段时间后重新出现的情况,无法与之前的同一目标完成关联,从而产生较高的IDSW(Identity Switch),降低了准确率。

对于这一缺陷,可以通过在模型中维护一个近期丢失跟踪链RLT(Recently Lost Tracks)队列,当前一帧出现过的目标在当前帧消失时,将该目标加入RLT队列。之后在检测到新目标进入画面后,对比新目标与RLT队列中各个已丢失目标的外观特征相似度,对于相似度高于一个预先设定的阈值的目标标注为可能的已丢失目标的重识别,用聚类方法判断前后目标能否拟合到同一条轨迹上,拟合成功即将新目标判定为已丢失目标的重识别,并将原目标移出RLT队列。

3 实验

3.1 实验环境

本文实验基于PyTorch深度学习框架,版本为1.0;运行实验的操作系统为Ubuntu 20.04,硬件方面为内存:16.0GB,CPU:Intel i7-9700F @ 3.00GHz,显卡:RTX2060S。

3.2 实验数据

采用多目标跟踪领域的权威公开数据集MOT17[16]进行实验,由于该数据集中包含各种不同角度以及针对各类不同目标的视频数据,为了保证实验足够具有针对性,仅选取最接近商场监控视角且跟踪目标为行人的部分视频数据进行实验。

3.3 实验结果

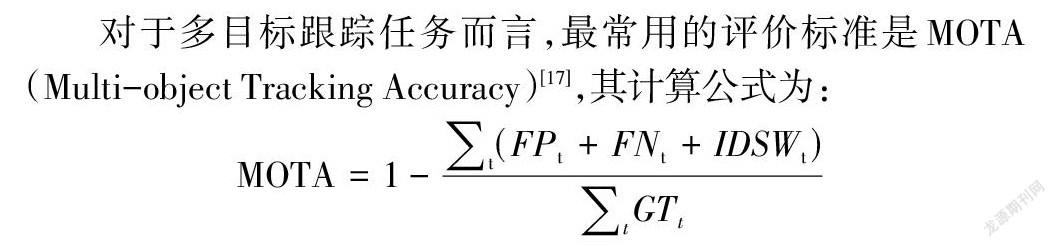

对于多目标跟踪任务而言,最常用的评价标准是MOTA(Multi-object Tracking Accuracy)[17],其计算公式为:

[ MOTA = 1-t(FPt+FNt+IDSWt)tGTt]

其中FP(False Positive)表示基准中不存在而跟踪结果中存在的目标个数,FN(False Negative)表示未被成功跟踪的目标个数,IDSW表示尽管被成功跟踪,但被识别为新目标,赋予了与之前的视频帧不同的ID的目标个数,GT表示基准目标个数,下标t表示视频帧的序号,最终结果以综合整个视频序列的所有以上参数共同决定,MOTA值越大表示跟踪结果越好。另外,为了体现新方法的有效性可以单独统计ID切换(IDSW, ID Switching)并进行比较。

由于RLT的加入与CenterTrack模型的训练是独立的,因此仅需分别使用原生CenterTrack模型与加入RLT的改进CenterTrack模型进行测试即可。

实验结果表明加入RLT的改进算法能够提升多目标跟踪准确率,特别是能降低IDSW。由于加入了重识别模块,运行的实时性会轻微下降。

3.4 商场热点图生成

在取得了目标跟踪的结果后,根据同一个目标在一段时间内的位置分布判断该目标是否处于移动状态,设置两个阈值来限制目标在一段时间内的每两个相邻帧间的位移以及整段时间内位置分布的方差,取目标满足限制条件的时间段,给其所在的位置添加权值,在画面中画出热点图。

以上画面截取监控录像的一帧作为背景进行绘制,以红色为中心的热区为行人逗留时间较长,逗留行人数较多的区域。注意画面中部分热点区域没有人出现,是因为热门区域是基于整个视频序列而非当前帧。

4 总结

本文提出一种基于CenterTrack目标跟踪模型,加入近期丢失跟踪链RLT以弥补原模型不易实现目标重识别的缺陷。重识别算法为目标特征相似度度量以及轨迹聚类相结合,能有效降低ID切换(IDSW)并提升多目标跟踪准确率(MOTA)。获取跟踪结果后判断每个目标在每一帧是否处于移动状态并分配权重,生成商场热点图,能够表示出监控录像中消费者驻足停留时间较长的位置,为经营者提供决策支持。后续工作应当进一步提升重识别算法的准确率以及优化热点图生成算法。

参考文献:

[1] 中华人民共和国国家质量监督检验检疫总局,中国国家标准化管理委员会.零售业态分類:GB/T 18106—2004[S].北京:中国标准出版社,2004.

[2] Luo W H,Xing J L,Milan A,et al.Multiple object tracking:a literature review[J].Artificial Intelligence,2021,293:103448.

[3] Bewley A,Ge Z Y,Ott L,et al.Simple online and realtime tracking[C]//2016 IEEE International Conference on Image Processing (ICIP).September 25-28,2016,Phoenix,AZ,USA.IEEE,2016:3464-3468.

[4] Wojke N,Bewley A,Paulus D.Simple online and realtime tracking with a deep association metric[J].2017 IEEE International Conference on Image Processing (ICIP),2017:3645-3649.

[5] Tang S Y,Andriluka M,Andres B,et al.Multiple people tracking by lifted multicut and person Re-identification[C]//2017 IEEE Conference on Computer Vision and Pattern Recognition (CVPR).July 21-26,2017,Honolulu,HI,USA.IEEE,2017:3701-3710.

[6] Xu J R,Cao Y,Zhang Z,et al.Spatial-temporal relation networks for multi-object tracking[C]//2019 IEEE/CVF International Conference on Computer Vision (ICCV).October 27 - November 2,2019,Seoul,Korea (South).IEEE,2019:3987-3997.

[7] Feichtenhofer C,Pinz A,Zisserman A.Detect to track and track to detect[C]//2017 IEEE International Conference on Computer Vision (ICCV).October 22-29,2017,Venice,Italy.IEEE,2017:3057-3065.

[8] Zhang Z,Cheng D Z,Zhu X Z,et al.Integrated object detection and tracking with tracklet-conditioned detection[EB/OL].2018

[9] Bergmann P,Meinhardt T,Leal-Taixé L.Tracking without bells and whistles[C]//2019 IEEE/CVF International Conference on Computer Vision (ICCV).October 27 - November 2,2019,Seoul,Korea (South).IEEE,2019:941-951.

[10] Kang K,Li H S,Xiao T,et al.Object detection in videos with tubelet proposal networks[C]//2017 IEEE Conference on Computer Vision and Pattern Recognition (CVPR).July 21-26,2017,Honolulu,HI,USA.IEEE,2017:889-897.

[11] Zhu X Z,Wang Y J,Dai J F,et al.Flow-guided feature aggregation for video object detection[C]//2017 IEEE International Conference on Computer Vision (ICCV).October 22-29,2017,Venice,Italy.IEEE,2017:408-417.

[12] Held D,Thrun S,Savarese S.Learning to track at 100 FPS with deep regression networks[M]//Computer Vision – ECCV 2016.Cham:Springer International Publishing,2016:749-765.

[13] Xiao B,Wu H P,Wei Y C.Simple baselines for human pose estimation and tracking[M]//Computer Vision – ECCV 2018.Cham:Springer International Publishing,2018:472-487.

[14] Zhou X.Tracking objects as points[R].European Conference on Computer Vision(ECCV), 2020.

[15] Ren S Q,He K M,Girshick R,et al.Faster R-CNN:towards real-time object detection with region proposal networks[J].IEEE Transactions on Pattern Analysis and Machine Intelligence,2017,39(6):1137-1149.

[16] Milan A,Leal-Taixe L,Reid I,et al.MOT16:a benchmark for multi-object tracking[EB/OL].[2021-06-20]https://arxiv.org/abs/1603.00831

[17] Yu Z H,MacBeth S,Modi K,et al.Tracking the trackers[C]//Proceedings of the 25th International Conference on World Wide Web.Montréal Québec Canada.Republic and Canton of Geneva,Switzerland:International World Wide Web Conferences Steering Committee,2016.

【通聯编辑:唐一东】