面向移动单摄像机的多目标跟踪算法*

2020-12-07李兴玮陈慧敏吕林珏关少杰

李兴玮,陈慧敏,吕林珏,关少杰

(国防科技大学 智能科学学院, 湖南 长沙 410073)

基于检测的在线多目标跟踪策略是利用检测器处理当前采集的视频帧,根据反馈的检测响应进一步提取感兴趣区域的视觉信息并与过去帧中的轨迹找寻最优匹配,整个过程相互迭代、更新[1]。目标跟踪往往被分为基于批量处理和基于当前帧处理(即离线模型和在线模型)[1-2]。离线模型[3]利用先验信息和未来视觉信息建立轨迹全局最优解,存在较大的计算量和复杂性,因此选择符合实际场合实时性要求的在线模型。一直以来,行人跟踪在目标跟踪领域是一项亟须解决的技术,同时行人也是机器人辅助自动驾驶、导航系统中最受关注的目标。因此,本文重点研究并改进一种基于检测的在线多行人跟踪器。基于单目移动相机拍摄的视频序列的行人跟踪技术中,运动模型是区分多个相似外观行人的重要线索。Kim和Bae等[4-5]分别提出了一阶、二阶运动模型对目标进行位置预测,之后提出了匀变速模型[6]和非匀变速模型[7]。关于目标间的运动模型大部分都是相互独立的,这种情况会随着摄像机的运动造成不可挽回的累积误差,最终导致跟踪失败。因此,研究人员开始尝试在不同的目标之间建立联系。Leal-Taixé等[8]考虑了行人之间的速度约束、避让斥力和群组拉力。王江峰等[9]使用双向时空连续性迭代关联。Yoon等[10]首次提出相对运动网络模型的概念,实验结果可以看出该模型在摄像机轻微抖动和运动下较好地保持了目标原本的轨迹。上述各类基于目标间相对运动信息的跟踪器在一定程度上缓解了摄像机移动和相似外观造成的跟踪模糊。主要考虑高级驾驶辅助系统和机器人导航等在线采集图像系统中的目标跟踪问题,重点研究基于多目标的空间结构信息[7]来描述目标之间相对运动关系,融合最新提出的基点匹配事件策略[11],重新定义相对运动网络中的损失函数,并改进门限算法应用过程中的相似性度量。为了缓解检测器的误检问题,利用结构约束对漏跟踪目标进行轨迹恢复,使得整个算法鲁棒性更强。

1 模型描述

将视频多目标跟踪问题转换为分层数据关联的搜索问题。整个算法步骤为:输入检测响应,提取目标区域的特征并初始化目标之间的相对运动模型,类似相对运动网络[10];关联成功的轨迹和新的检测响应,利用事件匹配算法进行数据关联;利用相对运动恢复漏跟踪目标的轨迹;更新目标状态和相对运动模型。下面介绍算法中所用的模型。在下面公式中忽略时间参数,S表示视频序列所有目标状态集,D表示检测响应集,A表示目标轨迹和检测响应的分配事件集。 其中,目标轨迹标签集i∈N,检测响应标签集k∈M,当前帧目标之间的相对运动集R。

1.1 相对运动模型

(1)

1.2 分配事件模型

把检测响应和目标轨迹之间的匹配方案定义为ai,k∈A,即{ai,k=1}表示检测响应k被分配给目标轨迹i,反之亦然。检测响应集D{dk∈D}的标签集k∈M,要求每一个检测响应仅分配一条轨迹或生成新轨迹;每一条轨迹仅接受一个检测响应或结束跟踪。可以通过损失成本函数计算目标轨迹与检测响应之间的相似程度函数,然后通过最小化总匹配损失成本来估计最佳匹配方案。

A=argminC(S,R,D)

(2)

式中,ai,0为一个误检目标的匹配作业。因此,当视频序列中所有的目标i没有被检测器检测出来的时候,此时ai,0个数总和等于目标的个数|N|。

1.3 损失成本模型

目标的轨迹是以目标在视频序列中按照时间变化上的位置、速度和大小的状态向量表示。在线多目标跟踪的目的是将当前帧的检测响应同当前的轨迹进行匹配,或终止轨迹或生成新的轨迹,即寻求最优匹配策略。 在当前匹配事件ai,k下,结构约束损失函数为:

C(S,A,R,D)|ai,k

(3)

Ωi,k=Fs(si,dk)+Fa(si,dk)

(4)

(5)

通过计算目标和检测响应的巴氏距离来估计尺寸损失成本Fs(s,d)。采用颜色直方图的多色观测模型估计外观损失成本Fa(s,d)。通过连接检测边界框和目标跟踪边界框的重叠率来估计位置损失成本Fc(si,r〈j,i〉,dk,dq)。

2 数据关联算法

2.1 结构约束事件匹配算法

为了更好进行下一步的匹配作业,设置一个基准匹配,基于结构约束对剩下的目标和检测结果进行匹配作业,匹配过程详见文献[11]。由于可以根据相应基准匹配的数量多次测量每个分配作业的成本,这个过程可以显著减少由于目标附近的误报、错误检测和约束错误导致的歧义。

2.2 漏跟踪目标恢复算法

3 多目标跟踪框架

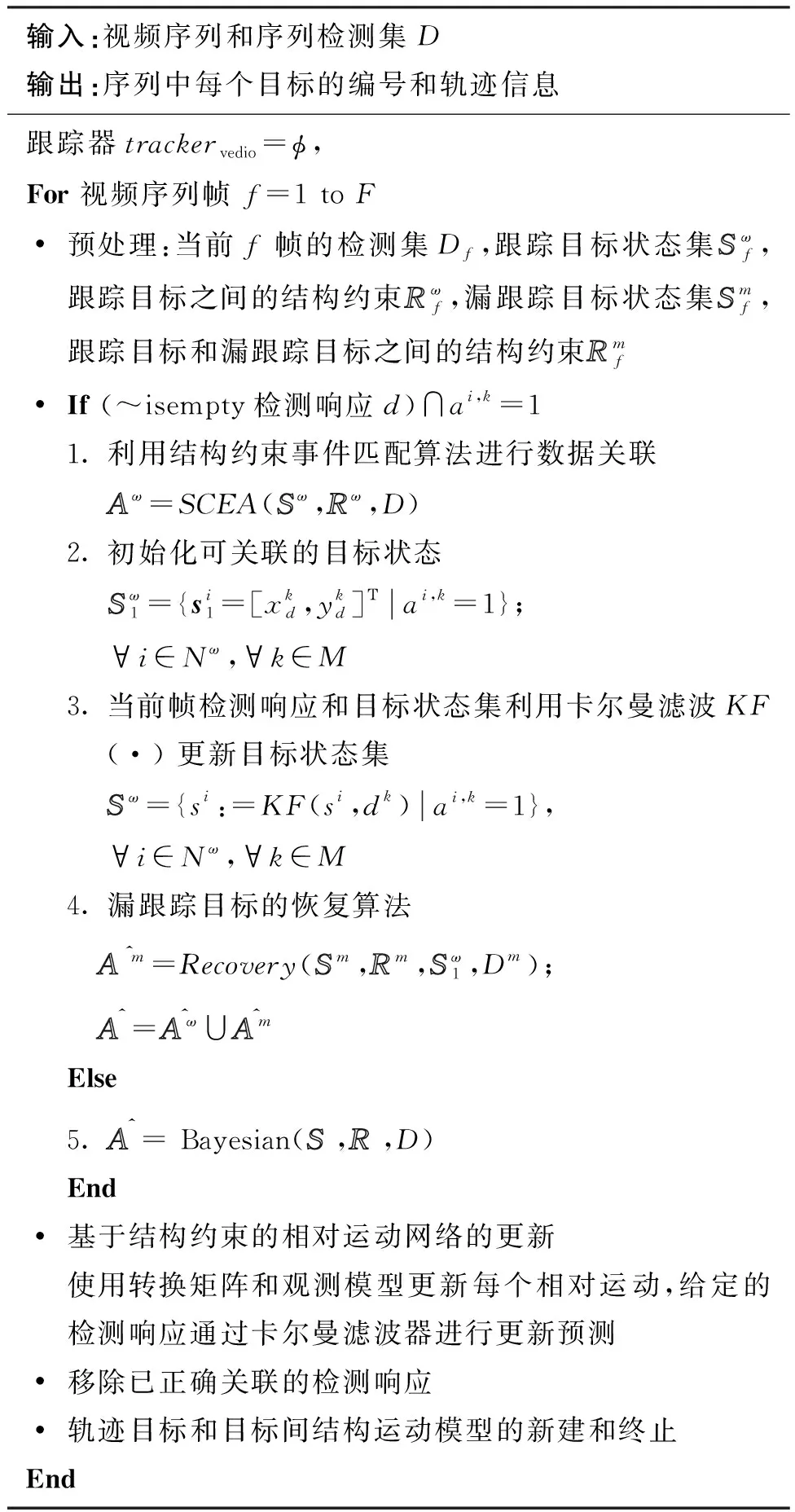

充分利用目标之间的相对运动信息改进数据关联框架。当目标匹配成功且出现新的检测响应时,采用结构约束事件匹配算法,否则采用原贝叶斯框架[10]进行数据关联。在算法1中描述了在线多目标跟踪的整个过程。

算法1 在线多目标跟踪框架

由于摄像机的移动,目标间相对运动模型的方向和速度是动态的,采用分段线性恒速模型对时变运动进行建模。其中,干扰假定为高斯白噪声。两个检测响应的位置差定义为观测量并使用卡尔曼滤波器[12]更新相对运动集R。漏跟踪目标使用匀速运动模型进行简单预测。

目标的新建和终止与Breitenstein等[13]提出的目标初始化方法类似,即使用两次检测响应之间的重叠距离阈值判断方法进行新目标轨迹以及对应的相对运动模型的初始化和终止。

4 实验

4.1 实验平台

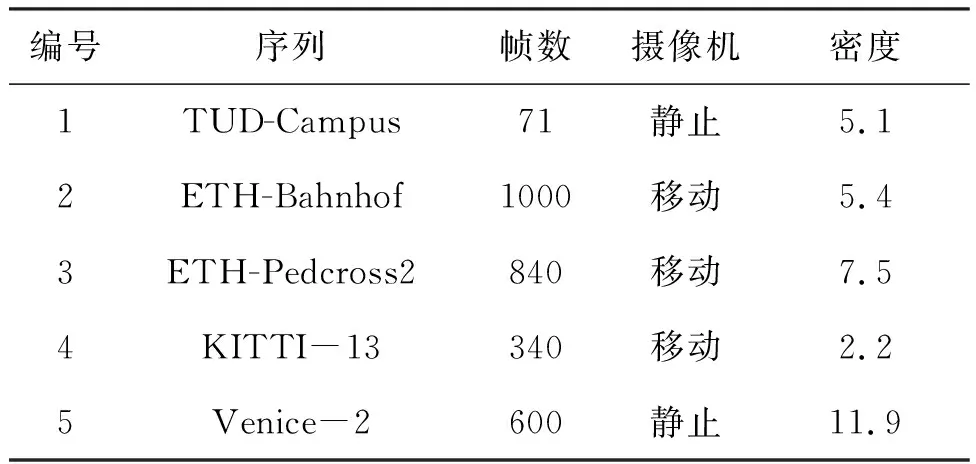

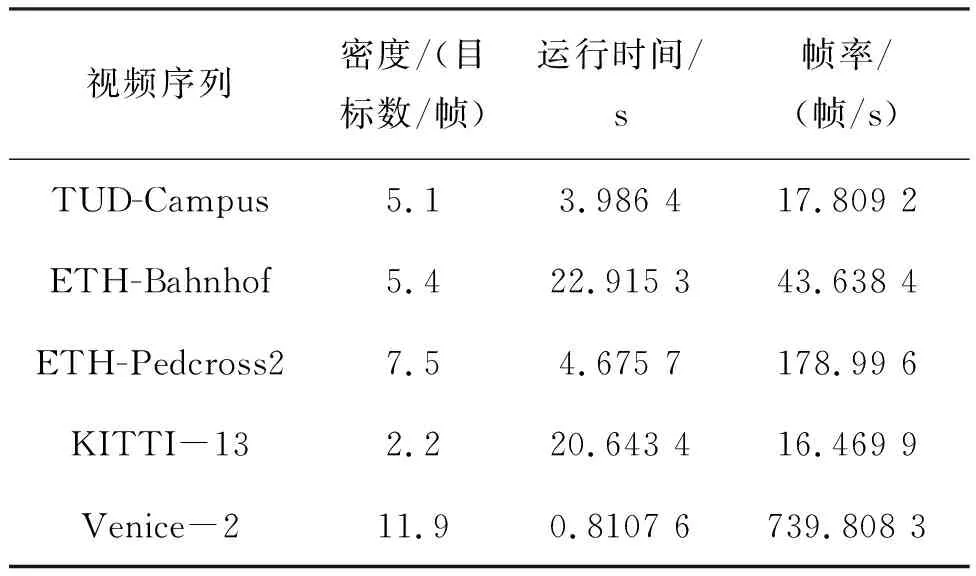

该实验在配置为Inter(R)Core TM i5-3230M CPU @ 2.60GHz处理器、4 GB内存、64位Windows操作系统的笔记本电脑上运行。下载MOT2015竞赛[14]中的公开视频序列和Xiang等[15]提供的检测响应进行测试,采用的数据集的图像属性与相机配置等如表1所示。表中的密度表示序列中行人的稠密程度,值越大代表行人稠度程度越大。

表1 MOT2015应用的序列介绍

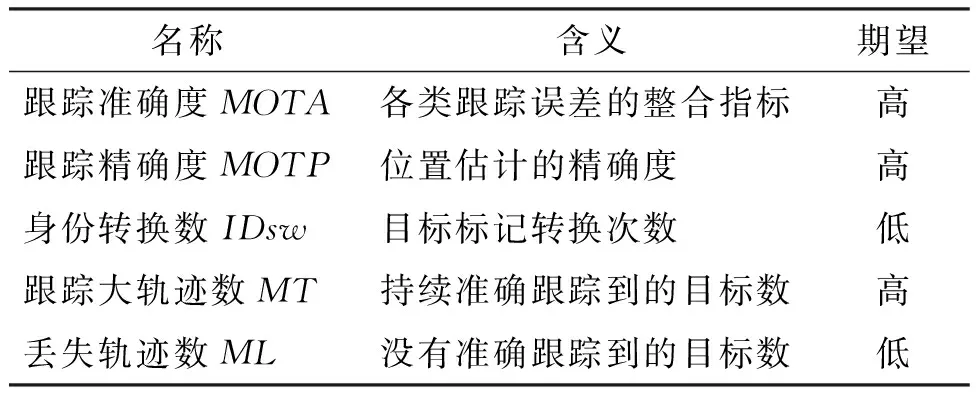

4.2 评价方法

采用了Bernardin等[16]设计的针对多目标跟踪技术的CLEAR MOT评价体系,是将实验结果与原图像的实际轨迹按照指标求解算法得到最终结果。参考的指标内容如表2所示。表2列举了文献[16]中的几个主要性能指标,文中性能对比采用的指标根据实际情况进行必要的删减和添加。多目标跟踪准确度(Multiple Object Tracking Accuracy, MOTA)和多目标跟踪精确度(Multiple Object Tracking Precision, MOTP)是本文最为关注的两项指标。

MOTA代表了多目标跟踪性能的总体指标。

式中,FNt、FPt和IDswt分别代表了轨迹在第t帧的错误匹配次数、错误检测次数和身份转化次数,GTt是地表实值中真实目标轨迹的总数。

MOTP描述了跟踪结果与地表实值之间的重叠比例。

表2 CLEAR MOT主要评价指标

4.3 实验一

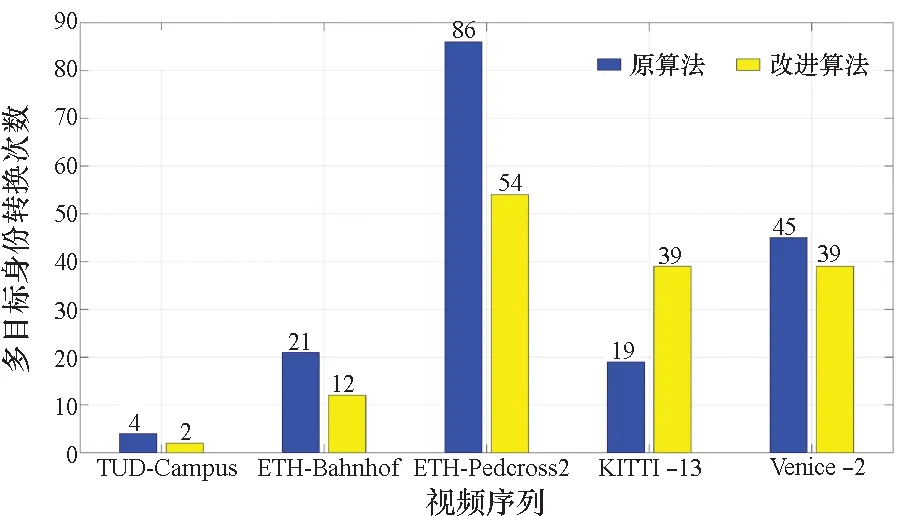

选取移动摄像机从不同视角拍摄的ETH-Bahnhof、ETH-Pedcross2和KITTI-13视频序列[17],为了验证算法的普适性,同样选择了两组由静止摄像机拍摄的TUD-Campus和Venice-2视频序列。为了直观显示出改进算法框架较原来算法在总体性能上提高的效果,对MOTA、MOTP和IDsw三大性能指标进行分析,如图1所示。从图1中可以看出,改进算法可以在保持高跟踪精度的前提下,提高跟踪准确度,比如TUD-Campus序列MOTA指标从77.4%提高至78.6%;ETH-Bahnhof序列的MOTA指标从55.8%提高至57.6%;特别是镜头移动幅度大、遮挡严重的KITTI-13序列的MOTA指标提高了26%。这也间接说明算法在静止摄像机拍摄的视频中具有优良性能。身份转换次数是衡量目标跟踪过程中保持目标身份完整性的指标。从图1(c)可以看出,改进算法大幅度地减少了IDsw,特别是在序列ETH-Pedcross2和ETH-Bahnhof中,IDsw值降低超过了35%,有利于提高跟踪识别的准确性。同时也可以看出,KITTI-13中IDsw值是增加的。

(a) 不同序列的跟踪准确度(a) MOTA for different sequences

(b) 不同序列的跟踪精确度(b) MOTP for different sequences

(c) 不同序列的身份转换次数(c) IDsw for different sequences图1 改进算法和原算法的对比Fig.1 Comparison between improved algorithm and original algorithm

为了进一步考察算法的实时性效率,以算法执行总时长(单位为s)和帧率(单位为帧/s)来进行效率对比。基于一致的响应集,多次测量取平均估计值,最终结果如表3所示。

表3 算法的运行效率分析

从表3的数据可以看出,算法在五段序列下的总运行时间达到50 s左右,平均帧率约为25帧/s。序列时长较短和硬件平台内存运行不稳定等因素导致个别序列与总体估计值存在较大误差。本节展示了各个序列的平均行人密度,可以大致认为密度越大的序列下,算法运行的速度越快。增大视频集的数据量,稳定算法的最终帧率,也是下一步工作重点。

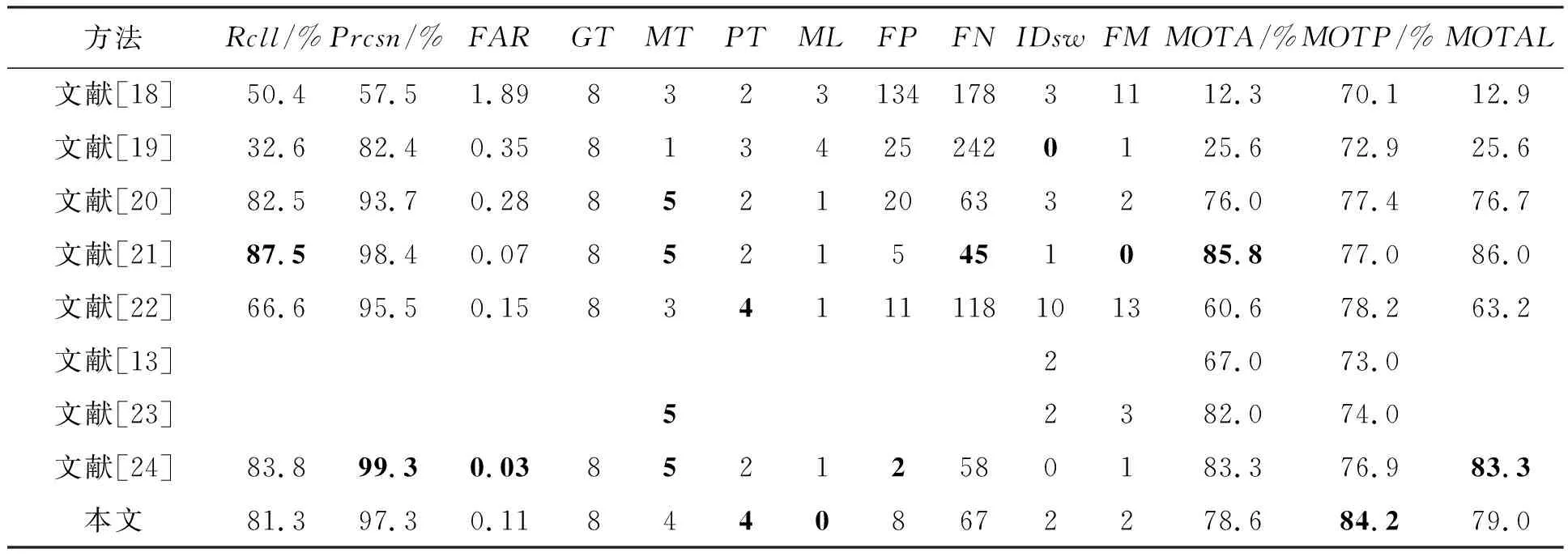

4.4 实验二

针对应用最广的TUD-Campus视频序列,算法的最终序列跟踪结果如图2所示,对比实验的量化指标参考表4。为了更加直观地展示实验结果,一共选择5种离线算法和3种在线算法的最终结果进行对比。

针对序列TUD-Campus,表4中的加粗部分是该指标下最好的结果。可以看出:文献[21]的离线算法的MOTA指标最优,利用未来帧信息的离线算法在数据关联中比在线方案更容易得到全局最优解。本文在线算法的MOTP指标最优。本文算法的其他指标与其他算法接近,缓解了序列中轨迹碎片的问题,较好地保持了目标的完整轨迹。图2显示了序列上的跟踪情况。目标1在整个序列中保持了完整的轨迹和唯一的标记。在目标4横穿目标3、 5和6的过程中,目标3、 4、 5和6都很好地保持了原本的身份标记。特别是在第19帧,正确跟踪到了相互遮挡严重的目标1、 4和5。对于一开始遮挡严重的行人,跟踪算法存在一定的问题,比如目标7开始时并没有被跟踪上,只有在第28帧的时候才开始跟踪。目标8在第55帧才开始跟踪。这一方面说明了算法对起始遮挡就很严重的目标不敏感,另一方面也说明了算法在后期处理遮挡、漏跟踪有很大的作用。

图2 在序列TUD-Campus的跟踪效果Fig.2 Result of TUD-Campus sequence

表4 在TUD-Campus序列的不同跟踪结果

5 结论

视频中多目标间的运动模型受到摄像机的运动影响变得难以预测。一个鲁棒的多行人跟踪器除了需要估计未知数量的视频中感兴趣的目标及其各自独有的轨迹,还应在漏跟踪和误检的时候能够恢复,减少检测失败造成的跟踪失败。本文重点研究了由目标间的位置和速度搭建的相对运动网络,利用相对运动对漏跟踪目标进行恢复,采用分层数据关联的方法对分配事件进行管理。利用恢复漏跟踪目标算法对算法进行优化,提出改进的数据关联解决方案,以更详尽的方式估计目标与检测之间的分配。为了验证所提数据关联算法的有效性,利用了接受度最广、使用率最高的公开数据集进行实验验证并取得了较好的实验结果。该框架的跟踪性能较原始框架有了很大的提高并且可以和先进的离线跟踪算法媲美。

分析实验效果可知,本算法针对摄像机视野中的大目标具有良好的普适性,相对运动模型可以很好地解决部分遮挡和交叉问题。然而,也正由于该模型的存在,当出现误检目标时,如果没有即时消除该目标的相对运动模型会造成下一帧的其他目标跟踪失败。该算法容易丢失序列中尺度差距较大的目标。因此下一步的主要工作是修正相对运动模型,考虑过去帧的信息对跟踪模糊的目标进行更新,并继续完善损失函数中的相似度度量,使得算法可以鲁棒地跟踪尺度差距明显的目标和小目标。

本文对算法的跟踪准确度和精确度做重点研究。受硬件平台影响未对实时性做重点评估。往往高精度需要降低运行效率作为代价。基于有限的平台下,根据实际需求评估算法的准确度和实时要求的平衡问题也是不容忽视的。因此实时性重要考察指标也将是下一步工作的重点。