微表情类别与区域间关联度的分析方法研究

2020-10-10张延良蒋涵笑洪晓鹏赵国英张伟涛

张延良,卢 冰,蒋涵笑,洪晓鹏,赵国英,张伟涛

1.河南理工大学 物理与电子信息学院,河南 焦作454000

2.西安交通大学 电子与信息工程学院,西安710049

3.奥卢大学 机器视觉和信号分析研究中心,芬兰 奥卢FI-90014

4.西安电子科技大学 电子工程学院,西安710071

1 引言

微表情是无意识下非自主控制的面部表情,它通常出现在人们想要掩藏和抑制他们真实情感的时候[1-3]。微表情识别能够检测谎言、揭示真实情感,因此它广泛应用在心理诊断、公共安全、审讯等领域[4-5]。与常规表情相比,微表情出现在面部区域的面积更小,肌肉动作幅度更轻微,而且速度非常快(在1/25~1/3 s之间),因此运用计算机自动识别微表情具有相当的难度。

微表情识别的研究主要集中在特征提取和分类上。贲晛烨及张军平分别[6-7]对微表情识别中的一些关键技术进行了综述。芬兰奥卢大学赵国英等人最早用动态纹理描述子LBP-TOP 算子提取微表情特征[8]。后续又出现了许多对该描述子的改进方法,如CBP-TOP[9]、LBP-SIP[10]、STCLQP[11]等。文献[12]以光流场为描述微表情运动模式的基础特征,提出用面部动力谱特征进行微表情识别。不同的微表情数据集是在不同的环境下用不同的拍摄设备建立的,文献[13-14]运用迁移学习的方法研究了跨库微表情识别的问题。文献[15]运用迁移学习深度神经网络研究了小样本集微表情识别的问题。

这些方法大多是通过对面部全局区域进行无差别分块,然后将各块的时空模式特征串联构成总的特征向量用于分类。这种基于全局区域的方法忽略了微表情类别与各局部区域之间的联系。

心理学研究发现,不同类别的微表情出现在面部区域位置也不同[3],如高兴体现为脸颊和嘴角区域的肌肉动作(表现为脸颊提升和嘴角上扬)、惊奇出现在眉毛和嘴部区域(表现为眉毛上提和双唇微张)等。通过大量观察发现,面部产生微表情的同时,也存在与微表情无关的面部动作变化。因此,准确剔除与微表情无关的面部区域,只提取与微表情紧密相关的局部区域的特征,是提高识别效果的关键所在。这就要求研究微表情类别与面部各局部区域的关联度,找出微表情经常发生的关键区域。

本文提出了一种划分面部关键局部区域及分析它们与微表情类别关联度的方法。首先根据各类微表情对应动作单元所在的位置信息确定出人脸最为关键的局部区域,即眼睛、鼻子、嘴巴、下巴及面颊等,然后采用面部形变鉴别模型自动检测出的面部关键点并自动划分出这些区域块。通过分析各区域块对各类微表情进行分类的准确率来确定两者之间的关联度。

2 全局区域方法与局部关键区域块的划分

2.1 全局区域微表情识别

全局区域的微表情识别是把整个面部图像作为研究对象,再将人脸分割为若干个重叠或者不重叠的块[4,8,16],如图1 所示。其中,图(a)中人脸被划分为不重叠的9×8 个区域块,图(b)中人脸被划分为相互重叠的4×3 个区域块。在每个区域块上分别提取局部区域时空模式特征,然后将串联后的特征作为整幅图像的特征向量,过程示意图如图2所示。最后将特征向量输入分类器实现微表情的分类。

图1 人脸分割区域块

图2 特征向量的提取

全局区域的微表情识别,在全面地提取到人脸特征的同时,也会提取到与微表情无关区域的肌肉动作,从而降低识别的效果。为了剔除这些无关区域,需要确定面部各局部区域与微表情的关联度。

2.2 面部动作单元与特定微表情的关系

面部动作编码系统(Facial Action Coding System,FACS)是美国心理学家Ekman 和Friesen 为客观进行人类面部表情识别而制定的[17]。该系统定义了46 个动作单元(Action Units,AUs),其中的32个AUs与面部肌肉动作有关,每个AUs描述面部一个局部肌肉群的特定动作模式。例如AU1表示眉毛内端上扬,AU10表示上嘴唇上扬等。任何一个面部表情都可以认为是由一个或者若干个AUs 的组合运动引起的。6 种常规表情与相应AUs的对应关系,如表1所示[17]。

微表情是人在高度紧张等特殊情形下面部肌肉的短暂、轻微动作,其与AUs的对应关系与常规表情不同。例如,“厌恶”在常规表情时对应AU9+AU15+AU16,但在微表情出现时对应AU9 或者AU10 或者AU4+AU7。微表情数据集CASME2的建立者中科院心理所傅小兰课题组从该数据集中总结的微表情与相应AUs 的对应关系,如表2所示[3]。

表1 常规表情与相应FACS AUs的对应关系

表2 微表情与相应FACS AUs的对应关系

2.3 人脸局部区域块的自动划分

依据表2 中给出的与微表情类别相应AUs 所在的面部区域位置,可以将面部区域划分为7 个局部区域块,如图3 所示。其中,1、2 局部区域块为眼睛,3 为鼻子,4为嘴巴,5、6为脸颊,7为下巴。每块区域都是一个或几个面部动作单元的组合,所对应的FACS AUs如表3 所示[18]。对表2 和表3 进行比较可知,本文所划分的7个局部区域块完整涵盖了各微表情类别所对应的全部FACS AUs,并且剔除了与微表情无关区域,有效避免了无关区域对微表情识别的影响。

图3 局部区域块的划分

表3 面部区域划分及其对应的FACS AUs

对于局部区域块的自动划分,首先要进行面部关键点的定位。本文采用一种判别式算法—形变鉴别模型方法[19],它不同于经典的主动外观模型方法(Active Appearance Model,AAM)[20],是自动标识人脸的49 个关键点坐标,可以实现面部模型的增量学习,因此对关键点的定位精度高,同时速度也很快,可以达到80 f/s。依据这一方法可以实现上述区域块的自动提取。图4展示了49个关键点位置坐标,依据相应的关键点坐标,分割出人脸的7 个矩形局部区域块。矩形区域框的位置和大小取决于4个边界(即上、下、左、右)对应的坐标点,这7个区域块边界对应的坐标点,如表4所示。

图4 49个关键点位置

表4 各局部区域边界坐标点

3 局部时空模式特征提取

局部二值模式(Local Binary Patterns,LBP)是由Ojala 等人[21]在1996 年最先提出的,并成功地将其应用在纹理分类中。LBP 算子是一种有效的局部纹理描述子,可以度量和提取灰度图像中局部近邻区域的纹理信息。其特点是计算简单且对光照变化不敏感,具有旋转不变性和灰度值单调变化的不变性。它是以一个像素点为中心,对该像素点周围像素的灰度值进行运算,然后对每个像素点赋予不同的权值,计算结果表示中心像素点的LBP值。

式中,是一个符号函数,gc表示中心点像素值,gp表示邻域内的一个像素值。邻域像素的灰度值与中心像素点灰度值进行比较,大于或等于中心像素点灰度值时标记为1,反之,标记为0。将所有的0和1串联,形成一个二进制数作为中心像素点的局部二进制模式。图5给出了邻域像素点数p=8 时,计算一个像素LBP 模式的过程。通过统计纹理图像中所有像素对应的LBP 模式出现频率的直方图作为该图像的特征向量。

图5 LBP计算过程

LBP算子主要用于静态纹理分类中,为了将LBP从2D 扩展到3D,Zhao 等人[16]提出考虑3 个正交平面上二维LBP模式的LBP-TOP描述子。将每个正交平面上的特征向量进行串联,如图6所示。可以把这个视频序列当作一个长方体,那么可以获得该图像序列的3个正交面XY、XT、YT。XY平面提供了空域信息,XT和YT平面提供了人脸图像随时间变化信息。

图6 特征描述子LBP-TOP

然而,LBP-TOP 的向量维度是3×2p,p是邻域点个数。这样高的维度增加了计算成本,降低了识别的性能。为了克服这一缺点,采用UniformLBP描述子[22],在一个平面上的向量维度从2p降到p(p-1)+3,从3 个平面(XY、XT和YT)上提取出来的特征向量串联起来作为LBP-TOP特征。

4 实验结果与分析

本文采用的是中科院心理研究所建立的CASME2微表情数据集。该数据集里面的微表情视频序列全部采用自然诱发的真实微表情,在拍摄过程中,要求所有参与者在出现自然的、动态的微表情前后,均保持中性表情。该数据集包括26 个测试者的微表情视频序列,表情类别有高兴、厌恶、惊奇、压抑、悲伤、害怕及其他共7种。由于数据集中悲伤、害怕这两种微表情样本较少,故本文实验中涉及到的微表情类别是剩余的5 种,共247个视频序列。

在进行人脸区域块划分和特征提取分类的实验之前,需要首先对微表情视频序列进行人脸对齐。采用主观形状模型(Active Shape Model,ASM)自动标定所有视频序列人脸图像的68 个关键点[23],以这些点为基础,运用局部加权平均算法计算每个视频序列的第一帧面部图像与模板面部图像的形变关系矩阵,将这一矩阵作用于对应序列的其他图像。这一人脸对齐步骤,可以较好的消除不同人脸、不同序列在无表情状态下的形状和位置差异,从而提高后续操作的精确度。

为了科学分析各类微表情与2.3节划定的局部关键区域的关联度,在每个区域上分别提取LBP-TOP特征,并利用支持向量机进行微表情分类。采用留一交叉验证法对各区域的识别效果进行评判。在该方法中,选择一个测试者的视频序列作为测试数据,其他测试者的视频序列作为训练数据。这个过程重复K次,K=26 是数据集中被测者的数量,然后综合26 次的识别效果以形成最终的分类准确率。本文以分类准确率作为评判标准,实验的运行环境是MATLAB R2016a。

4.1 全局区域和局部区域对比实验

本章对比全局区域和局部区域两类方法的微表情分类准确率,以检验本文划分的各局部区域对微表情识别的有效性。在提取面部局部时空模式LBP-TOP特征时,需要设置如下参数,邻域像素点数p,邻域半径r,时空区域块划分方法(n,m,t),其中n、m及t分别是沿X轴、Y轴及T轴的等分数目。

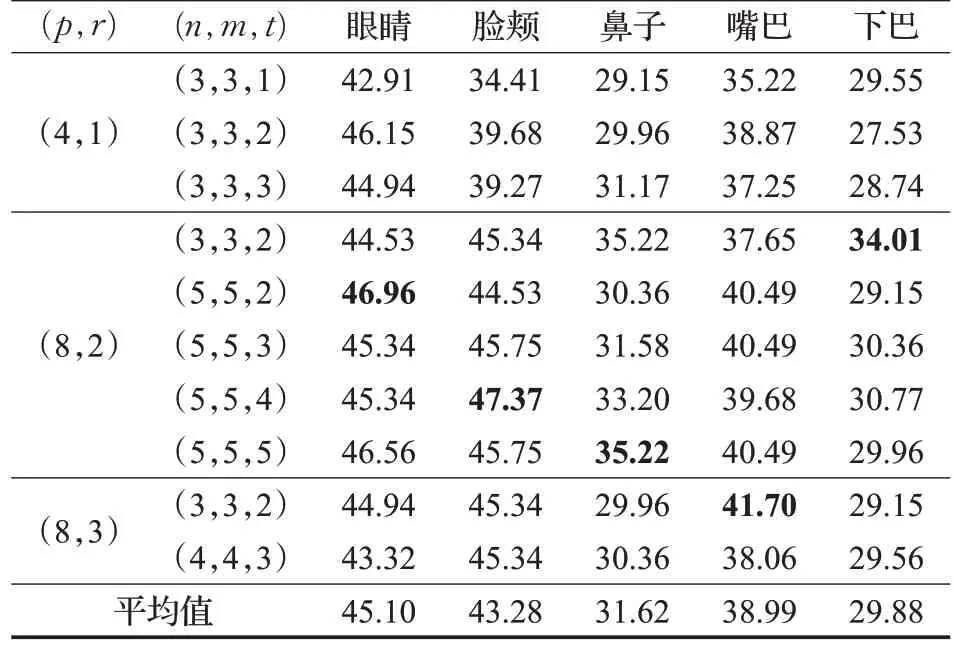

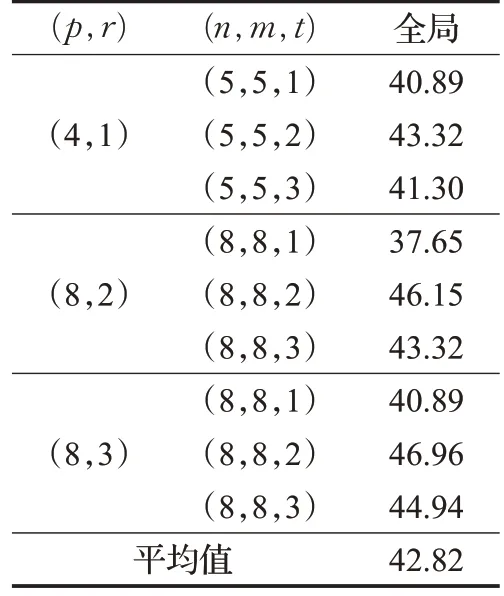

表5列出了各局部区域块在不同参数组合下的微表情分类准确率及平均值,表6列出了全局区域方法在不同参数组合下的分类准确率及平均值。在表中,各个区域在不同参数组合情况下的最佳分类准确率加粗标示。从表5 及表6 中可以看出,全局区域方法对微表情的平均分类准确率为42.82%,脸颊、眼睛区域的平均分类准确率分别为45.10%、43.28%,高于全局区域方法的平均分类准确率。这说明脸颊和眼睛区域是各类微表情动作比较集中的区域,由于舍弃了全局方法中与微表情动作无关区域的特征,使其在较小的观测区域内实现了比全局方法更好的识别效果。而鼻子、嘴巴、下巴等局部区域对微表情的平均分类准确率分别为31.62%、38.99%、29.88%,低于全局方法的分类准确率。原因是这些区域与单一微表情动作有关,而仅用其中一个区域实现对全部种类微表情的识别,势必会降低整体的分类准确率。

表5 各局部区域不同参数组合下的分类准确率%

表6 全局区域方法不同参数组合下分类准确率 %

4.2 局部区域与微表情类别关联度实验

本部分实验通过各局部关键区域对各微表情类别分类准确率的混淆矩阵[24]来分析两者之间的关联度。心理学研究发现,不同类别微表情的发生区域有一定的规律。因此,可以通过局部区域对各微表情类别识别的准确率高低来估计两者之间的关联程度。具体来说,某区域对某类微表情的识别准确率高,意味着这类微表情在该区域发生的概率较高,两者有较高的关联度,反之亦然。

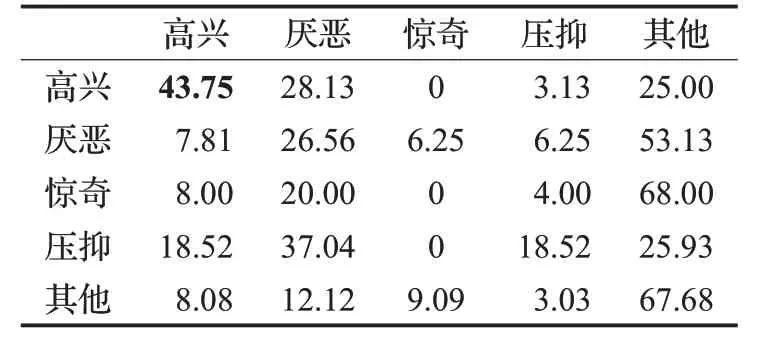

不失一般性,这里列出了在4.1 节最优参数组合下各局部区域对微表情进行分类得到的混淆矩阵。由于在CASME2 数据集里标定为“其他”的类别,不是某种特定的微表情,而是除了主要微表情类别之外其他多种微表情的集合。因此,这里仅分析微表情类别“高兴”“厌恶”“惊奇”、“压抑”与各局部区域的的关联度。眼睛、脸颊、嘴巴、鼻子及下巴区域的混淆矩阵分别如表7~11所示。混淆矩阵中,主对角线上的元素给出了各类微表情正确识别率(准确率较高的元素已加粗显示),其他元素给出了将某类微表情(纵轴所示)误识别为另一类微表情(横轴所示)的比率。混淆矩阵每一行元素的和为100%。

表7 眼睛区域的混淆矩阵%

表8 脸颊区域的混淆矩阵%

表9 嘴巴区域的混淆矩阵 %

表10 鼻子区域的混淆矩阵 %

表11 下巴区域的混淆矩阵%

从表7中可以看出,眼睛区域对“高兴”识别准确率是18.75%,将“高兴”误识别为“厌恶”“压抑”的比率均为9.38%;该区域对微表情“厌恶”和“惊奇”的识别准确率分别是46.88%和52%,说明这两种微表情在眼睛区域发生的概率较高,表明眼睛区域与微表情“厌恶”和“惊奇”的关联度较大。

如表8所示,脸颊区域对“高兴”和“厌恶”的识别准确率均为40.63%,表明脸颊区域与“高兴”和“厌恶”的关联度较大。

表9列出了嘴巴区域识别率的混淆矩阵,从表中可以看出,嘴巴区域对“高兴”识别准确率为43.75%,表明嘴巴区域与“高兴”的关联度较大。

从鼻子区域识别率混淆矩阵表10 中可以看出,鼻子区域对“高兴”“厌恶”“惊奇”“压抑”4种微表情的正确识别率均低于误识别率,说明鼻子区域与各种微表情均没有显著的关联度。

从表11 中可以看出,下巴区域对“压抑”识别准确率为40.74%,表明下巴区域与“压抑”的关联度较大。

综合上述实验结果,可以得出,微表情“惊奇”及“厌恶”与眼睛区域、微表情“高兴”与嘴巴区域、微表情“压抑”与下巴区域有较高的关联度。

此外,对CASME2 数据集中测试者中性表情和微表情发生时的面部图像进行了对比,从主观感受角度分析微表情类别与局部区域的关系。图7列出了部分“高兴”“厌恶”“惊奇”“压抑”的微表情样本,用方框圈出了微表情发生时肌肉动作明显的区域。通过对比分析,发现微表情“惊奇”和“厌恶”与眼睛区域、“高兴”与嘴巴区域、“压抑”与下巴区域有较高的关联度,这和实验结果相符,进一步印证了相关结论。

图7 CASME2数据库不同情绪下的微表情样本

5 结束语

不同于常规表情,微表情具有动作幅度和区域小、持续时间短的特点。现有的基于全局区域的微表情识别方法是建立在对面部进行无差别整体分块的基础上,忽略了微表情类别和局部关键区域的关联。本文提出的面部关键区域划分方法,充分利用了微表情发生时对应动作单元的位置信息。更进一步,本文通过分析各局部区域对各类微表情的分类准确率,从定量角度分析了所划分区域和各微表情的关联度。本文的有关结论是在分析CASME2数据集的247个微表情样本得出的,样本数量较少,后续需要在更广泛的微表情数据集上展开研究,以期得出更为详尽乃至数量化的微表情类别与面部各区域的关联度结果。本文的有关结论,为后续设计更为科学、高效的微表情识别算法提供了有益的指导。