基于激光测距的双通道双谱彩色目标的图像融合技术

2020-08-25卫小强

卫小强

摘 要:本文设计一套多源多模式的图像融合系统。信息的多源化和冗余性为图像处理的最终质量提供了保证。笔者提出了相应的融合策略,以便为众多信息融合时实现快速、可靠的整合提供解决思路。

关键词:冗余性;激光测距;多源性;Curvelet

中图分类号:TN223文献标识码:A文章编号:1003-5168(2020)20-0019-02

Abstract: This paper designed a multi-source and multi-mode image fusion system. The multi-source and redundancy of information provided a guarantee for the final quality of image processing. The author proposed a corresponding fusion strategy in order to provide a solution for the realization of rapid and reliable integration of many information fusion.

Keywords: redundancy;laser ranging;multi-source;Curvelet

随着微电子技术与传感器技术的发展,人们可以通过不同模式的传感器获得感兴趣的目标场景。这些传感器可以是可见光学摄像头,也可是红外、微光等不可见光的摄像装置。可见光类传感器的优点是图像日间的分辨率高,场景的细节信息量大;不可见光的传感器分辨率普遍较低,但夜间获取目标对象的敏感度高,这些是光学传感器所不具备的[1-2]。将两者有机结合,可将各自优点互相融合,同时增加信息冗余度,这样才能更全面、真实地反映所描述的客观内容。但是,多模式又带来无法避免的信息量大、处理耗时的问题。人们需要通过一定的方法,在大量多来源的信息中快速分离感兴趣的目标对象信息,通过融合策略对这些多模式目标信息进行整合,使新生成目标既具有光学传感器分辨率高、细节丰富的优点,又具备不可见光传感器高亮色彩可获得的优点,即最终获得的目标图像既具有自然色,符合人类的视觉感官,又具有醒目的高亮色,尤其在夜色中,类似对目标进行备注,突出目标重点。

1 左侧短时间间隔内的单目彩色光学摄像机的连拍信息的冗余性

使用一台光学彩色摄像机在短时间内连拍若干张同一场景的目标图像,当然针对的是缓变的目标场景。这些图像来源于同一台摄像装置,所以一般融合时无须配准,分辨率一致[3-4]。在连拍过程中,将其聚焦点与曝光条件适当等间距化,这样融合为一张图像时形成不同聚焦和曝光的冗余信息。通过一定的融合策略,人们可以得到各个部分都聚焦良好的清晰图像,即全局都为聚焦且光线充足的图像,这样充分利用了单台摄像机的资源与潜力。

融合策略可采用像素级融合。它可以直接对多幅图像的相应信息进行处理,优点是因为单目多幅同一场景,配准精度非常高,能提供多目摄像机无法获得的丰富、精确且可靠性高的信息。但缺点是信息量大,处理耗时,实用性受限。所以,要限制其连拍的幅数,同时必须在极短的时间内完成,这在一定范围内要受到摄像机连拍速度的制约。同时,其对目标对象也有要求,在短时间间隔内不能剧烈变化,所以主要针对缓变目标。

2 右侧单目前视红外图像

红外摄像装置与可见光摄像装置的成像原理不同,后者主要根据目标图像光谱的散射、反射等成像,而前者主要根据接受目标的热辐射强弱特性成像。可见光装置分辨率高,所以背景信息量大,能较好地反映环境的细节。而红外成像对环境不敏感,将可见光与红外摄像头结合,能更好地表征目标场景的详尽信息,既提高目标的识别性,又可解释目标与环境的关联,进一步增加观察者对目标行为的理解力。

3 激光测距辅助装置下的左侧光学摄像机与右侧前视红外摄像机的相互融合

激光测距处于左侧光学摄像机和右侧前视红外摄像机之间连线的中点位置。在摄像机对目标场景的拍摄中,激光测距记录大量的目标及场景深度测量数据,通过这些深度数据的积累进行并行数据处理,再设置合适阈值分类,对图像中的各个目标进行分割,这样就不必对整幅图像进行融合,真正的融合对象是目标本身。这种图像分割方式的鲁棒性、可靠性均较高,它可以大量节约后面的融合时间,以便后续只针对目标进行多模的图像融合,即在激光测距的辅助下,将图像融合转变为图像中特定目标区域的融合。这种方法可以解决图像融合中耗时、无法实时处理的问题,同时因为融合区域小,可采用一些计算复杂、精确度要求高的融合方法。

4 双模式下的图像融合策略——Curvelrt变换

Curvelet变换是一种在小波变换基础上发展而来的多分辨率、多尺度的几何分析方法。它既继承了小波变换的多分辨率、多尺度的优点,又增加了前者所不具备的多方向性的各向异性特征。图像表征比小波变换更接近真实目标,减少了配准误差。

基于激光测距的图像,对获得的可见光图像与红外图像进行分割,然后进行感兴趣目标区域的融合算法设计。

采用非下降沿Cuevelet变换,将可见光图像[Ivi]和红外图像[Iir]区域分別进行多尺度、多方向的分解,可依次获得[Ivi]和[Iir]区域的NSCT系数,这些系数包括低频子带系数[Cj0(m,n)]和各个带通方向子带系数[Cj,l(m,n)]。采用分别不同的融合策略,对可见光图像和红外图像的低频子带系数、各个带通子带系数进行融合。

将融合结果进行Cuevelet反变换,可得最终融合图像,融合规则如下。

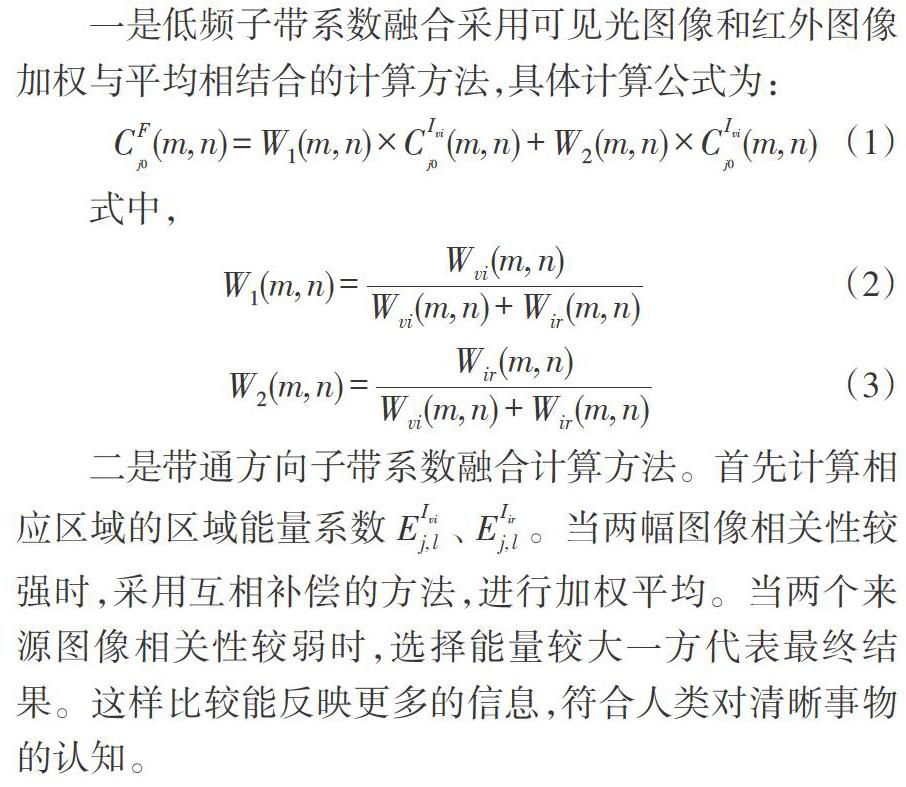

一是低频子带系数融合采用可见光图像和红外图像加权与平均相结合的计算方法,具体计算公式为:

二是带通方向子带系数融合计算方法。首先计算相应区域的区域能量系数[EIvij,l]、[EIirj,l]。当两幅图像相关性较强时,采用互相补偿的方法,进行加权平均。当两个来源图像相关性较弱时,选择能量较大一方代表最终结果。这样比较能反映更多的信息,符合人类对清晰事物的认知。

参考文献:

[1]Cuihong Qu,Dali Zhang,Pingfan Yan.Medical image fusion by wavelet transform modulus maxima[J].Optics Express,2001(4):184-190.

[2]毛士艺,赵魏.多传感器图像融合技术综述[J].北京航空航天大学学报,2002(5):512-518.

[3]吴良华.多传感器图像融合算法研究[D].长沙:国防科技大学,2005.

[4]李勇.基于多尺度分解的多源图像融合算法研究[D].长春:吉林大学,2010.