基于HOG特征协方差矩阵的动作识别算法

2020-08-04金锋张德王亚慧

金锋 张德 王亚慧

摘 要: 为了提高HOG在动作识别应用中的识别率,提出一种基于HOG特征协方差矩阵的动作识别算法。算法以HOG特征为样本计算协方差矩阵,再通过矩阵对数运算,将协方差矩阵从黎曼流形映射到线性空间;然后从协方差矩阵中提取描述子,基于不同的核函数使用支持向量机进行分类。在公开的三个数据库Weizmann,KTH和UCF Sports上分别进行实验,实验结果表明,文中提出的算法具有很好的识别性能。

关键词: 动作识别; 计算机视觉; 图像处理; 模式识别; HOG特征; 协方差矩阵

中图分类号: TN911.73?34; TP391.4 文献标识码: A 文章編号: 1004?373X(2020)03?0078?04

Action recognition algorithm based on covariance matrix of HOG feature

JIN Feng, ZHANG De, WANG Yahui

(School of Electrical and Information Engineering, Beijing University of Civil Engineering and Architecture, Beijing 100044, China)

Abstract: An action recognition algorithm based on covariance matrix of HOG (histogram of oriented gradient) feature is proposed to improve the recognition rate of HOG in action recognition applications. In the algorithm, HOG features are taken as samples to calculate the covariance matrix, and then the covariance matrix is mapped from the Riemannian manifold to the linear space by matrix logarithm operation. Then the descriptors are extracted in the covariance matrix and classified by support vector machine according to different kernel functions. Some experiments are conducted on the three public databases Weizmann, KTH and UCF Sports respectively, and the results show that the proposed algorithm has good recognition performance.

Keywords: action recognition; computer vision; image processing; pattern recognition; HOG feature; covariance matrix

0 引 言

视频图像已成为人们获取视觉信息的主要手段,特别是视频流和计算机处理相结合,人们称之为计算机视觉。人类获取客观世界信息的80%都来自于视觉,由此可见,人类视觉系统对人类获取信息而言非常重要[1]。目前,人体运动分析是计算机视觉领域中最活跃的研究主题之一,其核心是利用计算机视觉技术从图像序列中检测、跟踪和识别人并对其行为进行理解与描述。基于计算机视觉的人体动作识别在智能监控、智能家用电器、人机接口、基于内容的视频检索等领域有着广阔的应用前景和极大的经济价值和社会价值[2]。

人体动作识别算法主要涉及动作表示和动作分类两个步骤。目前,根据人体动作将已有动作识别的方法大体分为三类:

1) 基于时序或者状态模型的动作识别方法[3]。该类方法通过对视频中运动人体检测、分割与跟踪,提取人体轮廓特征并建立动作的时序或状态模型,然后比较输入视频中相应特征与模型的相似性以达到动作识别的目的[4]。该类方法计算简单、方便快捷,但是该方法的缺点是识别结果容易受视角变换和部分遮挡的影响。

2) 基于上下文及语境分析的动作识别方法。该方法将人体运动信息与全局中的场景或者物体编码为一个整体进行动作识别。此类方法识别效果较好,但是计算量大,只适合用于特定的场景[5]。

3) 基于局部时空特征点的动作识别方法。该类方法将视频序列看成是时间域或者空间域上的三维时空卷,然后在三维时空卷上探测局部时空特征点并通过计算其特征进行动作识别[6]。此类方法计算复杂度低且对噪声和部分遮挡不敏感,具有一定的鲁棒性,但是要求特征点足够稠密,以便能够保证涵盖运动目标的全部信息。近年来基于深度学习的方法也受到广大学者的关注与研究[7?8]。

为了提高所提取特征向量的表征性,提高动作识别精度,本文提出一种基于HOG(Histogram of Oriented Gradient)特征协方差矩阵的动作识别算法。算法以HOG特征为样本计算协方差矩阵,再通过矩阵对数运算,将协方差矩阵从黎曼流形映射到线性空间,然后运用相关数学工具从协方差矩阵中提取描述子。

1 动作特征向量构建

本文详细讲解了HOG特征提取方法,并详细介绍了如何从HOG特征组成的矩阵计算协方差矩阵,并将其投影到向量空间,最终获得特征向量。

1.1 HOG特征

HOG与其他时空特征不同的是,它描述的出发点是基于局部细胞单元的,而不是图像整体。这样就要求在计算特征向量的开始阶段需要先将图像划分为一个个大小相同的细胞单元,然后通过计算细胞单元中每个像素点的梯度方向,并通过计算结果统计该细胞单元对应的梯度方向直方图。后来,为了提高特征描述子的性能,将块的概念加入到HOG特征的计算中,即图像中相邻的若干个细胞单元组成小块,块之间允许出现相同的细胞单元。将块的特征计算完成后,归一化此特征的计算结果,使得HOG特征对图像中的亮度变化和阴影等不敏感。以下是HOG特征的提取流程:

1) 灰度化,把原图片序列变为灰度圖片。

2) 采用Gamma校正(归一化)。

3) 计算每个像素的梯度(包括大小和方向):主要是为了捕获轮廓信息,同时进一步弱化光照的干扰。

4) 将图像划分成cell,本文采用8×8的cell,并且cell间不重叠。

5) 统计每个cell的梯度直方图(不同梯度的个数)。每个cell分成9个bin,代表9个不同的方向,也就是每[360°9=]40°分到一个方向,每个方向直方图大小按像素梯度幅值加权,最后归一化直方图,即可形成每个cell的描述子。

6) 将每2×2个cell组成一个block,块之间可以重叠,一个块内所有的cell的特征描述符串联起来得到该块的HOG特征描述符。

7) 将图片内所有的block的HOG特征描述符串联起来就可以得到该图片的HOG特征描述符,接下来就可用于计算协方差矩阵。

以弯腰动作中一幅图片为例,HOG特征计算流程图如图1所示。

1.2 基于协方差矩阵的特征向量构建

通过矩阵对数运算能够将协方差矩阵从黎曼流形映射到线性空间,以便于利用线性空间中的运算子。然后运用数学工具从协方差矩阵中提取描述子,再将描述子编码,就可以使用支持向量机进行分类。特征向量提取具体方法如下:

1) 将每一帧图像的HOG特征按照时间顺序并列在一起,构成一个较大的样本矩阵,再计算该样本矩阵的协方差矩阵。

2) 利用矩阵对数运算,将其投影到向量空间中。在向量空间中,协方差矩阵变成了对称矩阵,一般不再是正定的。对称矩阵所构成的空间实际上并不是一个常见的线性空间,而是一个光滑的黎曼流形,因为每个对称正定矩阵都是一个具有黎曼度量的张量。得到协方差矩阵后,接下来利用矩阵对数运算计算这些协方差矩阵的对数,如式(4)所示,先对协方差矩阵进行奇异值分解,得到它的两个酉阵[p1,p2],以及其奇异值组成的对角矩阵[λ]。[log Cov]是对称阵,但是一般不再是正定的。由此,相当于把正定矩阵[Cov]所在的空间投影到了向量空间,成了对称矩阵[log Cov]。

3) 将该对称矩阵的上三角按列优先的顺序,拉成一列向量,这个向量便是表征视频段的全局特征。考虑到对称矩阵大约一半的数据是重复的,在将其拉成一列向量时,只针对它的上三角区域。

特征向量构建流程图如图2所示。

最后将得出的向量分别用卡方核函数的支持向量机和交叉核函数的支持向量机进行训练分类。

2 支持向量机

为了准确地完成动作识别,需要对所选择的特征进行分类学习,本文选择支持向量机作为分类器。支持向量机是一种基于间距最大化的判别算法,把最大优化问题等价转化为凸二次规划求解问题。当训练数据集线性可分时,可以计算出一个距离最大的决策面将数据分开。支持向量机的最优化目标是决策面位于两类之间,并且到两类边界的距离相等且最大。由于从视频中提取出来的特征描述子长度太大,数据集通常不是线性的,也就无法利用线性支持向量机作为训练模型得到超平面。为了解决这个问题,就需要把低维中不能线性可分的数据,通过一定的映射方式,将其投影到高维空间,使之变得线性可分。而映射的方式则是通过核函数解决,本文采用的核函数为直方图交叉核函数和卡方核函数。原因是因为直方图交叉核函数更适用于直方图特征,全局特征也适用于卡方核函数。

3 实验结果及分析

3.1 数据库与实验过程

为了验证所提算法的性能,本文采用动作识别领域公开的三个数据库Weizmann,KTH和UCF Sports进行实验分析。Weizmann数据库中包含10个动作,每个动作中含有9个或者10个视频样本,如图3所示。第一排从左往右依次为wave2(双臂挥手)、bend(弯腰)、jack(跳跃)、run(跑步)和walk(走路);第二排为wave1(单臂挥手)、jump(向前跳跃)、pjump(向上跳跃)、side(侧身跑步)和skip(单脚跑)。

KTH数据库中包含6种动作,每种动作中含有100个视频样本,如图4所示。第一排从左往右依次为boxing(出拳)、handclapping(拍手)、handwaving(挥手);第二排依次为jogging(慢跑)、running(快跑)和walking(走路)。

UCF Sports Dataset数据库中包含13种动作,每个视频样本的数量从5~25个不等,如图5所示。第一排从左往右依次为diving(跳水)、Golf?swinging(挥杆)、kicking(踢球)、lifting(举重)和riding?horse(骑马);第二排从左往右为running(跑步)、skateboarding(滑板)、pommel horse(鞍马)、horizontal bar(单杠)和walking(走路)。

依据上述数据库,在实验过程中,首先将视频分解为帧图片,经过图片大小归一化后计算HOG特征。这样,每一帧图片就对应一个列向量,将同一类动作的HOG特征放在一起,并进行PCA(Principal Component Analysis)降维。然后计算其协方差矩阵,再对协方差矩阵进行对数运算。这样就得到了特征向量和训练样本。本文采用直方图交叉核函数和卡方核函数的支持向量机作为分类器。在实验中,对于同一类动作,随机选取70%的视频数据作为训练样本,30%的视频数据作为测试样本。

3.2 动作识别结果比较与分析

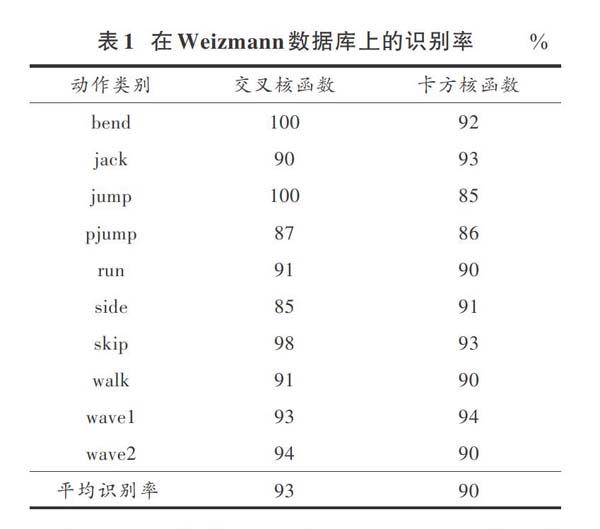

通过使用训练样本对支持向量机进行训练,考虑运用两种核函数:直方图交叉核函数和卡方核函数,以下是本文算法在三个数据库上的识别率及分析。

对Weizmann数据库中的90个视频进行实验所得的识别率如表1所示。从视频内容来看,Weizmann数据库的运动背景单一,同一背景并且摄像头固定。这都有利于有效地提取特征向量。从识别率来看,弯腰和向前跳的识别率较高,从视频内容来看,两类动作的差异比较大,即类内差异大,利于支持向量机进行分类。而跳跃与向上跳之间则比较容易出现混淆的部分,也就使得得出的识别率相对较低。

由表2可知,出拳、拍手与挥手,这两大类动作不难被区分,动作分类的错误率主要集中在慢跑与快跑之间,这两种动作具有一定的相似性,人体的躯干一直在移动,四肢也在做周期的摆动,并且它们的运动方向和摆动幅度变化都不大,进而提取出的HOG特征也具有很高的相似度。相对而言,支持向量机容易做出错误的判断,尤其是这两类动作的运动人体面对或背对镜头时所提取出的特征向量,因此这两类动作的识别率比其他动作略低。

UCF Sports数据库中一共有196段视频,每一段视频中只包含一个动作,每一种动作类别中包含的视频数目不等。虽然该数据库的视频有较高的分辨率,图像几乎没有噪声,但拍摄角度及运动人体的尺度变化大,各类动作执行速率差异显著。并且UCF Sports数据库的场景十分复杂,摄像头也不固定。由表3可看出,UCF Sports数据库下的识别率要比其他两个数据库低。该数据库的失误率主要集中在滑板、骑马和跑步三类动作上,类内之间的执行速率差异过大,加上他们的背景变化快,同时在计算协方差矩阵时,样本均值包含的信息减少。但是近几年来提取的算法与本文算法在UCF Sports数据库上的识别率相比,后者仍处于偏上的水平。

本文通过实验在三个数据库上分别实现了基于HOG特征协方差矩阵的动作识别算法,并分别同现有水平的其他动作识别方法进行比较,比较结果见表4。通过实验证实,本文所提出的动作识别方法对视频中的人体动作有较好的分类效果,在一定水平上优于其他动作识别算法。

4 结 论

基于视频的人体动作识别是计算机视觉研究中一个非常具有挑战性的研究领域,具有广阔的应用前景和研究价值。本文提出一种新的特征描述子,即基于HOG特征的协方差矩阵,该方法不仅涵盖了人体的轮廓信息,还充分发挥了协方差矩阵数据表征的优点。除此之外,本文还采用了两种和函数的支持向量机进行识别,最后进行对比发现,直方图交叉核函数更利于本文的动作识别。通过实验证明,本文算法在Weizmann,KTH和UCF Sports三个数据库上面取得了不错的识别率。

参考文献

[1] 胡琼,秦磊,黄庆明.基于视觉的人体动作识别综述[J].计算机学报,2013,36(12):2512?2524.

[2] 李瑞峰,王亮亮,王珂.人体动作行为识别研究综述[J].模式识别与人工智能,2014,27(1):35?48.

[3] 周风余,尹建芹,杨阳,等.基于时序深度置信网络的在线人体动作识别[J].自动化学报,2016,42(7):1030?1039.

[4] ALFARO A, MERY D, SOTO A. Action recognition in video using sparse coding and relative features [C]// 2016 IEEE Conference on Computer Vision and Pattern Recognition. Las Vegas, Nevada: IEEE, 2016: 2688?2697.

[5] WANG H, SCHMID C. Action recognition with improved trajectories [C]// 2013 IEEE International Conference on Computer Vision. [S.l.]: IEEE, 2013: 3551?3558.

[6] 宋健明,张桦,高赞,等.基于深度稠密时空兴趣点的人体动作描述算法[J].模式识别与人工智能,2015,28(10):939?945.

[7] 吴军,肖克聪.基于深度卷积神经网络的人体动作识别[J].华中科技大学学报(自然科学版),2016,44(z1):190?194.

[8] FEICHTENHOFER C, PINZ A, ZISSERMAN A. Convolutional two?stream network fusion for video action recognition [C]// 2016 IEEE Conference on Computer Vision and Pattern Recognition. Las Vegas, Nevada: IEEE, 2016: 1933?1941.

[9] JUNEJO I N, AGHBARI Z A. Using SAX representation for human action recognition [J]. Journal of visual communication and image representation, 2012, 23(6): 853?861.

[10] LIU J, KUIPERS B, SAVARESE S. Recognizing human actions by attributes [C]// 2011 IEEE Conference on Computer Vision and Pattern Recognition. Colorado Springs, Columbia: IEEE, 2011: 3337?3344.

[11] WU X, XU D, DUAN L. Action recognition using context and appearance distribution features [C]// 2011 IEEE Conference on Computer Vision and Pattern Recognition. Providence, Rhode Island: IEEE, 2011: 489?496.