低对比度条件下联合收割机导航线提取方法

2020-04-10曾宏伟雷军波陶建峰刘成良

曾宏伟,雷军波,陶建峰,张 伟,刘成良

低对比度条件下联合收割机导航线提取方法

曾宏伟,雷军波,陶建峰※,张 伟,刘成良

(上海交通大学机械系统与振动国家重点实验室,上海 200240)

针对强光照下成熟小麦已收割区域和未收割区域对比度低、收割边界获取难度大的问题,该文提出了一种基于区域生长算法的联合收割机导航线精确提取方法。对摄像头采集的作物收割图像,利用区域生长算法分割出图像中未收割区域。生长阈值通过对图像灰度直方图高斯多峰拟合进行自适应计算。对分割得到的二值图像进行形态学处理,获取作物已收割和未收割区域分界线,然后采用最小二乘法拟合收割机作业导航线。试验结果表明:在小麦已收割和未收割区域对比度很低的情况下,所提方法能够精确地提取出小麦收获边线,并得到收割机作业导航线,与人工标定导航线夹角平均误差小于1.21°,可以为联合收割机的自动导航研究提供参考;处理一张900×1 200像素的图像时长约0.41 s,基本满足联合收割机导航作业的实时性要求。与传统方法对比发现,该文方法不易受作物生长密度和麦茬的干扰,导航线的提取精度更高,单幅图像的处理时间略有增加,但基本满足实时性作业要求。

机械化;机器视觉;导航;联合收割机;区域生长算法;多峰高斯拟合;最小二乘法

0 引 言

自动导航作为智能农业装备的关键技术之一,广泛应用于播种、除草、施肥和收获等作业中[1-2]。在农作物收获过程中,为避免重割和漏割,驾驶员需根据作物收获边界对收割机前进方向及时调整,以保证收割机满幅工作。这要求驾驶员具有较高的操作技能和熟练度。此外,观察割台两侧作物收割边界会分散驾驶员的注意力,且长时间作业容易疲劳,给农业生产带来安全隐患。因此,研究联合收割机自动导航技术对减轻驾驶员劳动强度、提高生产效率具有重要意义。

自动导航的核心是提取作业导航线,如何快速准确地获取导航线是实现联合收割机自动导航的关键[3]。近年来,国内外关于农机作业导航线检测的研究主要分为机器视觉[4-6]和激光测距[7-9]导航2大类。由于通过视觉图像获取的环境信息更丰富、范围更广、目标信息更完整,基于机器视觉的导航方法受到国内外学者的广泛关注[10]。

对于绿色作物,由于作物和土壤颜色存在较大差异,采用超绿变换能够有效区分作物和土壤,常在早期管理作业中用于作物行线检测[11-12]。然而,在收割过程中,成熟作物与土壤颜色对比度较低,超绿法难以适用。针对收割作业导航线提取, Iida等[13]将水稻收割图像灰度值按列累加,定义累加曲线最大梯度处为水稻收割边缘分界点;Cho等[14]对水稻收割图像进行逆透视投影变换,再利用边缘检测算法获取水稻收割边界;梁习卉子等[15]通过对颜色分量分析,提出了玉米收割机导航路径和田端检测算法;李景彬等[16]提出了一种采棉机视觉导航路线检测方法,利用颜色分量差提取棉花已收获区和未收获区边界点;丁幼春等[17]通过旋转投影算法处理小麦收割图像再提取小麦收割边界;吴刚等[18]利用统计分析和边缘检测分析小麦收割图像获取导航线候选点,并改进了Hough变换来计算导航线;张成涛等[19]采用图像纹理特征区分小麦未收获和已收获区域,进而提取收获边界;赵腾等[20]利用阈值法分割已收获与待收获区域,再采用互相关函数法检测小麦收割分界点。

上述方法大多基于作物收割图像灰度不连续特性,只有当分界线相对周围环境有较大差异或已收割和未收割区域对比度较大时才能取得较理想的效果。此外,收割后的残留麦茬和未收割的小麦颜色基本一致,容易对收割边界线提取产生干扰。当分界处不存在阴影及光照较强时,小麦已收割区域和未收割区域对比度很低,此类方法难以精确提取小麦收割分界线。

针对现有方法存在的问题,本文提出了一种基于区域生长算法的收割机导航线快速精确提取方法。采用区域生长算法精确地分割出小麦图像中未收割区域,生长阈值根据图像直方图自适应计算,检测出小麦收割边界,通过最小二乘法对边界进行拟合,最终得到收割机导航线。

1 收割机导航线提取方法

在联合收割机作业过程中,要求收割机满幅工作,且不发生漏割和重割。因此,快速而准确地识别作物已收割和未收割区域边界是实现收割机自动导航的关键步骤。通过对大量的小麦收割现场图像分析发现,已收割和未收割区域具有颜色差异小、对比度低的特点,但未收割区域图像纹理更加平滑,像素值具有良好的均匀性和相似性,已收割区域由于存在残留的麦茬,像素值空间分布不均。区域生长算法[21]是一种常用的图像分割算法,通过比较种子与周围像素的相似性来决定是否合并种子,能够有效地将具有相似像素的连通区域分割出来,在医学[22-23]、农业[24]以及遥感图像处理[25]等领域得到了广泛应用。

因此,本文提出了一种基于区域生长算法的联合收割机导航线快速精确提取方法,具体流程如图1所示。

图1 收割机导航线提取流程

首先,通过安装在联合收割机上的摄像头获取小麦收割图像,对获取的图像进行预处理。采用区域生长算法分割出图像中未收割小麦区域,并对分割后的二值图进行形态学运算,以消除因噪声造成的空洞,平滑小麦收割边界,然后检测作物已收割和未收割区域分界线,最后采用最小二乘法拟合出收割机作业导航线。

1.1 图像预处理

本文采用海康威视生产的MV-CA013-20UC型号彩色相机获取小麦收割图像,分辨率为1 024×1 280像素。由于土壤和成熟小麦均呈黄色,麦田已收割区域和未收割区域颜色十分相近。图2a为摄像头采集的原始彩色图像,图2b为图2a中实线所在像素行的RGB分量值。由图2可知,已收割和未收割区域的RGB分量值差距均很小,即使转换到不同颜色空间,已收割区域和未收割区域对比度仍很低,难以通过颜色特征区分已收割和未收割区域。

在RGB分量均相近的情况下,颜色信息显得冗余。为减少数据量,将彩色图像转换成灰度图像,以提高后续算法处理速度,保证算法的实时性。彩色图像转换成灰度图的公式为[26]

式中为转换后的灰度值,、和分别表示RGB通道中红、绿、蓝分量值。将彩色图像灰度化后,采用5×5的高斯核对灰度图像进行高斯滤波,消除图像中的随机噪声。图3为原始图像经灰度化及高斯滤波后的图像。

图2 原始图像及RGB分量曲线

图3 预处理后的灰度图像

1.2 基于区域生长算法的图像分割

为检测小麦收割边界,先将图像分割成已收割和未收割区域。灰度图像分割算法通常基于灰度值的不连续性或相似性。前者是指以灰度突变为基础进行分割,如图像的边缘。后者是利用一定的相似准则将图像分割为相似的区域,常用的有阈值分割法、区域生长以及区域分裂算法等[26]。

观察小麦收割灰度图发现,已收割和未收割区域灰度值差异较小,但未收割区域图像灰度值更加均匀一致,而已收割区域图像中存在麦茬和裸露的土壤,纹理复杂度高。由于已收割和未收割区域灰度值无明显突变,利用灰度值不连续性分割图像难以达到理想效果。最常用的基于灰度相似性的图像分割方法为阈值法,当图像直方图存在分离的波峰时有较好的分割效果,但小麦收割图像直方图往往无法满足该条件。此外,由于已收割区域中的麦茬与未收割小麦灰度值几乎相等,阈值法分割往往将两者归为一类,麦茬与土壤的分界线会对后续收割边界提取产生严重干扰。区域生长算法则弥补了阈值分割法未考虑像素空间连通性的不足,利用相邻像素的相似性将像素或子区域组合成更大的区域,最终得到一个相似度高的连通区域。因此,区域生长算法更适合于小麦收割图像分割。

1.2.1 区域生长算法

区域生长是一种从单个像素开始逐渐向周围邻域生长的算法,选择初始种子后,逐个访问种子的邻域像素,若邻域像素与种子足够相似,则将其添加到种子区域,更新种子区域后继续向新的邻域生长,直至无新的像素可添加,则从该初始种子开始的区域生长结束。接着从另一个种子点开始生长新的区域,直至将整个图像分割成不同的区域。

区域生长需解决2个关键问题:种子点的选取以及生长准则[27]。在本文中,为保证分割效果,种子的选择需满足以下要求:

1)种子点应从未收割区域中选取,因为未收割小麦区域具有较高的相似性,适合区域生长;

2)种子点与周围像素高度相似,即灰度值相近;

3)种子点能较好地代表未收割区域,应从小麦像素区域选取,避免从阴影区域选择。

在传统区域生长算法中,种子点通常以人机交互的方法进行选取。然而,在实际收割过程中,人机交互的方式无法满足应用要求,算法应能够逐帧自动选取种子点。在实际收获过程中,收割机最常用的行进路线为右旋法和四边收获法,以顺时针方向围绕麦田进行收割[28]。因此,待检测的收割边界位于联合收割机左前方,未收割区域则靠图像的右侧。为保证种子点来自小麦未收割区域,先初步确定未收割区域大致位置。对灰度图每一列前行的灰度值累加,绘制出在每列前行中灰度值之和的变化曲线,最低点所在列数可以初步定为远端小麦收割边界点在图像坐标系中的横坐标值。根据摄像头采集的图像分辨率进行取值,当累加曲线出现明显波谷时较合适,本文中取20。由于存在透视现象,在图像坐标系中远端小麦收割边界点以右的像素区域均为未收割小麦区域。将该区域设为初始种子点的选择区域,并对其灰度值分布情况进行统计。出现频率最高的像素值往往最能代表本区域图像的整体信息,因此将该区域内出现频率最高的像素值对应的所有像素点标示为初始种子点集,从而实现种子点的自动选取。

生长规则包括相似性判断准则及生长结束条件。对于灰度图,通常根据待生长像素灰度值与种子区域平均灰度值之差是否小于设定阈值来判断是否相似[27]。设(,) 为输入灰度图阵列;(,) 表示种子阵列,其尺寸与相同,种子点位置处表示为1,其他位置处为0;堆栈用于存放待访问邻域像素点;G表示种子区域平均灰度值;为生长阈值。对于像素点(x,y)∈,其生长规则可表示为

小麦未收割区域分割算法流程为:

1)根据上述种子点自动选取方法选择初始种子点集,并将其压入堆栈;

2)判断堆栈是否有元素,若有则退栈取出栈顶元素(x,y),若为空则生长结束;

3)逐个访问(x,y)的4邻域像素点,对尚未被标记为种子的像素点按式(2)原则判断是否与种子相似,若相似则将该邻域像素点压入堆栈,同时更改种子阵列对应位置的值,更新G。若不相似则访问下一邻域像素。访问结束后返回步骤2)。

生长结束后,种子阵列中元素为1的区域即为生长得到的区域。

1.2.2 生长阈值自适应选取

在上述算法中,通过比较邻域像素灰度值与种子区域平均灰度值来判断该邻域像素是否与种子区域相似。生长的条件是两者灰度值之差小于某一阈值。该阈值决定了分割准确度,若阈值过大,则易产生欠分割,将不属于未收割区域的像素划分为未收割区域;若阈值过小,则会产生过分割,最终生成的区域无法完整地包含未收割区域。

该阈值的选择是区域生长算法的难点,目前尚未有普适的可行方法,通常根据经验选取[26]。固定的阈值只适用于相同的场景图像中,在小麦收割过程中,光照变化、场景变换均会影响该阈值的选择。因此,为提高算法鲁棒性,使其适应不同光照条件和场景,生长阈值应根据图像自适应选取。

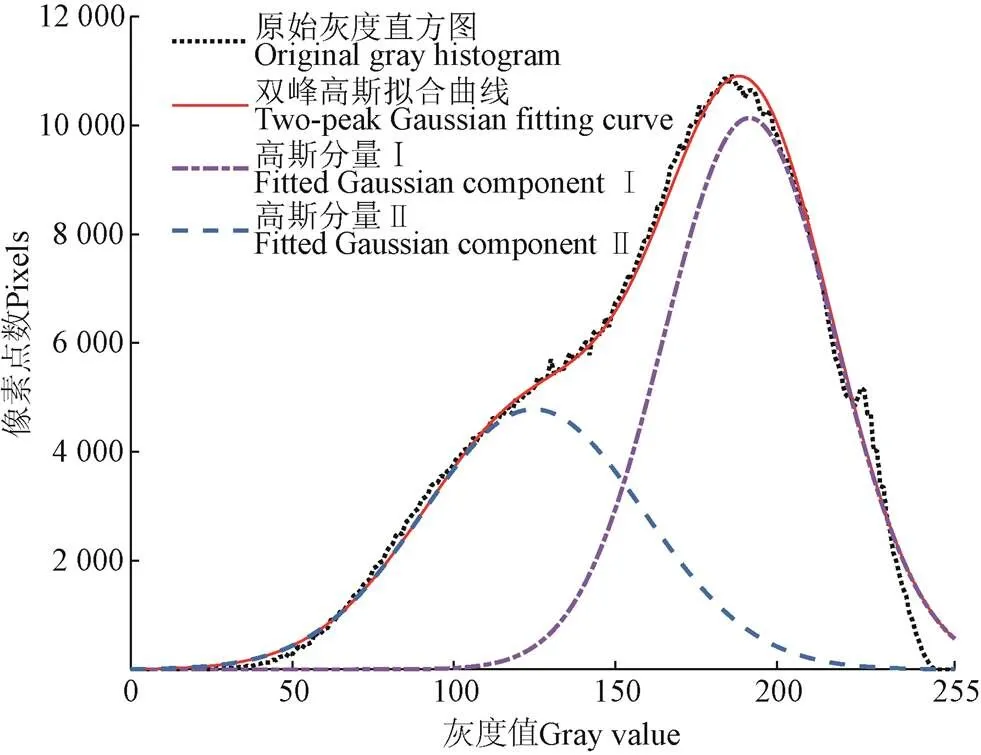

图像灰度直方图统计了整个图像中各灰度值的像素个数,体现了图像中灰度值分布信息。图4为图3对应的灰度直方图,从图中可以发现,峰值出现在灰度值180附近,说明图像中该灰度值的像素点最多。结合图像可知,小麦在图像中占据的像素点最多,灰度值180附近对应小麦的灰度值,而在灰度值120附近存在另一峰值,该灰度值附近的像素对应为土壤。

图4 图像灰度直方图

由于小麦和土壤灰度值十分接近,分布存在重合,直方图中并未出现明显的峰底。现假设小麦和土壤不同灰度值占据的像素数量均呈高斯分布,对灰度直方图进行双峰高斯拟合。令()表示拟合的函数,则其形式为

式中为灰度值;a表示高斯分量系数;b为高斯分量分布中心;c为高斯分量分布方差(=1,2);为图像中像素点总数。令()表示图像中灰度值为的像素个数。采用非线性最小二乘法对灰度直方图进行高斯双峰拟合,使得拟合数据与实际数据之间误差的平方和最小,则优化目标为

目标函数中有5个未知数,对于非线性最小二乘问题,可以采用信赖域方法进行数值求解。本文直接使用MATLAB拟合工具箱中fit函数进行计算求解。拟合得到高斯模型后,生长阈值取2个高斯分量均值之差的一半,即

采用式(3)中函数对图4所示直方图进行拟合,结果如图5所示。可以看出,高斯双峰曲线对灰度直方图拟合较好,其拟合优度指标判定系数为0.994 4。

图5 直方图拟合结果

根据上述拟合结果按式(5)计算阈值,然后采用1.2.1节算法对小麦收割图像进行分割,分割结果如图6所示。图6a为分割后的二值图,其中白色区域为通过区域生长分割出的未收割区域,黑色区域为背景。为更好地观察分割效果,将生长的区域通过掩膜叠加于原图,如图6b所示。可以看出,在小麦已收割和未收割边界处分割效果很好,但在未收割区域内部存在未生长的孤立区域,这从图6a中也可以发现。这些孤立区域主要是小麦植株间隙造成的阴影,其灰度值与小麦差异较大而未能被生长。

为填充未收割区域内细小孔洞,对二值图进行3次膨胀操作,然后进行3次腐蚀操作恢复原始尺寸。图7为形态学处理后的二值图像,处理后的未收割区域消除了大部分噪点和细小孔洞,并较完整地保留了分割边界。

图6 区域生长结果

图7 形态学处理后的二值图

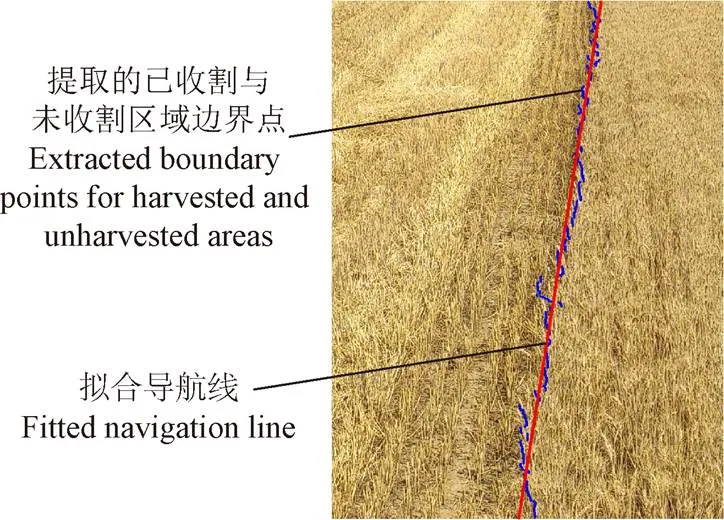

1.3 收割机导航线提取

为提取收割导航线,需要提取小麦收割的边界。直接采用边缘检测方法会引入未收割区域中噪点和孤立区域的边界,为后续导航线提取带来干扰。观察图7可知,左侧背景区域无噪点和孔洞,左侧黑色背景区域与右侧白色前景区域的交界线即为小麦已收割和未收割区域的分界线。对二值图逐行从左向右扫描,记录每行第一个像素值跳变点为小麦收割边界点。对获得的边界点进行最小二乘法直线拟合,即可得到小麦收割的导航线。图8为边界点检测及导航线拟合结果。从图中可以看出,在对比度很低的情况下,本文方法得到的导航线与小麦的收割边界基本重合,具有较高的准确度,边界点拟合优度为0.973 2。

图8 导航线提取结果

2 验证试验

为验证所提方法的有效性,在小麦收获现场采集用于试验验证的小麦收割图像。使用彩色工业相机进行图像采集,型号为海康威视MV-CA013-20UC,分辨率为1 024×1 280像素,以RGB颜色空间保存为JPG格式。裁切后的图像大小为900×1 200像素,图像处理在计算机平台上完成,处理器为Intel Core i7-6700,主频3.4 GHz,内存大小为8 G,图像处理软件为MATLAB 2018b。

图像采集地点为北京市昌平区国家精准农业示范基地,联合收割机型号为雷沃重工股份有限公司的GK120试验样机,收割行进路线为右旋法,待检测收割边界位于联合收割机左侧。因此,将摄像头安装在驾驶舱顶部偏左侧位置,相机光轴与水平线夹角约30°,离地高度约3 m,此时未收割区域始终位于采集的图像右侧。小麦品种为农大211,收割时作物自然高度为84 cm,割茬高度为8.5 cm。麦田无积水,土壤较干燥,在阳光下土壤颜色呈浅黄色,与小麦颜色相近。小麦收割后产生的秸秆经粉碎后从联合收割机尾部排放,由于割台宽于机身,从机身两侧到割台两端的区域内并无秸秆排放,因此麦田中和未收割区域相邻的已收割区域地表秸秆量较少,摄像头视野中从左至右依次为秸秆覆盖的地表、麦茬和裸露地表以及未收割小麦区。

光照是影响视觉导航精度的重要因素,联合收割机在田间作业时,所受自然光照是不可控的。因此,基于视觉的导航线提取方法应能适应不同的光照条件。为验证所提方法在不同作业环境下的适用性,采集了不同光照强度下的小麦收割图像,以及在麦田田垄边界处的图像,利用本文方法进行了导航线提取,并与人工标定的导航线进行比较,将算法提取的导航线与人工标定的导航线之间的夹角作为精度评价指标。图9a为不同条件下采集的原始图像,图9b为对应的未收割小麦区域分割结果,图9c则为导航线提取结果,其中红色实线为本文方法获得的结果,天蓝色实线为通过人工标定的导航线。图9中从左至右依次为:较弱光照下小麦收割边界图像、较强光照下小麦收割边界图像、麦田田垄边界图像;分别拍摄于2019年6月18日中午12点,多云;2019年6月22日中午12点,晴;2019年6月22日13点,晴。拍摄时间段均为中午,此时阳光直射地面,小麦已收割和未收割交界处无明显阴影,收割分界线相对周围环境不明显,导航线提取难度更大。

第一幅图像拍摄于阴天,光照强度较晴天弱,图像总体偏暗,亮度相对较低。由于小麦生长较稀疏,未收割区域存在作物行间隙,图像分割过程中未收割区域产生较多孤立小区域,但在收割边界处分割效果较好,较准确和完整地保留了边界信息。从图9c导航线检测结果来看,本文方法具有较高的精度,提取的导航线与人工标定的基准导航线基本一致,角度误差约为1.18°。由此可见,在植株生长较稀疏的情况下,所提方法仍能取得较好的效果。第二幅图像拍摄于晴天光照最强的时候,亮度较高,小麦和土壤的颜色更加难以区分。从图 9b中图像分割的结果可以看出,区域生长算法较准确地分割出了小麦未收割区域。从图9c来看,导航线提取结果与人工标定的基准线基本重合,检测误差约为 0.78°。第三幅图像为田垄边界处图像,由于田垄上长有绿色杂草,与周围小麦和土壤对比明显,小麦和田垄的边界线较清晰。相比前2幅图像,此处小麦生长更加密集,未收割区域像素更加均一,分割得到的未收割小麦区域噪点较少。图9c检测结果表明,提取的导航线和人工标定的结果基本吻合,误差约为1.21°。

注:图中红色实线为通过本文方法提取的导航线;蓝色实线为手工标定的导航线。

Note: The red solid line in the figure is the navigation line extracted by the method in this paper; the blue solid line is manually calibrated navigation line.

c. 导航线提取结果

c. Navigation line extraction results

图9 不同场景下收割机导航线提取结果

Fig.9 Extraction results of harvester navigation line under different scenes

综上可知,在不同光照、不同作物生长密度条件下,以及在分界线较明显(如小麦和绿色杂草分界线)的情况下,本文方法均能精确地分割出未收割小麦区域,并较完整地保留小麦收割边界信息。同时,本文方法获取的导航线与人工标定的导航线基本一致,平均夹角误差在1.21°以内。由此可见,本文算法能够精确地检测小麦收割边界并提取导航线,且对不同的作业场景具有较好的适应性。

在时效性方面,由于区域生长过程通过逐个访问种子邻域像素完成,因此图像分割过程在本方法中耗时占比最大。算法耗时长短和最终生成的区域面积大小有关,未收割区域像素点数量越多耗时越长。对于一张大小为900×1 200像素的小麦收割图像,本文方法平均耗时约为0.4 s。考虑到联合收割机正常作业速度在1.5 m/s左右,而相机前视距离约为8 m,因此0.4 s的处理时长基本能够满足联合收割机作业的实时作业要求。

传统的作物收割边界检测方法中,最常用的是将灰度值或者不同颜色通道下像素值按列累加,根据累加曲线寻找已收割和未收割区域边界点,然后通过边界点提取导航线[13,15-16]。对采集的图像每10行划分为一个处理区域,在该区域内将每一列的灰度值进行累加得到灰度值累加曲线,寻找曲线的最大梯度处作为边界点,然后通过最小二乘法获得导航线。以图3中的小麦收割图像为例,采用传统方法对小麦已收割和未收割区域边界点进行检测,检测结果如图10所示。从图中可以看出,当已收割和未收割区域对比度较低时,传统方法在检测已收割和未收割区域边界点时易受到残留麦茬以及生长稀疏作物区域的干扰。

图10 传统方法收割边界点提取结果

由于传统方法是通过沿水平方向寻找像素值累加曲线的阶跃值所在位置作为边界点,在单个处理区域内水平方向像素值出现跳变的位置都有可能被识别为边界点。因此,当已收割和未收割区域对比度低、收割边界不明显时,该方法容易将因作物生长稀疏以及残留麦茬造成的阴影区域错误地识别为边界点,影响后续导航线提取的精度。本文采用区域生长算法进行图像分割,利用相邻像素的相似性将像素或子区域组合成更大的区域,保证了分割区域的连通性。当作物生长稀疏时,阴影区域只会造成分割的未收割区域内存在孤立的区域,如图6a中所示,但未收割区域内部的孤立区域并不影响后续已收割和未收割区域边界点以及导航线的提取。此外,在进行图像分割时,区域生长算法在遇到已收割和未收割区域边界时即停止生长,能够较好地保留收割边界信息,而不易受到残留麦茬的干扰。

为对比本文方法与传统收割机导航线检测方法,随机选取20幅不同的小麦收割图像,分别采用本文方法和传统方法进行导航线提取,并将检测结果分别与人工标定的导航线进行比较,将两者的夹角以及最大像素误差作为评价指标,同时统计了单张图像的处理时间,试验结果如表1所示。

表1 本文方法与传统导航线检测方法的性能对比

由表1可知,本文方法在导航线检测精度上更具优势,平均角度误差以及平均最大像素误差均小于传统方法,且在不同的作物生长密度下均表现出较好的效果。而传统方法在作物生长较稀疏的情况下,导航线检测精度明显下降,误差远超过本文所提方法。在时效性方面,由于区域生长算法耗时较长,本文方法计算时间略微增加,平均处理一帧图片的时间约为0.41 s。考虑到联合收割机正常作业速度在1.5 m/s左右,而相机前视距离约为8 m,因此约0.41 s的处理时长基本满足联合收割机作业的实时作业要求。

3 结 论

为解决强光照条件下成熟小麦已收割与未收割区域对比度低、收割边界模糊以及导航线提取难度大的难题,本文提出了一种基于区域生长算法的联合收割机导航线提取方法。试验结果表明,在小麦已收割和未收割区域对比度很低的条件下,所提方法能够精确地检测出小麦收割分界线,并提取出收割机作业导航线。在不同光照强度、不同作物生长密度等不同的作业场景下,本文方法均能准确分割出小麦已收割和未收割区域,提取的导航线与人工标定的导航线平均角度误差小于1.21°,能够为联合收割机自动导航提供参考。在时效性方面,处理一张900×1 200像素的图像耗时约0.41 s,基本满足联合收割机正常作业速度下的实时性要求。

[1]姬长英,周俊. 农业机械导航技术发展分析[J]. 农业机械学报,2014,45(9):44-54. Ji Changying, Zhou Jun. Current situation of navigation technologies for agricultural machinery[J]. Transactions of the Chinese Society for Agricultural Machinery, 2014, 45(9): 44-54. (in Chinesewith English abstract)

[2]胡静涛,高雷,白晓平,等. 农业机械自动化导航技术研究进展[J]. 农业工程学报,2015,31(10):1-10. Hu Jingtao, Gao Lei, Bai Xiaoping, et al. Review of research on automatic guidance of agricultural vehicles[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE),2015, 31(10): 1-10. (in Chinesewith English abstract)

[3]Shalal N, Low T, Mccarthy C, et al. A review of autonomous navigation systems in agricultural environments[C]// Engineers Australia, 2013.

[4]蔡道清,李彦明,覃程锦,等. 水田田埂边界支持向量机检测方法[J]. 农业机械学报,2019,50(6):22-27,109. Cai Daoqing, Li Yanming, Qin Chengjin, et al. Research and experiment on boundary detection of paddy fields based on support vector machine[J]. Transactions of the Chinese Society for Agricultural Machinery, 2019, 50(6): 22-27, 109. (in Chinesewith English abstract)

[5]孟庆宽,何洁,仇瑞承,等. 基于机器视觉的自然环境下作物行识别与导航线提取[J]. 光学学报,2014,34(7):180-186. Meng Qingkuan, He Jie, Qiu Ruicheng, et al. Crop recognition and navigation line detection in natural environment based on machine vision[J]. Acta Optica Sinica, 2014, 34(7): 180-186. (in Chinesewith English abstract)

[6]Meng Q, Qiu R, He J, et al. Development of agricultural implement system based on machine vision and fuzzy control[J]. Computers and Electronics in Agriculture, 2015, 112: 128-138.

[7]伟利国,张小超,汪凤珠,等. 联合收割机稻麦收获边界激光在线识别系统设计与试验[J]. 农业工程学报,2017,33(增刊1):30-35. Wei Liguo, Zhang Xiaochao, Wang Fengzhu, et al. Design and experiment of harvest boundaryonline recognition system for rice and wheat combine harvester based on laser detection[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2017, 33(Supp. 1): 30-35. (in Chinese with English abstract)

[8]赵腾. 基于激光扫描的联合收割机自动导航方法研究[D]. 杨凌:西北农林科技大学,2017. Zhao Teng. Development of Automatic Navigation Method for Combine Harvester Based on Laser Scanner[D]. Yangling: Northwest A&F University, 2017. (in Chinese with English abstract)

[9]Choi J, Yin X, Yang L, et al. Development of a laser scanner-based navigation system for a combine harvester[J]. Engineering in Agriculture, Environment and Food, 2014, 7(1): 7-13.

[10]Bonadies S, Gadsden S A. An overview of autonomous crop row navigation strategies for unmanned ground vehicles[J]. Engineering in Agriculture, Environment and Food, 2019, 12(1): 24-31.

[11]Zhang X, Li X, Zhang B, et al. Automated robust crop-row detection in maize fields based on position clustering algorithm and shortest path method[J]. Computers and Electronics in Agriculture, 2018, 154: 165-175.

[12]姜国权,杨小亚,王志衡,等. 基于图像特征点粒子群聚类算法的麦田作物行检测[J]. 农业工程学报,2017,33(11):165-170. Jiang Guoquan, Yang Xiaoya, Wang Zhiheng, et al. Crop rows detection based on image characteristic point and particleswarm optimization-clustering algorithm[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2017, 33(11): 165-170. (in Chinese with English abstract)

[13]Iida M, Yu I, Suguri M, et al. Cut-edge and stubble detection for auto-steering system of combine harvester using machine vision[J]. Ifac Proceedings Volumes, 2010, 43(26): 145-150.

[14]Cho W, Iida M, Suguri M, et al. Vision-based uncut crop edge detection for automated guidance of head-feeding combine[J]. Engineering in Agriculture, Environment and Food, 2014, 7(2): 97-102.

[15]梁习卉子,陈兵旗,姜秋慧,等. 基于图像处理的玉米收割机导航路线检测方法[J]. 农业工程学报,2016,32(22):43-49. Liangxi Huizi, Chen Bingqi, Jiang Qiuhui, et al. Detection method of navigation route of corn harvester based on image processing[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2016, 32(22): 43-49. (in Chinese with English abstract)

[16]李景彬,陈兵旗,刘阳,等. 采棉机视觉导航路线图像检测方法[J]. 农业工程学报,2013,29(11):11-19. Li Jingbin, Chen Bingqi, Liu Yang, et al. Detection for navigation route for cotton harvester based on machine vision[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2013, 29(11): 11-19. (in Chinese with English abstract)

[17]丁幼春,王书茂,陈度. 基于图像旋转投影的导航路径检测算法[J]. 农业机械学报,2009,40(8):155-160. Ding Youchun, Wang Shumao, Chen Du. Navigation line detection arithmetic based on image rotation and projection[J]. Transactions of the Chinese Society for Agricultural Machinery, 2009, 40(8): 155-160. (in Chinese with English abstract)

[18]吴刚,谭彧,郑永军,等. 基于改进Hough变换的收获机器人行走目标直线检测[J]. 农业机械学报,2010,41(2):176-179. Wu Gang, Tan Yu, Zheng Yongjun, et al. Walking goal line detection based on improved hough transform on harvesting robot[J]. Transactions of the Chinese Society for Agricultural Machinery, 2010, 41(2): 176-179. (in Chinese with English abstract)

[19]张成涛,谭彧,吴刚,等. 基于达芬奇平台的联合收获机视觉导航系统路径识别[J]. 农业机械学报,2012,43(S1):271-276. Zhang Chengtao, Tan Yu, Wu Gang, et al. Visual Navigation system path recognition algorithm based on DaVinci platform for combine harvester[J]. Transactions of the Chinese Society for Agricultural Machinery, 2012, 43(Supp. 1): 271-276. (in Chinese with English abstract)

[20]赵腾,野口伸,杨亮亮,等. 基于视觉识别的小麦收获作业线快速获取方法[J]. 农业机械学报,2016,47(11):37-42. Zhao Teng, Noboru Noguchi, Yang Liangliang, et al. Fast edge detection method for wheat field based on visual recognition[J]. Transactions of the Chinese Society for Agricultural Machinery, 2016, 47(11): 37-42. (in Chinese with English abstract)

[21]Adams R, Bischof L. Seeded region growing[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 1994, 16(6): 641-647.

[22]程明,黄晓阳,黄绍辉,等. 定向区域生长算法及其在血管分割中的应用[J]. 中国图象图形学报,2011,16(1):44-49. Cheng Ming, Huang Xiaoyang, Huang Shaohui, et al. Directional region growing algorithm and its applications in vessel segmentation[J]. Journal of Image and Graphics, 2011, 16(1): 44-49. (in Chinese with English abstract)

[23]Gambino O, Vitabile S, Re G L, et al. Automatic volumetric liver segmentation using texture based region growing[C]// 2010 International Conference on Complex, Intelligent and Software Intensive Systems. IEEE, 2010.

[24]Pang J, Bai Z Y, Lai J C, et al. Automatic segmentation of crop leaf spot disease images by integrating local threshold and seeded region growing[C]// International Conference on Image Analysis & Signal Processing. 2011.

[25]闫东阳,明冬萍. 基于自动多种子区域生长的遥感影像面向对象分割方法[J]. 工程科学学报,2017,39(11):1735-1742. Yan Dongyang, Ming Dongping. Object-oriented remote sensing image segmentation based on automatic multispeed region growing algorithm[J]. Chinese Journal of Engineering, 2017, 39(11): 1735-1742. (in Chinese with English abstract)

[26]John C. Russ. 数字图像处理(第六版)[M]. 余翔宇等译. 北京:电子工业出版社,2014.

[27]Preetha M M S J, Suresh L P, Bosco M J. Image segmentation using seeded region growing[C]// International Conference on Computing. IEEE, 2012.

[28]倪长安,李心平,王显仁. 谷物收获机械有问必答[M]. 北京:电子工业出版社,2008.

Navigation line extraction method for combine harvester under low contrast conditions

Zeng Hongwei, Lei Junbo, Tao Jianfeng※, Zhang Wei, Liu Chengliang

(,,200240,)

In grain harvesting , the combine harvester’s header need to guide along the harvest boundary in time to ensure the harvester is working in full widt, which requires the operator has high operational skills. In addition, with the long-time operation the driver is prone to fatigue, which brings safety hazards to agricultural production. Therefore, it is of great significance to study the automatic navigation technology of combine harvester to reduce the labor intensity of drivers and improve production efficiency. The key of automatic navigation is the extraction of navigation line. Due to richer environmental information, wider detection range and more complete information, visual-based navigation methods have attracted extensive attention. However, the contrast between cut and uncut areas of mature wheat in the image is extremely low under strong illumination, which leads that the harvest boundary of crop is quite blurred. To solve the problem that the cut edge is difficult to extract under low contrast conditions, a fast and accurate navigation line extraction method of combine harvester based on region growing algorithm is presented in this paper. Firstly, the color images of harvesting scene collected by camera was converted into the gray scale image, and the Gaussian filtering was applied to remove the image noise. Then, the region growing algorithm was used to segment the image. Initial seed was selected based on some criteria and then the uncut wheat area was segmented by region growing process. The gray value of each 4-neighboring pixel was compared with the mean gray value of the seed region, if their difference was smaller than the threshold the corresponding pixel was added to the seed region. This procedure was repeated until no pixel could be grouped in the region. To improve the robustness of the region growing algorithm, an adaptive threshold selection method based on gray histogram was proposed. The multi-peak Gaussian fitting of the gray histogram was performed and half of the absolute value of the difference between mean values of the two Gaussian components was taken as the threshold of region growing, then the segmented binary image was processed by the morphological operations to fill the small holes in the segmented region which made the harvest boundary of wheat smoother. Finally, the harvest boundary of crop was detected and the harvester navigation line was acquired by fitting the harvest boundary with the least squares method. The experimental results showed that even though the contrast of cut and uncut wheat areas was extremely low, the proposed method could accurately detect the wheat harvest boundary and extract the harvester navigation line. Under different operating conditions such as different light intensity and different crop growth density, the average angle error between the navigation line extracted by the proposed method and the manually calibrated navigation line was less than 1.21 °, processing a 900×1 200 pixels image took about 0.41 s, which basically meets the real-time requirements of the combine harvester navigation. The results can provide a reference for the automatic navigation of the combine harvester.

mechanization; machine vision; navigation; combine harvester;region growing algorithm; multi-peak Gaussian fitting; least squares

曾宏伟,雷军波,陶建峰,张 伟,刘成良. 低对比度条件下联合收割机导航线提取方法[J]. 农业工程学报,2020,36(4):18-25. doi:10.11975/j.issn.1002-6819.2020.04.003 http://www.tcsae.org

Zeng Hongwei, Lei Junbo, Tao Jianfeng, Zhang Wei, Liu Chengliang. Navigation line extraction method for combine harvester under low contrast conditions[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2020, 36(4): 18-25. (in Chinese with English abstract) doi:10.11975/j.issn.1002-6819.2020.04.003 http://www.tcsae.org

2019-09-19

2019-11-01

国家重点研发计划(2016YFD0700105,2016YFD0702001);新进教师启动计划项目(18X100040003)。

曾宏伟,博士生,研究方向:智能化农机装备。Email:zenghw@sjtu.edu.cn

陶建峰,副教授,博士生导师,博士,主要从事智能液压传动与控制技术研究。Email:jftao@sjtu.edu.cn

10.11975/j.issn.1002-6819.2020.04.003

S225.3;TP29

A

1002-6819(2020)-04-0018-08