基于无人机双目图像的线目标测量的研究

2020-02-27王祖武魏文力

王祖武,丁 健,魏文力,韩 军

(1.上海大学 通信与信息工程学院,上海 200444;2.上海先进通信与数据科学研究院,上海 200444;3.国网浙江省电力公司 检修分公司,杭州 310007)

0 引言

近年,国家的公共设施(例如电力线、电力线杆塔、雕像等)的完善极大方便了人们的生产生活。公共设施需要定期的检测维护以确保证公共设施安全运行,其中输电线路覆冰是影响电力系统安全运行的重要威胁,是国内外电力系统最为严重的自然灾害之一。为保障电力通畅,需要对输电线的宽度进行监控测量,并根据监控数据做出相应的应对措施。因此,研究对线目标的测量在实际应用中具有重要的意义。

当前,目标测量分为主动式测量和被动式测量两种。Golinelli等[1-2]提出了一种基于红外激光的便携式测量系统,采用激光测距原理测量对线目标进行测量,马[3]提出一种使用超声波的目标测量方式,但超声波测量方式一般用于测量参考点到目标之间的距离。主动测量方式下,使用外部向被测对象施加的能量对目标进行测量,虽然准确度比较高,但成本很高,功耗比较大,在实际应用中普及率非常低。Mahajan等[4]和Kamboj 等[5]提出一种结合GPS进行目标测量的方式,相对于主动测量,它不需要对被测对象施加能量,不受被测对象特性的影响,但需要在GPS信号比较强的地方进行,在山区、丛林等复杂区域信号误差较大。王等[6]和韩等[7]提出一种使用全站仪进行测量的方式,但这种基于全站仪的测量方式需要选择合适的参考点,人为因素较大,在环境复杂、人工无法涉足的地方选择合适的参考点比较困难,同时测量效率降低、误差增大。而双目立体视觉技术[8-9]在测量方面具有测量精度高,功耗低,重量轻等优点。此外无人机具有质量轻、体积小、灵活轻便、拍摄角度全面、可操作性强等优点,在电力线巡检、测量等各领域中的使用不断增多。

基于上述对目标测量方法的分析,使用双目立体视觉技术对线目标进行测量。为提高对线目标的测量精度,在以下两个方面进行了改进优化。第一,在匹配算法方面,对传统Census立体匹配算法做了改进,在代价聚合阶段对聚合窗口中的初始代价值进行了异常值处理,抑制错误初始匹配代价;第二,在线目标视差图优化方面,提出一种基于目标识别的线目标视差图优化算法,该算法依据目标识别获取线目标视差图,然后根据提出的4个步骤进行优化处理,最后得到优化后的线目标视差图。最终设计出一个无人机双目视觉图像采集系统,并依据采集到的双目图像实现对线目标的测量。实际测量结果表明,该改进方法提高了双目图像正确匹配率,对线目标的测量具有较高的精度。

1 改进立体匹配算法

立体匹配算法的精度直接影响着双目测量的精度。对Scharstein[10]对立体匹配算法进行归纳,包括初始匹配代价估计、代价聚合、视差选择和优化4个方面,并对Census算法中代价过程做了改进。

1.1 初始匹配代价计算

考虑到实际应用场景是户外,相机成像受光照辐射影响比较大,依据文献[10],采用Census变换计算初始匹配代价。其中以像素为中心选择Census变换的固定窗口,以中心像素作为参考值,计算该窗口的比特串,如公式(1)~(2)所示。

(1)

(2)

其中:Np={I(pi)|i∈(0,m×n),i∈N,且i≠m×n/2+1}表示除了中心像素p以外的窗口内灰度值的集合,⊗表示按位连接,m和n分别表示支持窗口的长和宽,I(q)表示邻域像素灰度值,I(p) 表示窗口中心像素灰度值。然后计算Census变换后比特串之间的Hamming距离,用C(p,q,d) 表示,其中d为最大视差dmax和最小视差dmin之间的任意值,即d∈[dmin,dmax]。最后为了控制奇异值,将初始匹配代价值映射到区间[0,1]中,并以此作为新的初始匹配代价。映射函数如公式(3)所示。

(3)

其中:Cinit(p,q,d)为初始匹配代价,λ为控制离群值的参数。

1.2 代价聚合

代价聚合是立体匹配的关键之处。首先根据Mei等[12]提出的十字交叉代价聚合法得到聚合窗口S,对于任一像素点p,如图1(a)所示。

图1 像素P

根据颜色相似度和空间距离寻找该像素点的横向臂长(ArmL、ArmR)和纵向臂长(ArmU、ArmD)。臂长的判别原则如(4)~(7)式所示。

Dc(p1,p)<τ1AndDc(p1,p+(1,0))<τ1

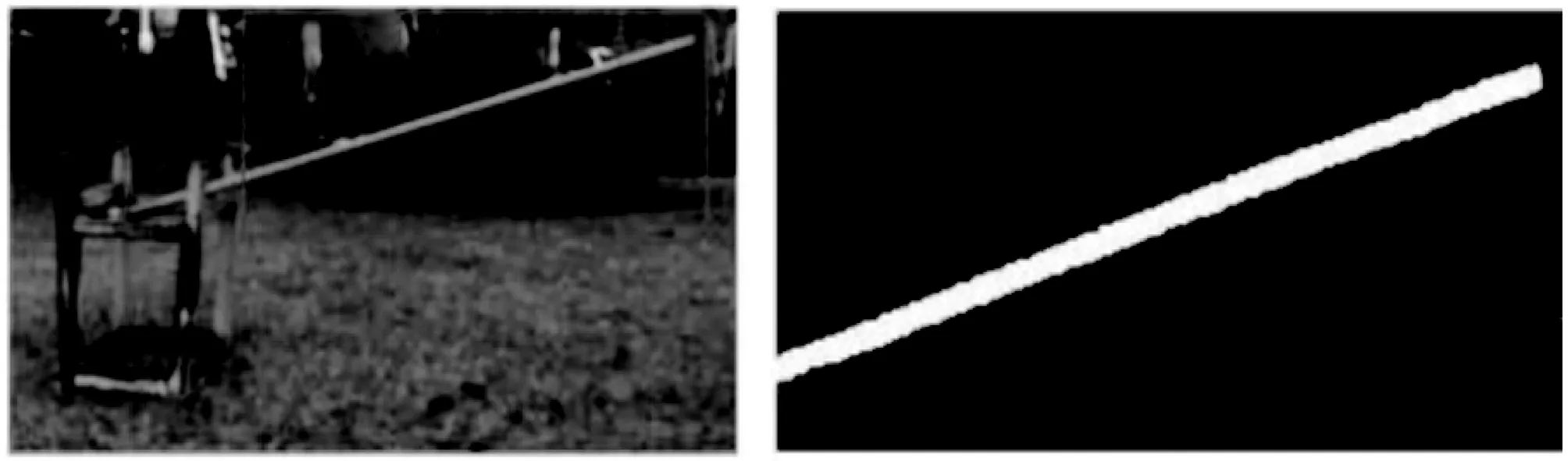

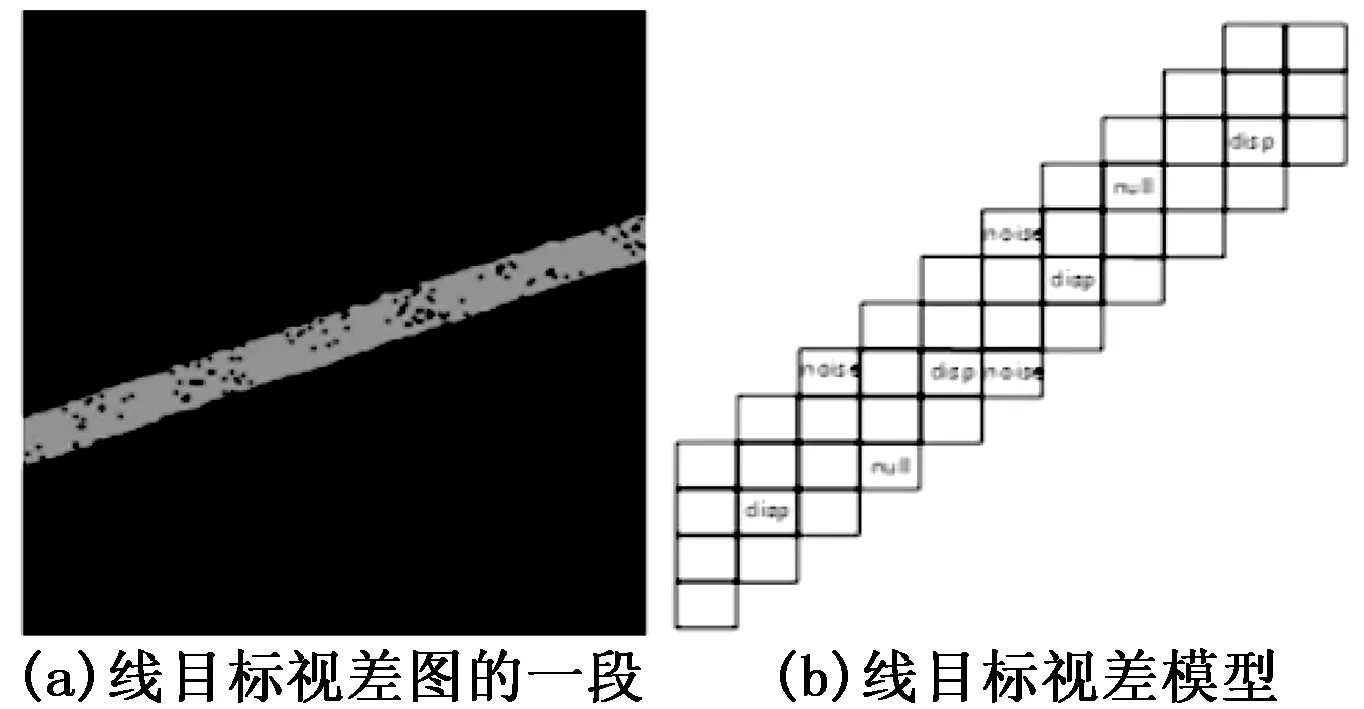

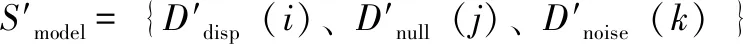

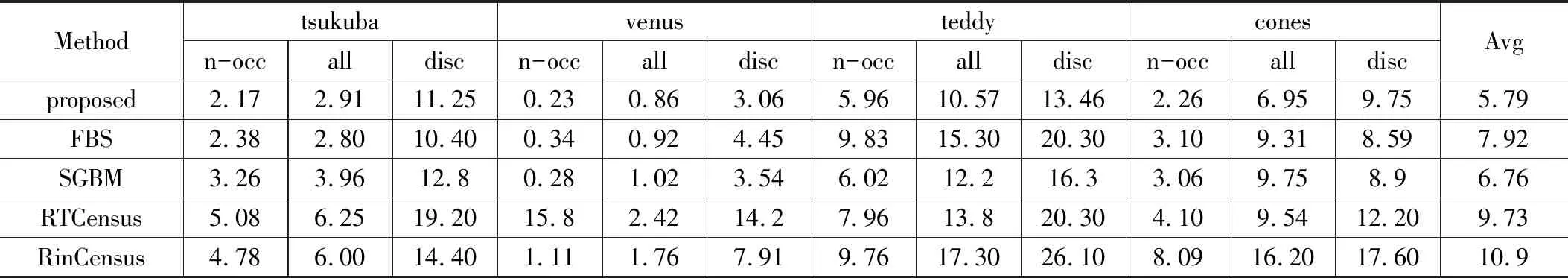

(4)

Ds(p1,p) (5) Dc(p1,p)<τ2ifL2 (6) τ1>τ2AndL1>L2 (7) 其中:p1表示像素p的最右边像素点。Dc表示计算两个像素点的颜色相似度,Ds表示两个像素点的空间距离,τ1、τ2,L1、L2分别表示颜色相似度、空间相似度阈值。随后根据像素点的横向臂长和纵向臂长得到像素点p的聚合区域S,如图1(b)所示。然而,考虑到自然环境和相机性能对成像的影响,当聚合区域S中存在比较多的干扰(异常值)时,采用Mei的方法产生的代价聚合值将会变得不准确,为此,经过对传统立体匹配算法中的代价聚合过程做了改进,提出对聚合区域S内的初始代价值做异常值处理。具体步骤如下:首先计算聚合区域S的平均值a和方差b,如式(8)~(9)所示: (8) (9) 其中:n表示聚合区域S中所含元素的个数;而后按照如下两个准则对区域S中的初始代价值进行处理,其中α为初始代价值个数的阈值: 1)当聚合区域S中的初始代价值的个数n<α时,不对聚合区域S内初始代价值进行异常值剔除。 2)当聚合区域S中的数据个数n≥α时,初始代价值大于a+3b或者小于a-3b则判别为异常值并给予剔除。 根据以上原则可得到关于像素点p的一个新的聚合区域S′,然后再对聚合区域S′进行代价聚合得到聚合匹配代价,如式(10)所示。 (10) 其中:Cagg(u,v,d)为聚合后的匹配代价,n′为新聚合区域S′中初始匹配代价值的个数。 在视差选择阶段,为了能够进一步提高算法匹配率,在代价聚合后进一步加入扫描线优化过程[12],然后采用WTA(Winner-Takes-All)策略[13]进行视差选择,该策略快速有效,它通过选择视差空间中匹配代价值最小的点作为匹配点,并得到其对应的视差。 在视差优化阶段,为了能够进一步提高视差图准确率,首先采用左右一致性检测找出异常点后,根据对极几何原理将异常点分类为误匹配点和遮挡点,然后采用区域投票的策略,对误匹配点和遮挡点进行插值处理。最后采用亚像素增强处理来减少离散视差造成的误差并利用3×3的滑动窗口对视差图进行中值滤波生成最终的视差图。 通过改进立体匹配算法提高了立体匹配精度,但为了测量线目标,仅仅依赖视差图进行测量误差会很大,因为在可见光图像中,线目标在整个图像是一种很细的目标对象,宽度占据的像素不过几十个像素,且在远距离拍摄时,其宽度占据的像素点不过十个几个,除此之外,在进行立体匹配时往往由于算法的优化,生成视差图中的线目标会出现“膨胀”现象,并且线目标视差图会出现很多空洞,如图2所示。为此提出了一种基于目标识别的线目标视差图优化算法,并将得到线目标视差图用于测量提高对线目标的测量精度。 图2 线目标原图及其视差图 为了实现对线目标视差图的优化,首先需要将图像中的线目标识别出来。考虑到自然场景中背景纹理及光线影响,这里采用基于局部特征的识别方法[14],处理过程如下:首先提取图像的边缘线段,采用Blob管理这些边缘线段并计算各个线段的属性值,接着采用Gestalt感知定律对断续线段的进行合并处理,然后对导线组进行聚合优化,实现对导线的识别。最终获取的线目标的二值图像如图3所示。 图3 图像中线目标及其二值图像 为了实现对线目标视差图的优化,这里首先利用3.1中方法生成的导线二值图像与改进立体匹配算法生成的视差图做掩膜处理,得到线目标所有的视差点,将视差值反映到图像上,如图4所示。 图4 对比图 通过图4(a)可以发现,此时生成的线目标视差图仍然会存在一些干扰点,为此,这里依据线目标长度并沿着导线方向对该线目标视差图进行分段,然后对每一个线目标段视差值进行优化处理,最后生成优化后的线目标视差图。 为了方便对线目标视差图进行分析,这里以其中的一个线目标视差段为例抽象出线目标视差模型,如图5所示。 图5 线目标视差图和线目标视差模型 如上图5(b)所示,白色方格和带有disp方格表示线目标上的视差点,带有null的方格表示没有视差值的视差点,带有noise的方格表示有异常的视差点,其中模型中的所有视差点用Smodel={Ddisp(i)、Dnull(j)、Dnoise(k)}表示,Ddisp(i)表示正常视差值视差点集合,Dnull(j)表示没有视差值的视差点集合,Dnoise(k)表示异常值的视差点集合,根据此模型,提出以下4个原则对线目标视差图进行优化: 1)首先根据视差值的大小去除没有视差值的点Dnull(j),此时对模型中剩下的视差点Smodel={Ddisp(i)、Dnise(k)}进行视差直方图分析,画出整个视差图模型中的视差值分布。 (11) 其中:n,m分别表示处理后正常视差值视差点的个数和异常值的视差点的个数。 4)最后采用视差值Dupdate代替视差模型Smodel={Ddisp(i)、Dnull(j)、Dnoise(k)}中的空视差值点和异常值点,即得到优化后视差模型S‴model={Ddisp(i)、Dupdate(z)},完成对导线线段的优化。 采用以上原则实现可以很大程度的优化线目标视差图存在的缺陷,如图4(b)所示。 无人机双目图像采集以大疆无人机M100作为搭载平台,在上面搭建了平行式双目立体视觉结构,如图6所示。 图6 无人机双目系统搭建实物图 其中双目采用的是两个同型号200万像素的工业相机,相机像元尺寸为 4.5 μm×4.5 μm,焦距为8 mm,两个相机基线距离为10 cm,同时为保证无人机双目图像采集的同步性,这里将两路相机与NVIDIA Jetson TX1开发板连接,利用相机API接口设置相机相关参数并同时启动相机实现图像的自动采集保存。 为了将无人机采集的图像实时的传输到地面,这里以无线WiFi路由器为基站建立局域网络,实现TX1开发板与PC计算机之间的实时通信,可将无人机捕获的图像实时传输到地面。 为了验证异常值控制阈值对算法的影响并选择合适的阈值,这里将采用Middlebury立体匹配算法测试平台提供的标准立体图像对(Tsukuba、Venus、Teddy、Cones)作为测试图,并用视差图非遮挡区域的误匹配率百分比作为评价标准,通过分析不同α值得到视差图的误匹配率来确定阈值α。如图7所示,依据原则11和22来进行异常值剔除,可以看到随着α的不断增大,视差图的误匹配率不断的降低,当α>5时,视差图像的误匹配率的变化开始变得不明显,并趋向于稳定。综合以上分析,可以确定算法中的阈值α值为5。 图7 不同α值对匹配精度的影响 为了分析所提出的改进算法的性能,这里同样采用标准测试图像对(Tsukuba、Venue 、Teddy、Cones)作为算法的输入,将得到的视差图与其标准视差图做对比,如图8所示。 其中图8中第一列为原始图象对的左视图,第二列为所提出的算法生成的视差图,第三列为所提出的算法视差图的误差图,其中黑色表示误匹配点,白色表示正确匹配点,灰色区域表示遮挡区域错误匹配点。 图8 标准测试图下改进算法生成的视差图及误差图 为了更加客观的分析所改进的算法的性能,这里计算了非遮挡区域(n-occ)、深度不连续区域(disc)、全部区域的误匹配率(all)以及平均错误率(Avg)等参数,并以此评价视差图的好坏。为此,这里不仅与其他改进Census算法(RTCensus[15]、RinCensus[16])做了对比还与当前比较好的算法(FBS[17]、SGBM、)做了对比比较,各个算法在不同区域的误匹配率,如表1所示。 根据上表可以发现,所提出的改进Census立体匹配算法错误匹配率低于其它两种基于Census变换的立体匹配算法,且相比于FBS、SGBM算法,所提出的的改进算法计算得到的视差图也具有很大的优势,并且平均错误匹配率为5.79%。 为了验证线目标优化优化算法对提高测量精度的有效性,这里选择直径27 mm的细杆作为线目标,并采用4.1节中的无人机双目采集系统采集细杆的双目图像(如图9(a)),以杆的宽度作为测量标准,对不采用线目标视差图优化得到的测量结果和采用线目标视差图优化得到的测量结果进行比较分析。 表1 不同算法视差图误匹配率(%) 具体实验过程为:在无人机起飞之前,首先用标定板(如图9(c))对无人机双目相机进行标定,并将标定结果保存用作双目图像的校正; 图9 实验视差结果及标定板 接着操纵无人机起飞,分别在距离线目标2 m、3 m、4 m、5 m、6 m处定点悬停采集、发送图像对,然后在PC端接收图像对,并选择待测图像对进行极线校正、立体匹配得到视差图(如图9(b)),然后根据视差图,采用划线的方式对线目标宽度进行20次测量,最后统计测量结果,如表2所示。 表2 无线目标视差图优化情况下测量结果 接着根据立体匹配得到的视差图,按照3.3节中方法对视差图中的线目标视差进行优化,然后同样采用划线的方式测量杆体的宽度,测量结果如表3所示。 表3 线目标视差图优化情况下测量结果 对比表2、表3的测量数据可以发现,对于细杆的测量,随着测量距离的增加,测量精度会不断的降低,但是采用文中提出的线目标视差优化算法后得到的测量结果,相比于不加线目标视差优化算法测量得到的结果更接近真实值,而且在不同距离的测量相对误差都比较低,可见文中提出的线目标视差优化算法对提高线目标测量的精度具重要的作用。 为提高无人机双目图像中线目标的测量精度,在立体匹配算法方面,对Census立体匹配算法做了改进,提出了基于异常值筛选的代价聚合方法,提高了立体匹配算法的匹配精度;在线目标测量阶段,为应对立体匹配算法生成线目标视差图中存在的问题,提出了基于目标识别的线目标视差图优化算法,实验结果证明,对于无人机双目图像中的线目标测量,采用线目标视差优化后的视差图进行测量可以得到较为准确的测量结果。1.3 视差选择和优化

2 线目标视差图优化

2.1 图像线目标识别

2.2 线目标视差图优化

3 实验结果与分析

3.1 无人机双目图像的采集

3.2 聚合算法中异常值控制阈值的确定

3.3 改进立体匹配算法性能分析

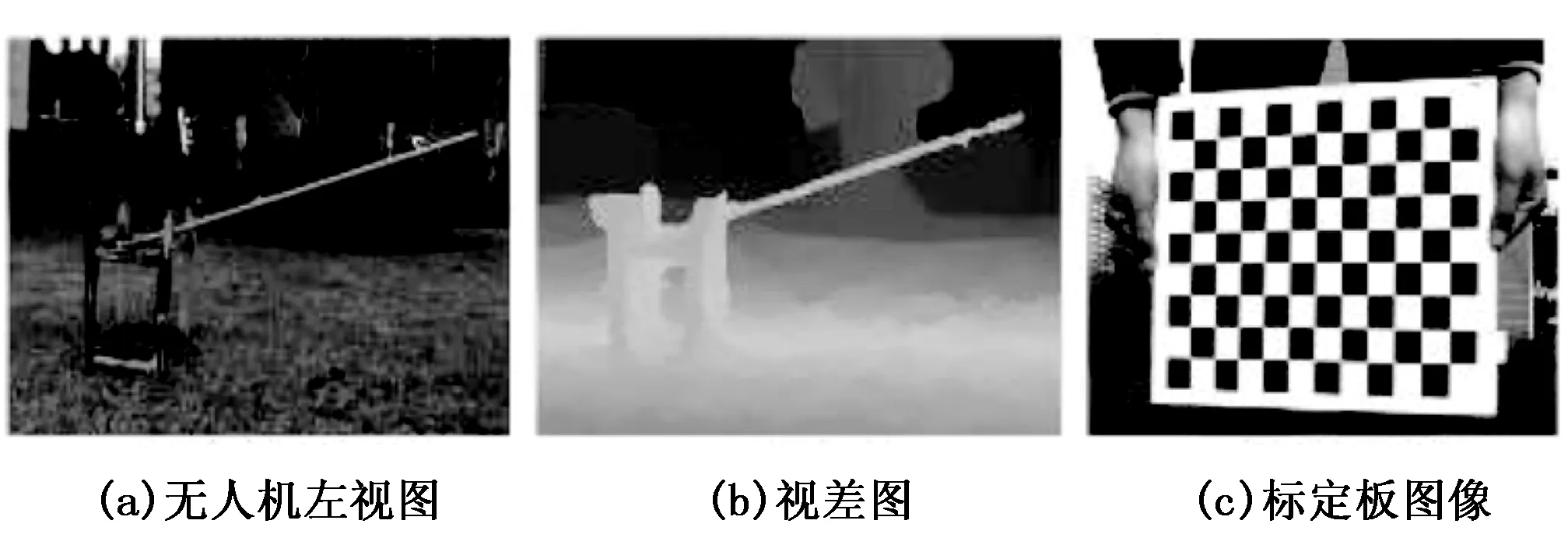

3.4 线目标视差优化算法性能分析

4 结束语