联合像元-深度-对象特征的遥感图像城市变化检测

2019-11-20赵生银朱美如

赵生银,安 如,朱美如

河海大学地球科学与工程学院,江苏 南京 211100

高分辨率遥感图像提供了丰富的地表细节信息,可以对不同阶段的地理对象进行详细比较。城市地理对象详细变化的检测在城市规划管理、地图更新、灾害管理等方面具有重要意义[1]。

目前,遥感图像识别后的比较法广泛用于城市变化检测。按处理的对象不同,通常可分为3大类:基于像元特征的变化检测、基于对象特征的变化检测和联合像元与对象特征的变化检测。传统的遥感变化检测方法主要是针对中、低分辨率遥感图像的像元进行的,其中波段差值法[2]是应用较为广泛的变化检测方法。但是随着遥感图像空间分辨率的不断提高,同类地物内部光谱差异逐渐增大,基于像元光谱统计的变化检测技术已经不能满足遥感图像变化信息检测的要求[3]。而面向对象方法可以充分利用高分辨率遥感图像的空间信息,为城市变化检测提供了新的研究方向。文献[4]指出面向对象识别技术通过增加纹理、空间等信息来提高图像识别的准确性,可以有效地避免像元识别中的“椒盐噪声”现象。目前,对联合像元和对象信息进行识别的研究较少。文献[5]设计了利用Dempster-Shafer理论对像元识别图和对象识别图进行联合后再识别的方法。文献[6]设计了在分割图的基础上统计每个对象内各地物类别的像元数量,根据最多像元数量的类别来确定对象类别的方法。文献[7]设计了利用支持向量机识别器来输出像元特征识别的概率图,然后利用最大后验概率估计法获得对象的识别概率,并设置阈值来确定对象的最终识别结果的方法。上述研究表明,综合利用像元和对象信息可以提高图像识别的精度,但它们都仅仅基于像元或对象特征识别后的结果再进行联合识别,多次识别的误差累积会影响图像的最终识别效果;同时,图像识别的精度严重依赖于图像分割的质量。

将多种特征进行集成,构造更为稳定和适用的检测模型是近年来变化检测应用研究中的热点问题和重要方向之一[8]。在像元特征空间的构建中,文献[9]设计了利用改进的视觉词袋生成算法来提取视觉词袋局部特征进行高分辨率遥感图像识别的方法;文献[10]指出进行多源数据特征空间的构建,发现激光雷达构建的地形特征可以提高识别的精度。许多研究也在像素级特征空间构建中引入卷积神经网络特征,其中文献[11]设计了利用深度卷积神经网络提取局部和全局特征,并利用支持向量机进行特征识别的方法;文献[12]设计了利用支持向量机对提取的深度卷积神经网络不同层的特征来进行识别的方法,该理论验证了深度特征更具表达性。在对象级特征空间的构建中,文献[8]设计了利用自适应的方法将对象之间的光谱距离和纹理距离进行组合来构建对象异质性的方法;文献[13]设计了对形状、位置、光谱和纹理的对象特征空间优化后进行面向对象识别的方法。上述文献构建的特征空间有利于图像识别精度的提高,但是像元特征仅利用了光谱的统计信息,对象特征则利用了纹理、几何、空间等信息。当一个对象内部存在多种地物光谱时,仅利用对象特征无法刻画同一图斑内各像元的光谱差异,因此仅仅利用单一的像元或对象特征会制约遥感图像的识别精度。

高分辨率遥感图像可以产生丰富的图像特征,但大量的特征会使分类器的构造变得复杂,并且会导致维数灾难或“修斯现象”。文献[14—15]设计了利用8种特征选择方法来研究选择的特征维度和训练集大小对识别器影响,该理论验证了特征选择对图像识别的重要性。文献[16]设计了使用了4种机器学习特征算法来选择高分辨率图像识别中最相关特征的方法。文献[17]设计了通过使用随机森林方法计算特征重要度来实现特征选择的方法。上述文献的特征选择算法在小数据量的特征选择中具有速度快、误差小的优点,但是当特征数据量增多时,上述特征选择算法的运算量随之增加,计算时间延长,降低了特征选择的效率。

针对以上问题,本文建立了一种联合像元-深度-对象特征和LightGBM特征选择算法来进行航空遥感图像城市变化检测,提高变化检测的精度。

1 研究方法

1.1 联合像素级和对象级特征空间的构建

传统遥感图像识别的主要方法是以像元为单位进行的,根据每个像元的光谱值将每个像元划归为相应的类别。但是,甚高分辨率遥感图像同物异谱和异物同谱现象十分普遍,使其分类结果有较严重的“椒盐现象”。面向对象识别方法可以充分利用形状、纹理、空间等信息,同一分割对象内部出现较多纯像元,可以减小“椒盐现象”[18]。该方法将每个对象视为由多个具有相同属性的像元组成,当分割尺度不佳,且一个对象内具有多种地物时,面向对象识别会将该对象判别成同一类地物,从而导致错误的识别。采用联合像素级和对象级特征的识别方法,不仅会充分利用每个像元的光谱特征信息,而且也利用了其所属对象的特征信息,如形状、纹理等几何和空间信息,二者优势相互补充。该方法可以改善图像分割尺度对识别结果的影响,可以将分割对象内光谱差异明显的不同地物识别出来,弥补了面向对象技术对光谱信息利用的不充分;同时也利用了对象内的均质性减小了基于像元识别的“椒盐现象”,改善了其忽略空间几何等信息的问题。本文的技术路线见图1。

图1 本文变化检测流程Fig.1 The proposed change detection method

1.2 LightGBM算法

LightGBM算法是对梯度提升决策树(gradient boosting decision tree,GBDT)的一种改进,具备了Gradient Boosting和Decision Tree的功能共同特性,被广泛用于排序、分类、回归等多种机器学习的任务[19]。

1.2.1 Gradient Boosting

Boosting是用一系列子模型的线性组合来完成学习任务的。Gradient Boosting的思想是:一次性迭代变量,逐一增加子模型,并保证损失函数不断减小。假设fi(X)为子模型,复合模型为

Fm(X)=∂0f0(X)+∂1f1(X)+…+∂mfm(X)

(1)

损失函数为L[Fm(X),Y],每一次加入新的子模型后,使得损失函数不断朝着信息含量次高的变量的梯度减小[20]

L[Fm(X),Y] (2) 1.2.2 Decision Tree LightGBM算法采用了带深度限制的按叶子生长策略,该策略每次会从当前叶子节点中找到分裂增益最大的叶子节点,然后分裂,不断重复上述两个步骤,通过限制决策树的最大深度来防止过拟合[21]。决策树中的信息增益Gain(S,A)可以作为衡量样本特征重要程度的指标。Gain(S,A)表示为当样本特征A的值为已知时,样本类别随机变量S信息量减少的程度。Gain(S,A)越大,表明特征A对分类结果影响越大;反之,表明特征A在分类中起的作用越小[22]。信息增益的公式为 Gain(S,A)=H(S)-H(S|A) (3) 式中,A={A1,A2,…,An}表示n维样本特征;H(S)与H(A)为信息熵函数,用于衡量随机变量S和A中的信息量;H(S|A)为条件熵函数,表示当A已知时随机变量S的不确定性程度。LightGBM算法通过信息增益计算每个特征的重要度并进行排序,排序结果用于特征的重要度分析及特征的选择。 宜兴市位于江苏省南部,地理位置为31°07′N—31°37′N,119°31′E—120°03′E之间。本文选取宜兴市部分区域作为研究区域,其中试验区域图像大小近似为137 m×107 m(440×346像素),验证区域图像大小近似为211 m×203 m(682×678像素),如图2所示。 图2 研究区域Fig.2 Research area 本文研究所使用的数据为UCXP WA-00315131传感器拍摄的图像,该航摄遥感图像包括红、绿、蓝和近红外4个多光谱波段,空间分辨率为0.31 m。遥感图像获取的时间分别为2012年2月18日和2015年4月30日。对获取的图像先进行正射校正,得到正射遥感图像和DSM数据。然后,对不同时相的图像进行配准,使配准误差在一个像元以内,并裁剪出试验区域及验证区域。 在充分提取像素级(由像元特征和深度特征组成)和对象级特征优势的基础上,本文分别将单独的像元特征空间、对象特征空间和深度特征空间叠加、合并成一个联合特征空间,该联合特征空间包括了光谱、指数、纹理、几何、表面高度及深度神经网络共137个特征。 3.1.1 像元特征和对象级特征空间的构建 根据不同的城市覆盖类型在图像上的表征来构建联合像元和对象级的特征空间。本文利用栅格计算法来提取图像的像元特征信息,主要包括光谱、纹理、指数和地形4大特征类型。利用尺度参数评估(estimate scale parameter,ESP)[23]方法对图像进行分割,来构建对象特征空间,主要包括光谱、形状、纹理、指数和地形5大特征类型。特征空间数据集见表1:本文构建的特征空间中有56个对象级特征和45个像元特征。 表1 特征空间数据集 3.1.2 卷积神经网络特征 深度卷积神经网络VGG-19模型,共有16层卷积层,5层最大池化层。根据特征图的抽象程度及大小,可将其分为浅层(conv1—2、relu1—2和pool1—2)、中层(conv3、relu3和pool3)、中高层(conv4、relu4和pool4)和深层(conv5、relu5和pool5)4种类型来进行分析[11]。卷积层是卷积神经网络的重要组成部分,它将上一层神经网络的卷积核采样的每一小块进行更加深入地分析从而获得抽象程度更高的特征。池化层可以将一张分辨率较高的图像转换为分辨率较低的图像,从而减少整个神经网络的参数。VGG-19神经网络模型具有以下两个特点:①相比于单个大尺寸的卷积核,该模型采用小型3×3的卷积核来提取每个像素周围的图像信息,使提取的特征更加精细、全面;②模型结构深度的增加,使模型可以提取到更抽象的高级语义特征,这些深度特征在图像识别中具有很高的判别性,同时在不同数据集上有很好的泛化能力。 VGG-19模型的特征图对纹理、细节等有很强的不变性,被广泛用于图像特征的提取。利用预训练好的VGG-19模型来提取各个卷积网络的特征图作为深度特征,并利用均值融合法将同组的神经网络层的特征图进行融合,如图3所示。为了解决随着网络层数的增加,输出的特征图的分辨率不断降低的问题,本文将输出的特征图与原遥感图像进行配准并赋予地理坐标信息,然后再进行重采样,使其与原遥感图像像元大小一致。图3(a)—(b)将图像中的地物细节(停车场线)、纹理(道路)等很好凸显出来,但是模糊了建筑物、植被等块状信息;图3(c)—(g)是各组卷积网络特征融合图,图像的分辨率逐渐降低。浅层、中高层网络特征图主要显示的是纹理、细节特征信息,对线状特征尤为敏感;深层网络特征可以提取形状、轮廓等特征信息,层数越深,特征的抽象度越高。图3(h)是VGG-19模型所有深度特征图融合结果,由于卷积核在采样过程中使属性差异不大的像元相互融合,来突出对比度大的像元特征,所以该模型主要提取了地物线状特征以及不同相邻地物的边界信息。深度特征包含了VGG-19各个卷积网络(Conv)、激活层(Relu)特征图,共36个特征,此类特征也属于像素级特征。 图3 2015年VGG-19卷积神经网络的特征图Fig.3 Feature map of the VGG-19 convolutional neural network in 2015 以2012年试验区为例,在遥感图像上选取训练样本311个点,其中城市地表覆盖类型为道路(69个)、建筑(50个)、裸地(43个)、人工地物(37个)、阴影(41个)和植被(71个)6类。提取样本点的所有特征图的属性数据,利用LightGBM算法对属性数据进行重要度排序,按重要度从高到低依次以3个步长选取特征数量来进行样本识别精度的评估。特征数量选择如图4所示:识别精度不会随着特征数的增加而不断提高,因为过多的特征,不仅会导致计算量的增加,而且会造成特征空间内部互相干扰的信息,降低了识别精度。本文特征数量选择的准则是利用较少的特征数量来达到较高的识别精度。试验区2012年的137个联合特征在LightGBM特征选择算法下,当特征数量为15个时,样本识别精度较高。然后计算了该15个特征之间的相对重要度,如图5(a)所示。在LightGBM特征选择算法下,对象特征(11个)重要度最高,像元特征(2个)次之,深度特征重要度较低(2个)。通过分析图9的2012年试验区3种特征类型间组合的平均识别精度:加入深度特征后,各种组合的识别效果均有所改进,总体的识别精度平均提高了4.00%;加入像元特征后,总体的识别精度平均提高了5.30%;加入对象特征后,总体的识别精度平均提高了9.00%。这与各种特征的重要性排序结果及其对识别效果的贡献相吻合。此外,为了验证新颖的LightGBM算法特征选择的运行效率,本文增加了RF、支持向量机(SVM)和XGBoost算法进行运行时间比较,见表2:本文特征选择算法运行时间统计的是Python程序下各种算法将特征按重要度排序的运行时间。其中LightGBM算法在4种特征选择算法中平均运行时间最少,达到了0.49 s。在相同的训练样本下,LightGBM算法比RF、SVM和XGBoost算法进行特征选择的运行效率较快。综上所述:新颖的LightGBM算法在遥感图像特征选择中可以提高时间效率,具有可行性与适用性。 图4 特征数量与样本识别精度(LGB代表LightGBM算法;RF代表随机森林算法;OBJ代表对象级特征;Pixel代表像素级特征)Fig.4 Feature quantity and sample recognition accuracy (LBG means LightGBM algorithm; RF means random forest algorithm; OBJ means object-scale feature; Pixel means pixel-scale feature) 图5 2012年联合像素级和对象级特征的特征选择结果(Object代表对象级特征;Pixel代表像素级特征:包含了像元特征和深度特征)Fig.5 Feature selection results of combining pixel-scale and object-scale features in 2012 (Object means object-scale feature; Pixel means pixel-scale feature) 3.3.1 联合像素级和对象级特征的图像识别 文献[24]指出对高空间分辨率图像进行面向对象分析时,发现随机森林识别器可以取得较好的识别精度,所以本文采用该识别器进行图像识别。本文方法的识别结果如图6所示:图6(a)、(n)是2012年试验区和验证区遥感图像;图6(e)、(n)是2015年试验区和验证区遥感图像;图6(b)、(f)、(j)、(o)是仅基于对象级特征的识别结果,过分割和欠分割现象是导致图像识别错误的主要因素;图6(d)、(h)、(m)、(q)是仅基于像素级特征识别的结果,由于没有充分考虑邻近像元的影响,错误识别较多,“椒盐现象”比较严重;图6(c)、(g)、(k)、(p)是联合像素级和对象级特征的识别结果,如图6(a)、(b)、(c)、(d)中线框所示:建筑的阴影和建筑被分割到同一个对象中,联合像素级和对象级特征的识别方法可以将建筑对象内的阴影检测出,克服了过分割的影响,并且房屋识别的边界较为规整。该方法可以充分利用像元特征信息来弥补面向对象方法中模糊的光谱信息,将对象内光谱差异大的地物识别出,也发挥了面向对象识别方法的优势,充分利用了空间几何信息,使识别结果连续性好,边界更规整;同时在一定程度上可以改善单一分割尺度对图像识别的影响。 表2 不同特征选择算法在像素级、对象级与联合特征中运行时间评估 Tab.2 Running time evaluation of different feature selection algorithms in pixel-level, object-level and joint featuress 特征选择算法像素级特征2012对象级特征联合特征像素级特征2015对象级特征联合特征平均时间LightGBM0.4180.4520.5400.4850.4230.6210.490RF0.6330.6110.7410.6600.6740.8050.687SVM0.8210.8430.8970.9440.9961.2630.961XGBoost0.9430.9741.1711.0431.0521.4561.107 3.3.2 VGG-19卷积神经网络特征的识别效果分析 本文将像元、深度和对象3种特征类型相互组合,共构建了7种特征组合空间,利用LightGBM特征选择算法构建最优特征空间,来探究深度特征对图像识别结果的影响。图7(a)、(c)相比于图7(b)框A,加入深度特征的图像识别可以将”L”型的线状阴影检测出来。图7(e)框B中:由于没有加入深度特征,将停车场线误分为道路。图7(d)、(f)框B中:在不同的特征选择算法下,加入深度特征的图像识别都可以较好地将停车场线正确识别为人工地物。如图9精度评价图所示:深度特征是通过融合像元值差异不大的像元,突出对比度大的像元信息,因此仅仅基于深度特征的识别效果较差,平均识别精度为69.20%。但是深度特征可以有效地提取地物的细节、纹理信息,深度特征与其他特征类型组合后,总体的识别精度平均提高了4.30%,见表3。综上所述:每一层卷积网络对上一层特征图不断进行采样,中、浅层的网络特征图能提取到可靠的纹理、细节特征;高层网络特征图抽象程度更高,可以较好地提取图像地物的块状信息。因此,该类深度特征信息可以在一定程度上可以提高图像识别的精度。 根据变化矩阵原理对识别后图像进行城市变化检测。变化检测结果如图8所示:试验区城市覆盖类型用数字表示,其中数字52表示2012年的植被到2015年变为建筑物。目前常用的识别后变化检测方法[25]在中、低分辨率遥感图像中主要是基于像元进行的,高分辨率遥感影像主要是基于对象进行的。本文通过与经典的基于像元特征变化检测和基于对象特征变化检测方法相比较,发现本文方法不仅可以克服分割尺度对检测结果的影响,也可以检测出微小的地物变化信息,变化图斑较为连续规整。 图8 城市变化检测Fig.8 Urban change detection 3.5.1 图像识别结果评价 随机、分布均匀地从遥感图像选取样本点,通过统计样本像元数量对试验区图像识别结果进行精度和Kappa系数评价,如图9(a)、(b)所示。LightGBM算法选择的联合像元-深度-对象特征的识别精度最高,平均达到了92.00%,Kappa系数达到0.90,比RF特征选择算法的识别结果提高了1.00%和0.03;其中,在两种特征类型组合中,联合对象-深度特征识别的总体的平均精度最好,达到了90.50%,由于分割尺度的影响,对象内部局部细节、纹理信息会被模糊,提取的为块状信息;而深度特征可以提供局部突出的图像信息,所以二者特征信息可以互补,从而获得较好的识别精度。 图9 试验区图像识别精度评价Fig.9 Accuracy evaluation of image recognition in experimental area 利用较大面积的验证区域的图像识别结果来验证本文方法的合理性,验证区域识别精度评价见表4:本文方法的图像识别效果最优,平均识别精度达到了85.00%。通过分析试验区和验证区的识别精度,本文方法的平均Kappa系数达到0.86,总体识别精度达到了88.50%,比仅仅基于像元、深度或对象特征的识别方法分别提高10.5%、15.00%和4.00%。本文提出的联合像元-深度-对象特征和LightGBM特征选择方法的航空遥感图像识别方法具有一定的可行性和精确性。 表4 验证区基于像元、基于对象、基于深度和联合特征识别精度的对比 Tab.4 Accuracy evaluation of image recognition based on pixel-scale, object-scale and joint method in verification zone 遥感图像特征选择算法特征类型精度Kappa系数2012年LightGBM算法对象0.810.76像元0.770.71深度0.720.69对象+像元+深度0.840.802015年LightGBM算法对象0.810.76像元0.760.69深度0.690.62对象+像元+深度0.860.82 3.5.2 城市变化检测精度评价 以验证区变化检测结果来检验本文方法的泛化性,城市变化检测结果精度评价见表5:随着研究区域的扩大,本文方法使城市变化检测平均漏检率为7.05%,误检率为5.65%,平均检测精度达到了87.5%,比基于像素和基于对象识别后变化检测精度分别提高了7.23%、4.56%。所以,本文方法是利用甚高分辨率遥感图像识别后进行城市变化的检测的有效方法。 表5 2012年到2015年遥感图像城市变化检测精度 Tab.5 Accuracy of urban change detection in remote sensing images from 2012 to 2015(%) 基于像元检测本文检测方法基于对象检测试验区误检率6.537.5漏检率11.088.5检测精度80.3489.084.27验证区误检率12.38.310.5漏检率9.76.111.2检测精度79.8085.681.20 针对甚高分辨率遥感图像识别方法对像元和对象信息利用不充分,特征空间构建单一以及特征选择效率低下等问题,本文建立了一种联合像素级和对象级特征的甚高分辨率遥感图像城市变化检测方法,得出以下结论: (1) 通过构建联合像素级和对象级特征空间进行图像识别,充分利用了面向对象识别和基于像元识别法的优势,减小了“椒盐现象”,使识别结果连续性好,避免了联合识别中多次分类造成的累积误差,同时也改善了分割尺度因素对图像识别精度的影响。 (2) 在像素级特征中引入卷积网络的深度特征,其提取的特征可以为图像识别提供具有代表性的信息;通过建立的联合深度、像元和对象特征的图像识别方法效果最好,提高了后续城市变化检测的精度。 (3) 引入新颖的LightGBM算法来对大量特征进行选择,且其选择的特征的识别结果及时间效率优于经典的RF特征选择算法,说明了该算法在遥感图像特征选择中的可行性。2 研究区及数据

2.1 研究区概况

2.2 试验数据及预处理

3 结果与讨论

3.1 联合特征空间的构建

3.2 特征选择

3.3 图像识别

3.4 城市变化检测

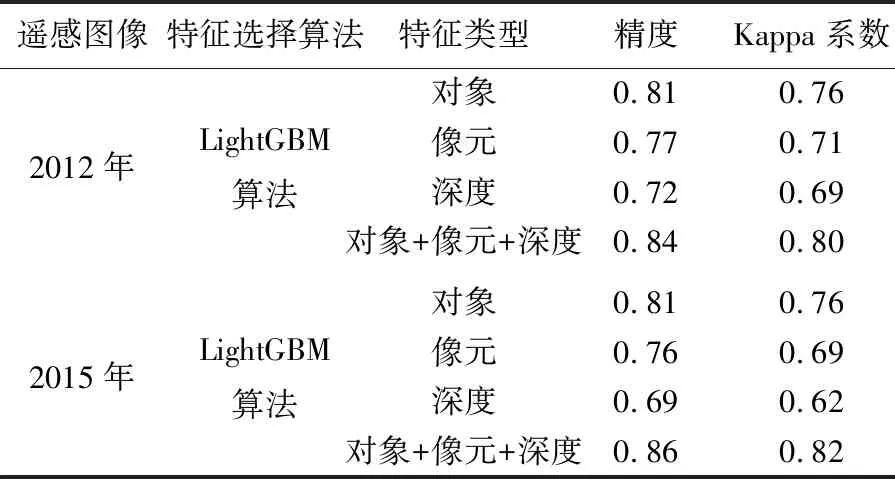

3.5 精度评价

4 结 论