结合R-DAD和KCF的行人目标跟踪改进算法

2019-09-12许喜斌

许喜斌

摘 要:行人目标跟踪技术在现实生活中具有较强应用性,但存在抗遮挡性弱等问题。本文利用Jetson TK1平台的便捷性结合R-DAD(Region Decomposition and Assembly Detector)思想改进了KCF(Kernelized Correlation Filters)跟踪算法,实现对行人目标跟踪。实验结果表明,改进的行人目标跟踪算法运算量少、性能高、速度快,具有良好的抗遮挡性和精确性。

关键词:Jetson TK1平台;R-DAD;KCF;目标跟踪;抗遮挡性

文章编号:2095-2163(2019)04-0263-05 中图分类号:TP391 文献标志码:A

0 引 言

随着人工智能的快速发展,图像检测识别和目标跟踪技术在多个领域被广泛使用,例如商业、小区安全、军事保密和法律取证等方面的智能视频监控;基于5G网络的智能医疗诊断;解决交通道路拥堵的智能交通监管系统及自动驾驶系统。

目标检测算法主要有基于背景建模、基于轮廓模板、基于光流法和基于底层特征等4类。基于背景建模算法是先建立当前前景的背景模型,再与背景图像模型做差分,提取运动前景,建立临时块模型,结合更新的行人检测的背景模型实现行人检测[1],该算法对动态变化背景较为敏感,不适用复杂的动态场景。基于轮廓模板的方法是通过构建图像目标物体的边缘轮廓、灰度、纹理等信息模板,再匹配模板的方法来检测目标[2],该方法简单易行,但需要构建大量的模板才能取得较好的效果。基于光流法是赋予图像各个像素点一个速度矢量形成图像运动场,再根据像素点的速度矢量特征进行图像分析,获取物体在图像中的运动位置,实现目标检测[3],该方法适合分析多目标的运动,可以解决运动目标检测中的遮挡、重合等问题,但存在实时性差、鲁棒性弱、计算方法复杂等不足。基于底层特征的算法是利用积分图技术进行快速计算,但对行人目标的表达能力不足,判别力较差。

行人检测技术主要有基于特征提取和深度学习(Deep Learning)2种。其中对于特征提取的方法,为了更好地获取行人图像特征,Dalal N等人[4]采用梯度方向直方图(HOG)特征描述子结合线性分类器支持向量机(SVM)的方法,在行人检测方面取得了巨大的突破,但在处理遮挡问题的时候,HOG特征并不能很有效地解决遮挡问题。基于深度学习方面,随着近年来的理论和相关技术的高速发展,深度学习的行人检测算法取得很大的突破[5-8],其检测精度也有较大地提高,深度学习具备的自我学习特点可以避免复杂的特征提取和数据建模过程,很好地描述检测目标特性。本文基于KCF算法,结合区域分解集成的思想,改进KCF算法提高目标跟踪的抗遮挡性,在NVIDIA Jetson TK1 平台上具有良好的抗遮挡性和实时性。

1 Jetson TK1平台

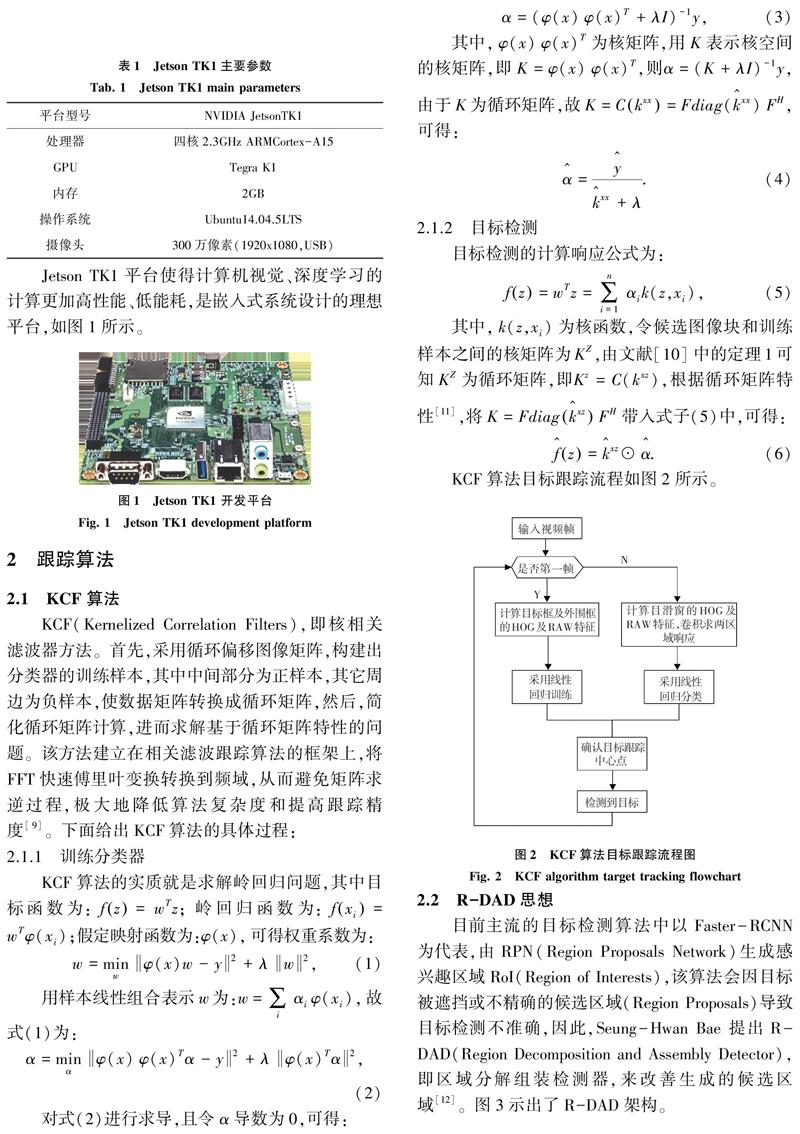

NVIDIA Jetson TK1平台是NVIDIA针对快速开发和部署面向机器人技术、计算机视觉、医疗等领域的计算密集型系统。该平台以NVIDIA Tegra K1 SoC 为基础构建,包含 NVIDIA KeplerTM 计算核心,且具有192 个 CUDA 核心,非常适合算法的并行运算,具体参数见表1。

Jetson TK1平台使得计算机视觉、深度学习的计算更加高性能、低能耗,是嵌入式系统设计的理想平台,如图1所示。

2 跟踪算法

2.1 KCF算法

KCF(Kernelized Correlation Filters),即核相关滤波器方法。首先,采用循环偏移图像矩阵,构建出分类器的训练样本,其中中间部分为正样本,其它周边为负样本,使数据矩阵转换成循环矩阵,然后,简化循环矩阵计算,进而求解基于循环矩阵特性的问题。该方法建立在相关滤波跟踪算法的框架上,将FFT快速傅里叶变换转换到频域,从而避免矩阵求逆过程,极大地降低算法复杂度和提高跟踪精度[9]。下面给出KCF算法的具体过程:

2.1.1 訓练分类器

2.1.2 目标检测

目标检测的计算响应公式为:

KCF算法目标跟踪流程如图2所示。

2.2 R-DAD思想

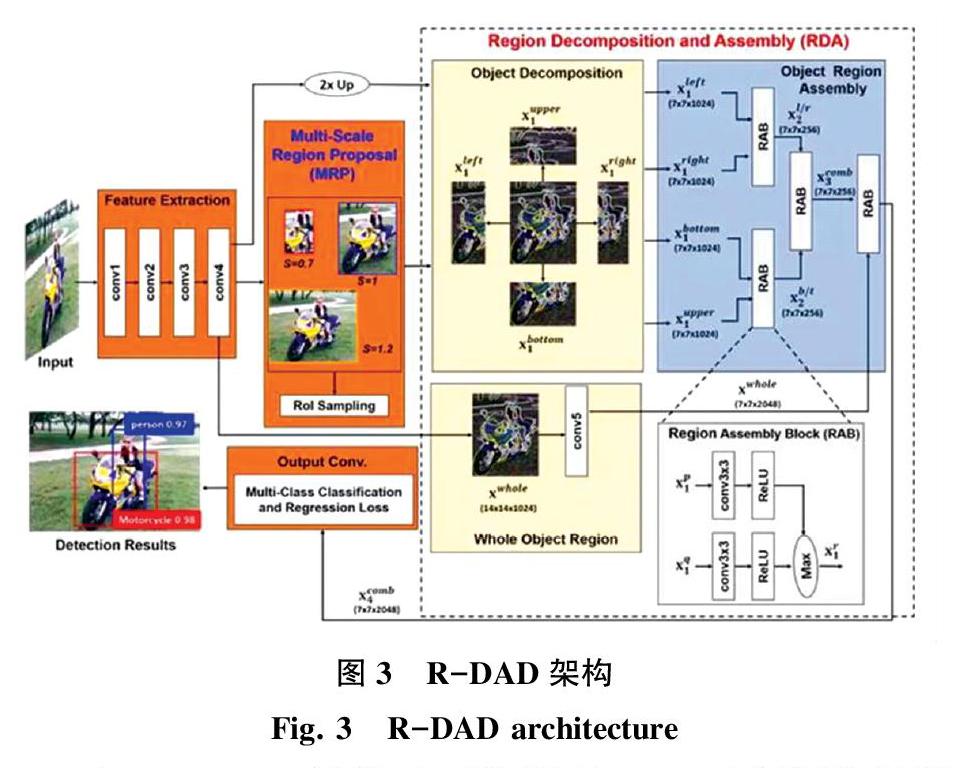

目前主流的目标检测算法中以Faster-RCNN 为代表,由RPN(Region Proposals Network)生成感兴趣区域RoI(Region of Interests),该算法会因目标被遮挡或不精确的候选区域(Region Proposals)导致目标检测不准确,因此,Seung-Hwan Bae 提出R-DAD(Region Decomposition and Assembly Detector),即区域分解组装检测器,来改善生成的候选区域[12]。图3示出了R-DAD架构。

在R-DAD架构中,重新对MRP网络进行调整,对目标进行缩放形成多个不同尺度的候选区域,再对其分解成几个部分,如上、下、左、右,其中,设计了一个带有3*3的卷积滤波器区域组装块,让分解的部分两两进行卷积和使用ReLU函数,比较得出最大单元模块,再继续使用RAB(Region Assembly Block),接着对分解部分的强响应进行结合,然后再学习整个对象和基于部件的特征之间的语义关系,R-DAD 网络架构主要分成MRP 和RDA 2个模块。

2.2.1 MRP(Multi-Scale Region Proposal)模块

MRP模块主要是改善RPN生成的候选区域的准确率。是生成多尺度的候选区域,首先用传统的RPN生成一些建议框,然后用不同的缩放因子对生成出的候选区域进行不同比例的缩小放大,从而提高候选区域的多样性。如图4所示,框内分别对应S=0.7,1,1.2的候选区域,不同尺度的区域,会导致部分局部大于目标本身,也使得候选区域数量过多,导致无法完全利用,因此需要添加RoI的采样层,对分数低和跟ground truth 重叠率低的进行筛选。因此,MRP 网络生成的各种候选区域,可以进一步适应目标之间因为空间变化所导致的特征变化,进而提高结构的鲁棒性。

2.2.2 RDA(Region Decomposition and Assembly)模块

RDA模块同时描述物体的全局及局部外观,将目标物体分为目标区域集成和目标分解2部分,其中,目标分解如图5所示,将目标分为上、下、左、右4个部分,其中图左边为不同尺度的候选区域,图右边为物体目标的分解区域。

对目标进行分解时,先用线性插值2倍以上采样之后再分解,会达到更好的效果。因为左右刚好是特征图的左右一半,上下也是一样,然后再送入RAB模块,其中RAB模块如图6所示。

RDA模块主要由以下2个函数表示:

R-DAD可以描述全局特征和局部特征的语义信息,在较为复杂的场景下,若目标对象被遮挡,通过左、右、上、下模板筛选出来的特征会更加符合真实场景,使得候选区域更加可信,增强目标跟踪的抗遮挡性。

2.3 改进KCF算法

KCF算法在各种场景的应用中,在跟踪效果和跟踪速度上都表现的比较优秀。但是,该算法存在无法较好解决跟踪过程中目标被遮挡的问题,一旦跟踪目标发生遮挡就容易导致跟踪失败。

本文结合R-DAD的思想,对行人目标区域进行全局和局部特征提取,并进行训练,获得行人目标的局部特征,再对局部区域使用KCF跟踪器进行初始化并输出响应值,利用响应值定位目标局部区域的关联响应,进而将部分区域响应值组合形成整体的行人目标响应值。局部特征提取如图7所示。

基于R-DAD思想的KCF目标跟踪改进算法描述如下:

步骤1 先将行人目标整体检测出来,然后对行人整体目标进行划分,例如,假设整体行人目标为X,将其等分为上、下、左、右4部分:Xl、Xr、Xu、Xd;

步骤2 对每部分都进行特征提取,并形成相对应的特征值:El、Er、Eu、Ed;

步骤3 将整体目标跟踪化为局部跟踪,先跟踪局部部分,即先跟踪El,以El特征为目标Xl作为行人目标所在的跟踪对象进行跟踪;

步骤4 当局部目标Xl被遮挡时,跟踪另一个局部目标局部块Xr,使用Er作为目标跟踪特征进行跟踪,重复步骤3;

步骤5 当局部目标特征失效或整体目标被完全遮挡,则跟踪失败;

步骤6 算法结束。

3 实验结果

为了提高识别的速度,提升实验效果,本文在JetsonTK1平台上调用GPU进行行人识别运算,对同一段行人跟踪视频分别用KCF算法及改进的KCF算法进行目标跟踪,对比两者的召回率和准确率,分析两者之间的性能区别,见表2。

3.1 召回率

其中,R为召回率;TP为目标跟踪正确的图像帧总数;TN为含有目标的图像帧及跟踪失败的总数。召回率可以评估目标跟踪算法的全面性衡量及跟踪质量,进而反映出算法在所有目标出现的图像中的成功跟踪目标的能力。

3.2 准确率

其中,P为准确率; TP为目标跟踪正确的图像帧总数; FP为目标跟踪错误及未出现目标的图像帧总数。准确率可以衡量目标跟踪的准确性。

见表2,KCF目标跟踪算法的准确率为 28.55%,改进后的KCF目标跟踪算法的准确率为48.69%,改进后的KCF算法准确率提升20.14%。KCF算法召回率为28.11%,改进后的KCF算法召回率为46.67%,改进后的KCF算法召回率率提升18.56%。实验结果表明,基于R-DAD思想改进的KCF目标跟踪算法的跟踪性能更佳、抗遮挡性更强、跟踪效果更好。

4 结束语

本文基于JetsonTK1平台,利用该平台性能高、便捷、小巧的特点,设计了行人目标跟踪算法,采用KCF跟踪算法,并利用R-DAD思想对KCF算法进行改进,在保持KCF算法高正确率、高运算速度、少计算量的同时,提升了行人目标跟踪算法的抗遮挡性和跟踪精度。

参考文献

[1]WREN C, AZARBAYEJANI A, DARRELL T, et al. Real-time tracking of the human Body[C]. IEEE Transactions on Pattern Analysis and Machine Intelligence,1997,19(7):781-785.

[2] 張春凤,宋加涛,王万良.行人检测技术研究综述[J]. 电视技术,2014,38(3):157-162.

[3] Yalin X, Steven A S. Moment and Hyper Geometric Filter for High Precision Computation of Focus,Stereo and Optical Flow[J]. International Journal of Computer Vision,1997,22(1):25-29.

[4] Dalal N,Triggs B. Histograms of oriented gradients for human detection[C]∥ 2005 IEEE Computer Society Conference on Computer Vision and Pattern Recognition,CVPR 2005,IEEE,2005:886-893.

[5] Tian Y,Luo P,Wang X,et al. Pedestrian detection aided by deeplearning semantic tasks[EB/OL]. ar Xiv preprint ar Xiv:1412. 0069,2014.

[6] Ouyang W,Wang X. Joint deep learning for pedestrian detection[C]. Computer Vision ( ICCV) ,2013 IEEE International Confe-rence on. IEEE,2013:2056-2063.

[7] Sermanet P,Kavukcuoglu K,Chintala S,et al. Pedestrian detectionwith unsupervised multi-stage feature learning[C]. Computer Visionand Pattern Recognition (CVPR) ,2013 IEEE Conference on.IEEE,2013:3626-3633.

[8] Luo P,Tian Y,Wang X,et al. Switchable deep network for pedes-trian detection [C]. Computer Vision and Pattern Recognition(CVPR) ,2014 IEEE Conference on. IEEE,2014:899-906.

[9] J.Henriques,R.Caseiro,P.Martins,et al.High-speed tracking with kernelized correlation filters[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2015, 37(3):583-596

[10]Li Y,Zhu J.A scale adaptive kernel correlation filter tracker with feature integration[C]//European Conference on Computer Vision,2014:254-265.

[11]何承源.循环矩阵的一些性质[J].数学的实践与认识,2001,31(2):211-216.

[12]Seung-Hwan Bae.Object Detection based on Region Decomposition and Assembly[C]. Thirty-Third AAAI Conference on Artificial Intelligence (AAAI-19).2019.