基于动态匹配模型的驾驶人嘴部行为识别与分级预警*

2015-04-12程文冬张名芳刘卓凡郭艳君

付 锐,程文冬,张名芳,袁 伟,刘卓凡,郭艳君

(1.长安大学,汽车运输保障技术交通行业重点实验室,西安 710064; 2.长安大学汽车学院,西安 710064;3.西安工业大学机电工程学院,西安 710032)

2015188

基于动态匹配模型的驾驶人嘴部行为识别与分级预警*

付 锐1,程文冬2,3,张名芳2,袁 伟2,刘卓凡2,郭艳君2

(1.长安大学,汽车运输保障技术交通行业重点实验室,西安 710064; 2.长安大学汽车学院,西安 710064;3.西安工业大学机电工程学院,西安 710032)

鉴于嘴部行为能够反映出驾驶人不同的精神状态,本文中提出了一种基于机器视觉的嘴部行为识别与精神状态预警方法。首先采用改进的高斯混合模型进行光照自适应的唇色分割。然后在嘴唇区域内建立了基于灰度能量角点的嘴唇动态匹配模型,用于描述嘴部特征并提取动作参数。最终建立了嘴部行为的判别模式,实现了驾驶人精神状态的分级预警。实验结果表明,动态匹配模型具有较高的嘴部特征匹配精度和动作适应能力。算法能够有效检测“闭嘴”、“说话”和“打哈欠”行为,分心预警和疲劳预警的监测精度分别为85.8%和92.9%。

嘴部行为;高斯混合模型;能量角点;动态匹配模型;分级预警

前言

基于机器视觉的驾驶人面部行为与状态识别已成为安全辅助驾驶研究的重要内容[1]。此项研究多集中于眼睛运动与头部姿态识别,例如监测眼睛开启度与眨眼频率,结合PERCLOS等法则进行疲劳预警[2];建立眼睛运动模型并结合头部姿态来估计驾驶人的关注区域和驾驶意图等[3]。事实上,嘴部行为特征也能够反映驾驶人的多种精神状态,例如文献[4]中研究发现说话行为会削减驾驶人对交通环境的感知能力以及规避风险的反应速度;文献[5]中认为打哈欠直接反映出驾驶人处于疲劳状态,并将其作为重要的判别指标引入疲劳驾驶监测。针对驾驶人嘴部行为的图像识别与安全预警逐渐成为安全辅助驾驶技术的热点课题,对提高车辆主动安全具有重要意义。

嘴部区域具有姿态的不确定性、行为表征的隐匿性、行为习惯的个体差异性,驾驶人嘴部特征识别与行为理解成为异常精神状态预警的瓶颈问题。嘴唇特征识别方法主要分为两类:一是基于形状结构规则的机器学习方法,例如Adaboost算法[6]、主动表观模型[7](AAM)等,此类方法将嘴唇重要特征表达为不相关低维向量的特征信息并抽象为数学模型,运用控制点和曲线拟合逼近嘴部形态,此类方法对光照变化的鲁棒性很强,但对驾驶人随机性头部姿态与嘴唇运动的适应能力较差,而且正负样本的训练数量大;第二类为基于像素的特征识别方法,如唇色概率估计[8]、显著边缘检测[9]、基于梯度的特征角点检测[10]等,再通过合理的匹配模板还原嘴部特征,此类方法对头部姿态与嘴唇动作的适应性强,可获取丰富的特征信息,缺点是对光照较为敏感,在复杂环境中的自适应收敛能力较差。

基于上述分析,本文中提出一种基于动态匹配模型的驾驶人嘴部特征识别方法,确保嘴唇检测的光照鲁棒性与动作适应性,在此基础上建立特征模型与嘴部行为的映射模型,实现驾驶人异常精神状态预警。

1 总体方案

本文的整体方案如图1所示。系统通过仪表盘内的CCD摄像头实时采集驾驶人面部图像,根据面部特征(皮肤、嘴唇和头发等)的色度聚类特性,运用改进的高斯混合模型实现面部肤色识别与自适应唇色分割。随后在嘴唇粗区域内建立基于灰度能量角点的嘴唇动态匹配模型,提取出能够映射“闭嘴”、“说话”和“打哈欠”3类动作的隐匿性行为参数指标。通过嘴部行为的模式识别建立驾驶人异常精神状态的分级预警,用于监测驾驶人的正常驾驶状态、分心状态与疲劳状态。

2 自适应唇色分割

监控图像中嘴唇目标较小,在全局范围内直接检测嘴唇的难度较大。剔除头发、驾驶室背景等无意义的信息,降低动态光照的干扰是嘴唇准确定位的关键。Adaboost和AAM等基于形状规则与样本学习的方法具有强大的目标识别能力,但由于驾驶人面部具有多尺度、多姿态、多干扰等特点,当人脸与嘴唇的形状规则跳出了训练样本的表达范围时,检测容易失效。而基于色度信息与生理先验知识的面部特征识别方法对头部姿态、部分遮挡等因素的容忍度很高,更适合驾驶人面部建模。本文中提出一种基于高斯混合模型(Gaussian mixture model, GMM)[11]的“全局—肤色—唇色”分层局部搜索方法来实现嘴唇定位。

2.1 肤色与唇色估计

RGB图像各分量中均含有亮度信息,易受到环境中光照的干扰。而HSI色彩空间[12]能够很好地分离出光照不敏感分量,适用于复杂环境下的色度分割。如图2所示,在H-S二维色度平面上,皮肤和嘴唇各自具有显著的聚类特性,可采用GMM来进行颜色概率估计。HSI-GMM算法流程如图3所示。为实现精准估计,面部像素的训练样本分为4类:皮肤、嘴唇、低灰度区域(头发、眼睛、鼻孔)与驾驶室背景。各类样本的H和S向量作为特征训练集,再运用高斯混合参数模型估计各类颜色概率密度:

(1)

2.2 自适应唇色建模

光照变化容易致使嘴唇色度与饱和度的聚类分布发生漂移和畸变,传统GMM唇色估计方法易导致漏检、误检等问题,因此提升GMM光照自适应能力成为嘴唇稳定分割的关键。受到文献[13]和文献[14]的启发,本文中针对2.1节中的μlip与Σlip进行GMM自适应参数迭代(adaptive parameter iteration, GMM-API),当唇色在H-S色度平面上发生漂移时,计算漂移状态下的μlip与Σlip。按照μ±Σ原则建立初始矩形Rec1,中心为O1(H,S),如图4所示。设矩形Rec1内像素的质心为O1′(H,S)。由于O1(H,S)与O1′(H,S)并不重合,此时将矩形沿着O1至O1′方向进行移动,移动后的矩形中心为O2。移动矢量为

(2)

3 嘴唇动态匹配模型

3.1 嘴唇特征点集

嘴唇特征模型是在关键特征点的基础上建立的,本文中提出了嘴唇特征点集Clip的概念:

Clip={Pleft,Pright,Pupper,Plower}

(3)

式中:Pleft和Pright是左右嘴角点,由两点距离确定嘴唇的宽度Dwidth;Pupper和Plower分别表示上嘴唇边缘的最高点和下嘴唇边缘的最低点,两点距离定义了嘴唇的张开程度。嘴唇边缘曲线可以由点集Clip进行拟合。

3.2 基于能量信息的角点探测

当前多数文献根据全局灰度信息以及边缘特征进行嘴唇区域的特征匹配。虽然嘴唇具有较强的色度聚类性,但是在复杂光照环境下,嘴唇与皮肤的纹理特征并不显著,单纯依靠边缘信息进行嘴唇特征匹配并不理想。事实上,嘴唇区域还具有较明显的灰度能量信息。图6表示嘴唇区域灰度能量的3D分布,能量角点则位于局部能量域的最大值处。如果建立合理的局部窗口函数进行能量域的梯度检测,则嘴部特征可通过能量角点的形式进行描述。与边缘检测方法相比,该方法能够更充分地提取嘴唇纹理的梯度特征,所提取的嘴唇信息更为充分。

一般认为嘴唇与肤色区域的红色分量比较接近,但测试发现绿色分量更能突显嘴唇的灰度能量信息。本文中首先在Green通道中采用多尺度Retinex法[15]进行嘴唇粗区域的灰度增强,在此基础上采用响应函数R[16]来度量像素的灰度能量:

R=det(M)-kTrace2(M)

(4)

式中:k为权重系数;Trace为矩阵的迹,表示矩阵主对角线上所有元素之和;G为梯度积分的高斯平滑量;ω为高斯平滑函数;Ix和Iy表示Green通道中x与y方向的灰度梯度。当灰度能量R大于设定阈值fT时,则认为存在能量角点Pcorner:

(5)

角点的数量与嘴唇特征匹配效率密切相关。角点过少,会丢失有用的嘴部特征,带来较大的匹配误差;角点过多,则会降低匹配实时性。经过实验测试,取G=2.5~2.8,k=0.05,fT=800,将角点数量控制在40个以内,能够较好地实现匹配速度和精度上的平衡。

3.3 特征角点匹配

嘴唇区域的能量角点整体上比较杂乱,因此需要根据生理先验知识进行角点筛选与匹配,获取图像中最具表征意义的特征角点。匹配算法共分为3步。

步骤1:左右嘴角匹配。在含有q个角点的嘴部区域中,求得角点集质心坐标O(xO,yO):

(6)

求得质心O与任意一角点i的距离DOi。由于嘴唇的形状近似于纺锤,产生最大距离的角点必然对应着左嘴角或右嘴角,若将该点记作P1(x1,y1),则

算例3的电动汽车SOC变化和调制功率变化曲线如图11所示。由图11可知,与算例2相比,算例3的电动汽车在设置的光伏功率波动区间,即在12:00~14:00之间开始放电,SOC下降较快,电动汽车的调制功率在12:00~14:00之间为正,以此来改善母线电压质量。

(7)

同理,距离P1最远角点的必为另一个嘴角P2(x2,y2),P1与P2即为图7中的Pleft与Pright。

步骤2:上下嘴唇特征点匹配。连接点Pleft与点Pright得直线L,其长度为嘴唇的宽度Dwidth。在其余的q-2个角点中,任一角点n与L的距离为

n=1,2,…,q-2

(8)

由于角点被直线L分割为上侧和下侧两部分,则Dn集被分为Dupper和Dlower,见式(9)和式(10)。在Dupper集合中筛选出两个最大值所对应的角点,求其平均坐标作为上嘴唇特征点Pupper。同理,可定位下嘴唇特征点Plower。Pupper与Plower沿垂直于直线L方向上的距离Dheight代表嘴唇张开的程度。

(9)

(10)

步骤3:上下嘴唇边缘拟合。由于光照条件、图像分辨率与设备抑噪性能的限制,运用常规边缘算子直接获取的嘴唇轮廓并不完整。本文中在获得特征点集Clip的基础上,对上下嘴唇边缘进行NURBS[17]三次曲线拟合。NURBS曲线C表达式为

(11)

式中:ωi是对应特征点集Clip-i的权重因子,通常ωi≥0;Ni,k(t)表示规范NURBS曲线的基函数。图7中的两条白色曲线即为NURBS拟合轮廓。

4 嘴部行为模式识别与预警方法

4.1 预警方案

4.2 “打哈欠”行为判据

相对于“说话”和“闭嘴”状态,打哈欠时嘴唇的张开程度更大,持续时间更长,根据这些特征运用嘴唇开启度φ进行判别:

(12)

式中:Dhi为上一节定义的上下嘴唇特征角点的像素距离;Dh0为闭嘴时上下嘴唇特征角点的距离初始值。本文中将初始3s缓存累积图像中最小的25%个Dhi的平均值作为Dh0。若φ超过开启度阈值φth,则驾驶人可能存在“打哈欠”行为。考虑到说话时有可能出现开启度过大而误判为“打哈欠”,本文中引入时间条件进行二次判别:在φ≥φth的条件下开始计算帧数,若超过时间阈值Tth便判定为“打哈欠”,否则认定为“其它”状态。经实验统计,定义φth=1.5,Tth=2s。

4.3 “说话”行为判据

说话时一部分嘴唇姿态近似于“闭嘴”,因此开启度φ并不能作为识别“说话”的判据。但相对于“闭嘴”状态,说话时开启度φ更具有时序上的波动特性,因此,本文中采用样本方差S2进行评价:

(13)

5 实验结果分析

图像采集装置安装在仪表盘内,约25°仰视拍摄驾驶人面部,图像大小为1080×720,帧率为20fps。视频分别在晴天、阴天、树木与建筑遮挡的道路环境下进行采集,确保样本光照条件的多样性,以充分验证唇色分割的光照鲁棒性与动态匹配模型的有效性。测试对象为18名驾驶人(12男6女),在安全驾驶的前提下完成嘴部动作,获得视频样本数量240组(共计358 032帧),其中“闭嘴”、“说话”和“打哈欠”行为的样本分别为77组、92组和71组。

5.1 唇色分割的鲁棒性实验

针对不同光照与嘴部动作的图像(共计9 215帧)进行唇色分割实验。图9为两组唇色分割结果,第一组测试的光照均匀,第二组的光照变动频繁。图中A,B和C轮廓分别是由GMM-API,GMM和HSI恒定阈值3种算法实现的嘴唇分割,对比可见GMM-API算法对嘴唇轮廓的还原性更好。图10为光照频繁变动环境下的唇色面积检测结果。GMM与HSI恒定阈值法检测结果的波动性很大,而GMM-API具有自适应收敛特性,能有效克服光照变化引起的唇色漂移,分割的唇色面积更为稳定,这是本文中嘴部行为识别与预警准确率较高的内在原因之一。

5.2 特征点匹配实验

(14)

表1 匹配误差i,e与匹配精确率ξi

5.3 嘴部行为模式识别与预警实验

实验针对“闭嘴”、“说话”和“打哈欠”行为的表征参数开展测试。图12为6名驾驶人分别进行“说话”和“打哈欠”的开启度φ曲线,波动范围分别为0.8~1.5和2~2.5,具有显著的可分性。“打哈欠”持续时间均大于4s,由于设定时间阈值Tth来进行二次判别,因此疲劳预警存在2s延迟。测试发现,φth和Tth是一对“此消彼长”的矛盾关系。提高开启度阈值φth会相应提高“说话”的识别率,但也会降低“打哈欠”识别的时间宽裕度,导致疲劳预警准确率下降。而降低φth又会导致一些“说话”行为被认定为“其它”,增加“正常驾驶”的误警率。大量实验证明,φth=1.5,Tth=2s能够最大程度上准确识别“说话”和“打哈欠”行为。

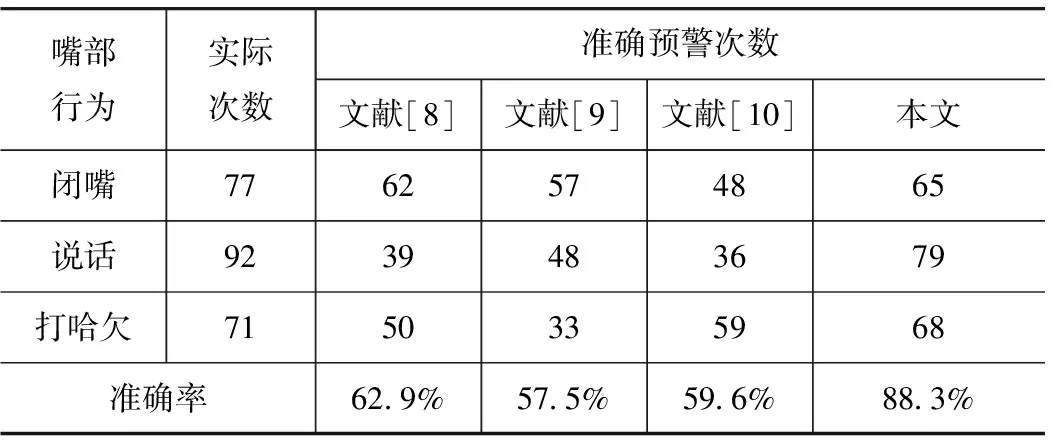

针对240组行为样本开展分类预警实验,同时采用其它文献[8-10]的算法进行对比测试,预警准确率的统计见表2。文献[8]中采用简单的嘴唇色度分布与像素数量来识别“打哈欠”等动作,但未充分考虑个体差异性与嘴唇轮廓的纹理特性,因此在实际驾驶场景中的适应性不足。文献[9]中依据嘴唇面积与高宽比来识别嘴部动作,由于未引入嘴部动作的时域特性,故无法有效区分“说话”与“打哈欠”行为。文献[10]中通过灰度水平投影结合二维Gabor滤波来识别嘴唇开闭状态,该方法在动态光照的干扰下识别效果不佳。与上述方法相比,本文中算法有针对性地考虑了驾驶室光照干扰与嘴唇动作的幅频特性,更适用于驾驶人嘴部行为识别与分级预警。由于“打哈欠”行为在开启度φ与时域空间上具有显著的可识别特征,该行为的预警准确率较高,达92.9%。而说话时嘴部动作随机而复杂,发音方式和语速也有很大的个体差异,因此“说话”行为的预警率相对较低,为85.8%。

表2 预警准确率

6 结论

以驾驶人精神状态分级预警为目标,提出了一种基于机器视觉的嘴部行为识别方法。首先在HSI色彩空间中运用GMM分割肤色与唇色区域。考虑动态光照的干扰,运用GMM-API改进算法进行唇色的自适应参数迭代,有效提高了嘴唇区域分割的完整性与准确性。建立了基于灰度能量角点的嘴唇动态匹配模型,准确描述左右嘴角与上下嘴唇特征点并有效提取嘴部运动参数,在此基础上建立嘴部行为的识别模式,实现驾驶人精神状态的分级预警。实验结果表明,提出的嘴唇动态模型具有较高的特征匹配精度和鲁棒的动作适应能力,各特征点的匹配精度在85.8%以上。算法能够有效检测“闭嘴”、“说话”和“打哈欠”行为,分心预警和疲劳预警检测精度分别达到85.8%和92.9%。在今后的研究中,拟将嘴部行为与眼睛运动和头部姿态等行为进行信息融合,实现基于复合指标的驾驶人精神状态安全预警。

[1] 李克强.汽车技术的发展动向及我国的对策[J].汽车工程,2009,31(11):1005-1016.

[2] 程文冬,付锐,袁伟,等.驾驶人疲劳监测预警技术研究与应用综述[J].中国安全科学学报,2013,23(1):155-160.

[3] 成波,孟传,张伟.基于机器视觉的驾驶员注意力状态监测技术研究[J].汽车工程,2009,31(12):1137-1140.

[4] Ishigami Y, Klein P M. Is a Hands-free Phone Safer Than a Handheld Phone?[J]. Journal of Safety Research,2009,40(2):157-164.

[5] Azim T, Jaffar M A, Mirza Anwar M. Fully Automated Real Time Fatigue Detection of Drivers Through Fuzzy Expert Systems[J]. Applied Soft Computing,2014(18):25-38.

[6] Hong S J, Sarang Khim, Phill Kyu Rhee. Efficient Landmark Localization Using Spatial-Contextual Adaboost Algorithm[J]. Journal of Visual Communication and Image Representation,2014,25(6):1366-1377.

[7] Lee S J, Park K R, Kim J.A Comparative Study of Facial Appearance Modeling Methods for Active Appearance Models[J]. Pattern Recognition Letters,30(14):1335-1346.

[8] Abtahi S, Hariri B, Shirmohammadi S. Driver Drowsiness Monitoring Based on Yawning Detection[C]. Instrumentation and Measurement Technology Conference (I2MTC),2011 IEEE,2011:1-4.

[9] 周云鹏,朱青,王耀南,等.面部多特征融合的驾驶员疲劳检测方法[J].电子测量与仪器学报,2014,28(10):1140-1148.

[10] Fan X, Yin B C, Sun Y F. Yawning Detection for Monitoring Driver Fatigue[C]. Machine Learning and Cybernetics,2007 International Conference on, IEEE,2007,2:664-668.

[11] Kakumanu P, Makrogiannis S, Bourbakis N. A Survey of Skin-color Modeling and Detection Methods[J]. Pattern Recognition,2007,40(3):1106-1122.

[12] Ban Y, Kim S, Kim S, et al. Face Detection Based on Skin Color Likelihood[J]. Pattern Recognition,2014,47(4):1573-1585.

[13] Cheng Y Z. Mean Shift, Mode Seeking and Clustering[C]. IEEE Transactions on Pattern Analysis and Machine Intelligence, IEEE,1995:790-799.

[14] Cho K M, Jang J H, Hong K S. Adaptive Skin-Color Filter[J]. Pattern Recognition,2001,5(34):1067-1073.

[15] Kimme R , Elad M, Shaked D, et al. A Variational Framework for Retinex[J]. International Journal of Computer Vision,2003,52(1):7-23.

[16] Chen L, Lu W, Ni J, et al. Region Duplication Detection Based on Harris Corner Points and Step Sector Statistics[J]. Journal of Visual Communication & Image Representation,2013,24(3):244-254.

[17] Ding H, Hong Y. NURBS Curve Controlled Modeling for Facial Animation[J]. Computers & Graphics:2003,27(3):373-385.

汉地润滑科技(中国)有限公司新品发布会盛大召开

2015年9月14日,汉地润滑科技(中国)有限公司“传承质造 润赢天下”新品发布会于北京嘉里大酒店顺利召开。本次发布会昭示汉地润滑油将传承上游基础油产业链的优势,以塑造“中国第四桶油”的宏大愿景,强势打造高端润滑产业链及世界知名润滑油品牌。行业内外的重量级嘉宾、媒体和合作伙伴等近200名来宾莅临现场、济济一堂,共同见证和开启汉地润滑油的新时代。

汉地润滑科技(中国)有限公司一举发布了14款新品,涵盖氢劲、氢龙系列11款车用润滑油,3款防冻液,宣告了汉地润滑科技(中国)有限公司正式进军国内润滑油市场。

汉地润滑科技(中国)有限公司旨在整合上、下游产业链,打造一个自有润滑油产业链。汉地润滑科技(中国)有限公司将依托领先的HYDROPURE氢纯技术,牢牢把控润滑油产品质量,做好油,为渠道、为客户提供最优质的产品及服务,打造最具价值的高端润滑油品牌。在未来,汉地润滑科技(中国)有限公司也将采取资本联合方式,与国内外的润滑油品牌厂商进行多种形式的合作,共享价值、共赢未来!

Driver Mouth Behavior Recognition and HierarchicalPrewarning Based on Dynamic Matching Model

Fu Rui1, Cheng Wendong2,3, Zhang Mingfang2, Yuan Wei2, Liu Zhuofan2& Guo Yanjun2

1.Chang’anUniversity,KeyLaboratoryofAutomotiveTransportationSafetyTechnology,MinistryofCommunication,Xi’an710064;2.AutomobileCollege,Chang’anUniversity,Xi’an710064; 3.SchoolofMechatronicEngineering,Xi’anTechnologicalUniversity,Xi’an710032

In view of that mouth behaviors can reflect different mental states of driver, a machine vision-based mouth behavior recognition and mental state prewarning method for driver is proposed in this paper. Firstly an improved Gaussian mixed model is adopted for light-adaptive lip segmentation. Then a dynamic matching model for lip region is proposed based on gray-scale energy corners to describe lip features and extract mouth movement parameters. Finally a discrimination pattern of mouth behavior is built to fulfill the hierarchical prewarning of driver’s mental states. Experimental results demonstrate that the dynamic matching model proposed has high matching accuracy in mouth features and strong adaptability to mouth movement. The algorithm can effectively detect the mouth behaviors of “closed”, “speaking” and “yawning”. The monitoring accuracies of distraction and fatigue prewarning reach 85.8% and 92.9% respectively.

mouth behaviors; Gaussian mixed model; energy corners; dynamic matching model; hierarchical prewarning

*长江学者和创新团队发展计划项目(IRT1286)、国家自然科学基金(61374196和61473046)和中央高校基本科研业务费专项资金(2013G2221006,2013G1502060和2013G1502062)资助。

原稿收到日期为2014年9月25日,修改稿收到日期为2015年4月28日。