基于RGB-D数据集的无参数图像深度估计算法

2014-02-09于海鹏

于海鹏,魏 涛

(河南工程学院计算机科学与工程系,河南郑州450007)

0 引 言

立体成像和三维重建已经成为人们所关注的一个热点。对于立体成像,首先需要提取出二维图像的第三维信息,即深度估计。因此,从单张图片有效地估计出深度信息是计算机视觉领域的一项重要研究内容。传统的深度估计方法主要集中于基于双目视差的方法[1,2],基于相机运动的方法[3,4]和基于变焦[5]或散焦[6]的方法等。这些方法往往需要一个或两个图像采集设备来拍摄相同场景的两张或多张图像。而且无一例外的,它们都需要事先知道图像采集设备的参数,知道图像是由什么型号的设备拍摄得到,然后通过复杂的空间几何关系或者图像中的点扩散函数得到图像的深度信息。而在实际情况中,往往只有图像而没有图像采集设备的任何参数。因此,在没有相机参数而仅用单张图片的来估计场景深度的方法具有更广泛的实际应用意义。最近,陆等人[7]提出一种针对单张图片获取深度信息的算法,该算法是一种基于Markov随机场模型对图像建模来获取图像深度信息。但在模型的建立过程中对图像进行的分割方法仍有一定的改进,采用不同的分割方法也会导致得到的深度信息不同。提出了一种针对单张图像的场景深度估计算法,中心思想是建立在不同图像中具有相同语义,即不同图像中相似的物体,假设它们具有相似的深度信息。利用Make3D[8]数据集,该数据集是利用三维激光测距仪(SICK LMS-291)得到的一组场景图及其相对应的深度图,在该数据集中利用全局GIST[9]特征进行全局匹配,并利用稠密SIFT[11]特征进行局部匹配,查询到与测试图最相似的K张图像,然后通过提出的前提假设,将相似图片及其深度图利用SIFT流[12]变形得到测试图的深度图。

1 图像匹配及变形的关键技术

1.1 GIST特征

GIST一种宏观的全局特征描述符,利用自然度、开放度、粗糙度、扩张度和崎岖度等物种语义词汇来描述自然场景。GIST特征是通过多种尺度多个方向的Gabor滤波器组对图像滤波后得到的轮廓信息。其中Gabor滤波器的表达式为

式中:x和y——图像像素坐标位置,σx和σy——x和y方向Gaussian因子的方差,f0——滤波器中心频率,φ——该谐波因子的相位差。利用Gabor滤波器对图像进行特征提取的实质就是将一组Gabor小波函数基与图像进行卷积操作。从而对输入的图像用一种鲁棒的全局特征来表示[12]。

1.2 SIFT特征及稠密SIFT描述

SIFT算法是在基于图像的特征尺度在不同的尺度空间上查找关键点,首先通过高斯卷积核来实现图像的尺度变换,建立多尺度空间,尺度空间使用高斯金字塔表示。然后检测尺度空间的关键点,关键点则是由尺度空间的局部极值点组成的,这些极值点的初步探查是通过尺度空间中各相邻两层图像之间比较来完成的。为了寻找尺度空间中的极值点,每个像素点都要与相邻的所有点进行比较,在尺度空间的中间层的检测点与同尺度的8个相邻点和上下相邻尺度对应的9×2个点比较,确保在尺度空间和二维图像空间都检测到极值点[14]。如果它比图像域和尺度域的相邻点都大或者比它们都小,则认为该点是极值点。然后将这些检测到的粗略的极值点的边缘响应点以及低对比度的关键点删除,这样可以得到更为精确的特征点用于后续的匹配操作,增强匹配的准确性。

为了使得特征点的描述符具有旋转不变性等特点,需要首先利用图像的局部特征来给每一个检测出的关键点在一定的领域内分配一个基准方向,使用图像梯度的方法求取局部结构的稳定方向。该基准方向通过在完成关键点的梯度计算后,使用直方图统计邻域内像素的梯度和方向,以直方图中最大值作为该关键点的稳定方向。再为每个关键点建立一个特征描述符,用一组向量将这个关键点描述出来,使其不随光照和视角等变化而改变[15]。将特征点的邻域划分成16个4×4像素大小的子块,然后计算每个子块在360度中平分的8个方向上的梯度直方图,最后将每个特征点表示为一个128维特征向量[16]。

SIFT特征是一种稀疏特征描述符,是在图像中检测极值点并提取出特征。而稠密SIFT则是取消检测图像中的极值点。即对图像中每个像素点的领域分成16个4×4像素大小子块,然后得到其SIFT特征。这种对每个像素求得的SIFT描述称为稠密SIFT描述符[17]。

1.3 SIFT流

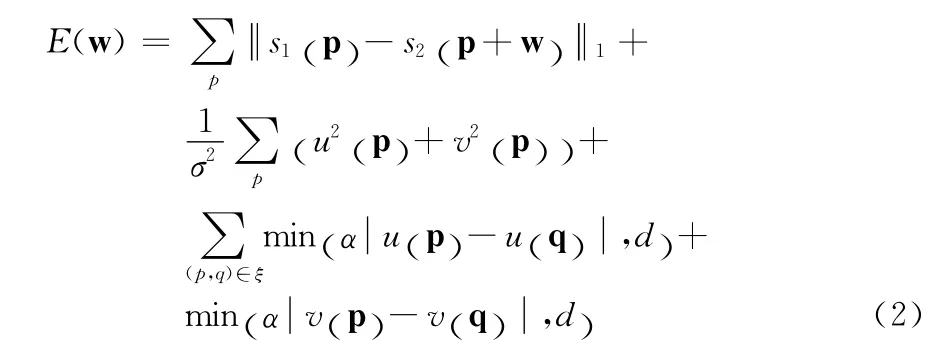

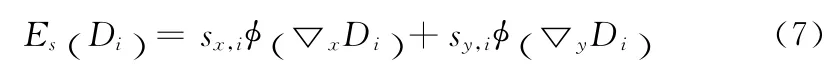

与光流相似,定义一个目标函数来估计两图像之间的SIFT流。SIFT流的计算过程为:首先提取图像每一个像素的SIFT描述符,即稠密SIFT描述符,然后对相邻帧图像计算图片中点的运动流场。SIFT流能量方程函数定义为

其中w(p)=(u(p),v(p))是图像P点的流矢量,si(p)代表图像i在像素p点的SIFT描述符,ξ是像素p点的领域。相对于传统光流技术,SIFT流对尺度、旋转和仿射变换等具有更强的鲁棒性。

2 无参数深度估计算法

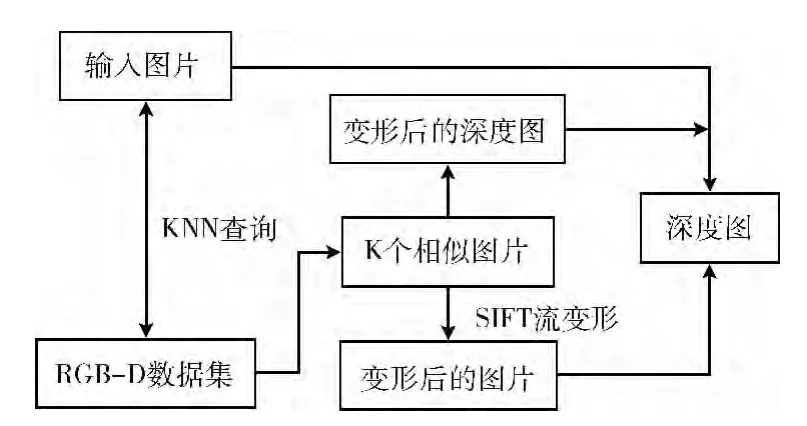

无参数深度估计算法分为3个阶段,工作流程如图1所示。

图1 无参数深度估计流程

首先给定输入图片后,在RGB-D数据集中查询到与输入图片最相似的K张图片。然后,利用SIFT流将查询到的图片及其对应的深度图变形到输入图片更加一致。最后,通过输入图片,变形图片以及变形后的深度图构造能量函数并最小化来得到最后的深度图。

2.1 相似图片查询

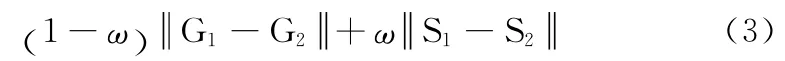

为了找到与输入图片最相似的K张图片,通过GIST特征及稠密SIFT特征的共同作用来查找相似图片。对输入图片与数据集中每张图片通过计算下式得到相似值

初到广州的五建迅速瞄准和服务华南市场。但与此同时,五建面临着依赖传统工程建设项目、效益增长方式单一、市场投资领域变化、生产方式转变、资源环境和生产要素制约以及劳动力成本上升等问题。眼见传统工程建设的路越来越窄,未来如何生存已经成为不得不思考的问题。“我们清醒地认识到,只有加快企业转型升级步伐,开发新的效益增长领域,企业才能焕发出新的生机和活力。”五建党委书记蒋德军说。

其中G1、G2和S1、S2分别代表两张图片的GIST特征和稠密SIFT特征,将前K个取得最小值的图片作为最相似的图片,称为候选图片,并将它们的深度图作为候选深度图。

2.2 相似图片及其深度图的变形

通过计算出的候选图片与输入图片具有最相似的特征空间,因此理论上这些图片与输入图片在场景级别上或是物体级别上具有更一致的语义信息。假设基于相同语义的物体具有相似的深度估计,为了得到更准确的估计,更希望相似图片与输入图片在像素级别上具有更一致的语义信息,通过SIFT流的变形方法可以实现。

首先将输入图片与每张候选图片计算出SIFT流,通过SIFT流得到相应的变形函数。再将每张候选图片通过各自的变形函数即SIFT流的逆向变形,变形到与输入图片在像素级别上具有更一致的语义信息。另外,每张候选图片的深度图也同样以相同变形函数变形。

2.3 深度图估计

根据假设,具有相同语义的场景、物体和像素具有相似的深度信息。因此,每张变形后的候选图片与输入图片具有大致相等的深度信息。但这些候选图片必然会包含一些不准确的信息。而且由于候选图片经过变形后会导致对应的深度信息在空间上不够光滑,需要将K张候选图片的深度信息综合考虑,优化如下能量函数,得到输入图片的深度图,并使得深度图满足空间光滑性

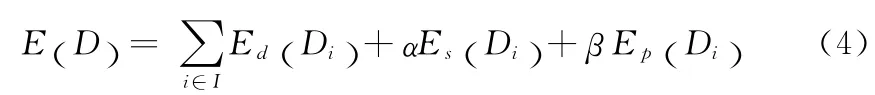

式中:D——深度,i——图像的像素,I——输入图片。该目标函数包括3项:数据项Ed(Di),空间光滑项Es(Di)以及先验项Ep(Di)。

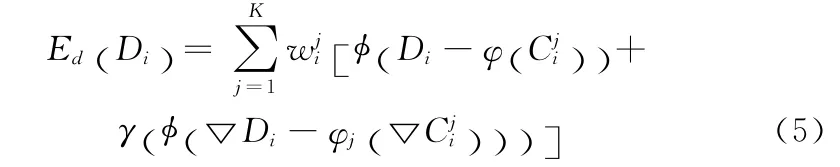

数据项Ed(Di)用来控制输入图片的深度与变形后的候选图片深度的相似程度,相似程度用来测量,ξ=10-4,(x)值越小则越相似。数据项定义为

S代表稠密SIFT特征。数据项中第一项使得输入图片的深度信息与变形后的候选图片深度信息尽量保持一致。第二项使得输入图片的深度图与变形后的候选图片深度图的梯度保持一致。

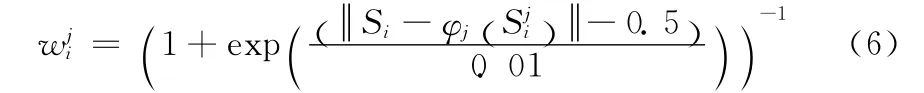

空间光滑项Es(Di)使得输入图片的深度信息在图像的光滑区域也保持光滑性。即使得输入图像与其深度图的梯度信息保持一致

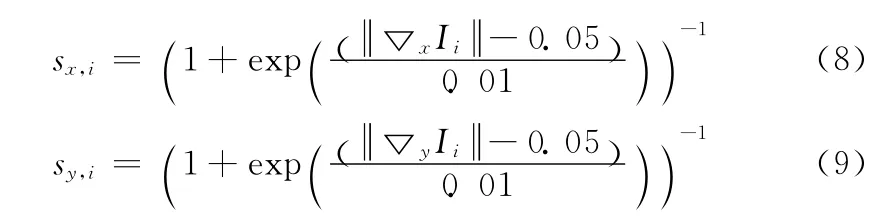

其中权重为

能量函数中还包括了输入图片深度图的先验信息。先验信息根据查询到的K张相似图片的深度信息得到

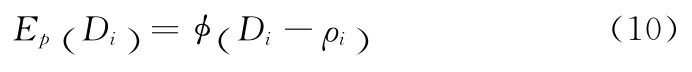

式中:ρ——输入图片深度图的先验信息,通过计算K张候选图片深度图的平均值得到

通过迭代重加权的优化方法可以得到能量函数的最小值。

3 实验结果与分析

RGB-D数据集来自Make3D数据中。数据集中包括534张分辨率为2272×1704的图像。采用其中400张作为训练集,134张作为测试集。实验参数设置为:K=7,α=10,β=0.5,γ=10。实验结果如图2所示。

图2 场景图及不同方法估计的深度

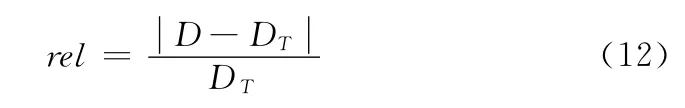

在图2中,图2(a)(上)为Make3D数据集中134张测试集中的场景图,图2(b)(中)为由Make3D方法得到的深度图,图2(c)(下)为改进算法得到的深度结果图。深度图中黑色为最近,白色为最远。通过计算得到的深度图像与真实深度值的相对误差来比较深度图像估计的准确性,计算公式为

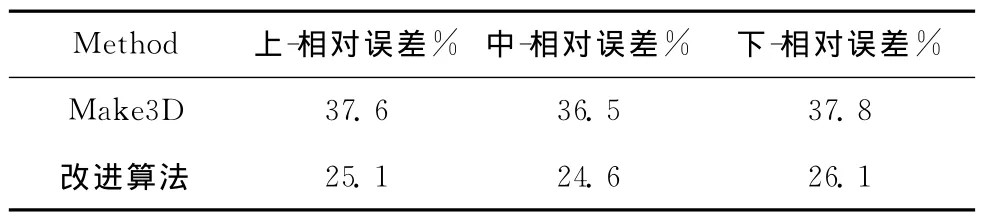

其中D代表估计深度,DT代表真实深度。与图2对应的相对误差数值比较见表1。

表1 三幅图片的Make3D和改建算法相对误差

从表1中可以看出,通过与Make3D的方法进行比较,平均相对误差降低了12.03%,改进的算法得到的深度图可以更好的反应场景的真实深度,比如图中的树叶部分等一些细小的特征区域。实验中仅使用了Make3D数据集中的400张作为训练集。理论上,如果使训练集更加完善,使训练集中包含更多的场景信息,改进的算法会得到更准确的深度估计。

4 结束语

提出了一种无参数的场景图片深度估计算法,在RGBD数据集的基础上,基于相同语义的物体具有相似深度信息的假设,在数据集中查询到与输入图片最相似的K张图片,通过变形使相似图片与输入图片具有更相似的结构信息,最后通过最小化能量函数得到最终的图像深度图。由于不需要任何图像采集设备的参数以及空间几何关系,所以在其它基于双目视差或运动视差等方法失效的情况下,依然可以有效地计算得到场景深度信息。经过实验证明,该方法可以有效地估计场景的深度图,改进算法的无参数特性在相机参数及空间几何关系未知的情况下仍能有效计算场景深度信息,比Make3D算法的平均相对误差降低了12.03%,具有更广泛的实际应用价值。

[1]WANG Jian,WANG Yuanqing.A monocular stereo vision algorithm based on bifocal imaging[J].Robot,2007,29(1):41-44(in Chinese).[王剑,王元庆.基于双焦成像的单眼立体视觉算法[J].机器人,2007,29(1):41-44.]

[2]WANG Chuanyu,ZHAO Ming,YAN Jianhe,et al.Three-dimensional reconstruction of maize leaves based on binocular stereovision system[J].Transactions of The Chinese Society of Agricultural Engineering,2010,6(4):198-202(in Chinese).[王传宇,赵明,阎建河.基于双目立体视觉技术的玉米叶片三维重建[J].农业工程学报,2010,6(4):198-202.]

[3]WANG Aihong,WANG Qionghua,LI Dahai,et al.Relation-ship between stereo depth and parallax image captured in stereoscopic display[J].Optics and Precision Engineering,2009,17(2):433-437(in Chinese).[王爱红,王琼华,李大海,等.立体显示中立体深度与视差图获取的关系[J].光学精密工程,2009,17(2):433-437.]

[4]JIANG Taiping,WANG Shuai,ZHAN Tao.Generation technique research of depth information based on motion estimation[J].Computer Technology and Development,2010,20(10):94-97(in Chinese).[姜太平,王帅,占涛.基于运动估计的深度信息生成技术研究[J].计算机技术与发展,2010,20(10):94-97.]

[5]WANG Haiyang,LI Li,JIN Ning,et al.Design of MWIR continuous zoom optical system with large zoom range[J].Infrared and Laser Engineering,2013,42(2):398-402(in Chinese).[王海洋,李力,金宁,等.大变倍比中波红外连续变焦光学系统设计[J].红外与激光工程,2013,42(2):398-402.]

[6]FAN Chongyi,HUANG Xiaotao.Moving target detection based on multiple azimuth resolution images in low frequency SAR[J].Journal of Electronics &Information Technology,2012,34(5):1057-1064(in Chinese).[范崇祎,黄晓涛.基于多方位分辨率图像的低频SAR地面运动目标检测方法[J].电子与信息学报,2012,34(5):1057-1064.]

[7]LU Zhenjie,SONG Jin.Scene depth estimation for single digital image in multi-scaled space[J].Computer Technology and Development,2013,23(1):51-53(in Chinese).[陆振杰,宋进.单幅数字图像多尺度空间下的场景深度估计[J].计算机技术与发展,2013,23(1):51-53.]

[8]Saxena A,Sun M,Ng A.Make3D:Learning 3D scene structure from a single still image[J].IEEE TPAMI,2009(31):824-840.

[9]QIAN Pengjiang,WANG Shitong,DENG Zhaohong.Fast kernel density estimate theorem and scaling up graph-based relaxed clustering method[J].Acta Automatica Sinica,2011,37(12):1422-1434(in Chinese).[钱鹏江,王士同,邓赵红.快速核密度估计定理和大规模图论松弛聚类方法[J].自动化学报,2011,37(12):1422-1434.]

[10]LI Peihua,ZHAO Nannan,YU Haiyang.Appearance modeling using dense SIFT features for object tracking[J].Journal of Natural Science of Heilongjiang University,2011,28(4):571-576(in Chinese).[李培华,赵楠楠,于海洋.使用稠密SIFT特征表达目标的跟踪方法[J].黑龙江大学自然科学学报,2011,28(4):571-576.]

[11]CHEN Hailin,WU Xiuqing,HU Junhua,et al.Densityguided tree-structured kernel for image object classification[J].Journal of Image and Graphics,2009,14(12):2545-2551(in Chinese).[陈海林,吴秀清,胡俊华,等.基于密度导向的树型结构核的图像目标分类[J].中国图象图形学报,2009,14(12):2545-2551.]

[12]Pechaud M,Vanzetta.Sift-based sequence registration and flow-based cortical vessel segmentation applied to high resolu-tion optical imaging data[C]//5th IEEE International Symposium on Biomedical Imaging:From Nano to Macro,2008:720-723.

[13]SONG Dan,TANG Linbo,ZHAO Baojun.SIFT mismatching points eliminating algorithm based on region overlapping kernel weighted Hu moment[J].Systems Engineering and Electronics,2013(4):870-875(in Chinese).[宋丹,唐林波,赵保军.基于区域重叠核加权Hu矩的SIFT误匹配点剔除算法[J].系统工程与电子技术,2013(4):870-875.]

[14]Liu C,Yuen J,Torralba A.SIFT flow:Dense correspondence across scenesand its applications[J].IEEE TPAMI,2011(33):978-994.

[15]LAN Jianliang,DING Youdong,HUANG Dongjin,et al.Depth estimation of single image based on multi-scale texture energy measure[J].Computer Engineering and Design,2011,32(1):224-227(in Chinese).[蓝建梁,丁友东,黄东晋.基于多尺度纹理能量测度的单幅图像深度估计[J].计算机工程与设计,2011,32(1):224-227.]

[16]YU Jiangde,WANG Xijie,YU Zhengtao.Semantic role labeling based on maximum entropy model[J].Microelectronics &Computer,2010(8):173-176(in Chinese).[于江德,王希杰,余正涛.基于最大熵模型的语义角色标注[J].微电子学与计算机,2010(8):173-176.]

[17]TANG Yonghong,LIU Xudong.An anomaly detection method based on mixed attribute dataset[J].Science Technology and Engineering,2013,13(7):1832-1835(in Chinese).[唐永红,刘绪栋.一种基于混合属性数据集的异常检测方法[J].科学技术与工程,2013,13(7):1832-1835.]