人工智能赋能课堂反馈的伦理困境及风险化解

2022-03-27罗江华王琳刘璐

罗江华 王琳 刘璐

摘要:人工智能(AI)技术为课堂教学反馈带来质效提升的同时,其引发的一系列伦理问题也日益受到关注。对应用个案的系统分析有助于揭示此类伦理困境产生的深层次原因。基于对X中学课堂反馈AI系统的开发者以及教师、学生等应用者的访谈,通过三级编码分析构建的“内因—外缘”解释模型表明:课堂反馈AI系统应用的伦理困境主要由算法陷阱引起,表现为算法黑箱与算法歧视;由于算法规则的不透明和偏向性,课堂智能反馈过程呈现出数据失信、数据滥用和隐私侵犯等现象,诱发了权力失范、关系失衡、情感异化等外发风险;这些风险表现为“师端”的教育自主权让渡,“生端”的学习自主性丧失、过度情感劳动以及情感遮蔽等。化解AI赋能课堂反馈的伦理风险,应该规避算法黑箱和算法歧视,主张师生对算法规则有知情权,以学生的主动性和发展性为落脚点完善法律法规对抗算法歧视;制定数据伦理规约,确保教育数据与师生隐私的安全;建立师生与AI之间的双向平等关系,强化人机协作效用;揭示学生情感变化规律,发展师生的积极情感关系。

关键词:人工智能;课堂反馈;算法陷阱;伦理风险

中图分类号:G434 文献标识码:A 文章编号:1009-5195(2022)02-0029-08 doi10.3969/j.issn.1009-5195.2022.02.004

基金项目:2021年度国家社科基金教育学重点项目“以新基建支撑高质量教育体系建设研究”(ACA210010)。

作者简介:罗江华,博士,教授,博士生导师,西南大学西南民族教育与心理研究中心(重庆 400715);王琳,博士研究生,西南大学西南民族教育与心理研究中心(重庆 400715);刘璐,硕士,中学二级教师,太原市第六十三中学校(山西太原 030021)。

一、问题的提出

人工智能(Artificial Intelligence,AI)通过分析课堂教学活动过程,能够为教学反馈提供新思路,为个性化教学提供新方法(孙众等,2020)。许多学校与企业合作,尝试研制出学生课堂反馈AI系统,使教学反馈实现从依赖教师观察、作业反馈与测验反馈向自动化、智能化、精准化与过程化反馈转变。但AI在提升课堂教学反馈质效的同时,也带来了巨大的挑战:“计算主义”至上的学习分析方式有悖于教育系统的复杂性(顾小清等,2020);大规模采集生理信息数据的做法侵犯了学生隐私(唐汉卫等,2020);出现“算法囚徒”的风险,甚至某些算法会不断强化自身的隐性控制,增强算法的监控属性(彭兰,2021)。值得深思的是,AI介入课堂是增强课堂反馈还是强化课堂控制?要实现AI与课堂教学反馈之间的“加法”,应当是计算机科学、心理学、教育学、社会学和伦理学等多学科融通的结果。

本研究始于X中学课堂反馈AI系统应用引发的媒体争议。X中学与H公司以提升课堂反馈效率为目标,以采集和分析学习行为数据、表情数据和认知数据为策略,合作研制了X中学课堂反馈AI系统。该系统却被媒体称为“黑科技”“天眼”“刷脸神器”“窗外的班主任”等,认为其造成了“无形的压力”“全天把神经绷紧”“情绪压抑”等负面影响。本研究对X中学课堂反馈AI系统的应用进行追踪,旨在透过应用进程中的“故事”,探析AI应用于课堂反馈的伦理困境及成因,并嘗试提出解决方案。

二、文献回顾

1.AI赋能课堂反馈的技术实现

传统的课堂教学反馈方式具有主观性强、样本量较小、费时费力以及滞后性等局限(吴立宝等,2021)。AI技术的出现,推动了课堂教学反馈通路的变革,实现了高效、动态、精准、智能以及自动化的反馈过程(赵瑞斌等,2021)。AI技术将摄像头、拾音器等采集的师生行为、语音、面部表情、生理信号等复杂生理特征数据化,并自动学习数据的隐形结构与内在规律,探测学习者内隐的认知与情绪状态,助力课堂反馈(刘清堂等,2019)。

AI技术支持的课堂反馈研究主要从课堂行为识别、情绪计算、多模态数据融合等路径着手。Whitehill等(2014)通过对学习者面部表情数据的采集与计算,推断其学习参与度,增强教师对学习者参与情况的及时感知;韩丽等(2017)应用人脸检测与面部表情识别技术,分析认知行为与头部姿态、面部表情的关系;曹晓明等(2019)基于脸部图像、脑电波数据以及学习日志等多模态数据集,分析学生学习参与度和活跃度。AI赋能课堂反馈呈现出学习过程监测化、认知状态可视化等趋势。但AI的融入并未为课堂教学带来深层次、大规模和结构性的变革(钟绍春,2020)。AI可提高效率和准确性,但AI的误用会对学生产生危害,而当危害发生时,AI的应用风险可能被放大,甚至带来诸多偏见(Wang,2021)。

2.AI赋能课堂反馈的本体局限与伦理问题

AI为课堂反馈带来便捷高效的同时,也冲击和改变了整个课堂教学生态,并诱发了一系列伦理问题(吴河江等,2020)。事实上,AI的课堂应用仍处于以深度学习为基础的弱人工智能阶段,其算法实现呈现高效率与过度控制的“双刃剑”效应,彰显出AI技术自身的局限性(莫宏伟,2018)。一方面,面部与行为识别虽能采集并分析出个体的内在情绪状态,但其依赖摄像追踪和语料采集所获得的数据常常过于碎片化和缺乏规律性,无法有效进行数据融合和兼容计算(李新等,2019)。另一方面,教育过程的复杂性和教育数据的非结构性决定了教师教学过程和学生学习过程的数据不可能得到完整记录,一些和教学行为高度关联的数据常因难以数字化而缺失(赵佳丽等,2020);此外,数据挖掘获得的个体行为和情绪数据,也不一定能准确解释深层次的学习发生机制(顾小清等,2016)。

不少研究也指出了AI技术应用于课堂反馈可能引发伦理风险。首先,面部表情与内在情绪有着复杂而非一一对应的关联(黄丽凤等,2010),简单应用数据表征学习者情绪有量化、标签化教育主体的嫌疑(苏明等,2019)。其次,判定行为、面部表情与个体内在情感之间的关系,需要采集海量数据,严重威胁教育主体隐私安全(Berendt et al.,2020)。再次,过度的行为与面部表情识别易将课堂文化引向控制和规训(安涛,2020)。最后,对学生的内心情绪进行制度化地窥探与导引,学生将被迫进行学习活动之外的情感劳动(程猛等,2021)。如要为学习者搭建促进其学习的智能化学习环境,需重点探析愈来愈普遍的人工智能教育应用中的伦理风险,建构对人工智能教育应用伦理限度的正确认识(李政涛,2020)。

三、研究设计

本研究基于扎根理论,观察X中学课堂教学,并对X中学校长与H公司7名算法工程师分别进行5轮与1轮的深度访谈,对11位教师与20名学生进行2轮焦点小组访谈,之后依托三级编码分析数据并构建解释模型,探究X中学课堂反馈AI系统应用诱发伦理问题的深层次原因。编码分为三个步骤:第一步,通过开放式编码将历时一年的课堂观察资料、系统日志、访谈资料进行逐条分析、归类与概念生成;第二步,通过主轴编码将导致伦理问题的概念类属建立联结,生成主要类属;第三步,通过选择编码对主要类属进行整合与精炼,得出核心类属,并解释主要类属之间的关系。

收集的资料涉及两方面主题:一是系统研发愿景及与结果匹配的情况,包括分析系统的正向激励作用,对教师、学生和家长之间有效沟通的强化作用等。二是算法实现的办法,包括学生专注度、参与度判定算法模型的设计思路,分析算法与学生心理安全感、师生关系、情感激励之间的关系。

研究者对收集到的资料进行整理,最终得到7万余字的访谈记录;随机选择2/3的访谈记录进行编码分析和模型构建,剩余1/3的访谈记录留作理论饱和度检验。

四、资料分析

1.数据编码与分析

(1)开放式编码

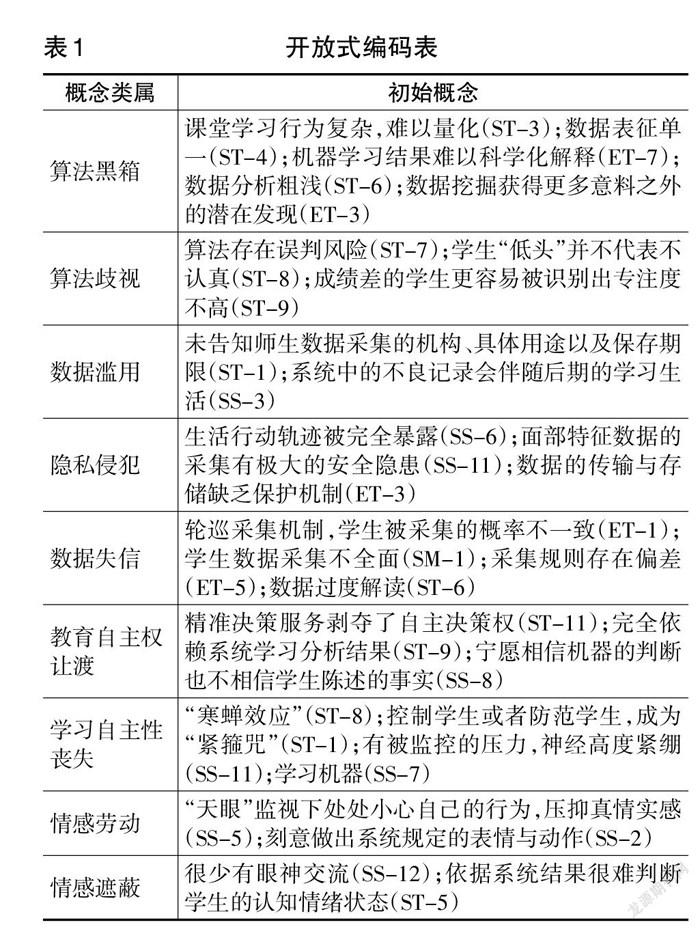

经过多次反复阅读和比较,最终形成9个初始概念类属(如表1所示):算法黑箱、算法歧视、数据滥用、隐私侵犯、数据失信、教育自主权让渡、学习自主性丧失、情感劳动、情感遮蔽。

(2)主轴编码

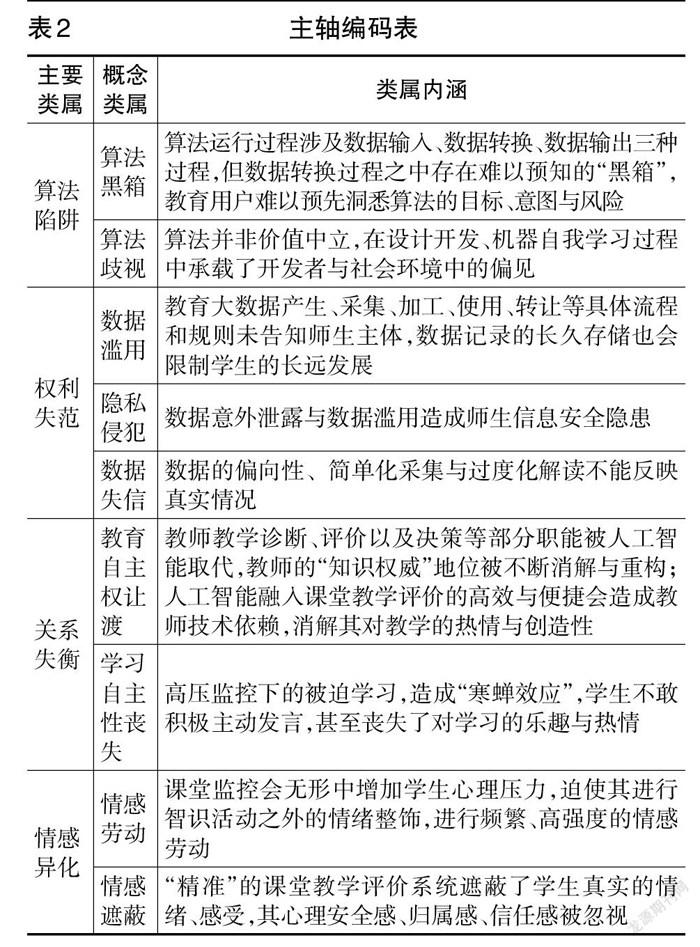

在开放式编码基础上挖掘概念类属之间的关系逻辑,最终形成4个主类属(如表2所示):算法陷阱、权利失范、关系失衡、情感异化。

(3)选择性编码

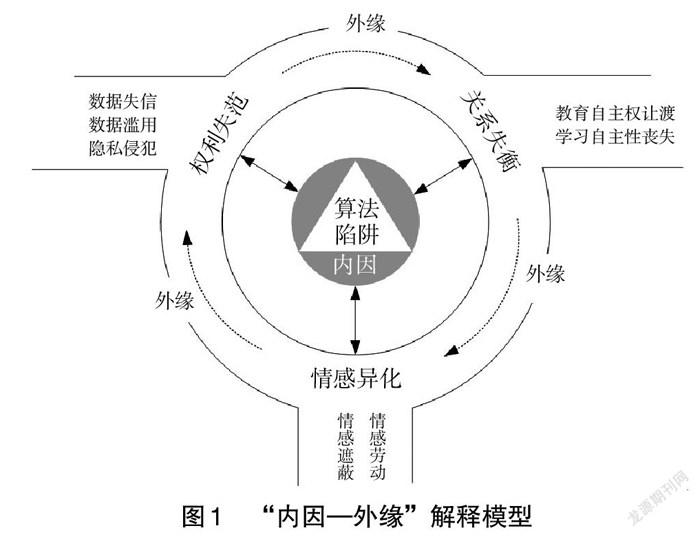

通过系统分析,确定“课堂反馈AI系统的伦理困境”这一核心类属,围绕核心类属的“故事线”可以概括为:算法陷阱是课堂反馈AI系统伦理困境的内驱动因,它直接诱致了权力失范、关系失衡、情感异化三个外发风险,权力失范、关系失衡、情感异化也间接导致算法陷阱,其关系结构如表3所示。此外,权利失范、关系失衡以及情感异化之间也存在间接的影响作用,形成了外缘闭环。以此“故事线”为基础,本研究构建了课堂反馈AI系统应用伦理困境的“内因—外缘”解释模型(如图1所示)。

2.理论饱和度检验

利用预留的1/3的访谈记录进行理论饱和度检验,未出现新的重要类属和关系属性;四个主类属内部也没有发现新的构成因子。由此可判断,上述“内因—外缘”解释模型在理论上是饱和的。

五、“内因—外缘”解释模型阐释

用“内因—外缘”的解释模型可以有效解释X中学课堂反馈AI系统应用的伦理困境。算法陷阱是造成数据权利失范、师生关系失衡以及情感异化等外发性伦理风险的内生性动因。数据的权利失范、师生的关系失衡与情感异化会加速课堂反馈AI系统的应用跌入算法歧视与算法黑箱的技术主义窠臼,形成恶性循环。

1.内因:算法陷阱的形成机制

算法是AI賦能课堂反馈的实质内核,算法规则是决定反馈是否有效的关键。H公司设定算法规则的初衷是监测学生的课堂行为表现,为教师及时干预提供参考。技术人员ET-1和ET-3作为算法研制者,其认为X中学课堂反馈AI系统的算法实现是有依据的:模型从大量的学习者行为与面部表情数据中进行机器学习生成7种情绪(恐惧、快乐、厌恶、悲伤、惊讶、愤怒和中性)、6种行为(读、写、听、站、举手、趴在桌子上)等特征指标,并赋予这些指标详细的定义。算法研制者根据指标定义对其进行加权处理,阅读等正向行为则加分,趴桌子等负向行为则减分。已有研究证实,个体的肌体信号是与心理压力相联系的,特别是个体的情绪状态(韩颖等,2018)。X中学课堂反馈AI系统设计理念源自于此,主要通过面部肌肉振幅、肢体动作来判定学生的专注度与活跃度。但课堂行为与专注度、活跃度之间的因果关系是否成立呢?

(1)算法黑箱

从课堂观察情况来看,系统给出的结果与教师的判断往往存在很大分歧。有些学生只是“偶尔走神”,有些学生习惯于“东张西望”,系统的记录均指向“低专注度”。但事实上这些学生的课堂专注度较高,成绩也优秀。为解释这一偏差,深入分析H公司的技术文档发现:系统数据采集机制存在问题,偏向性的数据采集可能导致算法歧视风险。系统将教室分为6个区域通过摄像机进行轮回扫描,40分钟的课程平均扫描到每个学生的时长大概5分钟。教育的整体性与数据的节点性存在不可调和的矛盾,仅用5分钟碎片化数据来判断学生的课堂学习状态是不准确的。加之采集数据类型太过单一,与教育的复杂性本质相悖。教师ST-7、ST-8和ST-9明确指出规则存在漏洞,忽略具体情境的简易表征并不能够完全反映学生真实的学习状态,同一个学生的同一种行为在教师的不同教学情境中所表示的意义也是不同的。简单的7种情绪和6种行为难以表征课堂教学活动的复杂性,也难以得到有效证明与保障(Boddington,2020)。并且算法的技术专业性、单向性以及隐蔽性等特征导致教师难以理解算法输出的结果,加剧了“算法黑箱”效应,盲目依赖预测性、引导性的算法决策会给教育系统带来巨大的危害(张爱军,2021)。

(2)算法歧视

X中学教师认为该系统能够有效提升低专注度学生的课堂学习专注度。H公司据此改进系统,重点关注学习成绩差且课堂专注度不高的学生。但当这部分学生意识到他们成为系统的重点监控对象后,表达了强烈的不满,加剧了算法歧视风险。加之,算法规则来源于算法研制者的主观判断与选择,难以避免嵌入某种偏向。譬如:低头、眼睛朝向课桌或书本可能是在“阅读”,亦有可能是“走神”;头部贴着课桌或课桌上的书有可能是“趴桌子”,亦有可能是“回顾知识点”。算法研制者的行为判断偏向会在算法的推断与应用过程中不断增强,并最终“植入”学习者的意向和行为动机,从而固化或改变其行为选择(程猛等,2021)。

2.外缘:算法陷阱的主要危害

算法通过对课堂教学行为数据的分析与应用,催生了新的课堂反馈形态,并以更创新、更高效的课堂反馈模式取代传统的课堂反馈模式。但算法规则的不透明和偏向性引发的算法黑箱与算法歧视会伴随其应用疆界的不断拓展而蔓延至课堂反馈全过程,衍生出数据失信、数据滥用和隐私侵犯等现象。数据权利失范所导致的工具理性对价值理性的不断僭越,进一步造成了教师教育自主权让渡以及学生学习自主性丧失,带来师生关系失衡的风险。随着师生关系异化,正常的情感交流不断被压制和边缘化,进而导致情感失衡,引发了过度情感劳动与情感遮蔽的风险。师生进行作伪、作秀式的“课堂表演”,进一步加剧了数据失信,形成“权利失范—关系失衡—情感异化”的闭环回路。此外缘闭环具有显著的叠加效应,作用于“黑箱”与“歧视”的算法陷阱内因,会加剧AI支持课堂反馈的伦理风险。

(1)权利失范

算法陷阱引发了数据权利失范。首先,算法并非中立,其暗含了主导者的意识偏向,致使在进行数据采集时收束了教育主体的选择权。教育管理者、教师有权决定何种信息被采集,何种信息禁止采集,而作为数据主体的学生却无权选择。例如教师和学生均对数据的采集、存储、处理以及使用过程中的安全性产生质疑,H公司技术人员ET-3也透露“数据的传输与存储缺乏保护机制”,由此引发了教师的抵触情绪,因教师的抵触摄像机便只采集学生数据。教师应用“权利”确保了教师自身数据不被采集和分析,这本身就是一种权利失范。而教师行为透露出该系统可能存在数据滥用与隐私泄露的风险,不可避免地让学生产生忧虑。其次,算法的不透明性忽视了教育主体的知情权。课堂行为评价算法是一个未知的“黑箱”,师生作为数据主体无法知悉算法的运行机制,利用不可解释的课堂行为评价算法,对海量教育数据进行分析,其最终生成的结果是否合理,是否有利于学生成长发展,亦存在争议。最后,深度学习机制具有不确定性,对学生信息的挖掘不能完全为其设计者所主导,对数据进行广泛而深入地解读,可能形成意料之外的数据链,挖掘出个体敏感信息,严重威胁师生的隐私安全。SS-17在被系统认定为“左顾右盼”后,被同伴取笑,認为他是对后座异性同学“有意思”。

(2)关系失衡

算法陷阱诱发了师生关系失衡。X中学为助力学生学习引入AI,却忽视了课堂教学的本质是师生交流互动的过程。AI的强势介入,在课堂反馈中扮演“监控者”的角色,必然会导致师生关系的解构与重构。于教师而言,“算法黑箱”可能导致盲目的技术崇拜,进而消解教师对教学的热情与创造性(孙艳秋,2018)。有教师表示课堂反馈AI系统一定程度上可以起到督促学生的作用,尤其是帮助低专注度的学生提高注意力,将其从点名、维持课堂秩序中解放出来,从而提高课堂效率。但是系统的常态化使用,可能使教师愈加依赖系统的监控与决策,丧失独立思考和判断的能力。于学生而言,借助人脸识别、情感分析等技术手段发现、计算和纠正微小的不当行为的算法机制,其本质是对学习者实施心灵的“全景敞视”,可能导致学生个性异化与学习专注力丧失(张家军等,2021)。学生时时刻刻被无形的监管者记录和分析,身体与情绪被置于被注视和被计算的状态,其安全感、信任感得不到满足,容易引发“寒蝉效应”,将课堂文化导向逼仄、压抑,学生丧失学习的主动性与专注力。学生SS-7就表示“我不喜欢被监控,这让我不自在。这个系统有可能有效,但我没办法按我的步调去安排学习进度,我可能反而学不好了。”AI赋能课堂反馈的过度监控忽视了师生内部的自主性与自我控制力,抑制了教师的创造性,导致教师教育自主权让渡与学生学习自主性丧失。

(3)情感异化

算法陷阱致使师生情感发生异化。于学生而言,AI技术通过摄像头持续采集学生人脸特征、行动轨迹、个人偏好等数据,实现对学生认知、情绪和行为习惯的全方位、实时关注,使得学生如同身处“全景敞视监狱”中(米歇尔·福柯,1999)。它无形之中规训学生的身体,抑制其真实情绪的表达,进而导致其情感的内在体验和外部表达失调(程猛等,2020)。学生甚至被迫进行智识活动之外的情绪整饰,进行频繁、高强度的情感劳动,甚至养成“表演性人格”(冯锐等,2020)。迪特尔·察普夫指出过度情感劳动可能导致情感枯竭和个性丧失(Zapf,2002)。于教师而言,在监控之下开展教学,其难免会出现迎合的心态,无法完全敞开心灵进行自主发挥。由此课堂教学蜕变成“前台”表演,所有外显的情绪、行为都具有了强烈的工具性价值,师生都将通过作伪、作秀的表演做出符合既定算法机制的情绪和行为表达,如此便可获得系统“过程性”与“真实性”的评价。长此以往,教育生态会被严重破坏。教师SS-11对系统常态化使用表达了深切的忧虑:“这个系统如果长期使用,老师会用来给学生施加压力,学校会用来给老师施加压力,建议千万不要常规化。”此外,摄像头对师生反复、无限度地“注视”,将师生对象化,遮蔽了其作为教育主体的完整性和时空感,学生言行被去情境化呈现,使其陷入被误解与错判的风险(郝东方,2015)。如此则招致师生正常的情感交流被边缘化,学生心理安全、自尊以及自我实现等需要被忽视。

六、伦理困境的化解策略

1.彰显算法价值理性,遵循教育的人性逻辑

AI在改进课堂反馈层面显示出巨大的潜力,但同时也带来了不可避免的挑战。如果出现错误的价值引导,这些挑战可能就会转化为教育技术创新应用的巨大阻力(Dawson et al.,2018)。重视AI课堂应用的价值引导,须从以下两个方面着手。

一是规避算法黑箱风险。技术参与课堂反馈的过程,使教师不必在学生学习行为发生的所有场合都出席,却能对学生每一个阶段的学习行为了如指掌,这将有助于教师采取更为合适的教学干预措施(Holroyde,1971)。但AI在课堂反馈中的应用应遵循赋能教师而非异化教师的原则。该原则的关键在于提升算法透明度。尽可能地向师生公开算法程序和算法运行的全过程,用可视化的简单指标解释技术和模型状态;及时向师生公开数据信息收集的范围和系统运行的可能结果,使得师生对自己的数据隐私和身份标签有较为清晰的了解。教师应强化与学生的常态化互动,利用系统输出结果辅助判定学生状态,合理采取相应教学改进措施。

二是避免算法歧视风险。在某种技术的设计与教育应用中充分考虑学生的主动性与发展性方为该技术最好的教育应用(李政涛,2006)。因此在数据采集、算法设计和决策制定的全过程中,应将学生的主动性和发展性作为落脚点,并通过立法规范算法技术,明确筛选数据的标准化制度,建立算法透明性和可解释性的审查机制,完善算法问责机制,以完善的法律法规对抗算法歧视。

2.制定数据伦理规约,确保师生隐私安全

数据是AI赋能课堂反馈的基础。但对教育数据的滥用与过度解读会威胁教育主体的隐私安全,甚至会限制学生长远发展。因此,可从价值定位与数据确权两个方面为教育数据安全提供内生规约与外在保障,以确保数据主体的隐私安全。

明确教育数据的价值定位可为教育数据安全提供内生规约。教育数据的本体限度决定了其应用价值在于“洞察”而非预测(苟学珍,2021),即洞察师生的交流互动,助力因材施教与个性化学习,而非考核教师业务能力、预测学生未来发展。并且在对教育数据进行收集、分析以及存储过程中应以有用无害为价值追求;在数据被分析、解释与挖掘过程中应将隐私保护作为数据规则来保护教育主体的隐私安全。

在明确教育数据价值定位的基础上进行数据确权是根治教育数据滥用的关键。数据确权即制定相应数据采集与使用制度,保障数据主体的隐私权、知情权与遗忘权。例如,对数据采集、存储、访问、提取等方面做出明确规定,尽量避免采集个人敏感信息;数据传输与存储过程中进行加密处理,对敏感信息进行智能清洗,防止隐私意外泄露;数据使用过程中保证数据主体的知情权,并对相关信息进行有效保护,不得随意泄露甚至买卖他人数据;定期删除服务器上师生的个人数据,保障数据主体的“被遗忘权”,避免数据滥用持续性存在。

3.建立双向平等关系,强化人机协作效用

人工智能的强势介入,严重冲击了课堂教学中师生关系的平衡,引发了教师教育自主权让渡与学生学习自主性丧失。因此,调和AI带来的负作用,防止技术对教育主体的僭越,就需要形成AI与教育主體相互制约的交互关系,强化人工智能与人脑智能的有效协作,充分发挥师生的主观能动性与技术的辅助作用,建立双向平等的关系,形成“师—AI—生”的人机协作共同体。

维贝克认为,技术意向性对于人的道德主体性具有建构作用(李日容等,2018)。因此,要建立师生与AI之间双向平等的关系,其基本前提是教育管理者与教师要理性认识课堂反馈AI系统的工作机理及其有效赋能的条件与限度,避免技术崇拜与技术依赖造成的教育主体性缺失。具体举措包括:建立具有明确道德观、价值观指引的伦理框架,增强教育主体对技术伦理的自我感知,同时对其已经或可能产生的价值迷失、行为失范等进行澄清和引导。

强化人机有效协作就要求算法设计者把握AI智能性与师生自主性二者间的平衡,使之既能充分利用教育人工智能高效、全面、精确的特性进行数据采集、分析与可视化呈现,又能充分发挥教师“灵魂工程师”的角色,以人脑智慧完成最优决策,以独具特色的知识经验为学习者学习外部知识及价值观等提供美好的学习体验,丰富师生的情感与思想交流,助力学生价值观的建构,消弭技术对师生互动产生的负面影响。

4.揭示情感变化规律,发展积极情感关系

情绪识别与情感计算在丰富课堂反馈通路的同时,也带来了情感遮蔽与情感劳动的负面影响。目前,情绪状态的智能感知研究大多停留在去时空化的基于文本、语音、视频或生理信息的单模态识别模型层面,难以还原学生真实状态,进而形成情感遮蔽(王一岩等,2021)。提高情感计算的还原率有助于增强教师对学生认知情绪状态的理解,强化课堂反馈的有效性。具体举措包括三点:一是注重情感数据的多元整合性,将人脸识别、语音识别和自然语言处理等技术相融合,综合不同模态的情感数据来提高情感识别的准确度,综合衡量学习者的学习状态。二是注重情感发生依存性,利用智能感知技术对真实的教学情境进行全方位、多层次的精准刻画,探究教师教学风格、课堂氛围等教学要素对学习者情感状态的影响机制。三是注重情感状态的时序变化,利用时序性数据,构建基于时间序列的动态分析模型,以便更精准地还原学生当下情绪状态,揭示其情感变化规律。

课堂教学的本质是师生互动。人工智能作为课堂监控异化了师生间的互动。因而,采用轻量化的人工智能设备,弱化其监控属性,有助于调和师生正常的互动交流。同时,教师应加强对学生的情感关怀,及时进行情感干预,消弭人工智能对师生情感互动产生的负面影响,发展积极的情感关系。

参考文献:

[1][法]米歇尔·福柯(1999).规训与惩罚[M].刘北成,杨远婴.北京:生活·读书·新知三联书店:241-242.

[2]安涛(2020).“算计”与“解蔽”:人工智能教育应用的本质与价值批判[J].现代远程教育研究,32(6):9-15.

[3]曹晓明,张永和,潘萌等(2019).人工智能视域下的学习参与度识别方法研究——基于一项多模态数据融合的深度学习实验分析[J].远程教育杂志,37(1):32-44.

[4]程猛,宋文玉,阳科峰(2020).人脸识别技术的课堂应用:一种批判性反思[J].基础教育,17(5):47-53.

[5]程猛,阳科峰,宋文玉(2021).“精准识别”的悖论及其意外后果——人脸情绪识别技术应用于大学课堂的冷思考[J].重庆高教研究,9(6):78-86.

[6]冯锐,孙佳晶,孙发勤(2020).人工智能在教育应用中的伦理风险与理性抉择[J].远程教育杂志,38(3):47-54.

[7]苟学珍(2021).智能时代教育数据安全的伦理规约简论[J].电化教育研究,42(9):35-40.

[8]顾小清,胡艺龄(2020).理解、设计和服务学习:学习分析技术的回顾与前瞻[J].开放教育研究,26(2):40-42.

[9]顧小清,舒杭(2016).信息技术的作用发生了吗——用学习分析技术刻画学习行为印记[J].现代远程教育研究,(5):10-19.

[10]韩丽,李洋,周子佳等(2017).课堂环境中基于面部表情的教学效果分析[J].现代远程教育研究,(4):97-103,112.

[11]韩颖,董玉琦,毕景刚(2018).学习分析中情绪的生理数据表征——皮肤电反应的应用前瞻[J].现代教育技术,28(10):12-19.

[12]郝东方(2015).教室摄像头的注视现象研究——以萨特的他者理论为视角[J].电化教育研究,36(12):23-29.

[13]黄丽凤,邵志芳,孟徐虹等(2010).诱导情绪影响面部表情识别的反应偏向[J].心理科学,33(3):624-626,599.

[14]李日容,张进(2018).维贝克“道德物化”思想的后现象学根基[J].科学技术哲学研究,35(5):83-88.

[15]李新,杨现民(2019).教育数据思维的内涵、构成与培养路径[J].现代远程教育研究,31(6):61-67.

[16]李政涛(2006).为人的生命成长而设计和发展教育技术——兼论教育技术学的逻辑起点[J].电化教育研究,(12):3-7.

[17]李政涛(2020).现代信息技术的“教育责任”[J].开放教育研究,26(2),13-26.

[18]刘清堂,何皓怡,吴林静等(2019).基于人工智能的课堂教学行为分析方法及其应用[J].中国电化教育,(9):13-21.

[19]莫宏伟(2018).强人工智能与弱人工智能的伦理问题思考[J].科学与社会,8(1):14-24.

[20]彭兰(2021).算法社会的“囚徒”风险[J].全球传媒学刊,8(1):3-18.

[21]苏明,陈·巴特尔(2019).人工智能教育伦理的多维审视——基于马克思技术批判和人的全面发展理论[J].西南民族大学学报(人文社科版),40(11):223-228.

[22]孙艳秋(2018).课堂教学中的“技术崇拜”:症候、成因与治理[J].电化教育研究,39(7):77-82,90.

[23]孙众,吕恺悦,骆力明等(2020).基于人工智能的课堂教学分析[J].中国电化教育,(10):15-23.

[24]唐汉卫,张姜坤(2020).大数据教育应用的限度[J].华东师范大学学报(教育科学版),38(10):60-68.

[25]王一岩,刘士玉,郑永和(2021).智能时代的学习者情绪感知:内涵、现状与趋势[J].远程教育杂志,39(2):34-43.

[26]吴河江,涂艳国,谭轹纱(2020).人工智能时代的教育风险及其规避[J].现代教育技术,30(4):18-24.

[27]吴立宝,曹雅楠,曹一鸣(2021).人工智能赋能课堂教学评价改革与技术实现的框架构建[J].中国电化教育,(5):94-101.

[28]张爱军(2021).“算法利维坦”的风险及其规制[J].探索与争鸣,(1):95-102,179.

[29]张家军,陈苗(2021).回归育人价值:数字全景敞视下教育规训隐忧的消解路径[J].现代远程教育研究,33(4):33-42.

[30]赵佳丽,罗生全,孙菊(2020).教育大数据研究范式的内涵、特征及应用限度[J].现代远程教育研究,32(4):57-64,85.

[31]赵瑞斌,杨现民,张燕玲等(2021).“5G+AI”技术场域中的教学形态创新及关键问题分析[J].远程教育杂志,39(2):44-52.

[32]钟绍春(2020).课堂教学新模式构建方向与途径研究[J].中国电化教育,(10):40-48.

[33]Berendt, B., Littlejohn, A., & Blakemore, M. (2020). AI in Education: Learner Choice and Fundamental Rights[J]. Learning, Media and Technology, 45(3):312-324.

[34]Boddington, P. (2020). The Ethics of AI and the Moral Responsibility of Philosophers[J]. The Philosophers’Magazine, 89:62-68.

[35]Dawson, S., Poquet, O., & Colvin, C. et al. (2018). Rethinking Learning Analytics Adoption Through Complexity Leadership Theory[C]// Proceedings of the 8th International Conference on Learning Analytics and Knowledge. Association for Computing Machinery:236-244.

[36]Holroyde, D. (1971). Educational Technology Means Men-or Machines?[J]. British Journal of Educational Technology, 2(2):137-142.

[37]Wang, Y. (2021). When Artificial Intelligence Meets Educational Leaders’Data-Informed Decision-Making: A Cautionary Tale[J]. Studies In Educational Evaluation, 69:100872.

[38]Whitehill, J., Serpell, Z., & Lin, Y. et al. (2014). The Faces of Engagement: Automatic Recognition of Student Engagement from Facial Expressions[J]. IEEE Transactions on Affective Computing, 5(1):86-98.

[39]Zapf, D. (2002). Emotion Work and Psychological Well-Being: A Review of the Literature and Some Conceptual Considerations[J]. Human Resource Management Review, 12(2):237-268.

收稿日期 2021-11-10 責任编辑 李鑫 谭明杰

AI Enabled Classroom Teaching Evaluation: Ethical Review and Risk Resolution

LUO Jianghua, WANG Lin, LIU Lu

Abstract: While artificial intelligence (AI) technology improves the quality and efficiency of classroom teaching feedback, a series of ethical problems have attracted more and more attention. The systematic analysis of application cases helps to reveal the deep-seated causes of such ethical dilemmas. Based on the interviews with the developers, teachers, students and other users of classroom feedback AI system in X Middle School, the “internal cause-external edge” interpretation model constructed through three-level coding analysis shows that the ethical dilemma of classroom feedback AI system application is mainly caused by algorithm pitfalls, manifested in algorithm black box and algorithm discrimination. Due to the opacity and bias of algorithm rules, the classroom intelligent feedback process presents phenomena such as data dishonesty, data abuse and privacy invasion, which induces external risks such as power anomie, relationship imbalance and emotional alienation. These risks are manifested in the transfer of educational autonomy of “teachers”, the loss of learning autonomy of “students”, excessive emotional labor and emotional masking. To resolve the ethical risk of AI enabled classroom feedback, we should firstly avoid algorithm black box and algorithm discrimination, advocate that teachers and students have the right to know the algorithm rules, take students’ initiative and development as the foothold, and improve laws and regulations to combat algorithm discrimination; secondly, we should formulate data ethics regulations to ensure the security of educational data and the privacy of teachers and students; thirdly, we should establish a two-way equal relationship between teachers and students and AI, and strengthen the effectiveness of man-machine cooperation; fourthly, we should reveal the law of students’ emotional change and develop the positive emotional relationship between teachers and students.

Keywords: Artificial Intelligence; Classroom Feedback; Algorithm Pitfall; Ethical Risk