基于迁移学习的名家画作数字化识别与分类

2021-03-23赵连军

邓 旭,赵连军,郇 静

(山东理工大学 计算机科学与技术学院,山东 淄博 255000)

0 引 言

艺术家识别是指在没有其它元数据的情况下,仅给定图像的情况下识别作品的艺术家。这一领域的专家需要很长时间来学习各种艺术家的风格,然后才能分析绘画作品。此外,即使具有专业知识,艺术家的身份也很难确定,因为一个艺术家的风格在不同的绘画作品中有很大的差异。通过机器学习,可以为专家提供基本估计,以减少必要的时间和精力,并使经验不足的人更容易识别艺术家身份。

在这项工作中,前人做了很多工作。Qian等主要是将自然图像进行油画、粉笔画等艺术风格模拟,或者是针对油画等西方画进行艺术风格分析[1]。Wang等提出了复合特征的自适应遴选及对水墨画风格描述的优化,其还通过提取多种底层异构视觉特征对国画风格进行描述,对国画作者进行分类预测[2]。Saleh和Elgammal使用了GIST、Classemes和PiCoDes特征[3]。Misumi等利用SIFT特征对3种不同风格的作品进行分类[4]。Sahu等利用局部二元模式(local binary patterns)、颜色直方图(color histograms)、HOG和GIST对作品美学评估分类[5]。

近年来,深度学习的卷积神经网络模型在图像识别上取得了很大的进步,例如在ImageNet上top-5分类的错误率仅有3.6%[6]。相比于浅层的特征提取,深度学习的深层网络结构可以逐层进行特征提取,这些特征更容易被分类识别。

卷积神经网络(CNNs)能够将图像内容和图像风格分开识别,并通过风格迁移可以将一幅画的艺术风格迁移到另一幅画上面[7,8]。Li等通过将VGG-F模型直接应用于中国画作风格识别问题,取得了很好的成果[9]。

深度学习可提取图像特征,应用于字体手写识别、人类图像识别、目标检测等方面[10]。近年来,深度学习也被用于图像细粒度分析与分类的研究,取得了很好的结果[11-14],通过迁移学习分类也有不错的效果[15]。

卷积神经网络学习目标特征需要花费大量的机器运算时间,预训练后的卷积神经网络模型(PretrainedCNN)具有良好的可迁移性。迁移学习既可以确保较为理想的训练效果,又可以节省大量的训练时间。迁移学习近年来成为图像识别领域的主要方法。

基于上述分析,针对艺术家识别,提出了一种基于 ImageNet 的ResNet-50迁移学习方法。ResNet-50能自动学习训练数据中的低层次信息,得到更详细高层的特征数据。实验结果表明,基于ImageNet的ResNet-50的迁移学习预训练模型在识别准确率方面效果最优。实验还通过显著图[16]验证了画家艺术风格分布在整幅画作中,通过风格迁移[7]验证画家的艺术风格能被神经网络学习,同时实验基于DenseNet-201[17]的迁移学习进行对比实验。

1 基于深度学习画家识别系统

1.1 深度残差神经网络原理

深度神经网络层数的不断增加,模型精度不断得到提升,但当网络层级增加到一定以后,测试正确率和训练正确率迅速下降,这说明当神经网络层数变多以后,深度神经网络难以训练。针对这个问题,深度残差网络提出了捷径连接(shortcut connections)。

CNN随着深度的增加会出现梯度消失问题,一般的卷积神经网络隐藏层直接会存在特征图丢失、不完整问题。残差网络是CNN的一种特殊结构,ResNet引入了残差网络结构,通过这种残差网络结构,一般随着深度的增加,识别效果会越好。

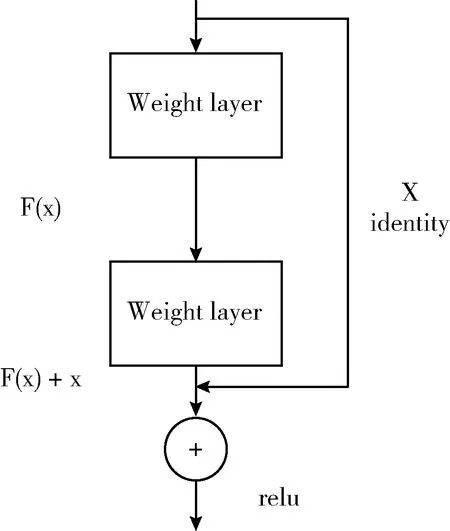

残差网络的基本结构如图1所示,在图1的残差网络结构中,通过捷径连接的方式,直接把输入传到输出,这条连接没有权重,可以避免特征图丢失问题。

图1 残差网络基本结构

1.2 深度学习模型

迁移学习的目的是为了将原领域学习的信息应用推广到新领域。本文为了验证深度神经网络迁移学习有效,训练了2个神经网络进行对比,分别是基于ImageNet迁移学习的ResNet-50和DenseNet-201这2个模型。

1.2.1 迁移学习的ResNet-50

基于ResNet-50结构的迁移学习卷积神经网络见表1,迁移学习的卷积神经网络权重来自ImageNet数据集的预训练权重。其它与前一个神经网络一样,将ResNet-50全连接的层替换为23维新的连接层,用来计算数据集中每个艺术家的得分。

表1 ResNet-50卷积神经网络结构

基于ImageNet的ResNet-50的迁移学习有效地减少了神经网络学习特征时间,原因在于一些从文艺复兴开始的艺术家,通常在绘画时都会画出栩栩如生的场景,这些场景描绘都能直接代表现实世界的画面,这些图画和ImageNet数据集里面的图面有相似之处。

1.2.2 DenseNet-201

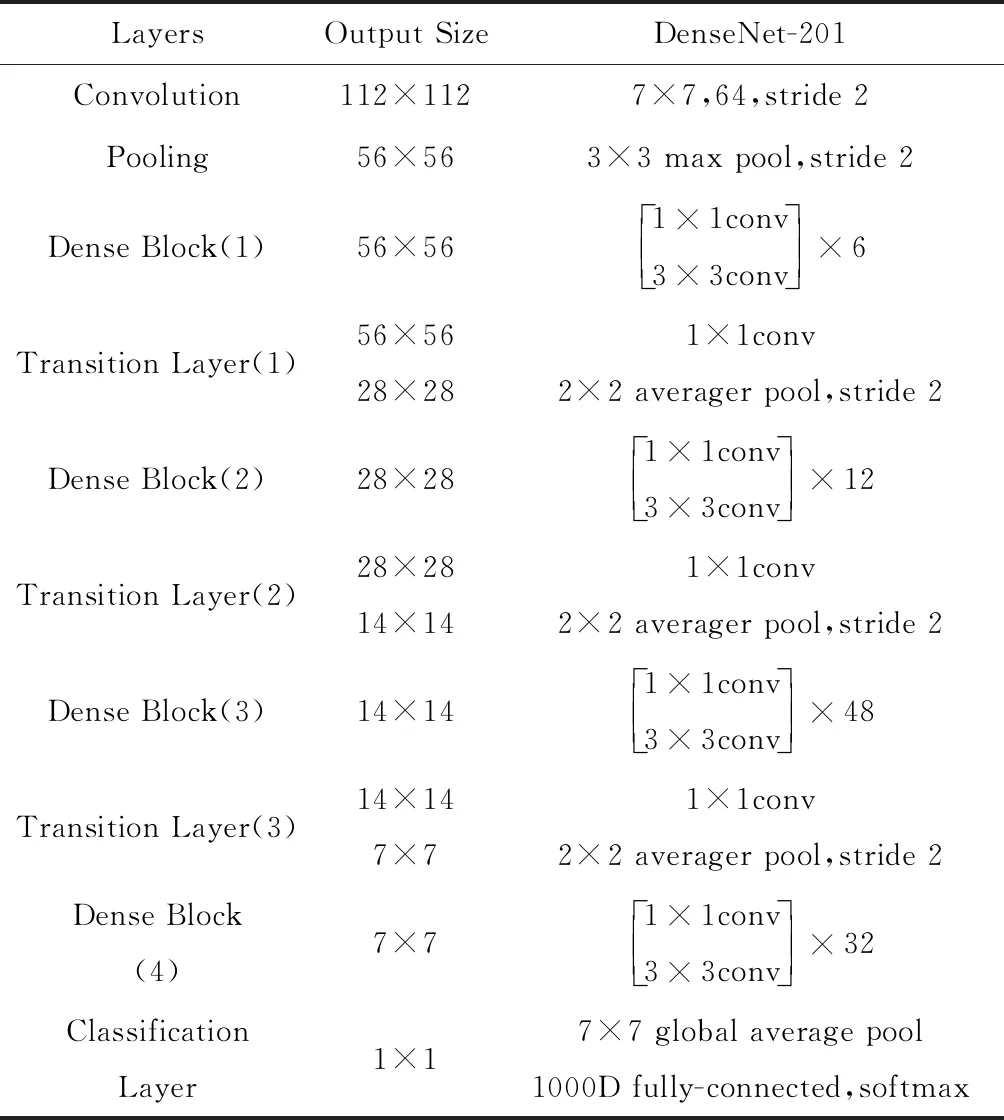

DenseNet采用的是一种更密集的连接方式,是一个密集卷积神经网络,以前向传播方式,将每一层与其余层密集连接。这样做的目的是可以确保各层之间的信息流动达到最大,将所有层(特征图大小匹配)直接连接在一起。DenseNet有着4个显著特点:①缓解了梯度消失问题;②增强了特征在网络间的传播;③实现和加强了特征重用;④有效减少了参数数量。本文主要使用了DenseNet-201卷积神经网络,具体见表2。

表2 DenseNet-201卷积神经网络模型结构

1.3 分类方法

实验训练了两种不同的CNN模型来识别分类画家。每个神经网络模型都是基于3×224×224RGB图像输入,输出数据集的23个画家得分。

对于两个神经网络模型,使用SoftMax分类和交叉熵损失

(1)

式中:Li表示在训练集中第i作品的损失。f是神经网络计算分数的方法,j表示23个可能的选择中的一个。yi表示正确类型。这个损失函数能保证神经网络在训练集中能最大化正确画家的分数。

2 实验与结果分析

2.1 实验数据集与数据处理

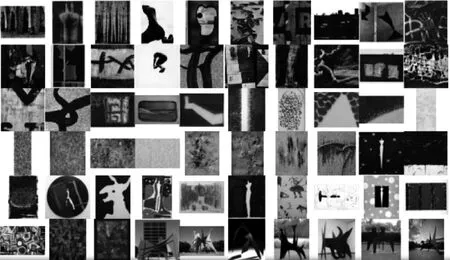

为了训练CNN模型识别画家,使用WikiArt数据集,整个数据集包括2300位画家的超过100 000幅作品,这些作品的时间和风格跨越广度非常广,数据集有抽象派、写实派、人物画、风景画、水墨画、油画。

整个数据集中的绝大多数艺术家只有不到50幅绘画作品,因此为了确保训练网络有足够的样本量,实验只使用数据集中有400幅或更多绘画作品的艺术家。为了保证每位艺术家画作数量平衡,这些画家画作只取400幅。因此,数据集来自23位艺术家的400幅作品组成(总共9200幅)。实验将每个艺术家画作按80-10-10的分割将此数据集分割为训练集验证集和测试集。因此,数据集中每个艺术家320幅画作作为训练集,40幅画作作为验证集,40幅画作作为测试集。这个数据集比以前的工作中使用的数据集要大得多,图2给出了数据集部分样本。

图2 WikiArt数据集

如图2所示,数据集中的画作有不同形状和大小,所以在将图像传送到CNN之前会对其进行修改。将图像归零并进行标准化,在训练网络的同时,随机对绘画的任意部分进行裁剪,每个输入图像进行224×224像素裁剪,这种随机性增加了训练数据的多样性,有助于避免过度拟合。在验证和测试图像时,实验也是对图像进行随机224×224像素裁剪,以确保结果的稳定性和可重复性。实验假设艺术家的风格在图像中无处不在,而不仅仅局限于特定的区域,所以绘画作品的随机裁剪可以包含足够的信息供CNN确定风格。

2.2 实验设置与环境

模型训练与测试均是在PyTorch框架下完成的。实验都是在云平台完成,使用GTX1080TiGPU,16 G内存和200 GB存储空间。

实验通过Adam update rule训练两个模型。迁移学习的ResNet-50和DenseNet-201的神经网络,使用默认 Adam 参数,learning-rate=10-3,实验可以观察到训练和验证数据集在整个训练阶段的准确性和损失,当神经网络性能不再提升的时候,将learning-rate降低10倍,直到最后神经网络训练准确率不再提高。

2.3 实验模型对比与分析

2.3.1 实验结果对比

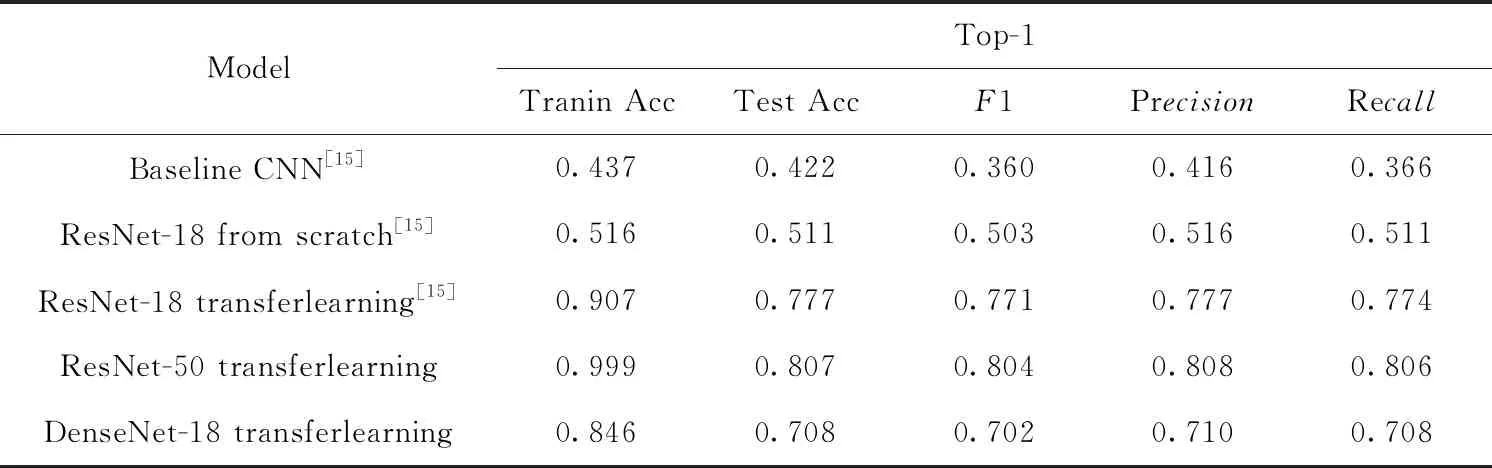

如表3所示,实验对比了5个神经网络模型,可以看到top-1的Precision,Recall和F1准确率。

实验与文献[15]进行对比,后者展示了3个神经网络分类的准确性。 Precision,Recall和的F1定义如下

(2)

表3 艺术家分类结果总结

(3)

(4)

其中,TruePositives和FalsePositives分别表示正样本被正确识别和错误识别的个数,TrueNegetives和FalseNege-tives则分别表示负样本被正确识别和错误识别的个数。

表3比较了不同模型的CNN在关键指标中的准确性对比,基于迁移学习的ResNet-50的神经网络的性能优于文献[15]中的3种神经网络模型,同时优于DenseNet-201模型,实验结果表明并不是神经网络更深效果更好。

2.3.2 实验结果分析

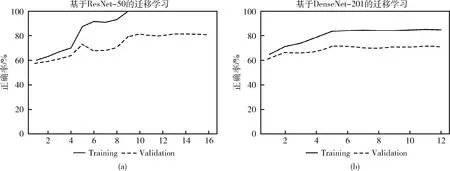

图3表示两个神经网络在训练中准确率的变化,如图3(a)所示实验发现基于迁移学习的ResNet-50开始训练模型,训练集和有效集的两个模型准确率提升曲线相似。实验分为4个阶段,每个阶段4次epochs训练,每个阶段完成后学习率下降10倍,如图3(a)所示第一阶段训练集和有效集的准确率都得到提高,其中第二阶段准确率提高并不明显,第三阶段准确提高迅速,可见不同的学习率对神经网络模型有不同提高效果,第四阶段表示神经网络已不再提高。

图3 3种不同模型的准确率

图3(b)所示,DenseNet-201CNN模型初始准确率非常高,后面准确率提高的非常缓慢,多次训练后准确率最高达到70%。DenseNet-201开始学习的模型第一阶段明显提升,将learning-rate缩小10倍时,第二阶段对准确率有一个曲线上升。第三阶段没有提升,而且准确率相对较低,实验验证ResNet-50神经网络相对DenseNet-201神经网络在艺术家画作识别上效果更好。

2.4 混淆矩阵

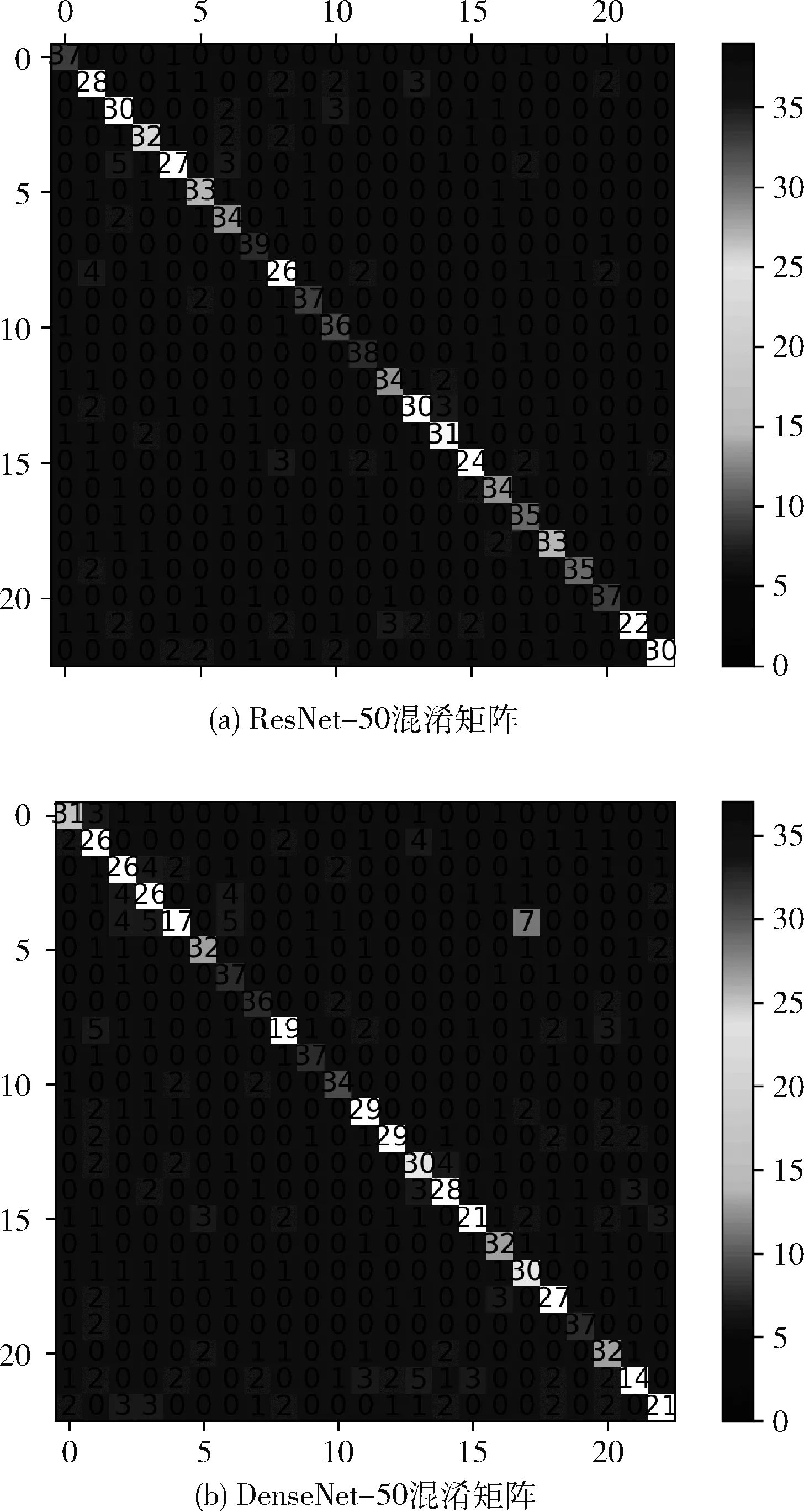

实验考查了基于ResNet-50和DenseNet-201的迁移学习神经网络在正确分类方面遇到的困难。图4显示了两个混淆矩阵,该矩阵是使用Torchnet for Pythorch计算的。每一列表示每个艺术家画家预测分类,因为实验数据集中有23个艺术家,为清晰起见,图中省略了矩阵上的标签。理想情况下实验希望尽可能多地预测集中在对角线上,这意味着神经网络正确地预测了正确的艺术家。

图4 测试集上混乱矩阵对于top-1分类准确率

测试集中每个艺术家有40幅画,测试集中混淆矩阵中单元格最大值为40。可以看到,对大多数艺术家来说,对角线上的数值都是较大的,这表明大多数绘画作品都被正确分类。倒数第二位艺术家Salvador_Dali是预测正确最少的,在ResNet-50测试数据集中,他40幅作品中只有22幅是正确预测。在DenseNet-50测试数据集中,他40幅作品中只有14幅是正确预测。Dali是一位具有非凡才能和想象力的艺术家,他的作品把怪异梦境般的形象与卓越的绘图技术和受文艺复兴大师影响的绘画技巧令人惊奇地混合在一起,他的艺术风格与其它艺术家的交叉重叠,所以他的画作极易分辨错误,这表明具有多种风格的艺术家画作极易分类错误。

2.5 显著图

计算显著性首先计算神经网络正确的类分数相对于输入图像的梯度,然后在计算的梯度的RGB这3个信道上取最大值。用于计算显著性图M的方程如公式所示,其中w是相对于正确类的导数,c是颜色通道Mij是图像中的位置,h(i,j,c) 是与原始图像中i,j,c相对应的w的索引[14]

Mij=max|wh(i,j,c)|

(5)

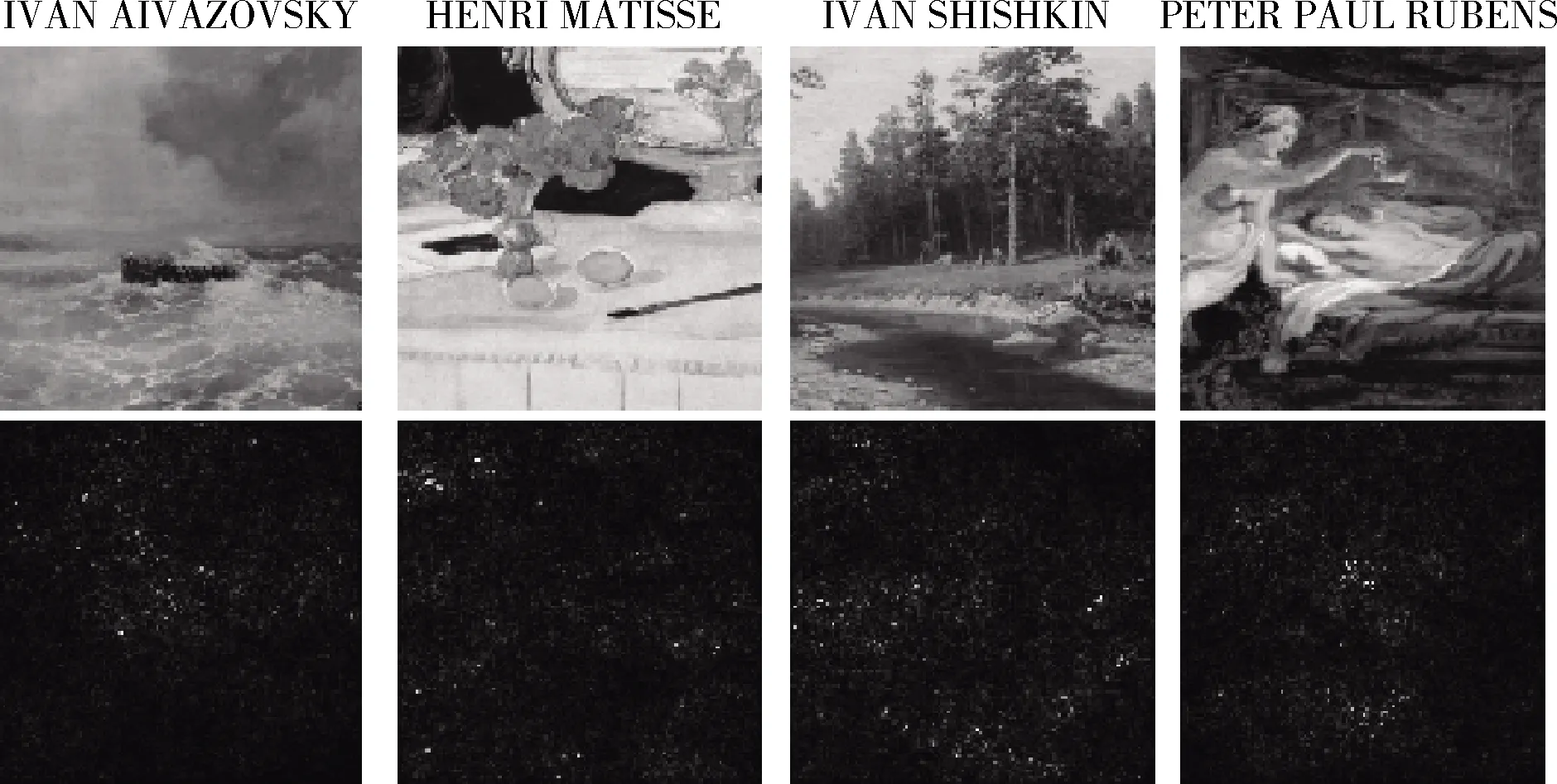

显著图能够可视化图像中的哪些像素对该图像的预测分数贡献最大。实验实现了艺术家识别的显著图,以确定绘画的哪些部分对于预测艺术家有重大影响。

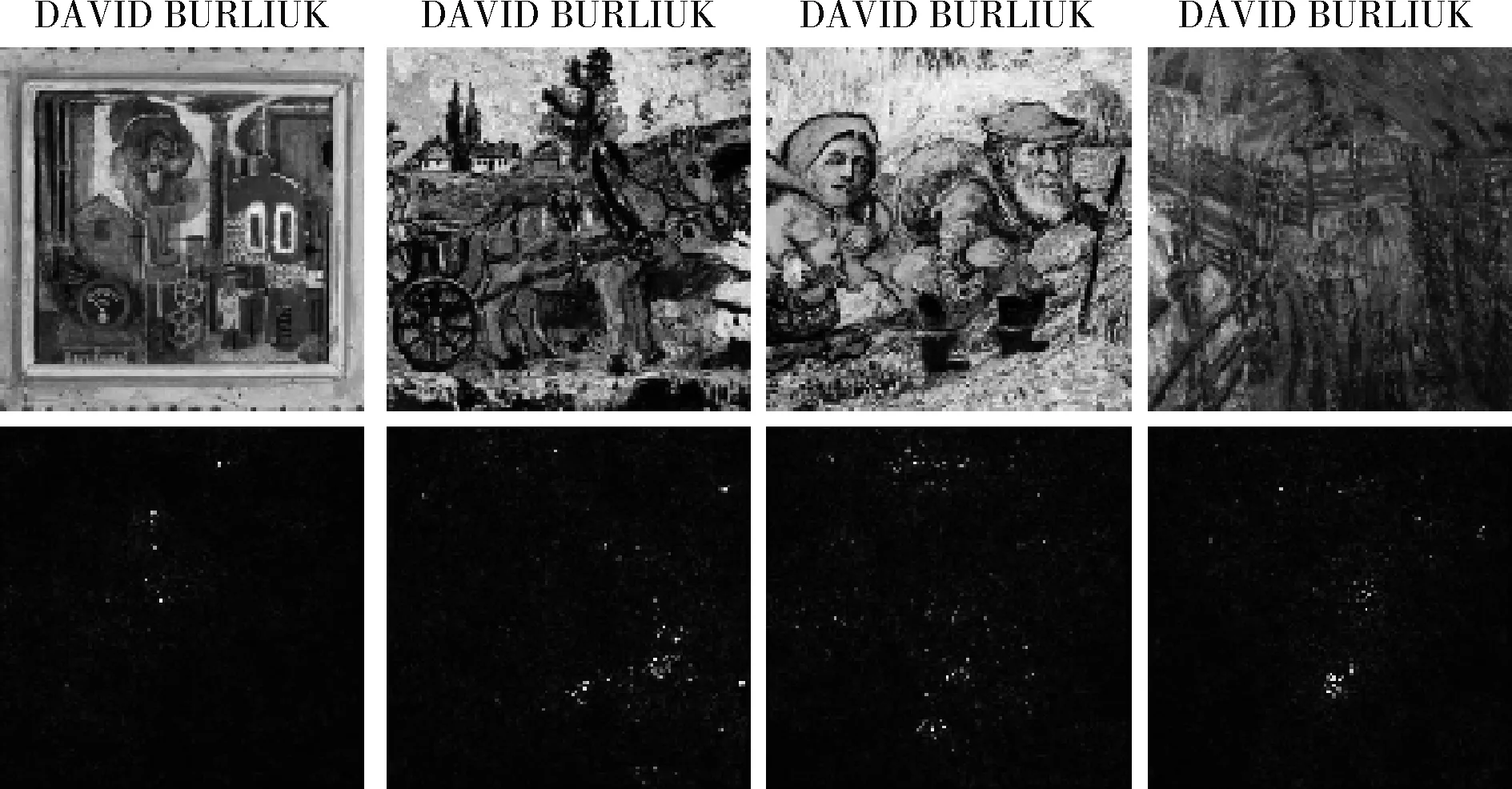

图5展示了不同画家作品的显著图,图6展示了同一个画家不同作品的显著图。在这些绘画显著图中,画作中物体或人并不是影响分类最明显的地方,因为影响分类的像素分布整个画作。实验检查了许多其它绘画的显著性地图,发现在大多数绘画中,影响预测的像素分布在整个图像,而不是集中在其中的物体或人周围。因为艺术家画作风格存在于整个图画中,表明预处理数据随机切割图像并不会影响绘画的风格,证明假设正确。

图5 不同画家画作的显著图

图6 同一个画家不同画作的显著图

2.6 风格迁移

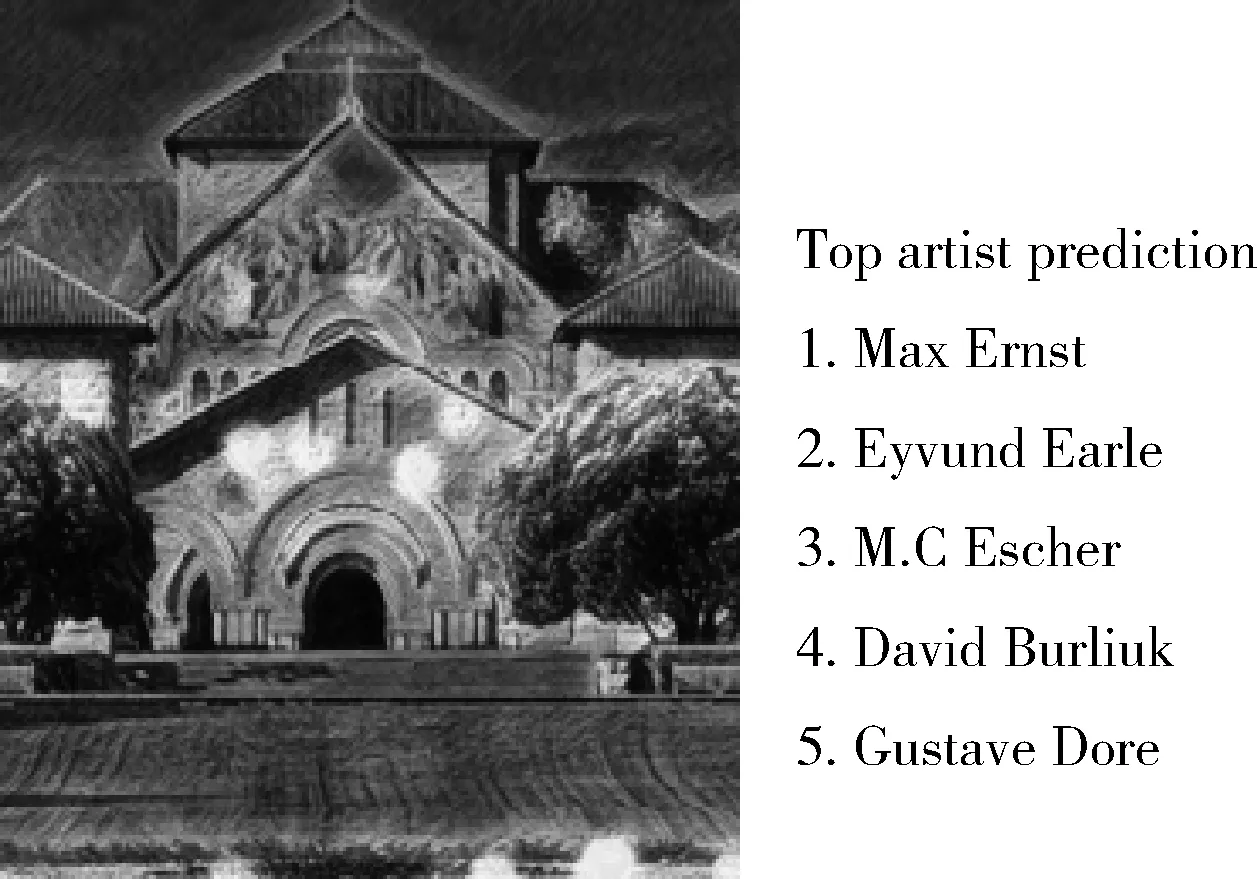

实验将一个画家艺术风格迁移到另一个画家画作上,然后通过这幅画作在神经网络中分类从而得出艺术家风格能被神经网络识别。图7使一座城堡的原画经过Max Ernet的风格迁移,并且在基于迁移学习的ResNet-50模型显示top 5预测。神经网络预测Max Ernst最可能是这幅画的画家,意味神经网络能独自预测的绘画风格,而不是看重它的绘画内容,神经网络可以分开理解绘画内容和绘画风格。迁移学习的ResNet-50模型对迁移风格图像进行了大量实验,虽然神经网络并没有每次为正确的艺术家产生最高的分数,但正确的艺术家通常在前5名,进一步证实艺术家的风格确实能被卷积神经网络理解。

图7 基于Max Ernst风格迁移的画作画家预测

3 结束语

本文提出了一种基于ImageNet预训练ResNet-50的迁移学习方法。通过迁移学习ResNet-50和DenseNet-201这2个神经网络对比,验证基于迁移学习ResNet-50识别效果最好。实验通过显著图验证艺术家风格存在于整幅画作中,其次通过风格迁移实验验证艺术家风格能被神经网络学习。虽然本文方法对艺术家识别取得一定效果,但如2.4节所说基于ImageNet预训练ResNet-50卷积神经网络在画家具有多种风格时,分类正确率一般,如何更加准确识别具有多种艺术风格的画家是未来主要研究方向。