面向信任问题的自动驾驶汽车人机界面设计方法研究

2020-03-30张宁卓

张宁卓

摘要:在自动驾驶即将普及的时代帮助人们建立合理的信任,创造安全便捷舒适的乘坐体验。以信任的组成及影响因素为基础,分析人的信任与自动驾驶系统的关系,得出人对自动系统的信任,尤其经验信任与系统的表现与设计特征相关,并随交互过程不断变化。人机界面作为沟通渠道,关系着人对系统及其行为的认知理解进而影响信任。结合系统透明度原则及拟人化设计方法。与第4级自动驾驶特征及用户场景,得出人机界面设计策略。

关键词:人机界面 自动驾驶 交互设计 信任问题 透明度

中图分类号:TB472 文献标识码:A

文章编号:1003-0069(2020)02-0050-04

引言

自动驾驶是汽车发展的必然方向之一,国际自动机工程师学会(SAE)将自动驾驶分为从第。级无自动化到第5级完全自动驾驶的6个等级,其中从第3级条件自动驾驶开始,驾驶操作与对周边环境的监控被自动驾驶系统接管,人类驾驶员也就不再需要时刻关注驾驶任务[1]。当需要驾驶员成为系统的监控者或置身于驾驶任务之外,能否信任并而将驾驶任务委托给自动驾驶的问题便随之到来。相关调研表明,相比将驾驶任务部分或完全委托给自动驾驶系统,多数人更希望保持对汽车的控制而仅让系统作为辅助,对自动系统的不信任是人对自动驾驶感到犹豫的主要原因[2]。

如果人认为自动系统不值得信任,即使系统足够可靠也不会使用;反之一如过于信任自动系统,则会导致错误使用自动系统,甚至在系统故障后继续依赖自动系统[3]。人机界面(Human-MachineInterface,HMI)作为人与自动系统沟通的桥梁,具有影响人对自动系统信任的能力,进而影响交互体验以及整个系统的运作。目前业界对自动驾驶的研发已达到第4级高度自动驾驶,如何通过人机界面设计来建立人对自动驾驶的合理信任,对于创造良好的体验,推动自动驾驶汽车的普及以及充分发挥其在效率、安全、体验上的优越性具有重要意义。

一、自动化与自动系统的信任问题

自动化意指以机械装置或计算机代替人完成部分或全部任务[3],其良好运作有赖人与自动系统的交互,而信任在其中扮演了重要角色[4]。人对自动系统的信任(Trust)可被定义为“受历史体验影响的人对机器主体在充满不确定性的环境中帮助达到某个目标的态度及看法”[5]。可见,信任受到人、自动系统、所处的环境、任务的执行及其体验等多因素的影响。

(一)信任的组成与影响因素

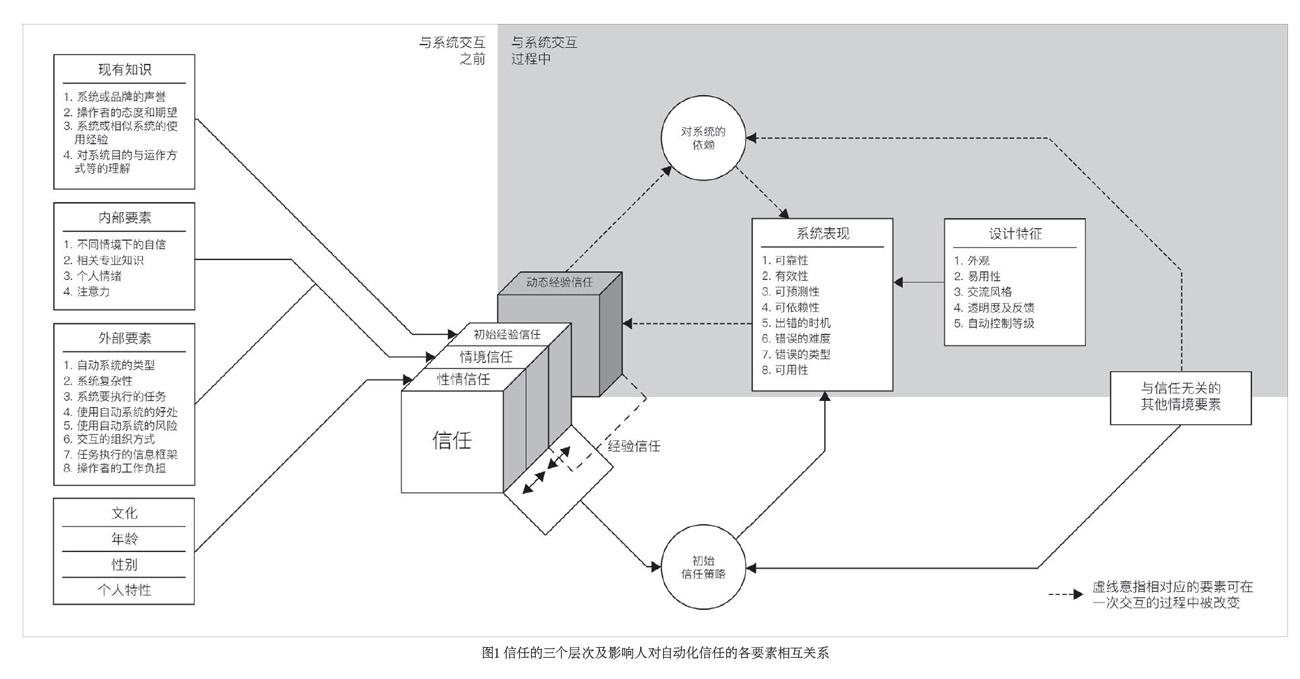

Marsh和Dibben提出信任的三个层次[6]:性情信任(DispositionalTrust)是最基本的一层,代表个体是否会信任自动系统的总体倾向,与人生理属性及社会影响有关而与外界情境或自动系统无关,相对持久稳定而不易受单次交互影响。

情境信任(Situational Trust)包括来源于系统属性、人机分工及工作状况等外部要素和来源于受情境影响的人类操作者的各种内部特性,表现了情境会对信任及后续行为产生的影响。

经验信任或称习得信任(Learned Trust)指操作者于过往经验或当前情境中对自动系统的评估,可被分为在与系统交互前已有的,受操作者既有知识影响的初始经验信任;与在与系统交互过程中的受自动系统表现影响的动态经验信任。

层次关系如图1,前几层决定操作者的初始信任策略,从而影响系统的后续表现、操作者的动态经验信任和对系统的依赖。操作者需投入的精力及情境意识、时限和生理完整等与信任无关的情境要素也会对该体系产生影响。

(二)信任与自动系统能力的匹配

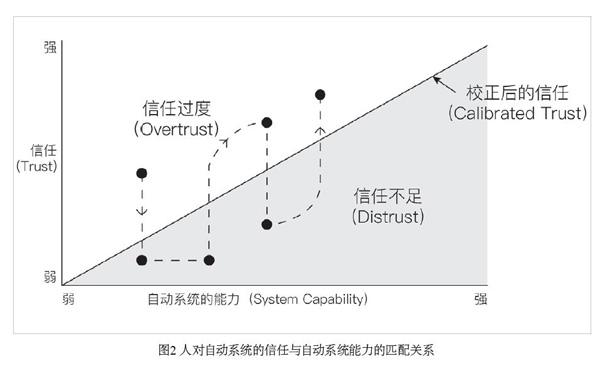

特定自动系统的能力(Automation Capacity)与人的信任存在程度是否匹配的问题口,,可分为信任不足、信任过度以及适当的信任三种情况。如图2所示X轴为自动系统的能力或可靠性,越往右越强;丫轴是人的信任程度,越往上则信任越高;对角线可被称为校正曲线(Calibration Curve),指信任与系统能力相匹配[4]。曲线上方表示信任信任过度,下方则为信任不足。

信任不足(Distrust)指不信任自动系统能完成其可月生任的任务[5]。接触自动系统前,对系统了解不足或失当则难以建立信任;接触后由于系统在任务执行及反馈上表现不佳或与期望存在差异也会导致信任降低。自动化凉奇(Automation Surprise)描述操作者的预想与系统表现存在差异,无法理解系统在做什么、为何以及下一步会做什么。虚假警报是在不存在触发告警的条件下系统仍发出的警报[4],导致在真正警报后不采取行动而造成危险。两者都会导致信任的不足。

信任过度(Overtrust)指对自动系统的信任超出了其能力而在系统无法胜任的情境中使用。操作者满足于自动系统表现产生自满情绪,在应监控时不监控,丧失对系统及周边环境的情景意识,及至须进行干预时无法干预。自动化偏见(Automation Bias)描述操作者倾向于信任自动系统的决策而忽略即使是正確的非自动系统决策的习性[3],导致疏忽性错误(Omission Error)一一操作者在系统通知后忽略某些问题或没有做出相应操作;及执行性错误(Commission Error)——操作者遵从了系统的错误指令。此外,过度依赖还可能导致操作者手动操作能力减弱。

(三)信任的动态变化与合理的信任

操作者在与自动系统的互动过程中不断得到关于系统能力和表现的经验,有意识和无意识地调整对系统的信任,因此信任的构建是个动态的过程[6][8]。图1.2中的虚线表示自动系统的使用者在使用了一段时间且工作正常时,信任就会逐渐增加,从而达到了虚线起点的过度信任的位置。一旦系统出错,以自动驾驶为例即造成碰擦或意外失控后,或系统未能满足用户的期望,信任就会急剧减少并达到信任不足的区间。随着对系统的持续使用,信任会在这条直线上来回移动并最终达到一个较稳定的点。此时人对自动系统的信任与自动系统的能力相适应,实现合理的信任[7]。理想的信任应保持在对角线上,但实际情况是相当复杂的,图1.2中虚线后段,人、情境和系统的变化都影响着信任的变化,在过度信任与信任不足之间徘徊。

二、形成对自动驾驶系统信任的策略

用户对自动系统的信任与自动系统的表现与设计特征相关,其中人机界面作为系统与用户交流的渠道,其内容与形式都能对信任产生影响[4][6][7],目前这方面的研究主要围绕系统透明度与拟人化。

(一)系统透明度

系统透明度(Transparency)指的是自动系统的内部工作原理或逻辑被人类操作者所认知的程度,例如系统为没有满足操作者的期望给出相应解释。围绕系统透明度与信任的研究可知,自动系统透明度的提升有利于人与自动系统的交流,进而有效增加信任并提升人与自动系统综合体的表现[6],透明度也有利于在系统出错导致信任降低后快速恢复[9]。Lyons将自动系统对人的透明度解析为以下四个模型[9]:

(1)意图模型:自动系统应当完全体现其意图或目的,并被用户在整体战略层次上理解,以保证系统行为在用户认知框架之中,包括能做什么、为何这么做和如何做等。

(2)任务模型:自动系统向认知框架提供各种细节信息,例如对用户目标的理解、某个特定时间的目标的相关信息、目标实现进程的信息以及对自身能力和错误的意识,以提升用户的情境意识并帮助用户更好地监控系统。

(3)分析模型:系统需将其分析信息并做出决策的原则与过程告知用户,避免用户困惑,这在充满不定性的环境下对用户尤其有帮助。

(4)环境模型:需向用户表明系统对包括但不限于地形、天气、人与各类物体以及各类限制的了解,从而使用户清楚系统正在经历什么以增强情境意识。

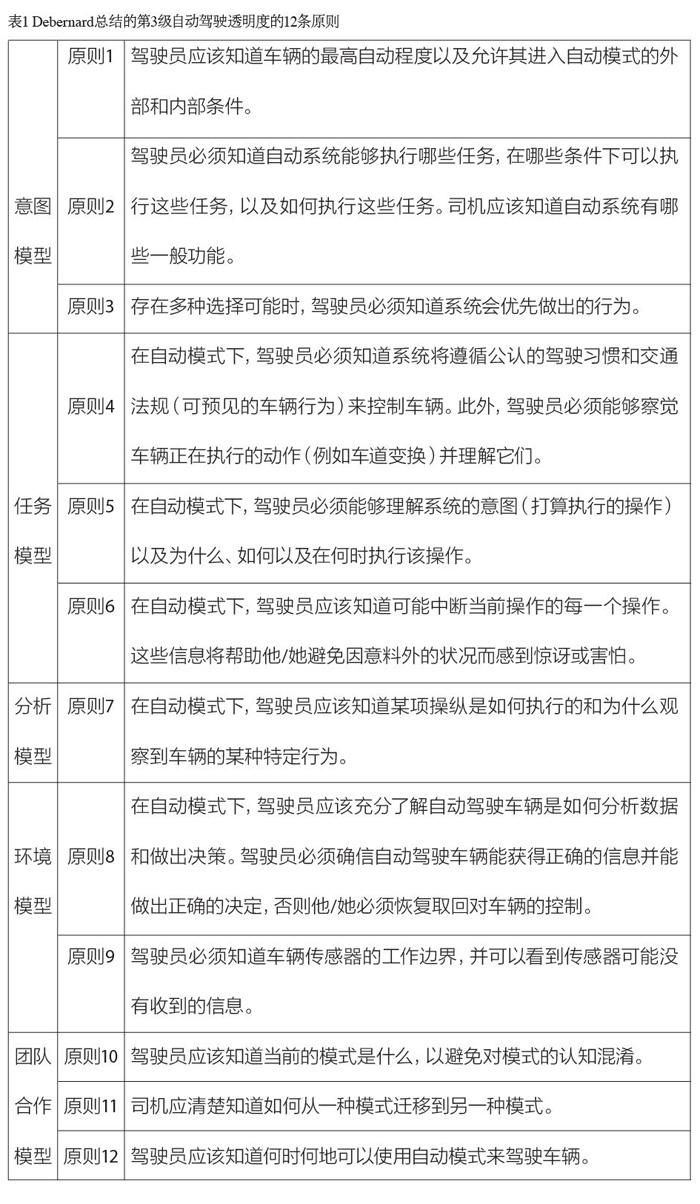

自动系统也需要对用户的多个方面有所了解即人对自动系统的透明度,分为团队合作模型和人类状态模型,分别要求用户与自动系统明确双方分工以形成默契,以及要求自动系统对人类用户的认知、情绪、物理等状态保持一定意识。Debern。rd等根据上述模型提取了12个与第3级条件自动驾驶相关的原则[10],如表1所示。

(二)拟人化人机界面

拟人化(Anthropomorphism)即赋予非人主体以人的特性,尤其是感情与思维,让非人主体像人一样思考、感受和行为[11]。围绕拟人化与信任的研究表明[8][11],当自动驾驶系统被赋予人的角色设定即名字、性别等并可发出人声,以及拥有与人相似的行为或思考方式,都能促使用户对系统运作更充分理解,提高用户对系统的信任,还有助于减缓系统出错后的信任减少[6]。拟人化应与透明度等其他方法相配合,否则交流内容的不合理或缺乏依然会使信任难以维持,正如人需要为自己的行为提供可信任的理由,拟人化的系统亦是如此。

基于用户研究将拟人化的多个形式合理结合,使用情感化的设计方法,使自动系统成为有生命、有情感、会思考、体贴可靠的“伙伴”,营造安全、可靠、积极的体验,更好地获得用户的理解与信任[12]。图3所示蔚来为其汽车装备的具备拟人化设计特点的智能系统“NOMI”,能以与车上乘客对话,完成车辆设定、导航、娱乐等多个任务,使人与车的互动更加自然。

三、自动驾驶系统人机界面设计策略

前述SAE对自动驾驶的分级是以功能实现为准的,也被用于媒体宣传,用户对这些标准的具体理解无法与车企相提并论,容易产生不合理的期望。因此不但需要从用户角度定义的车辆自动驾驶能力,也需要在设计中告知并合理引导用户。SAE分级中第4级被称为高度自动驾驶(High Automation),该级别的车型能在限定的道路和环境下由车辆完成所有驾驶操作而无需人类驾驶员干预,此时驾驶操作和对环境的监控都由系统完成,即使驾驶员未响应系统请求也能采取适当的处理方案[1]。设计适用范围(ODD,Operational Design Domain)即系统被设计来运作的环境,第4级的车辆在ODD内能够可靠运作,在ODD外则会退到较低的自动驾驶水平,可考虑设计策略如下。

(一)为不同环境对应的自动驾驶能力设计不同的人机界面

用戶期望自动驾驶能帮他们彻底摆脱控制车辆的任务,简单设定目的地后即转向其他任务,然而第4级自动驾驶车辆存在运作环境的限制,ODD内外用户的主要任务也不同,人机界面的设计应当适应用户可能的行为,并引导其与所处环境下的系统能力相符合:

1.ODD内:用户完成目的地设定后驾驶任务完全由系统负责,仅以乘客身份乘坐车辆。此时人机界面以支持用户的工作、聊天、游戏、娱乐等多项任务等任务为主要内容,同时须在避免安全隐患的前提下根据透明度的要求提供任务执行状况等信息[13];

2.ODD外:研究表明人很难在自动驾驶允许时持续监控[14],谷歌的路测也支持了该结果。因此应以驾驶员为主系统为辅,设计围绕支持驾驶员更轻松地完成驾驶来进行,限制驾驶员进行影响安全的其他任务;

3.ODD内外过渡阶段:由于人需要至少5-7秒的时间才能恢复对驾驶任务的控制[14],系统需要提前足够时间向用户传达即将面对的环境的信息,可通过地图、道路监控、车联网等扩展车辆的感知以延长过渡时间。系统也应告知用户何时可进入自动驾驶,并提供用户转移驾马史任务的途径。

(二)为自动驾驶系统的行为提供说明与解释

根据认为系统的可靠性、有效性、可预测性及错误信息都会影响用户的信任[6];在透明度的原则中意图和任务模型强调了用户对系统能力及工况的了解对信任的影响[9];机器与人的不同思维方式更要求充足的沟通以使用户了解自动系统,正如乘客了解出租车司机的能力才能放心乘坐。

对于自动驾驶系统来说,需告知用户系统在环境感知、规划决策以及控制执行层面运作的概况,如感知周围环境与附近的其他车辆,了解交通规则及限速等,告知路线的选取及原因,任务的完成进度等,如图4所示的特斯拉Autopilot即向用户展示了系统感知信息。

同样需注意在出错状况的告知与引导,合理的错误解释会降低信任损失,配合后续的有效引导能帮助信任更快恢复[9],这些错误及其他表现导致的信任变化都要求人机界面设计考虑合适的应对方式。结合系统透明度的原则,可以得到人机界面设计框架如图5所示。

(三)提供更丰富的交互方式和更人性化的交互体验

由上文分析可见,第4级自动驾驶需交流的信息多种多样,TODD内外信息主题也不相同,需基于不同情境提供不同的互动形式。为承载这些信息,并在自动驾驶场景下支撑用户工作、娱乐、休闲等多样的体验,图6所示的拜腾Concept横贯中控的大屏幕与语音识别、触摸控制、手势交互的结合即为一种探索方向。除此之外,基于增强现实的平视显示、仪表与中控一体化、更多的生物识别也是丰富自动驾驶交互体验的可行道路[15[。

在提供更丰富多样的交互途径的同时,还需通过情感化设计使交互体验更加自然与人性,对作为具备一定能力的主体存在的自动驾驶系统来说尤其有意义。除像NOMI提供拟人化的沟通来获知驾驶目标和管理车辆外,还需在行为设计上进一步深入,如基于认泊勺思考与行为模式来将系统的决策过程展示给用户;在结果或建议的同时给出理由并邀请用户反馈;学习了解用户并向提供更个性化的结果;对系统不足清楚说明并友好请求用户协助等。在不对用户主要任务产生妨碍的前提下,向用户充分展示自己,以体贴可靠的形象服务用户,不但能更好地获得并保持用户的合理信任,也能令用户获得更愉悦的体验。

结语

当车辆具备足够的自主能力后,人们用车的观点也可能发生变化,比如车辆会成为用户的伙伴或成為服务提供商提供的服务,有些车企也开始向服务提供商转型,购买私人车辆将成为一种更高层的需求。私人车辆须更了解用户并成为不可或缺的伙伴,才能赢得用户的青睐。这两种不同的发展方向都存在着人机界面设计的挑战,本文通过研究信任的构成以及自动驾驶系统如何获得合理的用户信任,提出了让用户能够放心使用自动驾驶车辆的人机界面设计初步策略,具体设计上依然有待深化,期望成为更进一步的设计研究的基础,延伸出更丰富的设计方案。

参考文献

[1]Society of Automotive Engineer.SAE J3016,Taxonomy and Definitions for Terms Related to On-Road AutomatedMotor Vehicles[S].Warrendale,PA,USA:SAE Pub.Inc,2014.

[2]Abraham H,Reimer B,Seppelt B,et al.Consumer Interest in Automation:Change over One Year[C].Washington,D.C:Transportation Research Board 97th Annual Meeting.2018.

[3]Parasuraman R,Riley V.Humans and Automation:Use,Misuse,Disuse,Abuse[J].Human Factors,1997,39(2):230-253.

[4]威肯斯.工程心理学与人的作业[M].第四版.北京:机械工业出版社,2014:274-279.

[5]Khastgir S,Birrell S,Dhadyalla G,et al.Calibrating Trust to Increase the Use of Automated Systems in aVehicle[A].In:Kacprzyk J ed.Advances in Human Aspects of Transportation[C].Basel,Switzerland:SpringerInternational Publishing Switzerland,2017:535~546.

[6]Hoff K A,Bashir M.Trust in automation:integrating empirical evidence on factors that influence trust[J].HumanFactors,2015,57(3):407-434.

[7]Lee J D,See K A.Trust in automation:designing for appropriate reliance[J].Human Factors,2004,46(1):50.

[8]Hauslschmid R,Bulow M V,Pfleging B,et al.Supporting Trust in Autonomous Driving[C]// Proceedings of the22nd international conference on intelligent user interfaces.ACM,2017:319-329.

[9]Lyons J B.Being transparent about transparency:A model for human-robot interaction[C]//2013 AAAI SpringSymposium Series.2013.

[10]Debernard S,Chauvin C,Pokam R,et al.Designing Human-Machine Interface for Autonomous Vehicles[J].Ifac Papersonline,2016,49(19):609-614.

[11]Waytz A,Heafner J,Epley N.The mind in the machine:Anthropomorphism increases trust in an autonomousvehicle[J].Journal of Experimental Social Psychology,2014,52(3):113-117.

[12]谢传伟.情感化设计在用户体验中的运用[J].设计,2014(2):21-22.

[13]许晓云,任静.汽车界面设计的智能化人机交互系统IJ].设计,2015(19):146-147.

[14]Seppelt B D,Victor T W.Potential Solutions to Human Factors Challenges in Road Vehicle Automation[M]//RoadVehicle Automation 3.Springer International Publishing,2016.

[15]郑博伟,吴亚生.新能源汽车时代车载HMI交互界面发展方向的探索[J].设计,2018(5):13-15.