离群点识别方法研究

2019-07-08黄强叶青聂斌

黄强 叶青 聂斌

摘 要:离群点又称特异点、兴趣点、偏离点、新颖点、異常点等。通过离群点识别可发现异常事件与新现象。随着信息技术的发展和信息量爆炸式增长,通过识别数据中的离群点获得潜在信息成为研究热点。首先简要介绍几种主要的离群点识别方法,并分析各种方法的优缺点,为相关使用者学习、选择和改进算法提供参考。阐述离群点识别的研究热点和应用邻域,并分析现有算法在识别高维、空间和时序数据离群点的难点,便于研究者提出新的相关离群点识别方法。

关键词:离群点识别;离群点;分析数据;数据挖掘;异常点

DOI:10. 11907/rjdk. 182475

中图分类号:TP301

文献标识码:A文章编号:1672-7800(2019)006-0035-07

Abstract: Outliers are also called special points, interest points, deviations, novelty points, outliers, etc. Outlier identification can detect abnormal events and new phenomena. With the development of information technology and the explosive growth of information, potential information by identifying outliers in the data has become the research hotspot and it has attracted more and more attention. This paper briefly introduces several main outlier recognition methods, and concisely analyzes the advantages and disadvantages of each method, providing a reference for later users to learn, select and improve the algorithm. At the same time, the research hotspots and application neighborhoods of outlier recognition are described, and the difficulties of existing algorithms in identifying outliers in high-dimensional, spatial and temporal data are analyzed, which is convenient for relevant researchers to propose new outlier recognition methods.

Key Words: outlier identification; outliers; analysis data; data mining; outlier

0 引言

对于离群点的概念目前还没有一个通用定义,Hawkins[1]第一次提出离群点定义:“某个数据点与数据集中其它的数据点偏离的太多,像是产生于不同的机制,这样的数据点我们把它称为离群点。”Barnet等[2]认为离群点是与样本中其它数据点显著不同的数据点。Johnson[3]认为与数据集中其它数据点的行为、表现不一致的数据点是离群点。离群点出现的原因有很多,大致可以分为两种:一种是数据异常(离群点),常为人为干涉的结果,比如药理实验出现新结果(之前实验没有出现过的结果),可能是人们期望出现的“异常”;第二种是自然发生的,比如异常天气的出现。

离群点有多种叫法,国外有学者把离群点称为outlier、exception、 abnormal point等,国内翻译为特异点、兴趣点、新颖点、偏离点、异常点等。为方便描述,本文一律用离群点代替。根据其特点,离群点大致可以分为如图1所示的几种类别。其中,数据点范围是指离群点偏离的对象位置。若离群点显著偏离于其所在局部区域数据点,则该离群点是局部离群点;若离群点显著偏离于全部数据点,则该离群点是全局离群点。现实世界中超过三维(属性)的数据均称为高维数据。不同离群点有相应方法识别,比如基于距离的离群点识别方法可以识别全局离群点,局部离群点需要应用基于密度的识别方法。

现有数据分析尝试通过建立一个能够拟合数据分布规律的模型对输入数据进行分类或者预测。在建模过程中,离群点导致拟合结果不准确,因此需去除数据集中的离群点。实际上,离群点在某些情景下包含丰富的有用信息,比如药理实验出现的新结果。因此离群点研究有重要的意义,不能简单地丢弃。

1 离群点识别方法

KNORREM 等[4]提出,知识发现可分为4类:依赖性检测、类识别、类描述、异常检测。前3项任务侧重于数据集中的大多数对象。数据挖掘中的大部分研究,比如关联规则、分类、数据聚类和概念泛化都属于前3项任务。然而第4项任务则侧重于经常被当作噪声丢弃的小部分数据对象。事实上,有时小部分数据对象携带的信息比大部分数据对象携带的信息更有研究意义,例如前文所指的药物实验的“异常点”,所以离群点识别的作用是挖掘一些异常数据对象,并发现其隐藏的信息。

随着对离群点识别的深入研究,离群点识别方法愈加丰富,其方法分类如图2所示。可以按照数据是否标记分为监督、半监督、无监督3类;也可以按照对离群点的假定分为基于统计、邻近、聚类3种。由于两种分类下的方法有交叉,本文重点从离群点假设角度介绍离群点识别方法,并概述各种方法的优劣。

1.1 监督、半监督、无监督方法

使用标记为正常和离群点的数据样本可建立离群点识别模型,其中离群点识别方法可分为监督、半监督和无监督三大类方法:①监督方法主要针对数据点正常性和离群性建模,通过学习给定的标记数据(正常数据或者离群数据)间存在的潜在联系识别离群点。比如通过学习标记为正常数据建模,与该模型不匹配的数据均被识别为离群点;②半监督方法。在现实应用中,小部分数据样本被标记,大部分未被标记,无法直接通过监督方法建模,因而提出半监督方法。半监督方法指通过标记数据和其邻近的未标记数据建模,不符合该模型的数据被标记为离群点;③无监督方法指针对难以处理的无标记数据,只能通过某种方法自主学习数据间的潜在联系。

分类方法是典型的监督方法,通过学习标记为某类别的数据建模,再使用该模型对数据进行分类,不属于该类别(不符合该模型)的数据即为离群点。比如支持向量机(SVM)通过学习数据(通常是正常数据)的决策边界识别离群点。给定一个新数据点,如果该数据点在决策边界外则被标记为离群点。半监督和无监督的方法有聚类、神经网络算法等。

1.2 基于统计的离群点

该概念的前提是数据对象是由某个统计模型产生的,如果数据对象不符合该模型或出现概率小于给定的阈值,则该对象被视作基于统计的离群点。

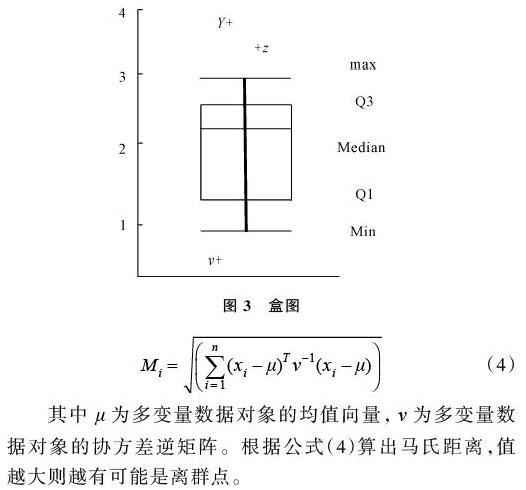

基于统计的离群点识别方法可以分为应用于多变量和单变量两大类。

在正态分布的假定下,卡方检验也可识别多变量离群点,数据对象卡方分布统计量值越大,则越可能是离群点。

基于统计的离群点识别方法的优点是所挖掘的离群点具有具体现实意义和统计学理论支撑。但这些方法均基于数据对象符合某个统计模型的假设,而现实世界中的数据大都不符合该假定。基于统计的离群点识别方法大多适用于低维数据集,同时时间复杂度与数据集大小有关,数据集越大,算法时间复杂度越大,因此遇到高维数据集则无法有效应对。

1.3 基于邻近的离群点

如果一个数据对象与它最近邻之间的邻近性显著地不同于其它对象与它最近邻的邻近性,则该数据对象为基于邻近的离群点。

如果数据对象集D中至少有P部分與数据对象O的距离大于D,则该对象O是以P和D为参数的基于邻近的离群点,记作DB(P,D),即如果在以D为半径的对象O的邻域内少于P(是一个分数)部分的数据对象,该对象可被定义为基于邻近的离群点,其中D确定邻域,P确定离群点。

基于邻近的离群点识别方法可以再细分为两种类型,一种是基于距离的,另一种是基于密度的。基于距离的离群点识别方法主要考虑对象邻域,如果一个对象在给定半径的邻域内没有足够数目(用户指定)的数据对象,则该数据对象为基于距离的离群点。基于密度的离群点识别主要考虑近邻的密度,如果对象的密度相对于近邻的密度很小,则该对象为基于密度的离群点。

(1)基于距离的离群点识别方法可以分为基于索引、基于嵌套和基于网格3种类别:①基于索引的方法[8-9]核心思想是在查找对象O邻域内数据对象数目的过程中,使用查询索引结构。根据给定数据对象集S建立多维索引(比如R树),之后根据索引查找对象邻域内的对象个数,如果n为使对象O成为离群点的临界值,在对象O邻域内搜索到第n+1个对象时,则判定该对象不是离群点并开始搜索下一个对象的邻域。基于索引的方法时间复杂度是 O(DN2),D是数据对象的维度,N是数据集的对象总数,但是没有囊括初始化索引结构的时间;②基于嵌套循环的方法[8,10]主要通过遍历对象集中的每个对象邻域确定该对象是否为离群点。嵌套循环算法有内外两个循环。外循环是遍历数据集中的每个对象,内循环遍历所有对象时,计算属于O邻域内的对象个数(n),一旦n超过给定阈值,则确定对象O不是离群点,跳出内循环,继续外循环直到遍历所有对象,算法时间复杂度为O(n2)。由于遍历所有数据对象时需计算对象间距离,所以该方法不适用于高维稀疏数据集;③基于网格的方法。由于基于嵌套循环的方法为确定一个对象是否为离群点,需遍历所有对象,为改进算法性能,提出基于网格[8,10-11]的方法。基于网格的方法是把对象集划分成由许多单元组成的多维网格,其中每个单元的边长为[r2k] ,k是数据对象的维度,r是用户指定的阈值参数。单元c邻近的单元被分成两层,直接与c相接的单元格构成第一层,在任意方向远离c单元一个或者两个单元的单元组成第二层。基于网格的方法根据这两个层对数据进行剪枝,从而提高了离群点检测效率,时间复杂度为O(ck + n),c为划分的单元格个数,k为数据维度,n为数据集大小。当数据对象数量很大时,基于网格的方法会导致大量对磁盘数据的随机访问。为解决该问题,朱庆生等[12]提出基于粗粒度单元的离群点识别方法,与传统基于单元格的算法相比,补充了初始化参数参考值的计算方法;其次对单元格划分方式稍作改进,使效率有所提高。陆声链[13]提出基于距离和的方法,在对数据集标准化后,计算每个对象与数据集剩下所有对象的距离和,并按距离和从小到大排序,前M个距离和最大的对象为离群点。

综上所述,本文首先从数据集中抽取一个样本集s,s的每一个对象均作为一个簇的形心,然后第一次扫描数据对象集,根据对象间距离把数据对象划分到各个簇中,第二次扫描数据集时,确定候选离群点(可能是离群点的对象),第三次扫描后找出所有基于DB(P,D)的离群点。该方法空间复杂度小,约为数据对象集的1%。

对于高维数据,有学者提出了新方法。Angiulli[10]通过比较数据对象与其k近邻的平均距离对数据集中的对象排序,平均距离大的前M个数据对象被识别为离群点。Ghoting[11]提出基于距离的两阶段算法——RBRP算法,该算法主要在识别离群点之前,先对数据对象进行聚类处理,形成若干数量的小类,再在小类中识别离群点,减少计算距离的量,提高算法效率,但在聚类处理阶段需用户指定类别数,且聚类效果取决于所用聚类算法。

在数据流的离群点识别方面,Kontaki[15]提出基于滑动窗口的离群点识别算法。当在给定半径R中邻居数少于K时,数据对象可视为离群点。虽然该方法不能保证存储开销比相关算法更小,但比相关算法效率更高,并且在输入参数方面有较高的灵活性。

基于距离的离群点识别方法无须知道数据符合的分布模型,可以较广泛地应用于距离度量的离群点识别。但该类方法对参数要求敏感,参数不同会导致不同的识别结果,而且不能识别出局部离群点。

(2)基于密度的离群点识别方法。该方法检测离群点时的参数是基于全局的,识别出的离群点被称为全局离群点。但是实际生活中的数据集往往复杂多样,其中存在一种离群点相对于自己邻近的数据对象是离群的,但是基于全局识别会被识别为正常对象,这样的对象被称为局部离群点。如图4所示,点O1为局部离群点。

在LOF方法中数据对象不再是非此即彼的关系,每个数据对象都有大小不一的LOF值,LOF值越大,越有可能是离群点。

LOF算法虽然能够识别出局部离群点,但计算可达距离和可达密度代价较大。Agyemang[17]对此作出改进并提出LSC-Mine算法。该方法先通过剪枝把不可能是离群点的对象去除,减少候选对象数,削减了计算量;然后通过计算局部稀疏率(Local Sparsity Ratio,LSR)确定离群点。LSR是对象O的k近邻数与其k近邻距离和的比值,LSR越小,是离群点的可能性越大。通过降低计算复杂度的改进算法还有MDEF算法[18]。其它改进算法有COF算法[19],常用于序列数据集中的离群点识别,INFLO算法[20]在数据分布模型复杂的数据集中能有效识别离群点。

LOF算法无法有效应对数据分布异常的情况,INLOF不加区分地分析K近邻和反向K近邻导致效率低下。因此邹云峰等[21]提出LDBO算法,通过引入强K近邻点和弱K近邻概念分析数据间相关性,尽可能避免不必要的反向K近邻分析,提高算法效率。

胡彩平[22]提出DLOF算法,该算法通过引入信息熵确定离群属性,并在计算对象间距离时为离群属性增加权重,提高离群点识别准确度,然后计算经过优化的LOF值以识别离群点。DLOF算法虽然提高了离群点识别准确度,但是在优化过程中需提前计算各对象之间的距离,增加了额外空间花销。

王敬华[23]提出的NLOF算法首先使用DBSCAN算法对数据进行预处理得到初步异常数据集,再计算各个数据对象的信息熵增量作为后续LOF计算中加权距离的权重,以此计算出LOF值识别出离群点。文献[24-26]也提出一些改进的LOF算法。

基于密度的离群点识别方法能够识别出局部离群点,但是由于也涉及到距离计算,时间复杂度通常为O(n2),在高维数据下效率不是很理想。

1.4 基于聚类的离群点

基于聚类的离群点识别方法主要思想是通过聚类算法把数据对象集自动分成若干个簇,不属于任何一簇的数据对象即为离群点。如果一个对象不属于任何一个簇或者属于一个微小簇,则该数据对象为基于聚类的离群点。

基于聚类的离群点识别方法有很多,下文分别介绍基于划分的、基于层次的、基于网格的、基于密度的聚类方法。

(1)基于划分的聚类方法主要思想是在给定常数k下,根据数据对象之间的相似性把数据对象分别划分到k个簇中,每个簇中至少有一个数据对象。

K-means[27]是划分方法中经典的聚类算法之一,该算法效率高,适用于大规模数据聚类,现在很多算法均是基于该算法改进而来的。

K-means算法首先从数据对象集中随机地选择k个对象,每个对象初始地代表了一个簇的平均值或中心,对剩余的每个对象,根据其与各个簇中心的距离,将它划分给最近的簇;然后重新计算每个簇的平均值。这个过程不断重复,直到准则函数(比如平方误差准则)收敛或者达到期望阈值。

文献[28]提出基于遗传算法的K-means聚类方法,该方法通过遗传算法确定初始聚类中心,存在前期过早收敛和后期收敛过慢的缺点,但可以解决传统遗传聚类算法聚类结果不稳定性问题。

K-means算法对高维数据聚类效率不是很理想,并且只适用于数值类数据;其次需设定希望得到的聚类数k,需求研究者对数据有很好的理解度。在K-means的基础上,很多学者提出新的改进方法,如文献 [29-34]中的改进方法。

(2)基于层次的方法是将数据对象组成有层次的结构,比如学生类可以细分为小学生、中学生和大学生。学生为一个层次,下面的子类为一个层次。把低层次聚类成高层次或者高层次拆分为低层次的聚类即为基于层次的聚类。

根据层次分解顺序是自下向上或自上向下,层次聚类算法分为凝聚的层次聚类算法和分裂的层次聚类算法。

凝聚型层次聚类的策略是先将每个对象作为一个簇,然后合并这些原子簇为越来越大的簇,直到所有对象都在一个簇中,或者某个终结条件被满足。与此相反,分裂的层次聚类是把整个数据对象形成的簇迭代地分裂为较小的簇群。凝聚层次聚类算法AGNES[35]首先把数据对象集中的每个对象划分成一个簇,之后根据各个簇之间的相似度(最小距离等)合并簇,重复此过程直到达到期望的簇数目,或使两个最近簇之间的距离超过某个阈值。分裂层次聚类算法DIANAN[36]的过程则和AGNES算法相反。

层次聚类的缺点是合并或分裂点选择困难,因此后来出现了将层级聚类和其它聚类技术进行集成、形成多阶段聚类的方法。比如BIRCH算法和Chameleon算法[37]等。

(3)基于网格的方法将数据对象空间划分为若干的单元格,每个对象都落入相应网格中,形成一个网格结构,所有数据操作均在网格层次进行。基于网格的聚类算法在处理大数据集合高维的数据集时比较有效。

STING算法[8,38]是一种基于网格的多分辨率聚类,数据空间按照分层和递归的方法进行划分,首先所有数据被劃分若干个最低层次的网格,上一层次的网格由若干个低层次的网格组成,以此类推,形成多层次网格聚类。每个网格单元的统计信息被当作参数提前被存储,更高的单元网格参数信息可由低层次网格单元计算得出,所以STING算法可独立于查询,而且网格结构有利于增量更新和并行处理;但是由于STING是多分辨率的方法,低层次网格单元聚类成高层次网格单元时的效率取决于底层网格单元粒度,即分得越细,效率越低,若粒度粗糙,则聚类效果不佳。

CLIQUE[8]方法包括两阶段聚类:第一步先把数据对象空间按照不同的属性组合划分成不重叠的单元,在此基础上找到稠密单元(需要指定稠密阈值);第二步合并互相可以邻接的稠密单元,形成更高维单元,直到遍历所有单元。该方法需要依赖给定的稠密阈值。

(4)基于密度的方法。大部分聚类方法只能发现球状簇,对于其它形状的数据因无法识别会出现误判。而基于密度的聚类方法可以发现任意形状的簇群。

DBSCAN[39]基于一组邻域描述样本集紧密程度,参数(∈,MP)描述邻域样本分布紧密程度。其中,∈描述某一样本邻域距离阈值,MP描述某一样本距离为∈的邻域中样本个数的阈值。其主要思想是:对于给定的数据集合中每個数据对象在给定领域内必须包含有规定的最少数据对象,这样的对象称为核心对象;核心对象通过密度相连等关系被聚类成一个簇,如此便可以识别出任意形状的数据对象簇。该方法也需要人为地指定参数(∈,MP),参数设置的不同会导致不同的聚类结果。

为避免使用一组全局参数,Ankerst等[40]提出OPTICS方法。OPTICS方法并不显式地产生聚类,而是输出一个簇排序,这个簇排序可反映各个数据对象基于密度的聚类结构。该方法可用图形表示簇排序,只需设定一个阈值,即可轻易找出满足阈值条件下基于密度聚类的离群点。最坏情况下算法时间复杂度为O(n2),n为数据对象数。

Rodriguez[41]提出新的基于密度的聚类方法DPCA。该方法假定高密度的聚类中心被局部密度低的对象包围,且距离另一个聚类中心较远,计算局部密度[ρ]和对象与高密度对象间距离d,具有较大的d和[ρ]的对象即为聚类中心,具有较大d和较小[ρ]的即为离群点。魏龙等[42]提出的DD-DBSCAN算法通过运用最小生成树,对DBSCAN进行改进,使算法无需输入参数即可同时识别全局和局部离群点。

一直以来不断有学者提出新的聚类算法识别离群点,Levent Ertoz[43]提出基于共享邻居的聚类方法SNN,通过构造相似矩阵,计算数据对象之间的链接强度,并以此为依据确立聚类中心和离群数据,输出离群数据。但是SNN对离群点的处理力度有限,必须建立SNN图和计算各个数据对象的链接强度后才开始确定数据对象是否离群点。耿技[44]对此提出改进的SNN算法。

聚类方法的目的是发现簇,离群点是聚类副产品。虽然有学者直接通过聚类方法识别离群点,但识别效率较低,所以聚类方法常结合其它方法识别离群点。

古平等[45]提出多重聚类的算法—PMLDOF。该方法的思想是通过不同的聚类方法或者以同一聚类方法、不同参数剪枝数据,数据对象在均被划分到某一簇中才被确定为非离群点,否则被确定为候选离群点。最后计算候选离群点的LOF确定离群点。PMLDOF算法通过剪枝处理可减少时间复杂度,提高识别准确度。

为识别动态数据集中的离群点,孟静[46]在DBSCAN原有的基础上进行改进。对于新增的数据对象,计算该对象到各个簇中心的距离,若到最近簇中心的距离小于给定阈值,则将对象划分到最近簇中,否则放入异常数据集中;再计算异常数据集的对象LOF值以确定离群点。该方法能有效识别增量数据中的离群点,时间复杂度也较低。

Christy[47]利用K-means聚类得到候选离群点集,然后根据离群点到最近簇簇心的欧式距离排序,top-n被识别为离群点。

石鸿雁等[49]提出DBSCAN和LAOF算法结合的两阶段离群点识别方法,通过优化参数的DBSCAN和新构造的LAOF(基于区域密度的局部异常因子)计算筛选数据对象的离群程度,并引用去一化信息熵确定数据属性权重,提高离群点识别精度。文献[48]提出互邻图概念以及基于互邻图的聚类算法ROCF,该算法可自动算出数据对象离群度,不用给定top-n参数即可识别出离群点。

任建华等[50]提出基于聚类的两段式识别算法,先通过聚类算法得到候选离群点集合,之后对离群点排序得到有序的离群点集合,最终由两集合的交集确定离群点。该算法无需预设离群点个数,具有较高准确率和效率,且对数据分布不敏感,能有效识别离群点。

1.5 方法总结

综上所述,各类方法的情况总结见表1。

2 离群点识别热点与应用

2.1 离群点识别热点

(1)高维数据离群点识别。高维数据是指维数超过三维的数据。该类数据属性众多,数据间距离难以定义,但是真正可以标识一个数据样本的属性只占其中一部分。对于该类数据一般先对数据降维,之后再使用相应离群点识别方法识别离群点。缺点是降维之后,数据信息会损失一部分。现有方法对该类数据的识别效率较低,还需克服以下问题:①对高维离群点的解释;②高维数据稀疏性;③如何表示高维数据点间的差异。

(2)空间数据离群点识别。随着全球定位系统(GPS)和各种空间数据传感器的出现,空间数据复杂性和量级不断增加,空间数据离群点识别成为难题。空间数据离群点识别的难处在于其包含非空间属性和空间属性,同时空间数据具有自相关性和异质性,空间数据受到邻近数据影响,因此空间数据离群点局部不稳定。常用方法有变差云图、Z-Score,用于低维空间数据,对于高维空间数据,有学者提出相应方法。文献[51]提出一个空间局部异常度量(SLOM),借助SLOM可够识别出局部空间离群点;文献[52]提出一种无参数的自适应空间离群点检测算法,该算法能够计算空间邻居个数,并能够自动找到离群点检测阈值;文献[53]提出基于地统计学的检测算法,算法应用空间自相关理论,利用德洛内三角网构建空间邻域,用邻域节点均值代替离群点。随着数据采集设备的更新,空间数据越来越复杂,提高算法有效性是空间离群点识别的重点。

(3)时序数据离群点识别。时序数据是与时间有关的一系列数据,比如每个月的用水量、某个时期降雨量、直播期间网络流量等。因为时序数据周期性影响,使时序数据离群点难以识别。常见方法是将时序数据的时间划分成等长子序列,然后使用基于距离的识别方法识别离群点,缺点是计算花费大;另一种方法是从序列数据中抽取特征,通过计算特征数据的距离识别离群点[54-56]。

2.2 离群点识别应用

离群点识别有助于剥离复杂的表象,挖掘隐含的重要信息,因此具有重要意义。

(1)去除干扰数据。实验数据采集或传感器数据传输可能出现不可抗原因导致的数据缺失,增加错误数据,使实验结果不准确或出现不实信息。识别并去除数据中的干扰数据(离群点)是数据挖掘重要环节。

(2)欺诈检测。银行卡或者储蓄账号被盗取后,购买模式会不同于原有购买模式。银行或者金融机构通过原有购买模式建立的模型可识别出反常购物行为,及时冻结账号并告知持有者,大幅降低用户被盗刷的可能性。

(3)入侵监测。如BAT等公司的数据库中存放大量宝贵的數据,为以防不法分子运用技术手段入侵数据库,相关机构可通过离群点识别等方法使网络入侵监测系统时刻检测入侵行为。

(4)异常气候监测。自然气候变化多端,离群点识别可提高异常天气预测准确率,提醒公众注意防害防灾。

(5)交通状况监测。交通异常监测系统通过监测道路探头传回的视频识别交通流量,发现车流量异常,判别是否交通堵塞或发生事故,能协助交警及时处理交通事件。

离群点识别还可以应用于医疗状况监测、股票市场异常的大量买入卖出行为、网络状况监测、机器故障监测、药物研究中新实验结果识别、直播平台突发大流量检测等。

3 结语

随着信息技术的发展和信息量爆炸式增长,离群点识别的重要性日益凸显。离群点识别的热点分布于图与网络数据集、时序数据集、空间数据集、数据流等领域。

在离群点识别方法方面,随着深度学习的兴起,基于神经网络的离群点识别方法将是未来重点研究方向。如文献[57-60]提到运用神经网络方法识别离群点,文献[57-58]利用基于能量函数的神经网络算法RBM识别离群点。文献[59-60]提出使用DBN算法检测离群点。

离群点识别方法还存在一些不足,如何形式化和量化数据之间的差异,提高识别方法的效率是下一步离群点识别研究的重点。

参考文献:

[1] HAWKINS D. Identification of outliers [M]. London: Chapman and Hall,1980.

[2] BARNETT V,LEWIS T. Outliers in statistical data[M]. 3rd edition. New York: John Wiley and Sons, 1994.

[3] JOHNSON R. Applied multivariate statistical analysis. New Jersey: Prentice Hall,1992.

[4] KNORR E M,NG R T. Algorithms for mining distance-based outliers in large datasets 1998 [C]. Proceedings of VLDB, 1998:392-403.

[5] GRUBBS F E. Procedures for detecting outlying observations in samples[J]. Techno Metrics1969 (11): 1-21.

[6] LAURIKKALA J, JUHOLA M, KENTALA E. Informal identification of outliers in medical data[C]. Berlin: Fifth International Workshop on Intelligent Data Analysis in Medicine and Pharmacology,2000.

[7] BEN-GAL I. Outlier detection[M]. Data Mining and Knowledge Discovery Handbook, 2005.

[8] HAN J W,KAMBER M. 数据挖掘:概念与技术[M]. 范明,孟晓峰,译. 机械工业出版社, 2007.

[9] BAY S D. Mining distance-based outliers in near linear time with randomization and a simple pruning rule[C]. ACM SIGKDD International Conference on Knowledge Discovery and Data Mining, 2003:29-38.

[10] ANGIULLI F, PIZZUTI C. Fast outlier detection in high dimensional spaces[C]. European Conference on Principles of Data Mining and Knowledge Discovery, 2002:15-26.

[11] GHOTING A,PARTHASARATHY S,OTEY M E. Fast mining of distance-based outliers in high-dimensional datasets[J]. Data Mining & Knowledge Discovery,2008,16(3):349-364.

[12] 朱庆生,王震. 基于粗粒度单元的离群点检测算法研究[J]. 世界科技研究与发展,2011,33(6):1045-1048.

[13] 陆声链,林士敏. 基于距离的孤立点检测研究[J]. 计算机工程与应用,2004,40(33):73-75.

[14] 张宏翔. 使用RNN的基于距离的孤立点检测[J].信息与电脑,2017(8):81-82.

[15] KONTAKI M,GOUNARIS A,PAPADOPOULOS A N,et al. Efficient and flexible algorithms for monitoring distance-based outliers over data streams[J]. Information Systems, 2016, 55(C):37-53.

[16] BREUNIG M. LOF: identifying density-based local outliers[C]. ACM SIGMOD International Conference on Management of Data, 2000:93-104.

[17] AGYEMANG M, EZEIFE C I. Lsc-Mine: algorithm for mining local outliers[C]. 2004.

[18] PAPADIMITRIOU S, KITAGAWA H, GIBBONS P B, et al. LOCI: Fast Outlier Detection Using the Local Correlation Integral[C]. International Conference on Data Engineering, 2003. Proceedings. IEEE, 2003:315-326.

[19] TANG J, CHEN Z, FU W C, et al. Enhancing effectiveness of outlier detections for low density patterns[C]. Pacific-Asia Conference on Knowledge Discovery and Data Mining. Springer, Berlin, Heidelberg, 2002:535-548.

[20] JIN W, TUNG A K H, HAN J, et al. Ranking outliers using symmetric neighborhood relationship[C]. Pacific-Asia Conference on Knowledge Discovery and Data Mining, 2006:577-593.

[21] 邹云峰,张昕,宋世渊,等. 基于局部密度的快速离群点检测算法[J]. 计算机应用,2017,37(10):2932-2937.

[22] 胡彩平, 秦小麟. 一種基于密度的局部离群点检测算法DLOF[J]. 计算机研究与发展,2010, 47(12):2110-2116.

[23] 王敬华,赵新想,张国燕,等. NLOF:一种新的基于密度的局部离群点检测算法[J]. 计算机科学,2013,40(8):181-185.

[24] 王敬华,金鹏.基于粗约简和网格的离群点检测[J].计算机工程与应用,2015,51(3):133-137+180.

[25] 王茜,刘书志.基于密度的局部离群数据挖掘方法的改进[J].计算机应用研究,2014,31(6):1693-1696+1701.

[26] 周鹏,程艳云.一种改进的LOF异常点检测算法[J].计算机技术与发展,2017,27(12):115-118

[27] HARTIGAN J A. A K-means clustering algorithm[J]. Appl Stat, 1979, 28(1):100-108.

[28] 左倪娜. 基于改进遗传算法的K-means聚类方法[J].软件导刊,2016,15(4):32-34.

[29] 华辉有,陈启买,刘海,等. 一种融合Kmeans和KNN的网络入侵检测算法[J]. 计算机科学,2016,43(3):158-162.

[30] 李小川,刘媛华. 基于Hadoop的多核果蝇-Kmeans聚类算法[J]. 软件导刊,2018,17(4):51-53+57.

[31] YING S, ZHU Q, CHEN Z. An iterative initial-points refinement algorithm for categorical data clustering[J]. Pattern Recognition Letters, 2002, 23(7):875-884.

[32] JIANG F, LIU G, DU J, et al. Initialization of K-modes clustering using outlier detection techniques[J]. Information Sciences, 2016, 332(11):167-183.

[33] 韩崇,袁颖珊,梅焘,等. 基于K-means的数据流离群点检测算法[J]. 计算机工程与应用,2017,53(3):58-63.

[34] 蒋丽,薛善良. 优化初始聚类中心及确定K值的K-means算法[J]. 计算机与数字工程,2018,46(1):21-24+113.

[35] KAUFMAN L, ROUSSEEUW P J. Finding groups in data: an introduction to cluster analysis [M]. New York: John Wiley & Sons, Inc. 1990.

[36] KAUFMAN L, ROUSSEEUW P J. Finding groups in data: an introduction to cluster analysis [M]. New York: John Wiley & Sons, Inc. 2008.

[37] KARYPIS G, HAN E H, KUMAR V. Chameleon: hierarchical clustering using dynamic modeling[J]. Computer, 2002, 32(8):68-75.

[38] WANG W, YANG J, MUNTZ R R. STING: a statistical information grid approach to spatial data mining[J]. 1997:186-195.

[39] UNCU O, GRUVER W A, KOTAK D B, et al. GRIDBSCAN: Grid density-based spatial clustering of applications with noise[C]. IEEE International Conference on Systems, Man and Cybernetics, 2007:2976-2981.

[40] ANKERST M,BREUNIG M M,KRIEGEL H P,et al. Ordering points to identify the clustering structure[C]. International Conference on Management of Data. 1999.

[41] RODRIGUEZ A, LAIO A. Clustering by fast search and find of density peaks[J]. Science, 2014, 344(6191):1492.

[42] 魏龍,王勇. 基于密度划分的离群点检测算法[J]. 计算机与现代化,2015(3):26-32.

[43] LEVENT E, STEINBACH M, VIPIN K. A new shared nearest neighbor clustering algorithm and its applications[C]. The Workshop on Clustering High Dimensional Data & ITS Applications at SIAM International Conference on Data Mining, 2002.

[44] 耿技,印鉴. 改进的共享型最近邻居聚类算法[J]. 电子科技大学学报,2006,35(1):70-72.

[45] 古平,刘海波,罗志恒. 一种基于多重聚类的离群点检测算法[J]. 计算机应用研究, 2013, 30(3):751-753.

[46] 孟静,吴锡生. 一种基于聚类和快速计算的异常数据挖掘算法[J]. 计算机工程, 2013, 39(8):60-63.

[47] CHRISTY A,GANDHI G M,VAITHYASUBRAMANIAN S. Cluster based outlier detection algorithm for healthcare data[J]. Procedia Computer Science, 2015, 50(12):209-215.

[48] HUANG J, ZHU Q, YANG L, et al. A novel outlier cluster detection algorithm without Top-n parameter[J]. Knowledge-Based Systems, 2017, 121(1):32-40.

[49] 石鸿雁,马晓娟. 改进的DBSCAN聚类和LAOF两阶段混合数据离群点检测方法[J]. 小型微型计算机系统,2018,39(1):74-77.

[50] 任建华,高立明. 基于聚类的两段式孤立点检测算法[J]. 计算机工程与应用,2016,52(20):98-102+176.

[51] SUN P, CHAWLA S. On local spatial outliers[C]. IEEE International Conference on Data Mining, 2004:209-216.

[52] XU W, GAO H, LIU Y, et al. An adaptive spatial outlier detection algorithm with no parameter for WSN[C]. International Conference on Information Fusion, 2017:1-8.

[53] 刘莘,张绍良,王飞,等. 基于地统计学的空间离群点检测算法的研究[J]. 计算机应用研究,2016,33(12):3700-3704.

[54] CHOY K. Outlier detection for stationary time series[J]. Journal of Statistical Planning & Inference, 2001, 99(2):111-127.

[55] MA J, PERKINS S. Time-series novelty detection using one-class support vector machines[C]. International Joint Conference on Neural Networks, 2003:1741-1745 .

[56] MARCZAK M, PROIETTI T. Outlier detection in structural time series models: The indicator saturation approach[J]. International Journal of Forecasting, 2016, 32(1):180-202.

[57] WAN Y, BIAN F. Cell-based outlier detection algorithm: A fast outlier detection algorithm for large datasets[C]. Pacific-Asia Conference on Advances in Knowledge Discovery and Data Mining, 2008:1042-1048.

[58] ZHAI S,CHENG Y,LU W,et al. Deep structured energy based models for anomaly detection[C]. New York: Proceedings of the 33rd International Conference on Machine Learning, 2016.

[59] DO K, TRAN T, PHUNG D, et al. Outlier detection on mixed-type data: an energy-based approach[C]. 12th International Conference on Advanced Data Mining and Applications, 2016:111-125.

[60] SHARMA M K, SHEET D, BISWAS P K. Abnormality detecting deep belief network[C]. International Conference on Advances in Information Communication Technology & Computing, 2016:11.

(責任编辑:江 艳)