基于IPCNN的红外与可见光图像融合算法

2018-11-17江泽涛周哓玲

江泽涛,吴 辉,周哓玲,黄 锦

(1.桂林电子科技大学 广西高校图像图形智能处理重点实验室,广西 桂林 541004;2.桂林电子科技大学 广西可信软件重点实验室,广西 桂林 541004)

0 引 言

红外图像记录了目标物体的温度信息,对低照度下或者伪装的目标有较强的识别能力。可见光图像受光照的影响程度较大,可以提供目标所需要的背景信息。红外与可见光图像融合有利于观察者对该场景进行更加准确、全面的描述[1,2]。

非降采样轮廓波变换(nonsubsampled contourlet transform,NSCT)能够多尺度、多方向的表示图像,并且具备平移不变性,可以产生较好的融合效果[3,4]。但图像的多尺度分解方法普遍存在计算复杂度高,实时性差等问题。压缩感知(compressive sensing,CS)理论的提出有效地弥补了这一不足。文献[5-7]将CS应用于图像融合中,讨论了不同采样率对融合图像的影响,取得了较好的融合结果。文献[8]将CS与NSCT相结合,在保证融合质量的同时提高了算法运行效率。脉冲耦合神经网络(pulse coupled neural network,PCNN)从被提出到现在,一直受到人们的重点关注。文献[9]对PCNN进行改进,解决了PCNN中参数设置复杂、迭代次数无法固定等问题。文献[10]则提出了一种多通道PCNN模型。文献[1]、文献[11]结合使用了NSCT和PCNN,将图像的边缘信息作为PCNN的外部输入,充分保留了图像的细节信息,取得了较为理想的融合结果。

结合CS与PCNN的优势,本文提出了一种基于改进脉冲耦合神经网络(improved pulse coupled neural network,IPCNN)的图像融合算法。对NSCT低频子带,进一步采用静态小波变换(static wavelet transform,SWT)对其进行分解,采用CS理论对SWT分解后的高频子带进行融合,提高了算法效率。对NSCT高频子带采用绝对值取大与IPCNN相结合的融合方法,并将链接突触计算神经网络(linking synaptic computation network,LSCN)引入其融合过程中,使图像的细节信息更加丰富。LSCN和IPCNN算法保留了图像的全局特征以及每个像素点的特性,能够突出表现图像边缘,使融合结果视觉观感更佳。

1 压缩感知理论

1.1 压缩感知原理

CS理论主要包含稀疏表示、测量采样以及信号重构3部分,其详细介绍如下:

(1)稀疏表示:假设x为离散信号,其长度为N,则x在某一N×N正交基或稀疏字典Ψ下的稀疏表示为

x=Ψθ

(1)

其中,θ为x在基Ψ上的稀疏系数,且θ中非零元素的个数远小于N。

(2)采样测量:对稀疏化信号以远小于奈奎斯特采样定理要求的采样率进行采样,得到观测信号y,y∈RM,即

y=Φx=ΦΨθ=Aθ

(2)

其中,Φ是对信号x的测量矩阵,A=ΦΨ,Φ∈RM×N,A∈RM×N。

(3)信号重构:当测量矩阵Φ满足k限定等距性,则可以利用观测值y恢复出信号x,即

(3)

通过求解上述凸优化问题,可得信号x的最稀疏解

(4)

1.2 分块压缩感知

为了解决CS在图像重建中存在的存储量大、耗时等问题,对图像进行分块压缩感知(block compressive sensing,BCS)。其原理是把源图像分割成B×B大小的子块,将每个子块排列成列向量后压缩投影到各自的观测矩阵上,得到每个子块的观测值,最后对所得到的观测值φBi进行优化求解[12]。观测矩阵φ为对角矩阵,即

(5)

2 LSCN与PCNN理论

在图像融合中,适当引入图像增强算法可以提高融合图像的视觉观感,使最终的融合图像具备较好的边缘信息和对比度。文献[13]针对传统增强算法的不足,提出了一种LSCN模型,能够较好的滤除图像噪声并增强边缘细节信息,提高融合图像的可见性及对比度。

2.1 脉冲耦合神经网络

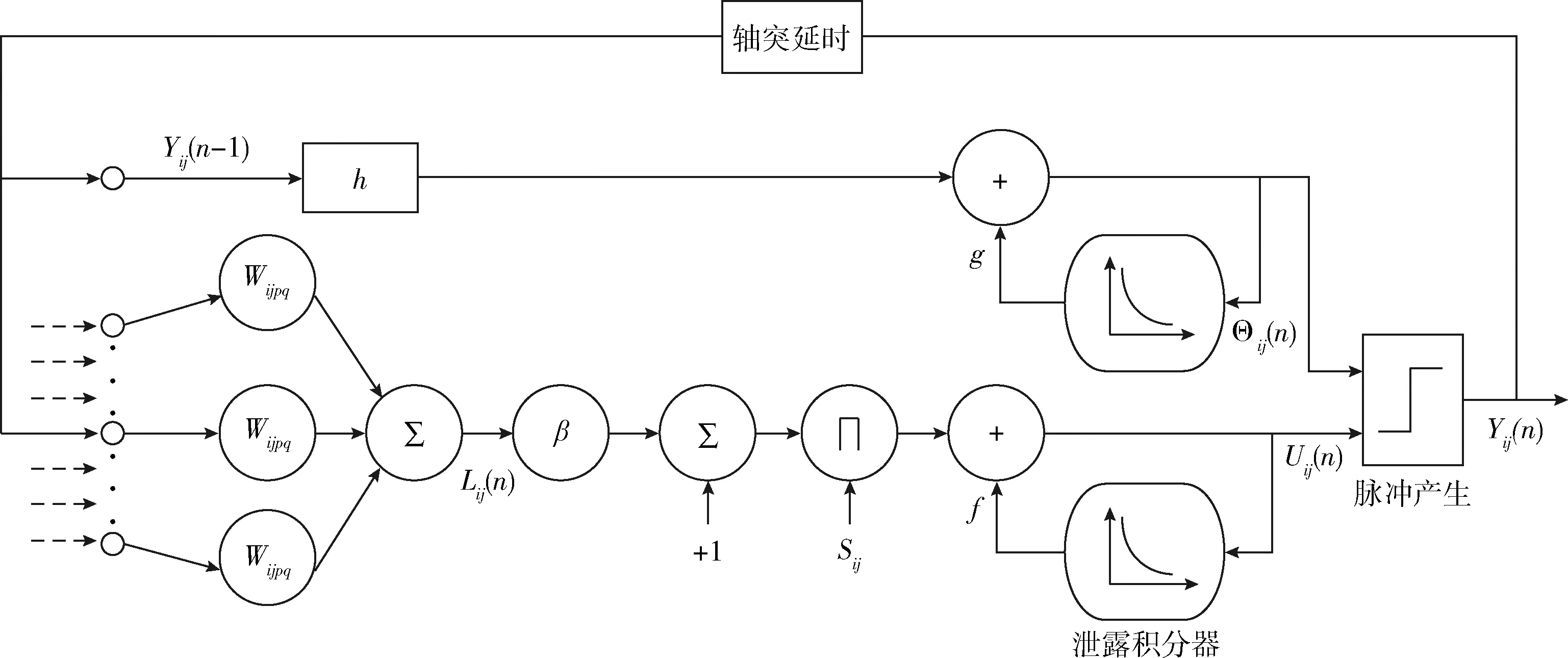

单个PCNN[14,15]神经元由输入、链接调制、脉冲产生3部分构成。PCNN的输入部分包含反馈输入以及链接输入,其中反馈输入是主要输入信号,用于刺激PCNN神经网络开始运作,链接输入部分作为辅助信号,将其与反馈输入信号相调制,调制结果输出到脉冲产生域。若调制结果大于阈值,则神经元产生点火并发射脉冲。如此经过多次迭代以后,将神经元总的点火次数构成点火映射图作为PCNN的输出。

2.2 链接突触计算神经网络

LSCN模型在PCNN的基础上做了两点改进,包括将膜电位表达为漏电积分器以及对反馈输入进行简化。其数学表达式如下

(6)

其中,L是链接输入,U表示神经元内部调制结果,Θ和Y分别代表阈值和神经元的输出,l为链接常量,Wijpq是链接输入权值,f和g均表示衰减常量,S、β、h依次为外部刺激输入、链接强度及放大系数。相关LSCN增强模型的理论内容可以参考文献[13]。单个LSCN神经元结构如图1所示。

图1 LSCN神经元结构模型

3 本文融合算法

3.1 融合规则步骤

本文融合算法过程图如图2所示,算法步骤如下:

步骤1 采用NSCT对源图像进行分解,得到低频子带LJ(x,y)与高频子带Hj,r(x,y),其中J为分解层数,j、r代表分解尺度和方向数。

步骤2 对NSCT低频子带进行SWT分解,分别采用局部能量与绝对值取大相结合和CS理论对小波低频、高频子带进行融合,再进行小波逆变换得到NSCT重构的低频子带系数。

步骤3 判断待融合图像的清晰度,根据判决准则选取

LSCN的增强层数。

步骤4 分别采用绝对值取大与IPCNN模型对NSCT高频子带的最高层与其余各层子带进行融合。

步骤5 对融合得到的低、高频子带进行NSCT逆变换,得到融合图像。

3.2 低频融合规则

根据不同多尺度分析方法的互补特性[16,17],采用SWT对NSCT分解得到的低频系数进行融合。图像的低频部分包含了图像中大部分能量信息,本文采用局部区域能量与绝对值取大相结合的融合方式对SWT低频子带进行融合,融合准则如式(7)所示

图2 本文融合算法过程

(7)

式中:EN为局部区域能量,其定义为

(8)

对于SWT分解得到的高频子带系数,采用CS理论进行融合,提高了算法效率,具体步骤如下:

(2)设计测量矩阵Φ,对输入的高频子带系数进行测量

(9)

标准差反映了图像的对比度信息,其公式为

(10)

图像清晰度公式为

(11)

加权系数ω参考文献[11]中的S函数得到,即

(12)

其中

(13)

f为S函数的收缩因子,并且f大于等于1,本文取f=5;

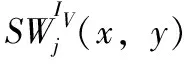

3.3 高频融合规则

图像的细节成分大多保存在高频子带中。本文采用分层融合的策略对高频部分进行融合,并在融合过程中引入LSCN模型对高频系数进行增强。由于LSCN模型有时存在微弱的振铃效应,且直接使用LSCN对高频系数增强会过分突出融合图像的边缘,因此本文通过计算待融合图像的清晰度来判断LSCN增强的高频层数。融合准则如下:

根据式(11)计算图像清晰度并将其与阈值λ比较,根据比较结果决定高频系数增强的层数,即

(14)

其中,J为分解层数,两幅图像整体的清晰度用S表示,取α1=α2=0.5,λ=27。

对最高层高频子带n采用绝对值取大的方法进行融合,以提高融合图像总体的对比度和亮度,即

(15)

为了增强图像的视觉观感,对除最高层高频子带n以外的其余子带,采用IPCNN模型进行融合,通过比较IPCNN神经元的点火幅度之和来确定融合系数,即

(16)

其中,Mij(n)为IPCNN输出的脉冲点火幅度总和,j=1,2,…,n-1,ε为自定义阈值,本文取ε=0.002。

本文采用一种软限幅的Sigmoid函数作为IPCNN神经元的输出,与传统PCNN模型相比,能够更好体现神经元点火时脉冲幅度的不同。Sigmoid函数为

(17)

本文选用改进的拉普拉斯能量和(sum of modified Laplacian,SML)与局部空间频率分别作为IPCNN的外部输入和链接系数,以更好地保留图像的边缘信息。SML定义如下

SMLj,r(i,j)=|2Ij,r(i,j)-Ij,r(i-h,j)-Ij,r(i+h,j)|+

|2Ij,r(i,j)-Ij,r(i,j-h)-Ij,r(i,j+h)|+

|1.4Ij,r(i,j)-0.7Ij,r(i-h,j-h)-0.7Ij,r(i+h,j+h)|+

|1.4Ij,r(i,j)-0.7Ij,r(i+h,j-h)-0.7Ij,r(i-h,j+h)|

(18)

空间频率为

(19)

其中,RF、CF、MDF和SDF分别表示行频率、列频率、主对角频率和副对角频率,其公式如下

RF=[I(i,j)-I(i,j-1)]2

CF=[I(i,j)-I(i-1,j)]2

MDF=[I(i,j)-I(i-1,j-1)]2

SDF=[I(i,j)-C(i-1,j+1)]2

(20)

4 融合实验与效果分析

4.1 实验设置

选取几组待融合图像进行算法验证,并将本文算法的融合结果与其它方法进行比较。本文中所选图像均为灰度图。NSCT采用′maxflat′滤波器和′dmaxflat7′滤波器,方向级数为[1,2,2]。IPCNN的迭代次数为10次,远小于文献[14]中设置的200次。实验采用的CS分块大小均为8×8,局部窗口大小为3×3。

4.2 UNcamp图像集实验

图3为UNcamp图像集与不同算法的融合结果。其中图3(a)为红外图像,图中行人目标清晰可见,但缺乏行人所在的场景信息。图3(b)为可见光图像,它包含了目标需要的场景内容,如树木、房屋、围栏等。图3(c)~图3(f)分别为文献[7]、文献[8]、文献[14]和本文方法的融合图像。从视觉角度看,以上方法均成功融合了源图像的有效信息。但经过仔细观察,图3(c)对比度较低,亮度相对不高,图3(d)中行人目标偏暗,目标相对不够突出,图3(e)背景较为模糊,边缘不够对齐,视觉观感欠佳。本文融合图像边缘突出,对比度和亮度较好,目标突出,并且能够清晰看到远处路边生长的草块,相对于其它3种方法有较为明显的优势。

图3 UNcamp图像集与不同算法融合结果

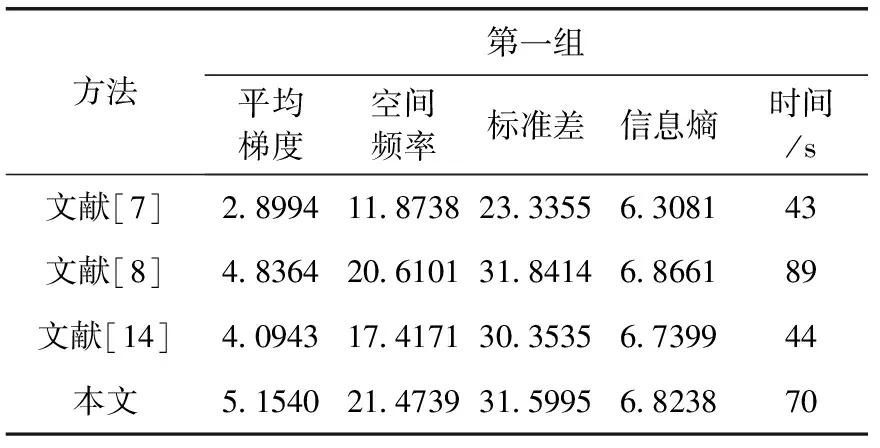

平均梯度反映了图像是否清晰,空间频率可以统计图像相邻像素间的差异,信息熵则表示了图像中信息量的大小[18-20]。本文采用以上指标以及标准差作为图像质量的客观评价指标。UNcamp图像集的客观评价结果见表1,表1可以看出本文融合图像的平均梯度、空间频率与其它方法相比有较大提升,图像的标准差、信息熵相对较高。本文算法采用的融合策略相对复杂,并且在融合过程中进一步采用SWT和LSCN模型,因此算法的融合速度相对一般。

表1 UNcamp图像集实验结果对比

4.3 其它测试集实验

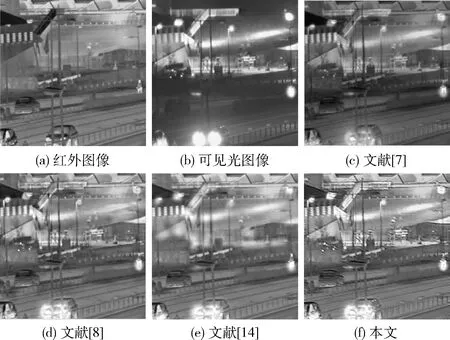

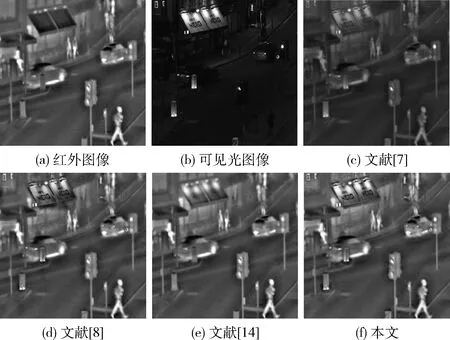

图4、图5为另外两组图像集的融合结果。从主观评价来看,图(c)仍有亮度偏低、对比度不高的情况,总体效果一般。图(d)总体效果较好,但部分区域存在背景缺失的现象。例如,图4中的远处灯光较暗,图5中的广告牌处有部分阴影产生。图(e)表现不佳,背景信息丢失严重,视觉观感较差。在这两组实验中,图(f)融合效果最好,整体看起来亮度适中,目标较为清晰,背景信息丰富,满足人眼的视觉舒适度。

图4 第一组图像与不同算法融合结果

图5 第二组图像与不同算法融合结果

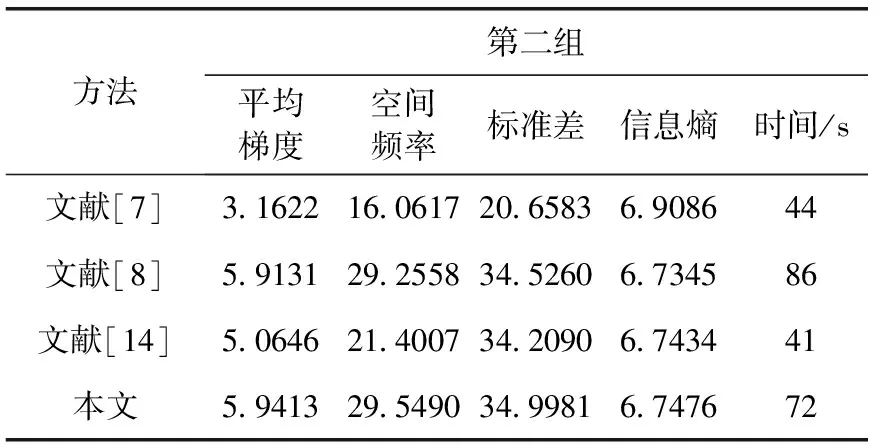

表2、表3分别为第一组、第二组融合实验的客观评价结果。从表2中可以看到,本文算法的各项指标均优于其它算法。本文算法的总体表现在表3中依旧最佳,各个指标相对比其它算法也都有所提升,但图像的信息熵要逊色于文献[7]。总体来说,本文算法在主观评价与客观评价两个方面表现均优于其它3种算法。

表2 第一组图像融合结果评价

表3 第二组图像融合结果评价

5 结束语

针对传统红外与可见光图像融合算法存在的不足,提出了一种基于IPCNN的图像融合算法。对NSCT低频子带进一步进行SWT分解,对SWT分解后的低频部分,使用局部能量与绝对值取大相结合的融合方法。采用CS理论对SWT分解后的高频部分进行融合,可以减少融合过程中的计算量。针对NSCT分解得到的高频子带采用分层融合的策略,分别采用绝对值取大和IPCNN模型对高频子带的最高层和其余各层进行融合。本文在高频融合过程中还引入了一种LSCN模型,能够进一步增强图像的细节信息。实验结果表明本文算法的各项评价指标均优于其它算法,视觉观感较好,是一种切实可行的融合方法。